하나의 AI가 '다 잘한다'는 환상이 깨지고 있다

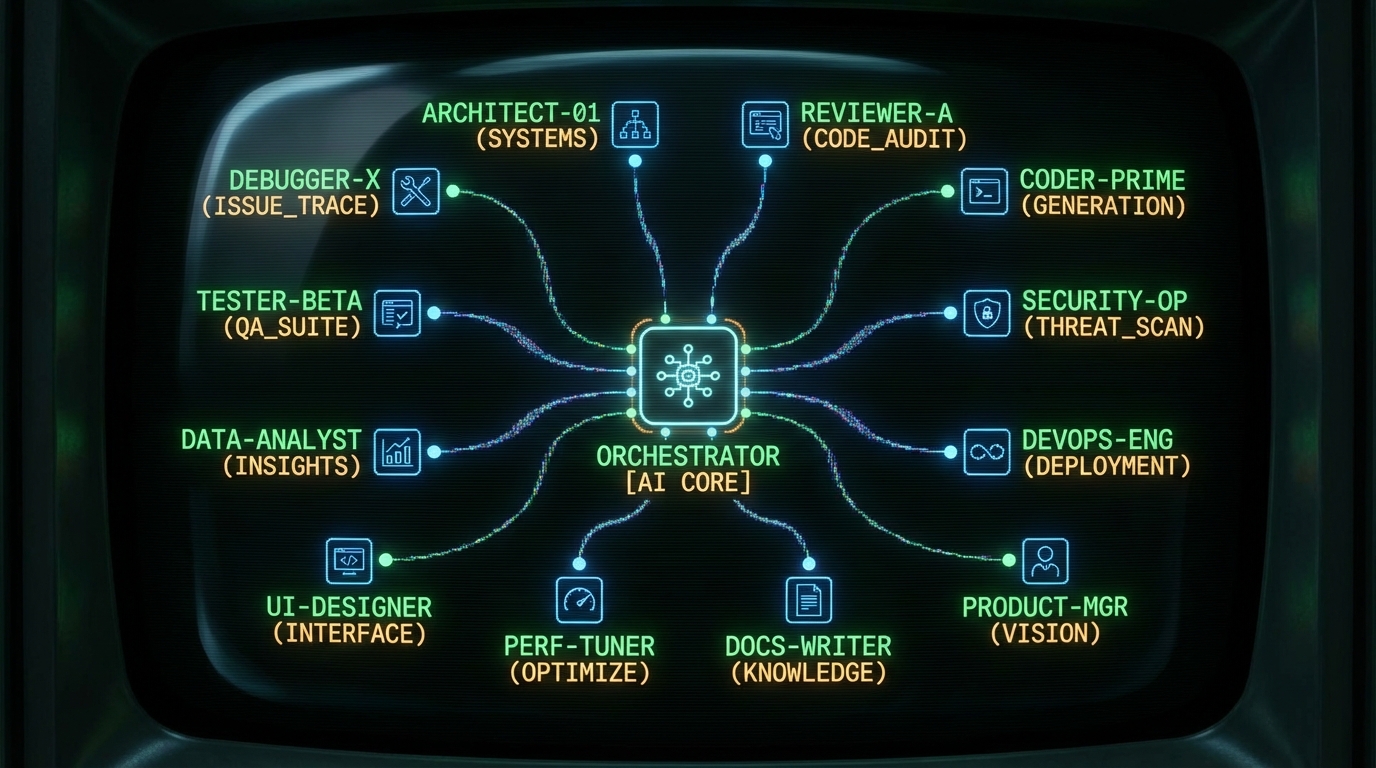

솔직히 말하면, 저도 처음엔 Claude Code 하나로 다 되는 줄 알았습니다. 코드 작성, 리뷰, 디버깅, Git 관리까지 — 범용 AI 에이전트 하나면 충분하다고요. 그런데 실전에서 부딪혀보면 금방 한계가 드러납니다. 컨텍스트가 희석되고, 같은 패턴이 피처마다 다르게 구현되고, 자기가 쓴 코드를 자기가 리뷰하니 '세컨드 오피니언'이 없습니다. dev.to에 올라온 Matkarimov의 사례가 정확히 이 문제를 짚습니다. 그는 Claude Code 하나를 12개의 전문 서브 에이전트로 쪼갰고, 결과는 '모든 걸 어중간하게 아는 제너럴리스트' 대신 '자기 도메인을 깊게 아는 스페셜리스트 팀'이었습니다.

코드에 적용하던 '관심사 분리'를 AI 워크플로우에도 적용하다

핵심 아이디어는 놀랍도록 단순합니다. 소프트웨어 설계에서 당연하게 쓰는 Separation of Concerns 원칙을 AI 에이전트 운영에 그대로 적용한 겁니다. ~/.claude/agents/ 디렉토리에 마크다운 파일로 정의된 각 에이전트는 독립적인 시스템 프롬프트, 도구 접근 권한, 모델 선택을 갖습니다. 메인 Claude 세션이 오케스트레이터 역할을 하고, 피처 구현은 senior-dev에게, 코드 리뷰는 code-reviewer에게, 타입 생성은 schema-type-generator에게 위임하는 구조입니다.

여기서 인상적인 건 모델 티어링 전략입니다. 복잡한 추론이 필요한 구현·디버깅·리팩터링에는 Opus를, 패턴 매칭과 일관성이 중요한 코드 리뷰·타입 생성·보안 감사에는 Sonnet을, 커밋 메시지나 브랜치 생성 같은 반복 작업에는 Haiku를 배정합니다. 이거 Claude한테 물어보니까, 비용 대비 효율의 관점에서 완전히 합리적인 설계더라고요. 모든 작업에 최고 성능 모델을 쓸 필요가 없다는 건 팀 인력 배치와 똑같은 논리입니다.

CLI가 IDE를 이기는 이유: 조합 가능성과 맥락 이해

멀티 에이전트를 CLI 기반으로 운영하는 것에는 구조적 이점이 있습니다. 또 다른 dev.to 아티클에서 한 개발자가 30일간 측정한 결과가 이를 뒷받침합니다 — AI CLI 도구 사용 시 코드 리뷰 시간 60% 감소, 버그 수정 시간 45% 감소, 보일러플레이트 코드 작성 80% 감소, 전체 배포 속도 2.3배 향상.

git diff main | claude "review this PR for security issues" | tee review.md — 이런 유닉스 파이프라인 조합이 가능하다는 게 핵심입니다. IDE 플러그인에선 꿈도 못 꿀 일이죠. SSH 접속 환경이든 Docker 컨테이너 안이든 터미널만 있으면 동작합니다. AI가 단일 파일이 아니라 리포 전체, 설정 파일, Git 히스토리까지 읽고 프로젝트 컨벤션을 이해한다는 점에서, 이건 자동완성이 아니라 맥락을 가진 동료에 가깝습니다.

그런데 진짜 문제는 여기서 시작된다: AI가 일하면 나는 뭘 하나

AI 멀티 에이전트가 팀처럼 동작하면, 자연스럽게 떠오르는 질문이 있습니다. "그럼 나는 뭘 하지?" Arafatweb의 글이 이 불편한 진실을 정면으로 다룹니다. AI가 문제를 즉시 풀어주면 고투(struggle)가 사라지고, 디버깅을 건너뛰게 되며, 아키텍처 사고력이 약해진다고요.

이건 AI-First 팀 리빌딩을 추진하는 저에게도 가장 경계하는 지점입니다. 팀원들에게 AI-First 마인드를 심어줘야 하지만, 동시에 "AI가 생성해준 걸 기반으로 우리가 다듬으면..."이라는 협업 모델이 작동하려면, 인간 쪽의 판단력이 살아있어야 합니다. 해법은 명확합니다: '솔루션을 달라'가 아니라 '이게 왜 느린지 설명해줘'로 프롬프트 방향을 바꾸는 것. AI가 생성한 코드를 자기 손으로 다시 써보는 것. 때때로 AI 없이 디버깅하는 것.

AI가 '팀원처럼' 행동할 때, 운영 규율이 필수다

SashiDo 팀의 글에서 가장 날카로운 통찰은 이겁니다: 모델이 자율적으로 느껴지는 순간, 병목은 '코드를 쓸 수 있나'에서 '우리 프로덕트가 AI의 산출물을 안전하게 수용할 수 있나'로 이동한다. 벤치마크 점수와 실전 체감은 다른 차원이고, 모델이 데이터를 조회하는 것과 실제로 변경하는 것 사이에는 반드시 하드라인이 있어야 합니다.

실전 팁으로, 이들은 '가장 어려운 프로덕션 유사 태스크부터 던져라', '구조화된 평가와 손맛 체크를 분리하라', '도구 접근을 명시적·감사 가능·되돌릴 수 있게 만들라'는 3단계 루프를 제안합니다. 스테이징 환경에 강력한 어드민 토큰을 그냥 넘기는 실수 — 이게 스테이징이 의도치 않게 프로덕션이 되는 경로라는 경고는 AI 에이전트 운영에서 반드시 새겨들어야 할 대목입니다.

시사점: AI 멀티 에이전트는 '팀 구조의 코드화'다

결국 Claude Code 멀티 에이전트 설계가 보여주는 건, 팀의 역할 분담과 코드 리뷰 프로세스와 품질 기준을 마크다운 파일로 코드화할 수 있다는 가능성입니다. senior-dev 에이전트의 시스템 프롬프트에 '타입 먼저, 스키마 다음, 서비스 그다음, UI는 마지막'이라는 빌드 순서가 명시된 건, 사실상 팀 컨벤션 문서를 실행 가능한 형태로 바꾼 겁니다.

이거 자동화하면 우리가 더 중요한 일에 집중할 수 있어요 — 아키텍처 의사결정, 제품 방향성 판단, 사용자 경험 설계 같은 것들이요. AI 멀티 에이전트는 팀원을 대체하는 게 아니라, 팀의 운영 체계 자체를 버전 관리 가능한 인프라로 전환하는 겁니다.

다만 잊지 말아야 할 건 이겁니다. AI가 12명의 전문가처럼 동작하더라도, 그 12명에게 일을 배분하고 결과를 판단하는 '테크 리드'의 역할은 사라지지 않습니다. 오히려 더 중요해집니다. 미래는 프롬프트만 잘 치는 개발자가 아니라, AI 팀의 아웃풋을 판단하고 교정할 수 있는 개발자에게 열려 있습니다.