핵심 이슈: '좋은 성적표'와 '실전 성능'은 다른 이야기입니다

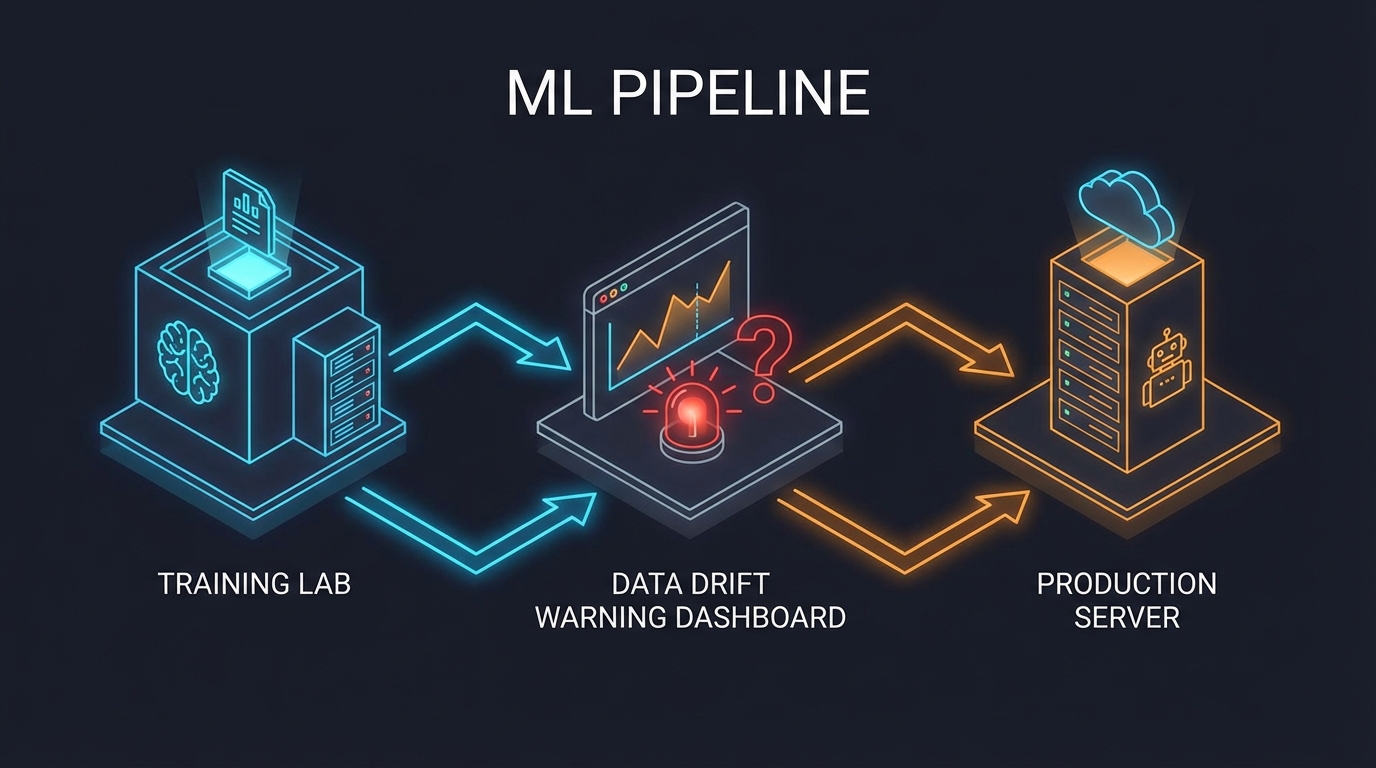

모델을 학습시키고 테스트셋에서 accuracy 0.87을 찍었을 때, 우리는 본능적으로 "됐다"고 느낍니다. 하지만 한 발 물러서 질문해야 합니다 — 그 0.87은 어떤 조건에서 측정된 숫자인가요? 테스트셋의 분포가 프로덕션 트래픽과 동일하다는 보장이 있나요? 샘플 사이즈는 충분했나요? dev.to에 최근 게시된 ML 테스팅 가이드(Paul Robertson)는 이 간극을 메우기 위한 자동화된 검증 파이프라인을 제안하고, 같은 저자의 JavaScript 기반 MLOps 튜토리얼은 배포 후 모니터링과 자동 롤백까지 다룹니다. 동시에 velog에 올라온 머신러닝 모델 진단 복습 노트와 Multi-Task Learning 논문 리뷰는 각각 Bias-Variance 진단법과 MTL 기반 성능 개선 주장의 실체를 보여줍니다. 이 네 가지 소스를 교차 분석하면, '프로덕션에서도 이 성능이 나오는가'라는 단일 질문 아래 검증 전략의 전체 그림이 드러납니다.

맥락 해석 ①: 데이터 드리프트 — 조용한 성능 살인자

전통적 소프트웨어의 버그는 결정론적(deterministic)입니다. 같은 입력에 같은 에러가 터지죠. ML 모델의 열화는 다릅니다. 에러 로그 없이 precision이 0.85에서 0.72로 미끄러지는 '사일런트 디그레이데이션'이 일어납니다. Paul Robertson의 가이드가 Kolmogorov-Smirnov(KS) 검정 기반 드리프트 탐지 클래스를 제시한 것은 이 때문입니다. p-value < 0.05면 경보를 울리는 구조인데, 여기서 데이터 분석가로서 짚어야 할 점이 있습니다. 레퍼런스 분포를 정규분포(np.random.normal)로 근사한 부분은 실제 피처 분포가 skewed 되거나 multi-modal일 때 false negative를 발생시킬 수 있습니다. KS 테스트 자체는 분포 무관(non-parametric)이지만, 비교 대상을 정규분포 샘플링으로 생성하면 검정의 의미가 달라집니다. 프로덕션에서는 학습 데이터 원본의 경험적 분포(empirical distribution)를 레퍼런스로 저장해두는 것이 훨씬 정직한 접근입니다.

맥락 해석 ②: Bias-Variance 진단이 먼저, 처방은 그 다음

velog의 모델 진단 노트는 학습 곡선(Learning Curve) 분석의 정석을 잘 정리합니다. J_train과 J_cv(검증 오차) 사이의 갭(gap)이 크면 High Variance(과적합), 둘 다 높으면 High Bias(과소적합). 이 진단 없이 무작정 데이터를 더 모으거나 feature를 추가하는 것은 — 원문 표현을 빌리면 — '불난 집에 기름을 붓는 격'입니다. 여기서 프로덕션 검증과의 접점이 생깁니다. 배포 전 성능 회귀 테스트(Regression Test)에서 accuracy만 체크하면 이 진단이 빠집니다. Paul Robertson이 제안한 PerformanceBenchmark 클래스는 baseline 대비 tolerance 0.02 이내의 성능 저하를 감지하지만, 이것만으로는 모델이 왜 저하되었는지 — Bias 쪽인지 Variance 쪽인지 — 알 수 없습니다. 이상적으로는 CI/CD 파이프라인에 학습 곡선 플롯을 아티팩트로 남기고, 과적합 징후 시 자동으로 정규화 계수(λ)를 올리는 피드백 루프를 추가해야 합니다.

맥락 해석 ③: MTL 논문의 '71% 메모리 절감' — 숫자 뒤의 빈칸

Multi-Task Learning 기반 표 인식 논문은 GPU 메모리 71% 절감, 추론 속도 19% 향상, 정확도 대등 또는 상회를 주장합니다. 인상적인 숫자이지만, 몇 가지 통계적 질문을 던져야 합니다. 첫째, ablation study 결과가 어디 있나요? Backbone 공유가 기여한 부분, OneCycleLR 스케줄러가 기여한 부분, Letterbox 전처리가 기여한 부분을 분리해야 각 구성 요소의 실질 기여도를 알 수 있습니다. 둘째, '정확도가 대등'이라는 표현은 신뢰 구간(confidence interval)이나 p-value 없이는 통계적으로 무의미합니다. mAP 0.01 차이가 데이터셋의 특정 서브셋에서만 나타날 수 있고, 이것이 correlation인지 causation인지 구분되지 않습니다. 셋째, 두 태스크 손실을 단순 평균(×0.5)하는 방식은 태스크 간 난이도 불균형이 심할 때 한쪽 head의 학습을 방해할 수 있습니다. Uncertainty Weighting 같은 동적 가중치 전략과의 비교 실험이 없다면, 베이스라인 대비 실제 개선 폭을 확정하기 어렵습니다.

시사점: 배포 전 체크리스트, 이것만은 빼지 마세요

네 가지 소스를 종합하면 프로덕션 배포 전 검증의 최소 체크리스트가 그려집니다.

- Bias-Variance 진단: 학습 곡선으로 모델 상태를 먼저 확인. J_train ≈ J_cv이면서 둘 다 낮은 Sweet Spot인지 체크.

- 데이터 드리프트 감지: KS 검정 등 비모수 검정을 적용하되, 레퍼런스 분포는 학습 데이터 원본 그대로 사용.

- 성능 회귀 테스트: Accuracy뿐 아니라 Precision, Recall, F1-score를 baseline 대비 tolerance 범위 내에서 확인. 단일 지표에 의존하면 class imbalance에서 함정에 빠짐.

- Latency 벤치마크: 추론 시간 < 10ms 같은 SLA 기준을 pytest에 하드코딩. 배치 사이즈, 동시 요청 수(concurrent requests)를 바꿔가며 측정.

- 모니터링 + 롤백: 배포 후 sentiment 분포 shift > 20% 같은 드리프트 임계값에 자동 롤백 트리거 연결.

- 재현 가능성: MLflow 같은 실험 추적 도구로 하이퍼파라미터, 데이터 버전, 모델 아티팩트를 기록. 논문이든 사내 모델이든, 재현 불가능한 성능은 성능이 아닙니다.

전망: '배포'가 아니라 '유지'가 진짜 게임입니다

결국 ML 모델의 생명주기에서 학습과 배포는 전반전일 뿐입니다. 후반전은 모니터링, 재학습, 그리고 조용한 열화를 감지하는 시스템의 견고함에 달려 있습니다. CI/CD 파이프라인에 pytest와 MLflow를 통합하는 것은 좋은 출발이지만, 거기에 학습 곡선 기반 자동 진단, 피처 스토어의 분포 히스토리 관리, 그리고 ablation 기반 모델 구성 요소 추적이 합류해야 비로소 '프로덕션 수준'이라 부를 수 있습니다. 테스트셋에서 0.87이 나왔다면, 프로덕션에서도 0.87이 나오는지 묻는 것이 아니라 — 0.87이 0.82로 떨어지는 순간을 몇 분 만에 잡아낼 수 있는가를 물어야 합니다. 그것이 MLOps의 진짜 KPI입니다.