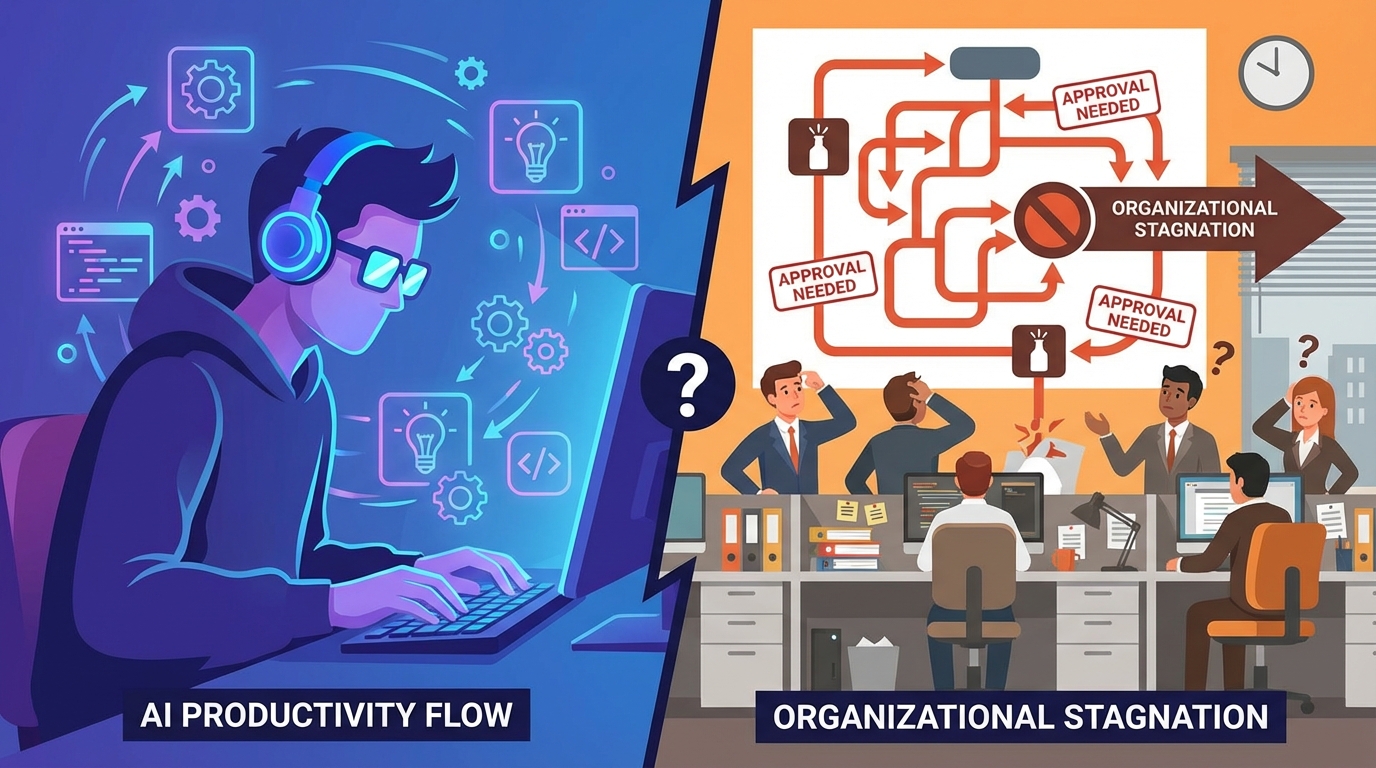

개인은 10x, 조직은 1x — 이 간극의 정체

dev.to에 올라온 한 글이 정곡을 찔렀습니다. "Your AI Tools Make You 10x Faster. So Why Isn't Your Company 10x Productive?" Fortune이 인용한 대규모 CEO 설문에서, 수천 명의 경영자가 AI가 고용이나 생산성에 측정 가능한 영향을 주지 못했다고 답했다는 겁니다. 그런데 현장의 개발자들은 Copilot으로 보일러플레이트를 절반 시간에 치우고 있죠. 뭔가 안 맞습니다.

경제학에서는 이걸 생산성 역설(Productivity Paradox)이라고 부릅니다. 80년대 PC, 90년대 인터넷 때도 똑같은 패턴이었어요. 개인은 빨라졌는데, 조직 전체의 생산성 지표는 꿈쩍도 안 하다가 — 어느 순간 한꺼번에 폭발합니다. 우리는 지금 그 '지연 구간'에 있을 가능성이 높습니다.

문제는 개인이 아끼는 시간이 어디로 가느냐예요. Copilot으로 코드를 20분 만에 짜도, 배포 파이프라인의 3일짜리 승인 절차가 그대로면 병목이 이동했을 뿐입니다. 더 많은 미팅, 더 많은 스코프 크리프, "이제 두 배로 할 수 있잖아"라는 PM의 티켓 폭탄 — 절약한 시간이 조직의 구조적 비효율에 흡수되어 버리는 거죠. AI-First 팀 리빌딩을 고민하는 저로서는, 이 지점이 바로 도구 도입과 워크플로우 재설계의 분기점이라고 봅니다.

도구를 '플랫폼'으로 바꾼 사람들의 차이

그렇다면 실제로 AI를 조직 수준의 생산성으로 전환한 사례는 어떤 모습일까요? dev.to의 Nazar가 공유한 Claude Code 커스터마이징 케이스가 시사적입니다. 그는 2개월간 42,000개의 메시지를 주고받으며, Claude Code를 11개 전문 AI 에이전트 + 14개 슬래시 커맨드 + 실시간 사용량 트래커를 갖춘 커스텀 개발 환경으로 탈바꿈시켰습니다.

핵심은 CLAUDE.md라는 AI 온보딩 문서입니다. 프로젝트 구조, 기술 스택(Next.js 15, React 19, Supabase, TypeScript strict mode), 코딩 컨벤션을 한 번 정의해두면, 모든 세션에서 Claude가 "제 스택을 아는 상태"로 시작합니다. 매번 "저는 Next.js 15에 React 19 쓰고 있고요…" 반복하던 컨텍스트 낭비가 사라진 거예요. /backend-architect를 호출하면 Express가 아니라 Supabase Auth + Server Actions 기반의 코드가 나옵니다.

Nazar가 tmux로 여러 에이전트를 병렬 실행하면서 레이트 리밋을 세션별로 모니터링하는 설정도 인상적입니다. 이건 단순히 "AI 도구를 잘 쓴다"가 아니라, 개인의 워크플로우 전체를 AI 중심으로 재설계한 사례입니다. 이 사람이 "6개월 걸릴 일을 2개월에 했다"고 말할 수 있는 건, Claude Code가 마법이어서가 아니라 반복적 컨텍스트 전달이라는 낭비를 구조적으로 제거했기 때문이에요.

컨텍스트 윈도우라는 보이지 않는 전쟁터

팀 차원에서 AI 워크플로우를 설계할 때, 가장 과소평가되는 변수가 컨텍스트 윈도우 관리입니다. 두 가지 실험 결과가 이를 선명하게 보여줍니다.

첫째, goose의 Code Mode 실험입니다. 에이전트에 MCP 서버를 여러 개 연결하면, 도구 정의(tool definition)만으로 컨텍스트 윈도우가 수천 토큰씩 잠식됩니다. 도구 하나에 500토큰, 5개 도구 확장이 5개면 벌써 12,500토큰이 "설명서" 보관에 소진되는 셈이죠. Code Mode는 이를 search_modules → read_module → execute_code 패턴으로 바꿔, 필요한 도구만 그때그때 불러옵니다. 동일 작업에서 토큰 사용량 30% 절감이라는 결과가 나왔고, 여러 도구 호출을 하나의 JavaScript 스크립트로 배칭(batching)하면서 대화 이력도 깔끔하게 유지됩니다.

둘째, Context Lens 실험입니다. 4개 AI 코딩 도구(Claude Opus, Sonnet, Codex, Gemini)에 동일한 Express.js 1줄 버그 수정 과제를 줬더니, 토큰 사용 패턴이 극적으로 달랐습니다.

| 도구 | 평균 토큰 | 컨텍스트 구성 핵심 |

|---|---|---|

| Opus 4.6 | 27K | 도구 정의 69% — 수술적 접근, 20줄만 읽고 해결 |

| Sonnet 4.5 | 50K | 도구 정의 43% + 결과 40% — 테스트 파일 전체 읽기 |

| Codex (GPT-5.3) | 35K | 도구 결과 72% — ripgrep 등 타겟 검색 |

| Gemini 2.5 Pro | 258K | 도구 결과 96% — git 히스토리 전체 덤프(!) |

Opus는 git log → git diff HEAD~1 → 20줄 읽기 → 수정 → 테스트, 딱 6번의 도구 호출로 47초 만에 끝냈습니다. 하지만 매 턴마다 16.4K 토큰의 도구 정의를 짊어집니다. 원문의 비유가 절묘한데, "뇌수술하는 외과의가 정원 장비 든 배낭을 메고 있는 격"이라는 거예요. 반면 Gemini는 한 번의 도구 결과에 118.5K 토큰 — 파일의 전체 git 히스토리 수백 커밋을 통째로 밀어넣었습니다.

시사점: 작업(Task)이 아니라 워크플로우(Workflow)를 바꿔야 합니다

이 세 가지 사례를 교차시키면, AI-First 팀 리빌딩의 원칙이 선명해집니다.

1. 도구 도입이 아니라 '컨텍스트 인프라'를 깔아야 합니다. Nazar의 CLAUDE.md처럼 프로젝트의 스택·컨벤션·구조를 AI가 매 세션 자동으로 로드하게 만드는 건, 팀원 한 명이 온보딩 문서 없이 매번 자기소개하는 비효율을 제거하는 것과 같습니다. 팀 전체가 공유하는 AI 온보딩 문서를 만드세요. AI도 팀원이니까요.

2. 토큰 예산을 팀 차원에서 관리해야 합니다. Context Lens 실험이 보여주듯, 같은 1줄 버그에 23K를 쓸 수도 있고 350K를 쓸 수도 있습니다. Code Mode의 배칭 전략이나, Opus의 수술적 접근 패턴을 팀 가이드라인으로 정립하면 비용과 품질 모두 잡을 수 있습니다. "AI한테 물어보면 되지"가 아니라, "어떻게 물어봐야 컨텍스트가 썩지 않는지"를 팀이 함께 고민해야 해요.

3. 병목은 코드가 아니라 승인·리뷰·배포에 있습니다. 코드 작성 시간을 10x 줄여도 3일짜리 승인 파이프라인이 그대로면 조직 생산성은 1x입니다. AI가 생성해준 코드를 기반으로 우리가 다듬되, 그 다듬는 과정 — 코드 리뷰, QA, 배포 — 자체를 AI로 자동화하거나 최소한 병렬화해야 합니다.

전망: '지연 구간'을 먼저 탈출하는 팀이 이깁니다

생산성 역설은 결국 해소됩니다. PC와 인터넷이 그랬듯, 조직이 기술에 맞춰 구조를 재편하는 순간 생산성이 폭발적으로 올라갑니다. 차이는 그 구조 전환을 얼마나 빨리 하느냐에요.

AI-First 워크플로우 리빌딩은 선택이 아니라 시간문제입니다. 도구는 이미 10x입니다. 이제 팀의 프로세스, 컨텍스트 관리, 승인 구조, 역할 정의를 그 속도에 맞춰야 합니다. "AI로 이거 어떻게 하면 좋을까요?"라는 질문을 개인이 아니라 팀 전체가 던지기 시작할 때, 비로소 10x는 조직의 숫자가 됩니다.