로컬 AI는 이제 “멋진 데모”가 아니라 제품 성장 레버가 됐습니다. ggml.ai(=llama.cpp 창립팀)가 Hugging Face에 합류하며 로컬 LLM 스택이 사실상 표준화 궤도에 올라탔고(geeknews 인용), iOS에서는 Apple Intelligence가 ‘안 되는 유저’가 생각보다 많아 폴백 UX가 곧 Activation 문제로 직결됩니다(dev.to 인용). 여기에 OpenAI가 2030년까지 천문학적 컴퓨팅 지출을 가정하는 시나리오(dev.to 데일리 브리프 인용)는 “추론비 변동성”을 전제로 제품을 설계해야 한다는 경고처럼 들립니다.

맥락을 Growth로 번역하면 간단합니다. 유저는 AI 기능을 쓰러 왔는데 (1) 기기가 지원 안 되거나, (2) 설정이 꺼져 있거나, (3) 모델 다운로드가 끝나지 않았거나, (4) 네트워크/서버가 느리면—그 순간 퍼널이 새고, D1이 깨집니다. Apple Intelligence의 가용성은 하드웨어(A17 Pro 이상), 옵트인, 저장공간, 언어, 모델 준비 상태까지 조건이 겹치고(dev.to), ‘미지원’은 예외가 아니라 기본 케이스가 됩니다. 즉, AI 기능은 “있으면 좋은 옵션”이 아니라 “없어도 흐름이 이어지는 UX”로 설계해야 리텐션이 살아남습니다.

여기서 ggml.ai×Hugging Face 협업이 왜 중요한가요? 로컬 추론의 병목은 모델 품질보다 “배포/호환/패키징”이었습니다. HF가 transformers와의 원클릭 통합, GGUF/양자화 지원 속도, 로컬 배포 UX를 강화하겠다고 밝힌 건(geeknews), 곧 제품팀이 로컬 폴백을 ‘특수 케이스’가 아니라 ‘표준 옵션’으로 넣을 수 있다는 뜻입니다. 이거 바이럴 될 것 같은데? “내 데이터는 밖으로 안 나가요” 한 줄이 공유 포인트가 되거든요.

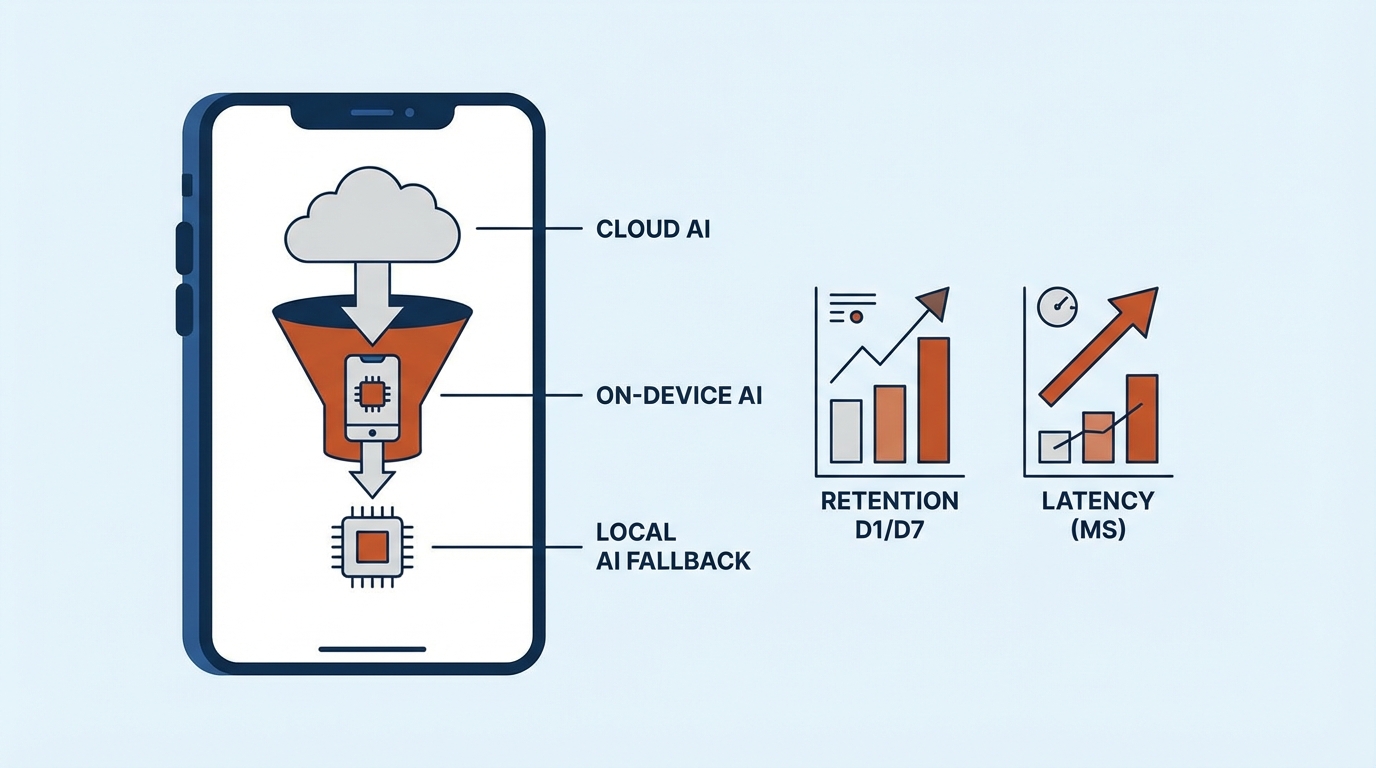

시사점은 세 가지입니다. 첫째, 온보딩에서 AI를 ‘단일 경로’로 두지 말고 3단 폴백을 강제하세요: 온디바이스(가능하면) → 로컬(gguf/양자화) → 클라우드. 유저가 어떤 기기든 첫 세션에 ‘작동하는 가치’를 보게 만드는 게 Activation의 핵심입니다. 둘째, Apple Intelligence 미지원 케이스를 상태값으로 제품화하세요(dev.to의 availability 분기처럼). “지원 안 함/설정 필요/다운로드 중”을 각기 다른 CTA로 다루면 이탈이 줄어듭니다. 예: 미지원=기본 기능 제공, 설정 필요=1회성 배너+가치 제안, 다운로드 중=기다림 UX+재시도. 셋째, 비용 구조를 프라이싱 실험으로 연결하세요. OpenAI가 상정한 수준의 컴퓨팅 경쟁(dev.to 데일리 브리프)은 추론비가 장기적으로 ‘싸질 수도, 요동칠 수도’ 있음을 뜻합니다. 그러니 패키지는 “AI 무제한” 같은 약속보다 “로컬 우선 + 클라우드 크레딧”처럼 원가를 통제 가능한 형태가 유리합니다. CAC가 너무 높아요—그럼 더더욱 추론비를 LTV에 안전하게 묶어야 합니다.

전망: 로컬 LLM은 앞으로 ‘성능 경쟁’보다 ‘표준화/UX 경쟁’에서 승부가 날 가능성이 큽니다. HF 생태계로 ggml/llama.cpp가 흡수되며 개발 난이도는 내려가고(geeknews), iOS의 Apple Intelligence는 강력하지만 단말/설정 제약 때문에 폴백 설계가 곧 제품 완성도가 됩니다(dev.to). 결론은 하나—빨리 테스트해봐야 돼! 로컬 폴백을 넣은 코호트 vs 클라우드 단일 경로 코호트로 D1/D7, 첫 작업 완료율, 도움말 진입률(실패 신호)을 A/B로 돌리면 됩니다. 로컬AI는 비용 절감 기술이기도 하지만, 진짜 임팩트는 “끊기지 않는 경험”으로 리텐션을 지키는 데서 터집니다.