핵심 이슈: 숫자가 클수록 먼저 물어야 하는 것들

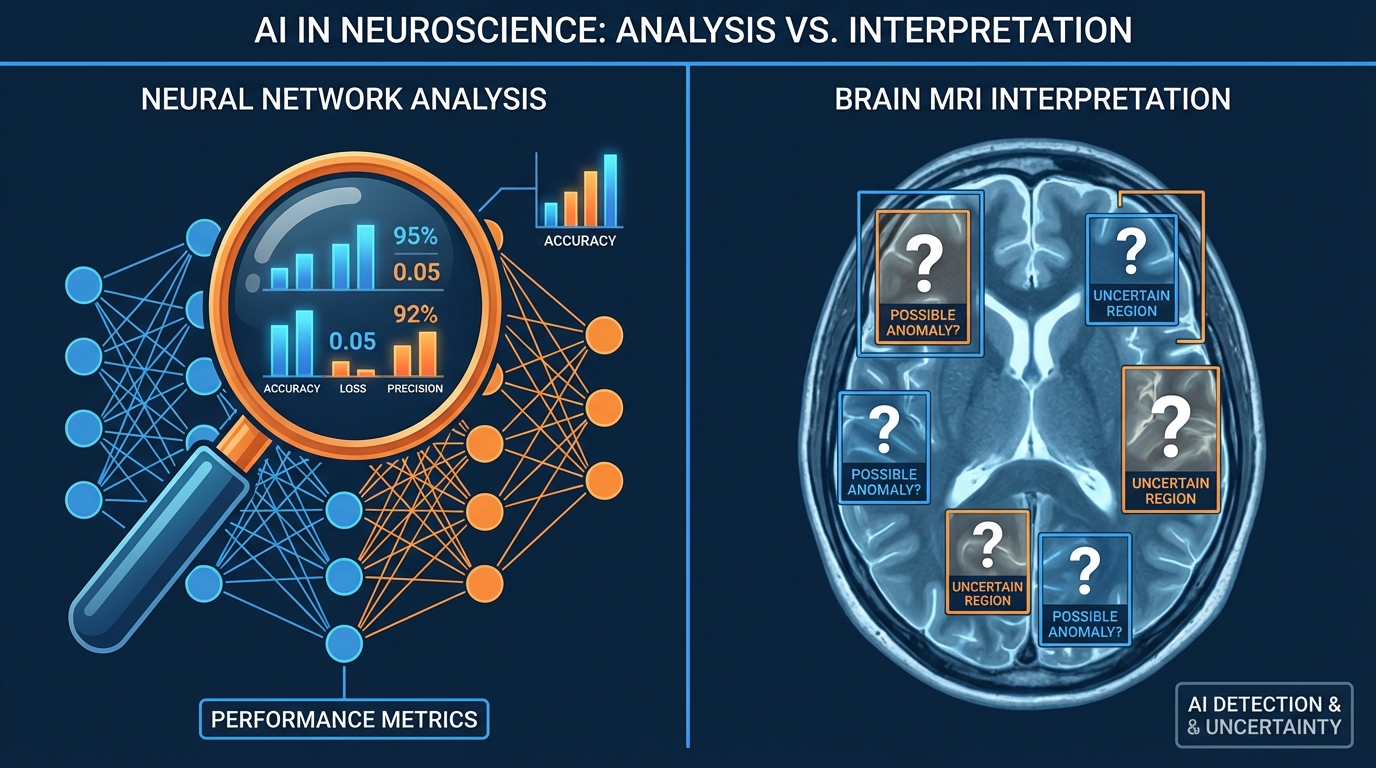

비전 AI 분야에서 성능 수치는 곧 신뢰의 통화입니다. '96.8% 정밀도로 뇌종양을 진단한다'는 헤드라인은 의료 현장의 기대를 끌어올리고, 'Zero-shot으로 ImageNet에서 ResNet-50에 필적한다'는 주장은 패러다임 전환의 증거로 인용됩니다. 그런데 근거는 있나요? 정확히 어떤 데이터에서, 어떤 베이스라인 대비, 어떤 분할(split) 전략으로 측정한 숫자인지를 묻는 순간, 두 사례의 신뢰도는 극단적으로 갈립니다.

CLIP: 실험 설계가 먼저 보이는 논문

OpenAI의 CLIP 논문(Radford et al., 2021, arXiv:2103.00020)은 4억 개 이미지-텍스트 쌍으로 구성된 WebImageText(WIT) 데이터셋 위에 대조 학습(contrastive learning)을 적용합니다. 핵심은 고정된 클래스 라벨 대신 자연어를 감독 신호로 사용하고, 이미지 인코더와 텍스트 인코더의 출력을 동일 차원의 공유 임베딩 공간에 정렬(alignment)하는 것입니다. 학습 목표 자체가 '분류'가 아니라 '관계'이므로, 전통적 의미의 Accuracy 한 숫자로 성능을 요약할 수 없다는 점을 논문 스스로 인지하고 있습니다.

데이터 관점에서 흥미로운 건 노이즈 전략입니다. 자연어 캡션은 부정확하고, 객체를 모두 설명하지 않으며, 문맥적 표현을 포함합니다. 논문은 이를 부정하지 않고 규모(scale)로 극복한다는 선택을 합니다. '정제된 소규모 라벨 → 노이즈가 있는 초대규모 데이터'라는 전환은 이후 LLM 훈련 철학과 정확히 맞닿습니다. 중요한 건 이 전략이 ablation에서 검증되었다는 점입니다. 클래스 이름만 사용할 때보다 문장 템플릿("A photo of a {class}")을 적용했을 때 성능이 개선되었고, ViT-L/14 인코더가 ResNet 대비 유의미한 향상을 보인 실험 결과가 제시됩니다. 베이스라인이 명확하고, 변수 통제가 가시적입니다.

물론 CLIP에도 물어야 할 질문이 있습니다. WIT 데이터셋은 비공개이므로 재현 가능성(reproducibility)에 한계가 있고, 4억 쌍의 데이터 분포에 어떤 편향이 내재하는지 — 영어 중심, 서양 문화권 이미지 과대 대표 — 는 후속 연구에서 반복적으로 지적되었습니다. Zero-shot ImageNet 성능이 supervised ResNet-50과 '유사하다'는 표현도, 정확히 어떤 Top-1/Top-5 지표에서 몇 퍼센트 포인트 차이인지를 따져봐야 합니다. 그럼에도 실험 설계의 투명성 면에서 CLIP은 '숫자를 어떻게 읽어야 하는지' 맥락을 함께 제공하는 논문입니다.

AnnotateAI의 96.8%: 빈칸이 너무 많다

반면, AnnotateAI의 뇌종양 진단 사례(dev.to 게시물)는 정반대입니다. 'YOLOv11이 96.8% precision으로 뇌종양을 탐지한다'고 주장하면서 참조로 달린 것은 "arXiv: YOLOv11: Real-time object detection with 96.8% precision"이라는 제목뿐입니다. 샘플 사이즈가 충분한가요? 어떤 데이터셋에서 측정했나요? Precision 96.8%라면 Recall은 얼마인가요? 의료 진단에서 Precision만 보고 Recall을 누락하면, '놓친 종양(False Negative)'의 비용이 완전히 가려집니다. F1-score, ROC-AUC, 혹은 민감도-특이도 분석 없이 단일 지표 하나로 임상 적용 가능성을 논하는 건 위험합니다.

더 근본적인 문제는 베이스라인의 부재입니다. 96.8%가 기존 방사선과 전문의 판독 대비 얼마나 개선된 것인지, 이전 YOLO 버전(v8, v9) 대비 어떤 마진인지가 빠져 있습니다. 게시물에서 인용한 '뇌종양 초기 오진율 30%'(Journal of Neuro-Oncology)라는 통계 역시, 해당 논문의 정확한 DOI나 연구 설계가 명시되지 않아 검증이 어렵습니다. HIPAA/SOC2 컴플라이언스를 강조하지만, 이는 데이터 보안 인증이지 모델 성능 검증과는 전혀 별개의 차원입니다. 이건 correlation이지 causation이 아닙니다 — 보안 인증이 높다고 진단 정확도가 담보되지는 않습니다.

그리고 실제 운영 환경에서도 이 성능이 나올까요? 뇌종양 영상은 장비(MRI 기종, 프로토콜), 환자군(연령, 종양 유형), 촬영 조건에 따라 분포가 극적으로 달라집니다. 학습 데이터와 배포 환경 사이의 데이터 드리프트(data drift)를 고려하지 않은 precision 숫자는 프로덕션에서 급격히 하락할 수 있습니다. 의료 AI에서는 단일 기관의 retrospective 데이터로 학습한 모델이 외부 기관 데이터에서 10~20%p 성능 하락을 보이는 사례가 흔합니다.

임베딩 검증이라는 제3의 교훈

재미있는 것은, 포켓몬 시맨틱 검색 프로젝트(dev.to, pgvector 활용)가 이 맥락에서 오히려 모범적인 벤치마크 설계를 보여준다는 점입니다. 151개 포켓몬에 대해 16개의 '의도적으로 단어 겹침이 없는' 쿼리를 설계하고, Hit@1(81~88%), Hit@5(94~100%), MRR@5(90.6%)를 모델 4종에 걸쳐 비교합니다. 샘플 사이즈는 작지만 실험 의도가 명확하고, 베이스라인(키워드 검색 = 0% 매칭)이 자명하며, 지표 선택의 근거가 설명됩니다. 비전 AI 성능 주장이 이 수준의 투명성이라도 갖추면 대화가 가능해집니다.

시사점: '숫자 하나'가 아니라 '실험 맥락 전체'를 읽어야 한다

비전 AI의 성능 주장을 해부할 때 최소한 다섯 가지를 물어야 합니다. 첫째, 베이스라인은 무엇인가 — 절대 수치가 아니라 상대적 개선폭이 의미를 가집니다. 둘째, Precision-Recall 트레이드오프 — 특히 의료·안전 도메인에서는 단일 지표가 위험합니다. 셋째, 데이터셋 크기와 분포 — 샘플 사이즈가 통계적 유의성을 담보하는지, 클래스 불균형은 없는지. 넷째, 재현 가능성 — 코드, 데이터, 하이퍼파라미터가 공개되었는지. 다섯째, 프로덕션 일반화 — 학습 분포와 배포 환경 사이의 갭이 측정되었는지.

전망: 멀티모달 시대, 검증의 복잡도도 멀티모달이다

CLIP 이후 Flamingo, BLIP, CoCa, 그리고 GPT-4V까지 멀티모달 모델은 빠르게 진화하고 있고, 의료·산업·로보틱스 도메인으로의 적용도 가속되고 있습니다. 그러나 모달리티가 늘어날수록 검증해야 할 축도 늘어납니다 — 이미지 품질, 텍스트 프롬프트의 민감도, 크로스모달 정렬의 공정성, 도메인별 분포 이동. '96.8%'라는 숫자 하나에 매료되기 전에, 그 숫자가 탄생한 실험실의 조건 전체를 펼쳐보는 습관이 필요합니다. 결국 모델의 진짜 실력은 논문의 실험 섹션, 그 중에서도 limitations 문단에서 드러납니다.