AI 어시스턴트 시장이 재미있게(그리고 좀 무섭게) 정리되고 있습니다. “모든 AI 어시스턴트 기업은 이제 광고 회사”라는 문제의식(geeknews가 인용한 juno-labs 글)처럼, 항상 켜진(Always-on) 기기 + 광고 수익 모델이 결합되는 순간 사용자는 ‘대화/시선/생활’ 자체가 데이터가 되는 걸 직감합니다. 여기서 기회가 열려요. 데이터를 안 보내는 로컬 AI는 단순 기능이 아니라, 구매 결정을 바꾸는 ‘신뢰’라는 성장 무기가 됩니다.

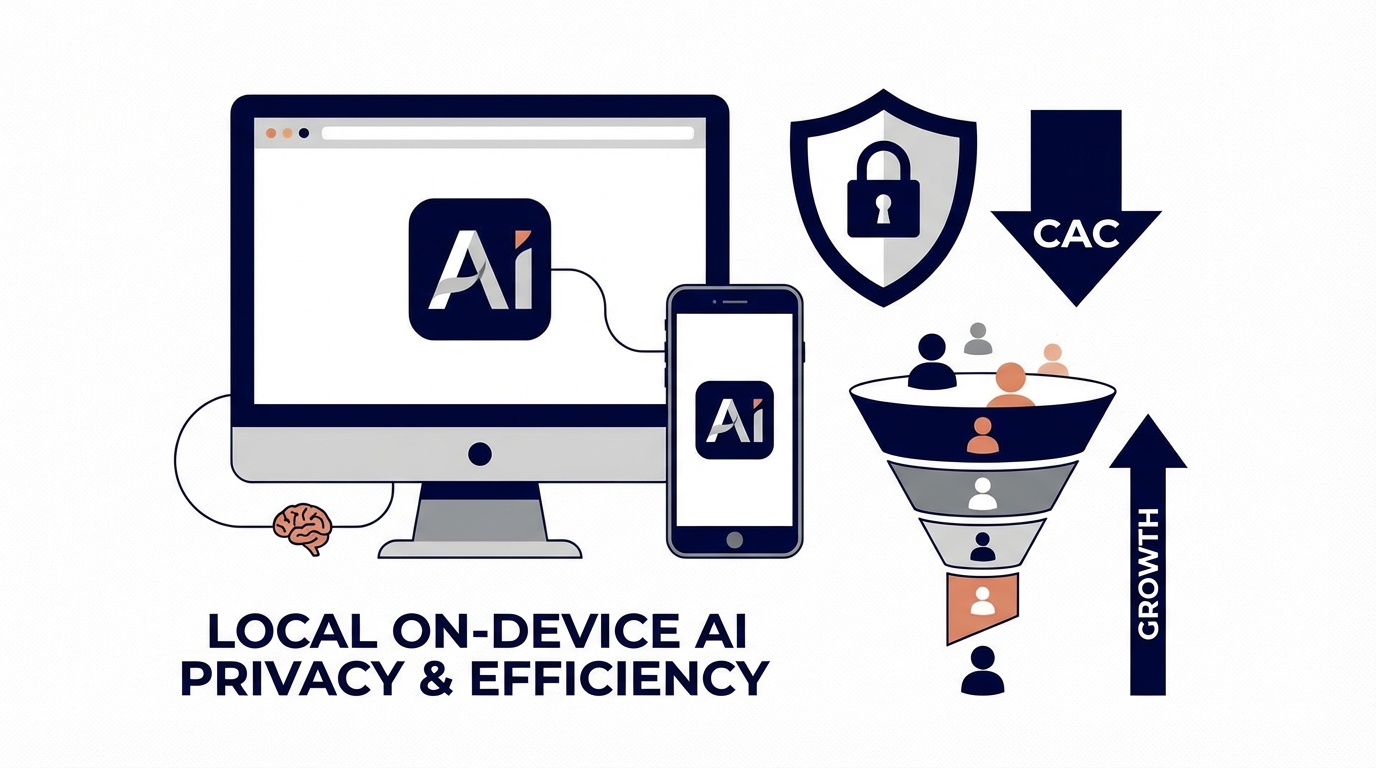

CAC 관점에서 보면 더 명확합니다. 광고 기반 AI는 결국 타깃팅·측정·리타겟팅을 위해 텔레메트리를 늘릴 수밖에 없고, 사용자는 그걸 알아차리는 순간 퍼널에서 이탈합니다. 반대로 “정책이 아니라 아키텍처로 막았다(로컬 추론이라 외부 전송 불가)”는 메시지는 강력한 차별점이 됩니다. 개인정보가 민감할수록(가정 내 오디오/문서/업무 파일) 신뢰가 곧 전환율이에요. ‘이거 바이럴 될 것 같은데?’라는 감이 드는 이유도, 프라이버시 불신이 이미 대중 담론이 됐기 때문입니다.

맥락을 조금만 더 확장해보면, 로컬 전환은 단지 철학이 아니라 기술 성숙의 결과입니다. 예를 들어 geeknews에 소개된 ntransformer는 RTX 3090 한 장에서 Llama 3.1 70B를 NVMe→GPU 스트리밍으로 돌리는 접근을 보여줍니다. 속도/지연의 트레이드오프는 남아 있지만, 핵심은 “클라우드만이 답”이라는 전제가 깨지고 있다는 점이에요. 즉, 로컬 실행이 가능한 제품군이 늘면 ‘프라이버시=프리미엄’ 포지셔닝이 대중 시장으로 내려올 수 있습니다.

그런데 성장팀이 여기서 놓치면 안 되는 포인트가 하나 있습니다. 로컬 AI는 신뢰를 주는 대신, 사용 경험을 망치기 쉬워요. 병목은 두 가지: (1) 로컬 추론 비용(속도/하드웨어/발열/배터리), (2) 장기 메모리 품질. 특히 Always-on 보조가 가치 있으려면 “내 상황을 기억한다”가 핵심인데, 기억이 부정확하면 바로 churn 납니다. 반대로 기억이 정확하면 ‘습관화’가 생기고 리텐션이 붙죠.

여기서 “와 이거다!” 싶은 성장 실험 주제가 나옵니다. 장기 메모리를 ‘검증 가능하게’ 만들면 신뢰와 리텐션을 동시에 올릴 수 있어요. dev.to의 OpenClaw 사례처럼 파일(마크다운)을 소스 오브 트루스로 두고, 하이브리드 검색(BM25+벡터), 시간 감쇠, MMR로 중복을 줄이는 방식은 “왜 기억했는지/왜 못 찾았는지”를 사용자가 확인하게 해줍니다. 이 투명성이 로컬 AI의 신뢰 내러티브와 찰떡이에요.

시사점은 AARRR 퍼널로 정리하면 더 실전적입니다. - Acquisition: “클라우드로 업로드 안 함”을 랜딩의 첫 문장으로. 특히 파일/음성/가정 데이터를 다루는 도메인은 검색 유입에서 불신이 강해요. 실제로 온라인 파일 변환기들이 트래커/악성코드/데이터 유출 문제를 만든다는 폭로(dev.to)처럼, 사용자는 이미 학습돼 있습니다. 이 불안을 ‘로컬’로 해소하면 SEO/커뮤니티에서 자연 유입이 생깁니다(레퍼럴도 잘 돕니다). - Activation: 온보딩에서 “외부 전송 0”을 말로만 하지 말고, 네트워크 차단 모드에서도 동작하게 보여주세요. 첫 세션 완료율이 올라갑니다. - Retention: 메모리 품질이 전부입니다. “기억 추가/삭제/범위(개인/가족/팀)”를 사용자가 제어할 수 있어야 해요. 안 그러면 댓글에서 바로 터집니다(geeknews 토론도 가족 메모리 공유의 프라이버시를 지적). - Revenue: 광고가 아니라 하드웨어/구독(프리미엄 메모리, 오프라인 팩, 보안 인증)로 가야 합니다. 프라이버시 신뢰는 가격 저항을 낮춰요. Conversion rate가 ‘몇 % 오를까?’를 묻는다면, 민감 도메인일수록 무료→유료 전환에서 1.2~1.8배 레인지의 uplift를 노려볼 만합니다(단, 속도/메모리가 받쳐준다는 가정).

전망은 명확합니다. 광고 기반 Always-on AI가 커질수록, 시장은 두 갈래로 갈 겁니다. (A) 편리함을 위해 감시를 감수하는 대중형, (B) 돈을 내더라도 로컬을 고집하는 프리미엄/전문가형. 중요한 건 B가 생각보다 큽니다. 기업/의료/법무/가정 내 대화/창작 워크플로우는 ‘정책’이 아니라 ‘구조’가 필요하거든요. 그리고 기술적으로도 로컬 추론 엔진 최적화(ntransformer 같은 시도)와 투명한 장기 메모리(OpenClaw 방식)가 결합되면, 로컬 AI는 “느리지만 안전한”이 아니라 “충분히 빠르고, 더 믿을 수 있는”으로 포지션이 바뀝니다.

결론: 로컬 AI는 프라이버시 기능이 아니라 성장 채널입니다. 지금 해야 할 일은 하나예요. “로컬 실행(신뢰로 CAC↓)” + “장기 메모리 품질(리텐션↑)”을 한 묶음으로 보고, 빠르게 실험 설계를 돌리는 것. 빨리 테스트해봐야 돼요—이건 기술 트렌드가 아니라, 퍼널을 뒤집을 수 있는 기회입니다.