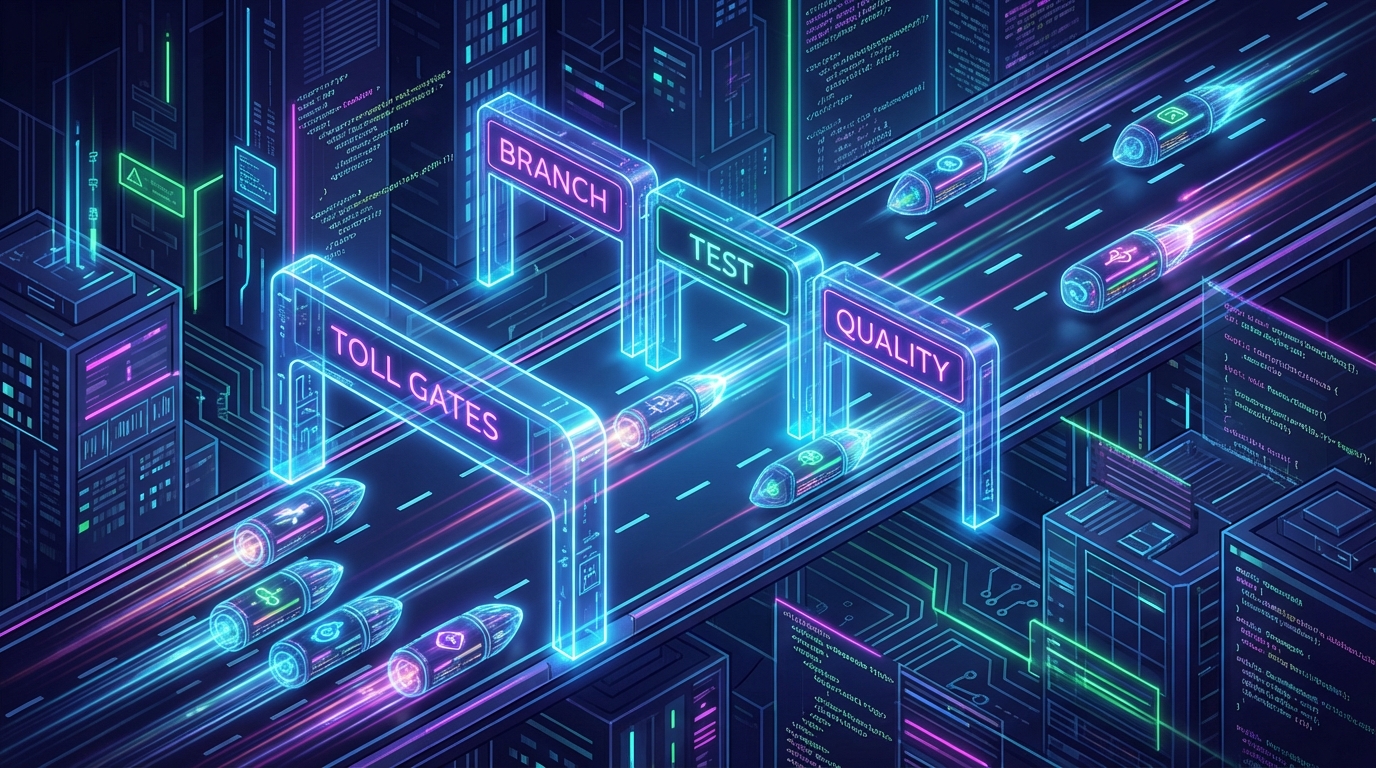

핵심 이슈: AI가 만든 '속도'가 기존 파이프라인을 부수고 있다

코딩 에이전트를 팀에 붙이면 코드 생산량은 폭발적으로 늘어납니다. 문제는 그 코드가 통과해야 할 파이프라인—브랜치 전략, CI 테스트, 품질 게이트—이 2~3년 전 설계 그대로라는 점입니다. Claude Code 같은 에이전트를 도입해 PR이 주 30개를 넘기 시작하면, GitFlow의 공유 dev 브랜치는 순식간에 병목이 됩니다. 우리 팀도 똑같은 벽에 부딪혔고, 이 글에서는 "파이프라인 자체를 바꾸지 않으면 AI-First는 구호에 그친다"는 관점에서 세 가지 실전 변화를 엮어봅니다.

1️⃣ 브랜치 전략: GitFlow → PReFlow, PR마다 세상을 하나 준다

Neno의 Founding Engineer Joel이 공유한 PReFlow 사례(dev.to)는 우리 팀에게도 꽤 자극적이었습니다. 핵심은 단순합니다. dev·staging 브랜치를 없애고, PR이 열릴 때마다 독립 프리뷰 환경(DB·서비스·URL 전부 분리)을 자동 생성하는 것입니다. Neno는 6명이 주 30~35개 PR을 머지하면서도 4개월간 배포 기인 다운타임 0%를 유지했고, PR 머지부터 프로덕션까지 평균 6분이 걸렸다고 합니다.

AI 에이전트가 동시다발적으로 PR을 생성하는 환경에서, 공유 dev 환경은 "누가 마지막에 배포했어?"라는 슬랙 메시지를 만들어내는 장치에 불과합니다. 이건 엔지니어링 문제가 아니라 스케줄링 문제죠. PReFlow가 그 카테고리를 통째로 제거합니다. 우리 팀에서도 Pulumi + GCP Cloud Run 기반 프리뷰 환경을 파일럿 중인데, "환경 경합(environment contention)"이 사라지니까 에이전트를 세 개 동시에 돌려도 서로 충돌이 없습니다.

2️⃣ CI 테스트: LLM 통합 테스트를 '토큰 0'으로 돌리는 법

PR은 빨라졌는데, CI에서 LLM API를 실제로 호출하면 두 가지가 터집니다. 비용과 비결정성. 하루 20번 CI가 도는데 매번 OpenAI 토큰을 태우면, 커밋 빈도에 비례해 청구서가 불어납니다. 게다가 모델 응답이 비결정적이라 어제 통과한 테스트가 오늘 실패하면, 팀은 테스트 스위트 자체를 못 믿게 됩니다.

ModelRiver가 공개한 'Test Mode'(dev.to) 접근법이 이 문제를 깔끔하게 풀었습니다. 워크플로우를 테스트 모드로 전환하면, 인증·라우팅·로깅은 실제 파이프라인을 타되 AI 프로바이더 호출만 스킵하고 사전 정의된 샘플 데이터를 반환합니다. 토큰 소모 0, 응답 결정적, 코드 변경 없음—세 마리 토끼를 잡는 셈이죠. 프론트엔드 팀이 AI 파이프라인 완성 전에 먼저 개발을 시작할 수 있다는 점도 실전에서 큽니다.

다만 Test Mode는 프롬프트 품질이나 페일오버 로직은 검증하지 못합니다. 프롬프트 회귀 테스트는 별도 레이어가 필요하고, 이 부분은 아직 업계 전체가 정답을 찾는 중입니다. 우리 팀은 "CI에서는 Test Mode로 구조 검증, 스테이징 샌드박스에서는 저비용 모델로 프롬프트 스모크 테스트"를 분리 운영하는 방향으로 가고 있습니다.

3️⃣ 품질 게이트: AI 생성 코드의 '바이브 스코어'를 CI에 걸어라

속도와 비용 문제를 해결해도, AI가 쏟아낸 코드의 품질이라는 마지막 관문이 남습니다. Stanford 2025 연구에 따르면 AI 생성 코드는 인간 작성 코드 대비 보안 취약점이 2.74배 많습니다. eval() 무분별 사용, 환각 임포트(hallucinated imports), 복붙 구조의 반복 함수—코드 리뷰에서 사람 눈으로 잡기 어려운 패턴들입니다.

vibe-check라는 CLI 도구(dev.to)는 AST 분석 기반 7개 탐지기(보안 25%, 반복 코드 15%, 제네릭 네이밍 15%, 환각 임포트 15% 등)로 파일별 0~100 '바이브 스코어'를 매깁니다. --threshold 60 옵션을 CI에 걸면, 고위험 파일이 포함된 PR은 자동으로 빌드를 실패시킬 수 있습니다. 아직 Python 전용이고 정적 분석의 한계가 있지만, "AI가 생성한 코드에 AI 기반 게이트를 건다"는 패턴 자체가 중요합니다.

시사점: 파이프라인을 바꿔야 '에이전트 3대 동시 운전'이 가능하다

정리하면, AI-First 팀이 실제로 교체해야 할 파이프라인은 세 조각입니다.

| 구간 | As-Is | To-Be |

|---|---|---|

| 브랜치/환경 | GitFlow + 공유 dev | PReFlow + PR별 독립 환경 |

| LLM CI 테스트 | 실제 API 호출 (비용·비결정성) | Test Mode (토큰 0, 결정적 응답) |

| 품질 게이트 | 사람 리뷰 의존 | AST 기반 바이브 스코어 + CI 연동 |

코딩 에이전트의 생산성 향상 자체는 이미 입증된 이야기입니다. 보일러플레이트 생성, 유닛 테스트 작성, 리팩터링 가속—이런 건 Claude Code 같은 에이전트를 붙이면 바로 체감됩니다. 진짜 병목은 그 '쏟아진 코드'가 프로덕션까지 가는 길목에 있습니다. 에이전트 도입의 ROI는 코드 생성 속도가 아니라, 파이프라인이 그 속도를 소화할 수 있느냐에서 결정됩니다.

우리 팀에서도 "AI로 코드 짜는 건 20%의 문제고, 그 코드를 안전하게 머지하고 검증하고 배포하는 게 80%의 문제"라는 말이 자주 나옵니다. AI-First 팀 리빌딩의 다음 스텝은 에이전트를 더 좋은 걸로 바꾸는 게 아니라, 에이전트가 만든 코드가 달리는 도로 자체를 재설계하는 것입니다. PReFlow 같은 환경 격리, Test Mode 같은 비용 제어, vibe-check 같은 품질 게이트—이 세 가지를 CI/CD에 끼워 넣는 팀이 AI 시대의 속도를 실제 프로덕션 안정성으로 전환할 수 있습니다.