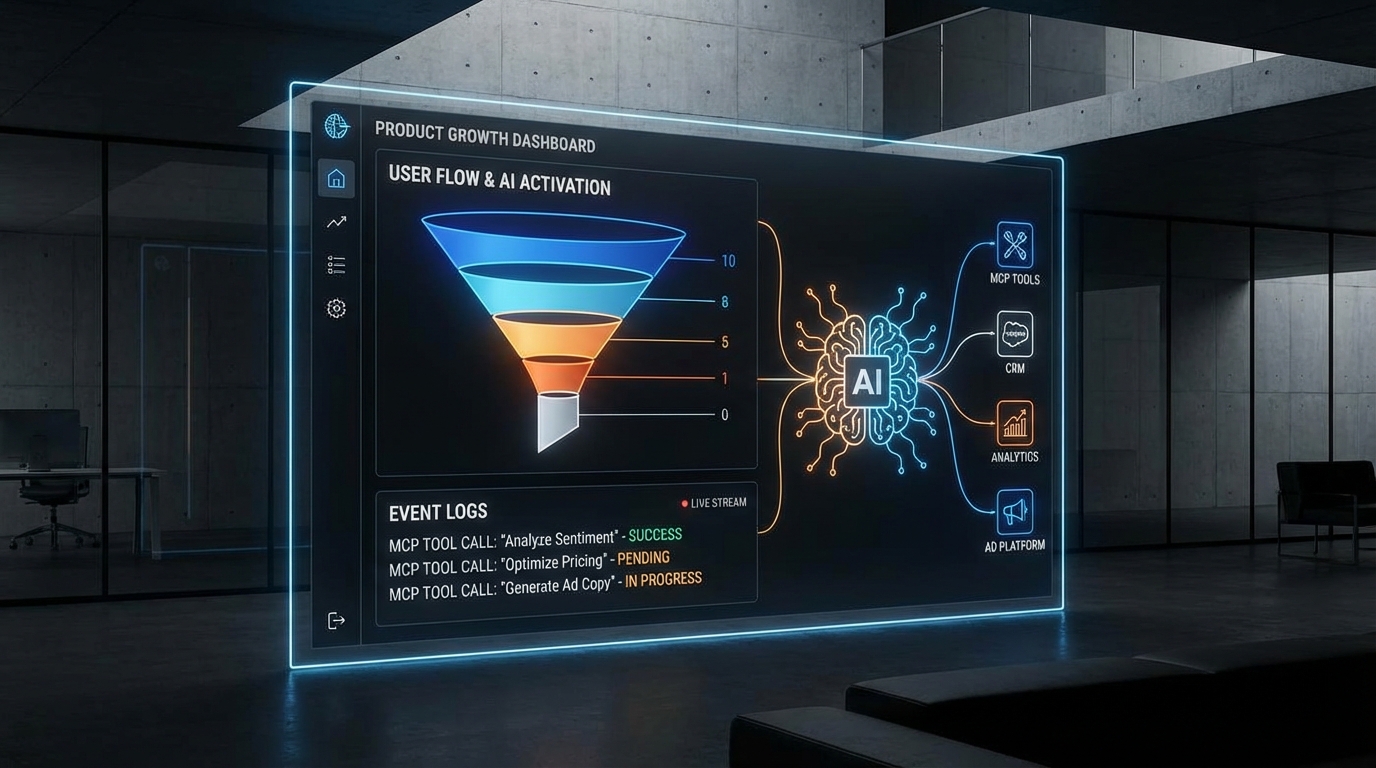

AI 에이전트 기능을 제품에 붙였는데도 전환이 안 오른다면, 대부분 원인은 하나입니다. 에이전트가 “말”만 하고 “행동”을 못 하거나, 행동은 하는데 “측정”이 안 됩니다. 이 둘이 겹치면 퍼널 최적화는 감으로 하고, 리텐션은 운에 맡기게 되죠. 여기서 MCP(Model Context Protocol)가 퍼널을 여는 레버로 뜹니다.

dev.to의 PageBolt 사례는 너무 직관적입니다. 코딩 어시스턴트가 스크린샷 코드는 써주지만 실제 촬영은 못 해서, 사람이 실행→확인→설명하는 비효율 루프가 생깁니다. MCP 서버를 1st-party로 붙이니(“USB‑C 같은 표준”이라는 표현이 인상적), 대화 중에 스크린샷·PDF·OG 이미지·브라우저 플로우 녹화까지 ‘툴 유즈’가 즉시 발생합니다. 즉, 에이전트가 제품/웹의 상태를 직접 관측하고 다음 액션을 이어가는 구조가 됩니다(출처: dev.to PageBolt MCP 글).

이걸 그로스 관점으로 번역하면: MCP는 ‘새 채널’이 아니라 ‘새 퍼널’입니다. 기존 퍼널은 사람이 UI를 클릭하며 전환합니다. MCP가 열어주는 퍼널은 에이전트가 툴을 호출해 과업을 완료하며 전환합니다. 예를 들어 “결제 플로우 데모 영상 만들어줘”라는 요청이 실제 record_video 실행으로 끝나면, 사용자는 ‘결과물’을 얻고 즉시 다음 단계(공유/리뷰/배포)로 넘어갑니다. 마찰(Friction)이 줄어들면 Activation rate는 오를 확률이 큽니다.

그런데 여기서 중요한 질문: “Conversion rate가 얼마나 오를까요?” 답은 측정할 수 있느냐에 달려 있습니다. 툴 유즈가 발생하는 순간부터 이벤트가 찍혀야 합니다. Loki처럼 애플리케이션 로그를 즉시 푸시해 관측성을 확보하는 방식(출처: velog Spring Boot→Loki→Grafana)은, 에이전트 툴콜에도 그대로 적용됩니다. tool_call_started→tool_call_succeeded/failed→artifact_delivered→user_accepted 같은 이벤트 스키마를 잡아두면, “에이전트가 일을 했는데 왜 이탈하지?”를 퍼널로 분해할 수 있습니다.

시사점은 세 가지입니다. (1) A/B 테스트가 ‘UI’에서 ‘에이전트 워크플로우’로 확장됩니다. 같은 기능이라도 툴 호출 순서/프롬프트 템플릿/재시도 정책만 바꿔도 전환이 달라집니다. (2) CAC를 낮출 레퍼럴 모먼트가 생깁니다. PageBolt처럼 PR에 ‘내레이션 데모 영상’을 자동 코멘트로 달면, 팀 내부 공유가 쉬워지고 외부 공개 데모(커뮤니티/소셜)로도 전환이 빨라져요. “이거 바이럴 될 것 같은데?”는 결국 공유 가능한 산출물(영상/OG 이미지/리포트)을 에이전트가 자동 생산할 때 현실이 됩니다. (3) 리텐션은 ‘반복 과업 자동화’에서 나온다. QA, API 테스트, 데모 제작처럼 주기적으로 생기는 귀찮은 일을 MCP로 2분 셋업 후 해결하면(출처: Cursor/Claude Desktop 설정 예시), D7/D30 리텐션을 밀어올리는 훅이 됩니다.

전망: MCP는 표준화가 빠르게 진행 중이고, Postman Remote MCP처럼 테스트/워크플로우 도구까지 연결되기 시작했습니다(출처: velog Postman Remote MCP). 다음 단계는 뻔합니다. ‘툴 유즈 로그’가 곧 성장 데이터가 되는 시대. 하루 90만 이벤트를 처리한 사례가 말하듯(출처: dev.to 실시간 이벤트 트래킹 글), 스케일의 병목은 트래픽이 아니라 초기 설계입니다. 지금 해야 할 일은 “에이전트가 무엇을 했는지”를 기능 개발보다 먼저 정의하는 것. 빨리 테스트해봐야 돼요. MCP로 행동을 붙이고, 로그/이벤트로 관측성을 붙이면, 그 순간 퍼널이 열립니다.