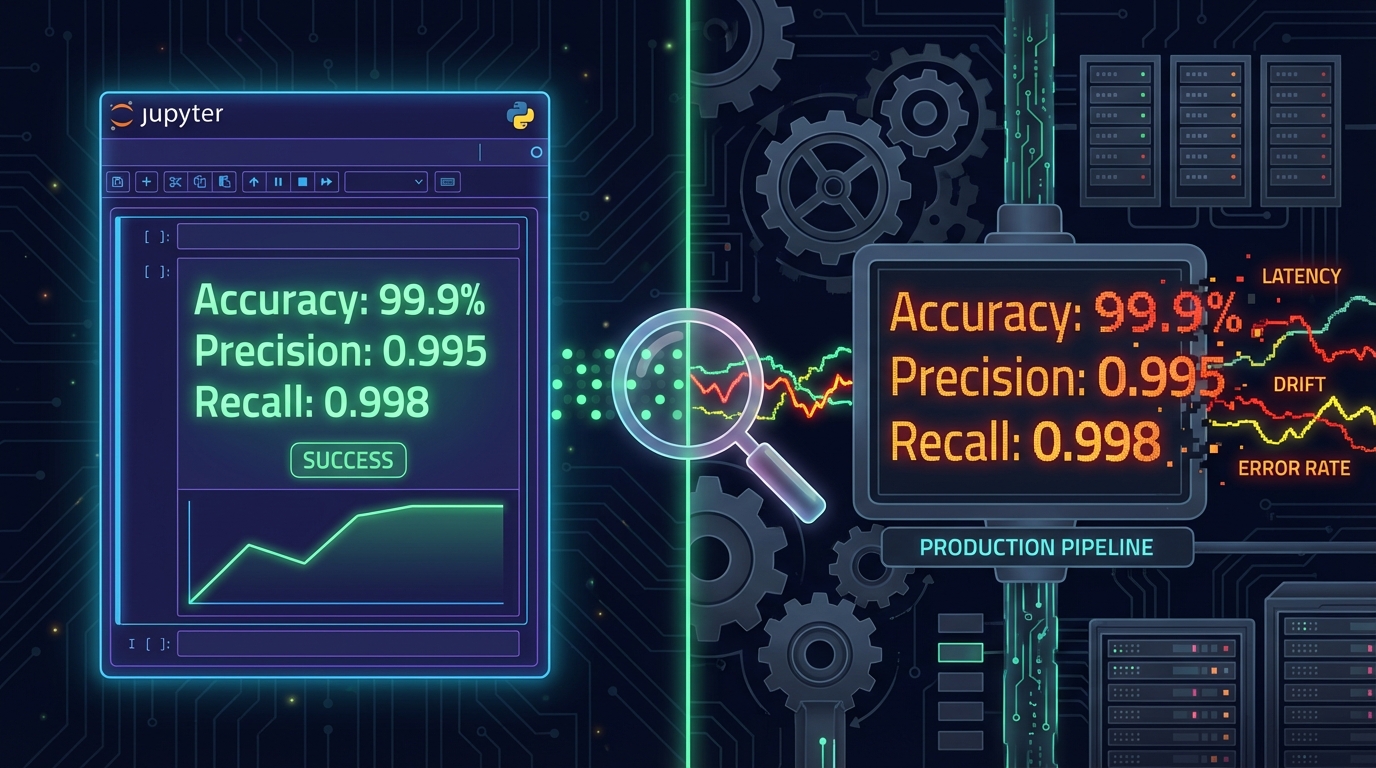

노트북 AUC 99%가 프로덕션에서 쓰레기가 되는 순간

근거는 있나요?—이 질문은 ML 모델이 Jupyter 노트북을 떠나 프로덕션 API로 이식되는 순간 가장 뼈아프게 돌아옵니다. 이번에 모인 네 건의 소스는 하나의 공통 서사를 관통합니다. 모델이 실험실을 떠나면 숫자가 무너진다. Training-Serving Skew, 4비트 양자화(NVFP4) 벤치마크, O(n²) 퍼지 매칭의 스케일링 한계, 극단적 데이터 희소성 속 물리 기반 확산 모델—각각의 문제를 데이터 분석가의 렌즈로 교차 검증해 봅니다.

1. Training-Serving Skew: '같은 피처'라는 착각

dev.to에 공유된 Training-Serving Skew 분석 글이 제시하는 시나리오는 단순하지만 치명적입니다. Python에서 null을 forward-fill하고, Java에서는 0으로 치환하는 순간 피처 분포 자체가 이동(shift) 합니다. AUC 99%를 찍은 모델이 운영 환경에서 쓰레기 예측을 내뱉는데, 코드가 크래시하지 않으니 몇 주간 발견되지 않습니다. 여기서 제가 던지고 싶은 질문은 이겁니다—베이스라인 대비 피처 분포 드리프트를 모니터링하고 있습니까?

해법으로 제안된 Feature Store(Feast, Tecton)의 핵심 가치는 '로직을 한 번만 정의한다(Define Logic Once)'는 원칙입니다. Offline(훈련)과 Online(추론)에서 동일한 변환 코드를 강제하고, Point-in-Time Correctness로 데이터 누수(Data Leakage)까지 차단합니다. 이건 단순한 인프라 투자가 아니라, 실험 결과의 재현성(reproducibility)을 프로덕션까지 연장하는 유일하게 검증된 아키텍처 패턴입니다. 수동 SQL로 valid-time 테이블을 조인하는 팀이라면, 이미 데이터 누수 사고가 발생했을 확률이 높습니다—다만 아직 발견하지 못했을 뿐입니다.

2. NVFP4 양자화: MLPerf 숫자, 얼마나 믿을 수 있나

엔비디아가 공개한 NVFP4 벤치마크(올포칩 보도)는 인상적인 수치를 내놓았습니다. 512개 Blackwell Ultra GPU로 Llama 3.1 405B 사전 훈련을 64.6분에 완료, 이전 FP8 라운드 대비 1.9배 속도 향상. 추론에서는 DeepSeek-R1(671B MoE)의 FP8→NVFP4 전환 시 토큰 처리량 증가를 확인했다고 합니다.

여기서 통계적 의심을 제기하겠습니다. 첫째, 1.9배 개선의 분해: GPU 세대 업그레이드(GB200→GB300 NVL72)와 NVFP4 포맷 자체의 기여를 분리하는 Ablation이 필요합니다. 하드웨어와 수치 포맷의 복합 효과를 한 숫자로 묶으면, NVFP4 고유의 기여분을 과대평가할 수 있습니다. 둘째, MLPerf 비공개(closed) 부문은 정확도 기준 충족만 확인하지, 정확도 손실의 크기를 세밀하게 보고하지 않습니다. 엔비디아가 공개한 DeepSeek-R1 평가 점수 그래프에서 'FP8 기준선과 매우 유사하게 일치'한다고 했지만, confidence interval이나 태스크별 분산은 명시되지 않았습니다.

그럼에도 긍정적인 시그널은 분명합니다. MLPerf Training 벤치마크는 업계에서 가장 엄격한 재현성 프로토콜을 갖추고 있고, 비공개 부문이라도 수렴(convergence) 요건을 통과해야 합니다. Black Forest Labs의 FLUX.2에서 단일 B200 기준 최대 6.3배 속도 향상이라는 실측 수치도 나왔습니다. 관건은 여러분의 모델, 여러분의 데이터에서 이 숫자가 재현되느냐입니다. 4비트 양자화는 모델 아키텍처·토큰 분포·컨텍스트 길이에 민감하므로, 프로덕션 적용 전 자체 벤치마크는 필수입니다.

3. O(n²)의 벽: 퍼지 매칭 스케일링의 현실

퍼지 매칭 스케일링 기사(dev.to)는 ML이 아닌 데이터 파이프라인 레벨에서 프로덕션 숫자가 무너지는 고전적 사례를 보여줍니다. 1,000건에서 100만 비교였던 것이 10만 건에서 100억 비교로 폭발합니다. 이 글이 제시하는 'pain band' 분류—50K까지는 로컬, 50K~200K는 블로킹, 200K~2M은 분산(Spark), 2M+ 는 Vector DB/MDM—는 실무적으로 꽤 정확합니다.

그러나 한 가지 빠진 관점이 있습니다. Precision-Recall 트레이드오프의 정량적 보고입니다. 블로킹 규칙이 너무 엄격하면 Recall이 떨어지고, 너무 느슨하면 비용이 폭증한다고 했지만, 각 스케일 밴드에서 실측 Precision/Recall이 어떻게 변하는지는 제시되지 않았습니다. 프로덕션에서 퍼지 매칭은 '충분히 좋은 근사'를 찾는 문제이므로, ANN(Approximate Nearest Neighbor) 검색의 recall@k 지표를 기준으로 평가해야 합니다.

4. 극한 희소 데이터: 물리 법칙이 prior가 될 때

Physics-Augmented Diffusion Modeling(PADM) 논문은 가장 도발적인 주장을 합니다. 전 세계 해안선의 15% 미만만이 전통 ML에 충분한 관측 데이터를 보유한 상황에서, 물리 법칙(Shallow Water Equations, Exner Equation)을 확산 모델의 score function에 직접 임베딩하여 물리적으로 타당한 시나리오를 생성한다는 것입니다.

아이디어 자체는 매력적이지만, 데이터 분석가로서 짚어야 할 점이 있습니다. 샘플 사이즈가 3년치 조위 관측 데이터라면, 모델 검증을 위한 held-out set은 어떻게 구성했습니까? physics_weight=0.3이라는 하이퍼파라미터 하나로 데이터 피델리티와 물리 제약의 균형을 잡는데, 이 값의 민감도 분석(sensitivity analysis)은 충분합니까? lambda_physics를 에폭에 따라 감쇠시키는 스케줄(1.0 / (1.0 + epoch/100))은 물리 제약을 점진적으로 완화하는 것인데, 이것이 정말 최적인지에 대한 Ablation study 결과가 보이지 않습니다. 물리 prior가 강한 모델일수록 '모델이 학습한 것'과 '사람이 주입한 것'의 경계가 모호해지므로, 해석 가능성(Interpretability) 확보가 더욱 중요합니다.

프로덕션으로 가는 길: 공통 시사점

네 가지 소스에서 추출한 패턴을 정리하면 이렇습니다:

| 문제 영역 | 실험실 숫자 | 프로덕션 리스크 | 검증 핵심 |

|---|---|---|---|

| Feature Skew | AUC 99% | Null 처리 불일치로 분포 이동 | Feature Store + 분포 모니터링 |

| NVFP4 양자화 | 1.9× 속도 향상 | HW/SW 복합 효과 미분리 | 자체 워크로드 벤치마크 |

| 퍼지 매칭 | O(n²) → 블로킹 | Recall 저하 미보고 | recall@k 정량 측정 |

| PADM 희소 데이터 | 물리 prior 주입 | 검증셋 부재, 하이퍼파라미터 민감도 | Ablation + held-out 교차 검증 |

결국 하나의 원칙으로 수렴합니다: '실제 운영 환경에서도 이 성능이 나올까요?' Correlation이 아니라 causation을 물어야 하고, 벤더 벤치마크가 아니라 자체 데이터에서의 재현이 증거가 됩니다. Feature Store는 스큐를 자동화로 제거하고, MLPerf는 양자화 정확도에 최소한의 신뢰 기준을 제공하며, 블로킹 전략은 O(n²)를 길들입니다. 하지만 이 모든 도구의 효과는—여러분이 직접 pd.DataFrame을 열어 분포를 확인하고, 지표의 confidence interval을 계산하고, Ablation을 돌려볼 때만 진짜가 됩니다.

모델은 실험실에서 태어나지만, 가치는 프로덕션에서 증명됩니다. 숫자를 의심하는 습관이 가장 강력한 MLOps 도구입니다.