핵심 이슈: 같은 주에 터진 세 개의 신호

지난주 AI 커뮤니티에 흥미로운 세 개의 뉴스가 거의 동시에 올라왔습니다. 가이드랩스(Guide Labs)는 내부 동작을 추적할 수 있는 오픈소스 LLM '스티어링-8B(Steerling-8B)'를 공개했고, 메릴랜드대·컬럼비아대 등 공동 연구진은 모델 구조 변경 없이 추론 속도를 최대 3배 높인다는 '자기 증류 기반 멀티 토큰 예측' 기법을 발표했습니다. 그리고 앤트로픽(Anthropic)은 딥시크(DeepSeek), 문샷 AI(Moonshot AI), 미니맥스(MiniMax) 등 중국 AI 연구소 세 곳이 약 2만 4000개의 허위 계정을 통해 1600만 건 이상 클로드(Claude)와 상호작용하며 불법 증류를 시도했다고 폭로했습니다(출처: AI타임스).

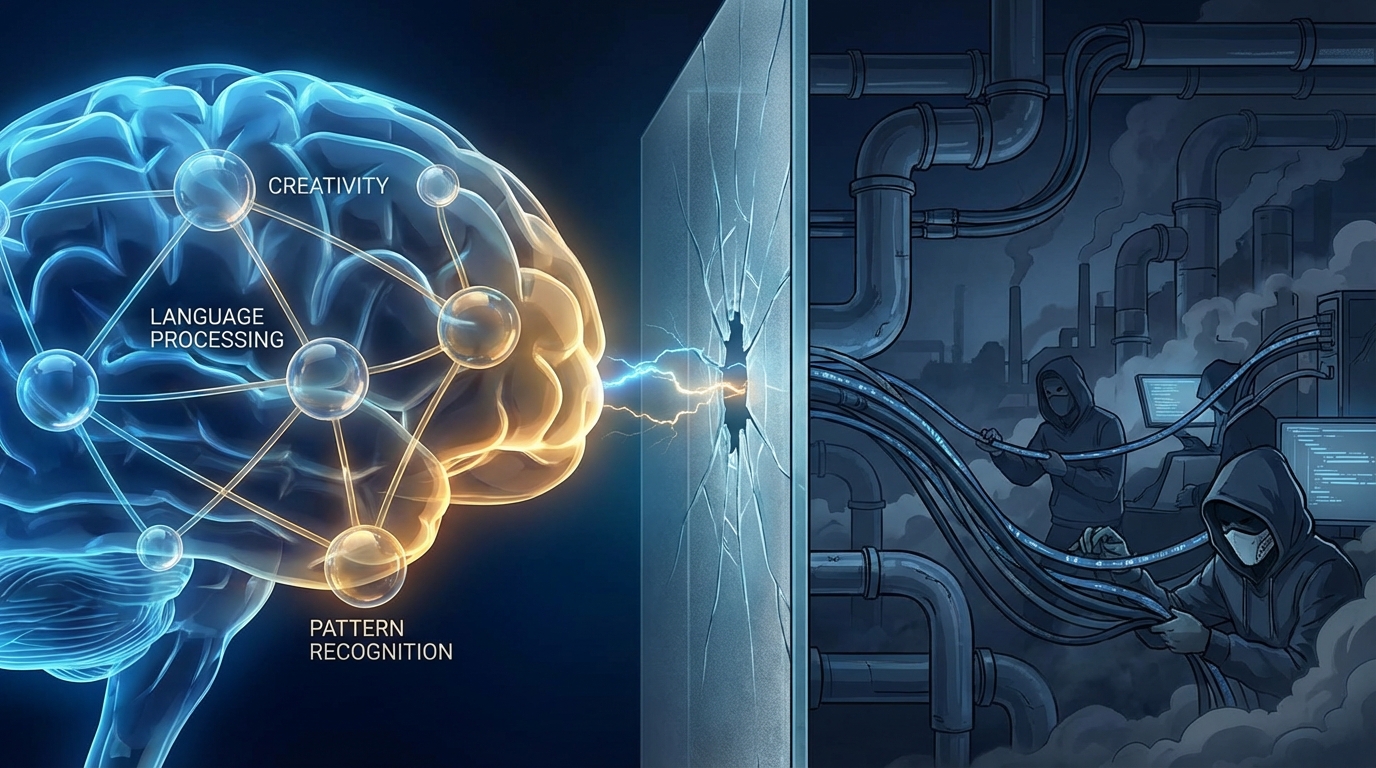

표면적으로는 별개의 사건이지만, 데이터 관점에서 보면 이 세 뉴스는 하나의 질문으로 수렴합니다. '모델의 내부를 투명하게 만드는 것'과 '그 내부를 몰래 복제하려는 시도'는 같은 긴장 위에 서 있습니다.

스티어링-8B: 사후 설명이 아닌 '설계부터 투명성'

기존 Explainability 접근법의 한계는 명확했습니다. SHAP, LIME, Saliency Map 같은 Post-hoc 방법론은 이미 계산이 끝난 블랙박스의 출력을 역추적해 '아마도 이 feature가 중요했을 것'이라고 추측하는 방식입니다. 가이드랩스의 CEO 줄리어스 아데바요(Julius Adebayo)가 2018년에 이미 증명했듯이, Saliency Map은 AI가 개념을 이해한 것이 아니라 윤곽선을 따라 눈속임을 한 것에 불과할 수 있습니다.

스티어링-8B는 이 문제를 '아키텍처 레벨에서' 해결하려 했습니다. 트랜스포머 백본과 출력 헤드 사이에 '개념 모듈(Concept Module)'이라는 병목 레이어를 삽입해, 수만 차원의 내부 벡터를 '친절함 0.8', '과학적 0.9' 같은 인간 해석 가능한 개념값으로 분해한 뒤 다시 출력층으로 전달합니다. 결과적으로 모든 토큰 생성이 어떤 개념의 조합에서 비롯됐는지 추적 가능해집니다.

그런데 저는 여기서 바로 몇 가지 질문을 던지게 됩니다.

베이스라인 대비 실제 성능 손실은 얼마인가요? 가이드랩스는 동급 8B 모델 대비 '90% 성능'을 발휘했다고 밝혔습니다. 그런데 어떤 벤치마크 기준인지, MMLU인지 HumanEval인지 MT-Bench인지 명시되지 않았습니다. 10% 성능 손실은 use case에 따라 치명적일 수도, 무시 가능할 수도 있습니다. Ablation study 결과가 공개됐나요? 개념 모듈 레이어만 제거했을 때의 성능 회복 수준을 봐야 해당 병목이 실제로 얼마나 overhead를 유발하는지 알 수 있습니다.

더 흥미로운 점은 '발견된 개념(Discovered Concepts)'입니다. 아데바요 CEO에 따르면 학습 데이터에 직접 포함되지 않은 '양자 컴퓨팅' 개념을 모델이 스스로 구성했다고 합니다. 이것이 사실이라면 해석 가능성과 일반화 능력이 trade-off가 아닐 수 있다는 뜻인데—이건 correlation인지 causation인지, 재현 가능한지 독립적인 검증이 필요합니다.

멀티 토큰 예측 '3배 속도': 숫자를 그대로 믿어야 할까요?

메릴랜드대 등 공동 연구진이 발표한 '자기 증류를 통한 멀티 토큰 예측(Multi-Token Prediction via Self-Distillation)'은 구조적으로 깔끔한 아이디어입니다. 기존 Next-Token Prediction(NTP)의 순차 처리 병목을 교사-학생(Teacher-Student) 온라인 증류 구조로 우회하면서, 임베딩 행렬에 특수 토큰 <MTP> 하나만 추가해 병렬 연산으로 전환합니다.

라마-3.1-8B-매그파이 기준, 수학 추론 데이터셋 MetaMathQA에서 속도 3배 향상 + 정확도 손실 3% 미만이라는 수치가 나왔습니다. 큐원3-4B는 속도 3배에 정확도 약 7% 감소.

그런데 잠깐, 저는 이 숫자를 보면 반사적으로 다음 질문들이 떠오릅니다.

- MetaMathQA 하나로 일반화할 수 있나요? 수학 추론은 패턴이 구조적이라 멀티 토큰 예측에 유리한 도메인입니다. 오픈엔드 생성, 감성 분석, 코드 생성에서의 결과도 봐야 합니다. 실제로 연구진도 창작 글쓰기와 요약에서 가속 효과가 유지됐다고 언급했지만, 구체적인 수치는 공개되지 않았습니다.

- 실제 운영 환경(프로덕션)에서도 이 속도가 나올까요? 연구에서 측정한 throughput은 single-user GPU 활용 최적화 기준입니다. 멀티 유저 배치 추론 환경에서 동일한 latency 개선이 나타나는지는 별도 실험이 필요합니다.

- ConfAdapt의 신뢰도 임계값 90%는 어떻게 결정된 건가요? 이 하이퍼파라미터 선택이 성능-속도 trade-off 곡선 전체를 지배합니다. 데이터셋마다 최적값이 다를 가능성이 높습니다.

5배 속도 설정에서는 정확도 손실이 '더 커진다'고만 표현됐는데, 구체적인 수치가 없습니다. 모델을 Hugging Face에 공개했다고 하니 커뮤니티 재현 실험 결과가 나오는 것이 훨씬 중요합니다.

DeepSeek의 불법 증류: 데이터 파이프라인 오염의 윤리학

앤트로픽이 공개한 사건은 MLOps 관점에서 매우 구체적입니다. 딥시크·문샷 AI·미니맥스는 프록시 네트워크와 '히드라 클러스터(Hydra Cluster)' 형태의 허위 계정망을 통해 트래픽을 분산시키면서 클로드의 출력을 대규모로 수집했습니다. 이 출력이 학습 데이터로 사용됐다면, 이는 클로드의 추론 능력이 증류된 데이터셋이 됩니다.

이 사건에서 데이터 품질 관점의 핵심 문제는 두 가지입니다.

첫째, 안전 장치의 증류 여부. 앤트로픽은 무단 증류 모델이 원본 모델의 안전장치(RLHF 기반 정렬, 유해 콘텐츠 필터)를 제대로 계승하지 못할 가능성이 높다고 경고했습니다. 이건 단순한 윤리적 주장이 아니라 데이터 분포(distribution) 문제입니다. 클로드가 거부하거나 우회적으로 답한 경우, 딥시크는 오히려 '검열 우회 답변'을 확보하는 데 집중했다고 하는데—이는 의도적으로 safety alignment 분포 바깥의 데이터를 수집한 것입니다. 이 데이터로 학습된 모델의 응답 분포는 원본과 체계적으로 다를 수밖에 없습니다.

둘째, 이건 correlation이지 causation이 아닐 수 있습니다. 앤트로픽은 이 증류 활동이 해당 기업들의 성능 향상으로 이어졌다고 주장하지만, 실제로 수집된 데이터가 최종 모델에 어느 정도 기여했는지 외부에서 검증할 방법은 없습니다. 16만 건(딥시크)~1300만 건(미니맥스)의 상호작용이 실제 학습에 사용됐는지, 그리고 그것이 벤치마크 성능 향상의 직접 원인인지는 별개의 문제입니다.

그럼에도 이 사건이 중요한 이유는 데이터 파이프라인의 출처 검증(data provenance)이 얼마나 취약한지를 보여주기 때문입니다. MLOps 측면에서 보면, 학습 데이터의 출처와 라벨링 정책이 불투명할 때 모델의 행동을 예측하고 통제하는 것이 불가능해집니다.

시사점: 투명성은 양날의 검

스티어링-8B와 DeepSeek 사건을 함께 놓으면 역설적인 그림이 나옵니다. 가이드랩스는 모델 내부를 열어 보이려 하고, 중국 AI 연구소들은 남의 모델 내부를 몰래 복제하려 했습니다. 해석 가능성(Interpretability)이 높아질수록 모델의 '무엇'이 가치 있는지도 더 명확해진다는 뜻이고, 역설적으로 그 가치를 타깃하기도 쉬워집니다.

개념 모듈 아키텍처가 '친절함', '과학적 정확성' 같은 개념을 명시적 수치로 노출한다면, 이를 겨냥한 adversarial attack이나 targeted distillation이 오히려 더 정밀해질 수 있습니다. 블랙박스를 열면 방어자도 이득을 보지만 공격자도 이득을 봅니다.

멀티 토큰 예측은 또 다른 각도를 제시합니다. 추론 속도를 3배 높이면서 모델을 자기 자신으로부터 '증류'하는 구조는, 증류라는 기법 자체가 내부적으로 얼마나 보편적인 최적화 도구인지를 보여줍니다. 기법이 중립적이라는 뜻입니다. 윤리적 문제는 기법이 아니라 누구의 데이터를, 동의 없이, 어떤 목적으로 사용하느냐에서 발생합니다.

전망: 세 개의 질문이 남습니다

이 세 사건이 가리키는 방향에서 저는 세 가지를 주목합니다.

재현 가능성 검증이 먼저입니다. 스티어링-8B의 '90% 성능'과 멀티 토큰 예측의 '3배 속도'는 커뮤니티의 독립적 재현 실험이 나와야 의미가 있습니다. 논문과 블로그 포스트의 숫자를 그대로 인용하는 것은 데이터 분석가로서 받아들이기 어렵습니다.

데이터 출처 검증(Data Provenance)이 MLOps의 핵심 파이프라인이 됩니다. 앤트로픽 사건은 학습 데이터의 출처를 추적하는 것이 선택이 아니라 필수임을 보여줍니다. 모델 카드(Model Card)에 학습 데이터 출처와 라이선스를 명시하는 관행이 더 강제력 있는 기준으로 자리잡아야 합니다.

Interpretability는 인프라가 되어야 합니다. 가이드랩스의 접근처럼 Post-hoc이 아닌 설계 단계의 투명성은, 금융·의료·법률 도메인에서 규제 요건을 충족하는 유일한 방법이 될 가능성이 높습니다. 단 성능 손실의 정량적 증거가 축적되어야 실제 채택이 가능합니다. '해석 가능하면서 SOTA에 근접한' 모델이 등장하는 날, 블랙박스 논쟁의 판도가 달라집니다.