'AI 도입하면 생산성이 올라간다'는 말은 이제 아무도 믿지 않습니다. 정확히는, 그 말을 믿게 만들 숫자가 없으면 아무도 예산을 내놓지 않습니다. 팀 리빌딩을 주도하면서 제가 가장 많이 받는 질문이 딱 하나입니다. "AI 넣으면 얼마나 빨라져요?" 이 질문에 감으로 답하는 순간, AI-First 전환은 취미 프로젝트로 끝납니다. 오늘은 실제 측정된 데이터를 기반으로, 그 질문에 제대로 답하는 법을 이야기해보겠습니다.

핵심 이슈: 측정되지 않으면 존재하지 않는다

Dev.to에 올라온 JS7 마이그레이션 사례는 제가 본 AI ROI 문서 중 가장 정직한 축에 속합니다. 500개 이상의 스케줄 잡을 엔터프라이즈 워크플로우 플랫폼 JS7으로 이전하는 작업—보통이라면 6개월 이상 걸리는 프로젝트였습니다. 팀원 중 단 2명만 JS7을 알고 있었고, 레거시 잡의 절반은 문서조차 없었습니다.

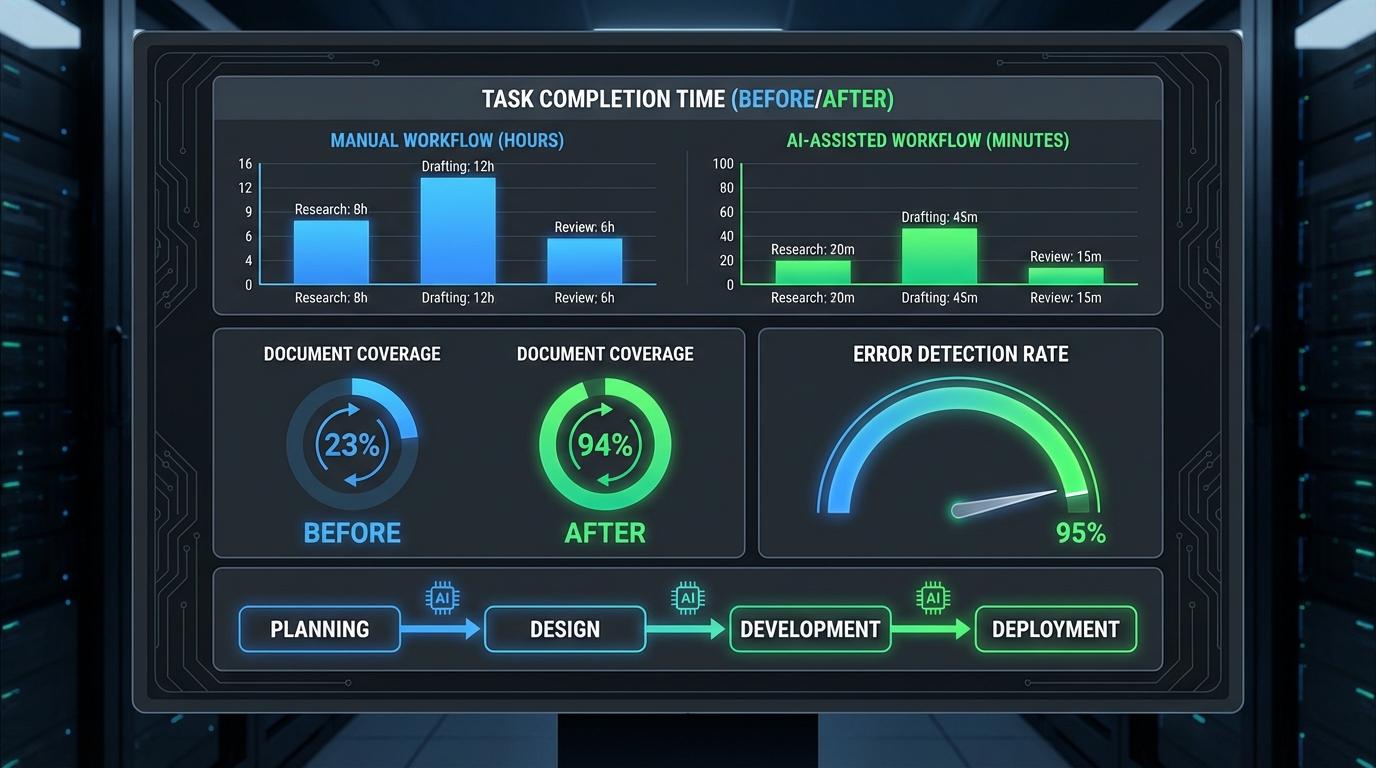

AI를 도입한 결과는 수치로 명확합니다. 워크플로우 신규 생성: 2~4시간 → 2~5분. 운영 환경 프로모션: 1~2시간 → 30초. 배포 전 오류 탐지율: 40% → 95%. 문서화 커버리지: 23% → 94%. 전체 마이그레이션 기간은 6개월 예상에서 수 주로 단축됐습니다. 98% 속도 향상이라는 헤드라인이 과장처럼 보이지만, 태스크 단위로 쪼개보면 숫자가 오히려 보수적으로 느껴질 정도입니다.

여기서 중요한 건 단순히 '빨라졌다'가 아닙니다. 어떤 조건에서 빨라졌는가입니다. 이 팀이 AI에게 준 것은 환경 설정, 네이밍 컨벤션, 에이전트 클러스터 매핑, 노티스 보드 의존성 전체—즉 인프라 컨텍스트 전체였습니다. 컨텍스트 없는 AI는 챗봇이고, 컨텍스트를 가진 AI는 팀원이 된다는 걸 이 사례는 수치로 증명합니다.

맥락 해석: ROI는 '속도'만이 아니다

속도 향상 수치에 가려진 더 중요한 ROI가 있습니다. 바로 지식 자산화입니다. JS7 사례에서 문서화율이 23%에서 94%로 뛴 건 단순한 부산물이 아닙니다. 마이그레이션 자체를 문서화 기회로 설계했기 때문입니다. 워크플로우를 건드리는 시점에 AI가 목적, 우선순위, 소유자, 장애 대응 절차를 함께 캡처했습니다. 이건 나중에 수백만 원짜리 온보딩 비용과 직결됩니다.

Laravel 팀을 위한 AI 안전 도입 7단계 가이드(Dev.to, LaraCopilot)는 이 맥락에서 읽으면 더 날카롭게 보입니다. 이 가이드의 핵심 메시지는 하나입니다. "AI는 검토된 어시스턴트로 워크플로우 안에 있어야 한다. 자율적인 기능 빌더가 아니라." 2~4주 파일럿 후 측정하는 지표 목록도 구체적입니다. 태스크당 절감 시간, 테스트 커버리지 변화, 버그 발생률, PR 리뷰 시간. 이 숫자들이 없으면 AI 도입 확대를 결정할 근거가 없습니다. 반대로, 이 숫자들이 있으면 경영진 설득 자료가 됩니다.

바이브 디자인 이야기도 같은 프레임으로 읽힙니다. Claude Code와 Figma의 'Code to Canvas' 연동(AI 매터스 보도)은 기획→디자인→개발의 3단계 순차 워크플로우를 병렬 리뷰 구조로 바꿉니다. 여기서 ROI는 단순히 디자이너 시간 절감이 아닙니다. 수정_최종_최종2_진짜최종.psd 파일명으로 상징되는 피드백 루프 비용 전체를 줄이는 겁니다. 의사결정권자의 "1픽셀 옮겨줘" 요청을 AI가 실시간으로 처리하는 동안, 디자이너는 규칙과 원칙을 검수하는 역할로 올라섭니다.

Dev.to의 AI 협업 개발 경험 아티클은 수치보다 심리를 다루지만, ROI 측정의 맹점 하나를 짚어줍니다. 저자가 말하는 '불안에서 몰입(Flow)으로'의 전환—이건 측정하기 어렵지만 실제로 존재하는 ROI입니다. 반복 작업이 자동화되면서 확보된 사고 시간이 아키텍처 품질과 문제 사전 해결로 이어진다는 관찰은, 생산성 측정 지표에 '기술 부채 감소율'이나 '사전 버그 탐지 건수'를 포함해야 한다는 시사점을 줍니다.

시사점: ROI 측정 프레임 직접 설계하기

이 사례들을 종합하면, AI 도입 ROI를 측정하는 프레임은 세 레이어로 구성됩니다.

레이어 1 — 태스크 단위 시간 측정 가장 단순하고 설득력 있는 숫자입니다. JS7 사례처럼 태스크별로 Before/After를 기록합니다. 워크플로우 생성, 코드 리뷰, 테스트 작성, 문서화, 환경 배포—각각 따로 측정하세요. 뭉뚱그린 '생산성 향상 30%'보다 '테스트 작성 시간 2시간→15분'이 훨씬 강력합니다.

레이어 2 — 품질 지표 추적 Laravel 가이드가 제시한 항목들입니다. 배포 전 오류 탐지율, 테스트 커버리지, PR 머지 후 버그 발생률, 문서화 커버리지. 속도가 올라가도 품질이 떨어지면 ROI는 음수입니다. 이 숫자들은 AI 도입에 회의적인 팀원을 설득하는 데도 필수입니다.

레이어 3 — 지식 자산 가치 가장 과소평가되는 레이어입니다. 온보딩 시간 단축, 트라이벌 지식의 문서화, 신규 팀원의 자립 속도—이것들을 시간당 비용으로 환산하면 의외로 큰 숫자가 나옵니다. JS7 팀처럼 마이그레이션 시점을 문서화 기회로 활용하면, 이 숫자는 공짜로 얻을 수 있습니다.

측정 프레임보다 더 중요한 건 측정 시점입니다. Laravel 가이드는 2~4주 파일럿을 권고합니다. 저는 여기에 한 가지를 추가합니다. 파일럿 시작 전에 Before 수치를 반드시 기록하세요. 사람들은 개선 전 상태를 금방 잊어버립니다. Before가 없으면 After의 극적 효과가 사라집니다.

전망: 다음 측정 대상은 '워크플로우 전체'

바이브 코딩, 바이브 디자인에 이어 바이브 배포, 바이브 운영이 도래한다는 전망(AI 매터스)은 단순한 기술 트렌드 예측이 아닙니다. 측정 대상이 '태스크'에서 '워크플로우 전체'로 이동한다는 신호입니다. 개별 태스크의 속도 향상은 이미 증명됐습니다. 다음 질문은 기획→설계→개발→테스트→배포→운영의 전체 사이클에서 AI가 어느 지점에 있을 때 팀의 아웃풋이 최대화되는가입니다.

Claude Code to Figma처럼 도구들이 연결되기 시작하면, 단일 도구 ROI보다 워크플로우 통합 ROI가 중요해집니다. 코드 생성 시간이 아니라 아이디어에서 배포까지의 총 사이클 타임, 수정 요청 횟수, 팀 간 핸드오프 비용—이게 다음 측정 지표가 될 겁니다. 지금부터 이 숫자들을 기록해두는 팀이 1년 후 가장 설득력 있는 AI ROI 케이스를 가지게 될 것입니다.

"AI 넣으면 얼마나 빨라져요?"라는 질문에 이제는 이렇게 답합니다. "파일럿 2주 돌려보고 태스크별로 Before/After 재볼게요. 그때 숫자 보여드리겠습니다." 감이 아니라 데이터로 말하는 순간, 팀의 AI-First 전환은 취미에서 전략이 됩니다.