근거는 있나요? 숫자부터 보겠습니다

세일즈포스가 전 세계 약 8,000개 기업(한국 500개사 포함)을 대상으로 발표한 '데이터 및 분석 현황 보고서'는 꽤 불편한 숫자를 내놓습니다. 국내 기업의 84%가 "탄탄한 데이터 기반이 AI 성공의 핵심"이라고 응답했지만, 그 중 61%는 데이터를 실제 비즈니스 목표와 연결하는 데 어려움을 겪고 있다고 답했습니다. 인식과 실행 사이의 갭이 통계로 증명된 셈입니다.

더 충격적인 숫자가 있습니다. 국내 선도 기업들이 추정하는 전체 데이터 중 사일로에 갇혀 접근 불가능한 데이터 비율은 15%, 그런데 응답자의 66%는 "가장 가치 있는 인사이트가 바로 그 15% 안에 있다"고 답했습니다. ML 파이프라인 입장에서 이 말을 번역하면 이렇습니다: 우리 모델은 가장 중요한 피처를 학습하지 못하고 있을 가능성이 높다.

파이프라인 실패의 3중 구조

프로덕션 ML 파이프라인이 무너지는 원인은 보통 세 가지 레이어가 동시에 작동하면서 발생합니다.

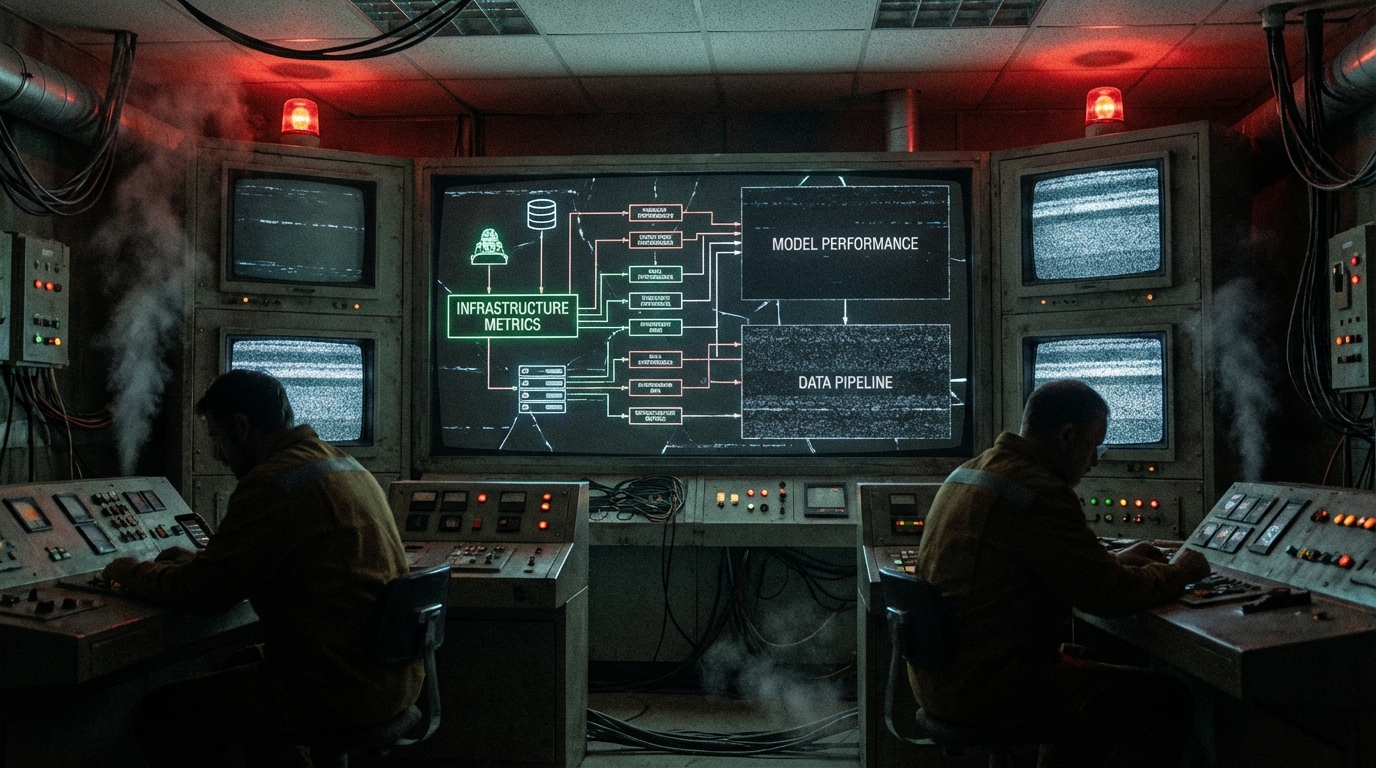

첫 번째: 모니터링의 착각 — 인프라 지표만 보는 함정

dev.to의 AI Observability 아키텍처 필드 리포트는 이 문제를 직격합니다. 대부분의 조직은 CPU, RAM, 디스크 같은 인프라 지표만 모니터링합니다. 저자의 표현을 빌리면, "공장 온도를 재면서 라인에서 나오는 부품 품질은 전혀 보지 않는 것"과 같습니다.

실제로 프로덕션 ML 파이프라인에는 4개의 관측 레이어가 필요합니다:

- 인프라 레이어: GPU 활용률, VRAM, 메모리 대역폭 — 없으면 아무것도 모르지만, 이것만 있어도 모델이 제대로 동작하는지는 알 수 없습니다

- 데이터 파이프라인 레이어: 학습 데이터 신선도(freshness), 피처 완전성, 입력 분포의 통계적 드리프트 — 이게 바로 "보이지 않는 레이어"입니다

- 모델 레이어: inference latency, throughput(req/s), confidence score 분포, fallback rate, 예측값 vs 실제값 비교

- 비용 레이어: inference당 비용, GPU 비용, 비용-비즈니스 가치 비율 — €3 inference cost on a €0.50 value use case는 기술 문제가 아니라 비즈니스 문제입니다

이 중 어느 하나라도 모니터링 블라인드스팟이 되면, 파이프라인은 조용히 망가집니다. 알람도 없이.

두 번째: 오케스트레이션 부재 — 반쯤 배포된 모델의 악몽

dev.to의 워크플로우 신뢰성 아티클이 제시한 시나리오는 현실에서 반복됩니다. 새벽 3시에 시작된 ML 재학습 파이프라인 5단계 중 3단계(모델 학습 + 아티팩트 레지스트리 푸시)는 성공했습니다. 그런데 4단계에서 스코어링 서비스의 DB 마이그레이션으로 연결이 거부됩니다.

이 시점에서 시스템이 어떻게 설계되어 있느냐에 따라 결과가 완전히 달라집니다:

- 재시작 설계: 6시 재시도 시 1단계부터 재실행 → BigQuery + Kubernetes 컴퓨팅 비용 이중 소모, 이미 존재하는 모델을 다시 학습

- 방치 설계: 모델은 레지스트리에 고아(orphaned) 상태로 방치, 고객은 stale 모델로 서비스 지속, 3일 후 데이터 사이언티스트가 수동 발견

- Saga 패턴 설계: 3단계 완료 상태를 영속화, 4단계만 재시도, 5:15 AM DB 복구 후 자동 재개, 5:20 AM 고객에게 새 모델 배포

핵심은 Idempotency(멱등성)입니다. 같은 연산을 두 번 실행해도 동일한 결과가 나와야 재시도가 안전합니다. 이것이 보장되지 않으면 Saga 패턴 자체가 무너집니다. 스코어링 설정이 중복 생성되거나, 모델이 이중으로 배포되는 상황이 발생합니다. Stripe의 Idempotency-Key, Kubernetes 컨트롤러의 desired state 비교 루프가 동일한 원리로 설계된 이유입니다.

세 번째: 데이터 사일로 — 파이프라인 실패의 근본 원인

앞서 언급한 보고서의 수치를 다시 꺼내보겠습니다. 국내 기업의 80%는 단절된 데이터가 AI 역량 저하, 고객 이해 부족, 매출 손실로 이어진다고 응답했습니다. 그럼에도 불구하고 공식 데이터 거버넌스 체계를 갖춘 글로벌 기업은 43%에 불과합니다.

데이터 사일로는 단순히 "데이터를 못 쓰는" 문제가 아닙니다. ML 파이프라인 관점에서는 데이터 드리프트 탐지 불가, 피처 분포 모니터링 부재, 학습-서빙 스큐(training-serving skew) 심화로 이어집니다. 모델 성능 지표(F1-score, ROC-AUC)가 오프라인 평가에서는 우수하지만 프로덕션에서 급락하는 현상의 배경에 데이터 사일로가 있는 경우가 많습니다. 이건 correlation이 아니라 causation입니다.

흥미로운 대응 전략도 보입니다. 국내 기업의 56%가 데이터를 물리적으로 복사하지 않고 연결하는 제로카피(Zero-Copy) 통합 전략을 도입했습니다. 데이터 이동 비용과 일관성 문제를 동시에 줄이는 방향으로 움직이는 셈입니다.

오픈소스 관측 스택이 답이 될 수 있을까

필드 리포트에서 제시된 스택은 주목할 만합니다: OpenTelemetry → VictoriaMetrics + OpenObserve/Loki → Grafana. 벤더 락인 없이 트레이스-메트릭-로그를 통합 수집하는 아키텍처입니다.

특히 ML 파이프라인 전용 커스텀 메트릭 계층이 핵심입니다. ml.inference.duration, ml.inference.confidence, ml.inference.cost.gpu 같은 지표를 OpenTelemetry SDK로 직접 계측하면, GPU 비용을 inference 단위로 추적하는 것이 가능합니다. 프로덕션에서 "이 모델, 비용 대비 가치가 있나?"라는 질문에 데이터로 답할 수 있게 되는 구조입니다.

다만 한 가지 통계적 의심을 제기하고 싶습니다. 이 스택이 특정 엔게이지먼트와 데모 플랫폼을 통해 검증된 사례라는 점에서, 샘플 사이즈와 환경 다양성이 충분한지 재현 가능성(reproducibility)을 따져봐야 합니다. 베이스라인 대비 관측 비용(compute overhead)이 얼마나 증가하는지, 실제 프로덕션 트래픽 규모에서도 동일한 성능이 나오는지는 별도 검증이 필요합니다.

시사점: 세 가지 레이어를 동시에 공략해야 합니다

결국 ML 파이프라인의 프로덕션 실패는 단일 원인이 아닙니다. 관측 불가능성(Observability 부재) + 오케스트레이션 취약성(Saga 패턴 미적용) + 데이터 사일로가 결합할 때 파이프라인은 소리 없이 무너집니다.

실무적 우선순위를 제안한다면:

- 지금 당장: 인프라 메트릭 너머 모델 레이어와 데이터 파이프라인 레이어 모니터링 추가. confidence score 분포 이상 탐지만으로도 초기 드리프트를 잡을 수 있습니다.

- 다음 스프린트: 재학습·배포 파이프라인의 상태를 메모리가 아닌 DB에 영속화. 각 스텝의 idempotency 보장 여부를 코드 리뷰 체크리스트에 추가하세요.

- 분기 과제: 데이터 거버넌스 체계 구축과 사일로 해소. 제로카피 통합이 최소 저항 경로일 수 있습니다. 하지만 글로벌 CIO들이 AI 기술보다 데이터 인프라에 4배 더 많은 예산을 배정하는 데는 이유가 있습니다.

전망: 관측 가능성이 곧 경쟁력이 되는 시대

국내 선도 기업의 80%가 AI 전략 성공을 위해 데이터 전략 전반의 재정비가 필요하다고 응답한 지금, 이 문제는 더 이상 데이터 엔지니어링팀만의 숙제가 아닙니다. 모델 배포 이후 무슨 일이 일어나는지 측정하지 못하면, SOTA 성능을 달성한 모델도 프로덕션에서는 블랙박스가 됩니다.

"우리 모델 잘 돌아가고 있어요"라는 답변이 GPU 사용률 그래프를 보고 나온 것이라면, 그 파이프라인은 이미 무너지고 있는 중일 수 있습니다. 데이터가 말하게 해야 합니다.