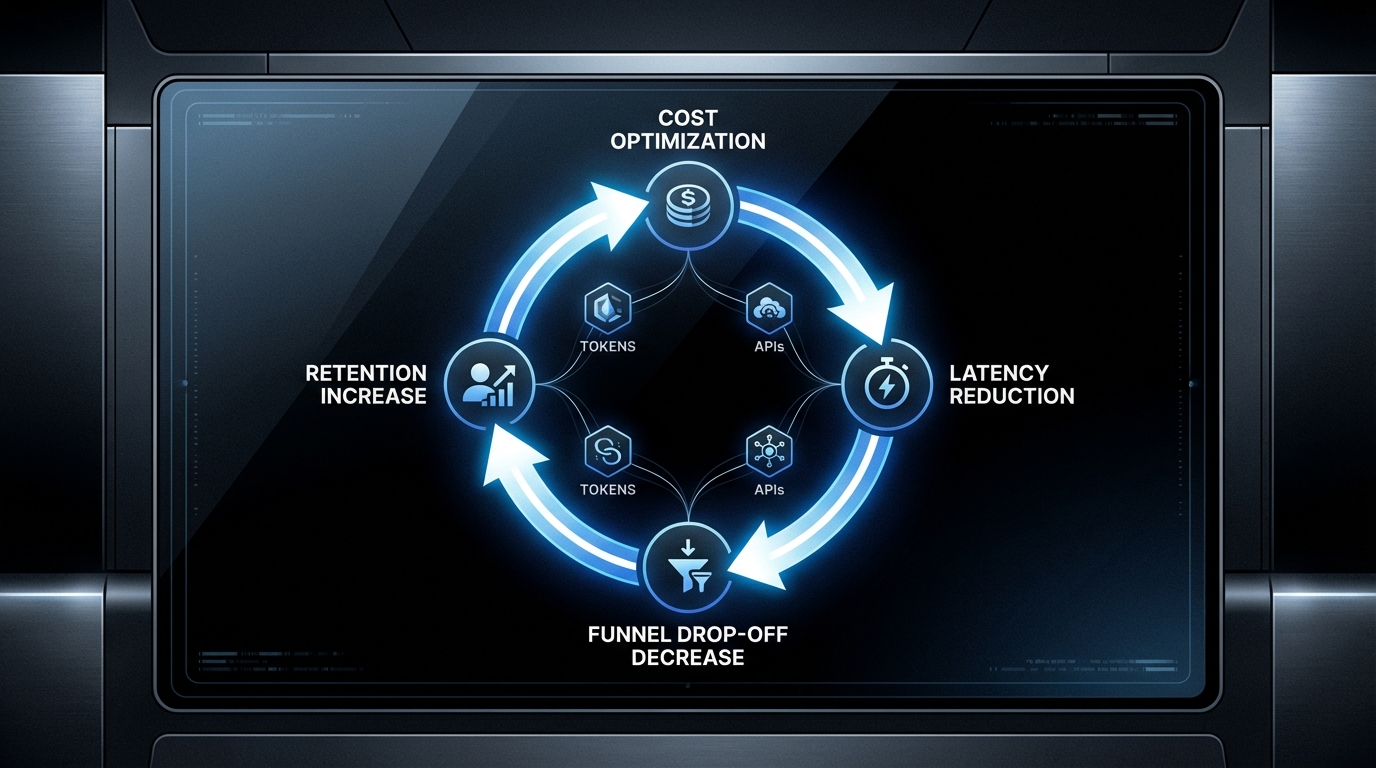

AI 에이전트를 제품에 붙이는 순간, 토큰과 지연시간은 곧바로 그로스 지표가 됩니다. “기능이 좋다”는 말로는 부족해요. 유저는 느리면 떠나고(퍼널 이탈), 비싸면 막히고(마진/과금), 자주 잊으면 실망합니다(리텐션 하락). 그래서 오늘의 핵심은 하나: 비용 최적화 → 응답 속도 개선 → 퍼널 이탈 감소라는 루프를 ‘바로’ 실험 가능한 형태로 만들자는 겁니다.

dev.to의 「The Token-Per-Dollar Math: Running Claude Max for 30 Days」는 이 루프가 왜 현실적인지 보여주는 극단적으로 좋은 케이스입니다. 월 $200의 Claude Max(정액)로 자율 에이전트를 30일 돌렸는데, 초반 3일 만에 월 할당의 71%를 태웠죠. 여기서 포인트는 “모델이 비싸다”가 아니라, 운영 방식이 토큰을 새게 만들면 성장이 불가능해진다는 사실입니다.

그가 잡아낸 3대 토큰 싱크는 제품팀에게 그대로 번역됩니다. 첫째, 컨텍스트 압축(compaction) 이후 재구성 비용. 요약이 잦아지면 에이전트가 다시 파일을 읽고 맥락을 복구하느라 토큰을 태웁니다. 그는 컨텍스트 80%에서 미리 경고하고, 작업을 마무리·커밋·상태를 mission.md에 기록하게 만들어 낭비를 약 25% 줄였다고 말합니다. 제품 관점에선 “세션이 길어질수록 느려지고 비싸지는 UX”를 “자연스러운 마일스톤 단위”로 쪼개는 설계입니다.

둘째, 멀티 에이전트 협업 오버헤드. 5개 에이전트가 동시에 돌면 ‘똑똑해 보이지만’ 파일 중복 읽기, 조정 메시지, 충돌 해결로 비용이 폭증합니다. 실제로 45분에 하루 예산 27%를 썼고, 단일 에이전트+일회성 태스크(Tasks)로 바꾸자 8%로 내려갔다고 합니다(약 70% 절감). 이거… 제품에서도 똑같아요. “에이전트 팀”을 만들기 전에, 한 번의 요청에서 병렬이 필요한 일을 짧은 서브태스크로 만들고, 컨텍스트를 공유하지 않게 하는 편이 CAC를 훨씬 잘 지킵니다.

셋째, 탐색적 웹 리서치 반복. WebSearch/WebFetch는 정보 3줄 뽑자고 긴 문서를 읽으며 토큰을 태웁니다. 해결은 캐싱(마크다운 저장 후 재사용). 이건 곧바로 리텐션 레버예요. 같은 질문을 다시 할 때 “또 검색해서 느리게 답”이 아니라 “기억해둔 근거로 즉답”이 되면, 체감 속도가 올라가고 신뢰가 쌓입니다.

여기에 dev.to의 또 다른 글 「How Poor Tool Calling Behavior Increases LLM Cost and Latency」가 퍼널 관점의 경고를 던집니다. 툴콜 12번으로 2번짜리 문제를 푼다—이건 토큰 비용뿐 아니라 레이턴시를 직격합니다. 레이턴시는 곧 전환율 변수예요. 특히 온보딩/결제 직전 플로우에서 TTFT(Time To First Token)와 E2E latency가 늘면, 유저는 “뭔가 불안한데?” 하고 이탈합니다. 즉, 툴 정의를 미니멀하게, 중복 호출은 캐시로, 독립 호출은 병렬로—이 3가지는 기술 최적화가 아니라 퍼널 최적화입니다.

그리고 마지막 퍼즐은 “기억”. 「Your AI Agent Forgets Everything…」가 말하듯, 컨텍스트 윈도우를 메모리로 착각하면 에이전트는 금방 ‘치매’가 됩니다. 제품에선 이게 치명적이에요. 에이전트가 매번 같은 정보를 재질문하면 마찰이 증가하고, 사용자는 유료 전환 전에 피로해집니다. 더 무서운 건 비용입니다. 잊어서 재확인 → 툴 재호출 → 컨텍스트 재구성 → 지연 증가가 한 번에 터지거든요. 기억은 단지 UX가 아니라 비용-지연을 동시에 줄여 리텐션을 올리는 레버입니다.

그래서 오늘의 시사점은 명확합니다. 우리가 만들어야 할 건 “더 똑똑한 에이전트”가 아니라 비용-리텐션 루프입니다.

1) 토큰 예산을 일 단위/요청 단위로 쪼개고(버짓팅)

2) 컨텍스트 임계치 전에 작업을 ‘닫게’ 만들고(마일스톤 설계)

3) 툴콜을 줄이고(배치/캐시/병렬)

4) RAG는 고정 top-k가 아니라 Adaptive RAG depth로 난이도/예산에 따라 조절(「Adaptive RAG Depth Control」)

이 4개를 붙이면 “비용↓ → 속도↑ → 이탈↓ → 재방문↑” 루프가 돌아갑니다. 와 이거다! 이건 기능이 아니라 성장 엔진이에요.

전망도 재미있습니다. 앞으로 에이전트 경쟁력은 모델 스펙보다 운영 레이어(메모리·툴콜·RAG·관측성)에서 갈립니다. 정액이든 API 과금이든, 결국 유저당 비용을 예측 가능하게 만들고 P95/P99 레이턴시를 관리하는 팀이 CAC를 이기고 LTV를 가져갑니다. “빨리 테스트해봐야 돼!”라면, 다음 2주 실험으로 충분합니다: (a) 툴콜/요청, (b) TTFT, (c) 토큰/세션, (d) D1 리텐션을 같이 묶어 대시보드에 올리세요. 에이전트 비용을 줄이는 순간, 전환율이 같이 오를 확률—생각보다 높습니다.