'데이터 품질'이라는 말은 너무 낙관적입니다

데이터 주석 도구 시장이 2034년까지 연평균 5.7% 성장해 28억 달러 규모에 달할 것이라는 인텔 시장조사의 전망은, 표면적으로는 AI 인프라 투자에 대한 긍정적 신호입니다. 그런데 저는 이 숫자를 보자마자 반사적으로 이런 질문이 떠올랐습니다. "시장이 커지는 것과, 라벨 품질이 실제로 높아지는 것은 같은 얘기인가요?"

같은 보고서가 스스로 답을 줍니다. AI 프로젝트의 45%가 라벨링 불일치를 주요 장애물로 꼽았고, 일부 조직은 AI 예산의 최대 60%를 데이터 준비에 지출합니다. 시장은 성장하고, 비용은 늘고, 그런데도 품질 문제는 해결되지 않는 구조입니다. 이건 시장이 수요를 소화하는 것이 아니라, 문제가 비용으로 전환되고 있는 상황에 가깝습니다.

라벨 품질의 적은 도구가 아니라 '주관성'입니다

컴퓨터 비전이나 자율주행용 포인트 클라우드 주석은 어느 정도 객관적 기준이 존재합니다. 바운딩 박스가 정확한지, 라이다 포인트가 올바른 클래스로 분류됐는지는 검증 가능합니다. 문제는 감정 분석, 콘텐츠 조정, 자연어 뉘앙스 태깅 같은 작업입니다. 이 영역에서 주석 일관성(inter-annotator agreement)은 태스크 난이도와 주석자의 문화적 배경, 심지어 당일 컨디션까지 영향을 받습니다. Cohen's Kappa 지수를 측정조차 하지 않고 배포되는 학습 데이터셋이 얼마나 많을까요?

AI 증강 주석 플랫폼이 '수동 대비 40% 효율 향상'을 내세우지만, 여기서 효율이 throughput(처리량) 인지 precision(정확도) 인지는 명확하지 않습니다. 처리 속도가 빨라져도 오류가 그대로 확장된다면, 우리는 나쁜 데이터를 더 빠르게 양산하는 것일 뿐입니다.

편향 인식이 모델 성능보다 더 빠르게 신뢰를 무너뜨립니다

라이든 대학교 연구팀이 미국 성인 2,144명을 대상으로 진행한 실험(전자신문 보도)은 데이터 품질 문제의 다른 차원을 보여줍니다. ChatGPT가 정치적으로 편향됐다는 경고를 받은 집단은, 동일한 모델, 동일한 정보를 접해도 설득 효과가 28% 감소했습니다. 통제 집단의 설득력 변화가 표준편차의 83.6%에 달했던 것과 비교하면 이건 작은 수치가 아닙니다.

이 실험에서 GPT-4.1이 사용됐고, 연구팀은 더 발전된 추론 기반 모델도 설득력 면에서 추가 이득이 크지 않다는 선행 연구를 근거로 이 결과의 일반화 가능성을 주장합니다. 물론 '미국 성인 2,144명'이라는 샘플이 전 세계 사용자를 대표하는지에 대한 질문은 여전히 유효하지만, 핵심 메커니즘 자체는 설득력이 있습니다. 연구팀이 명명한 '신뢰성 공격(credibility attacks)' —메시지 내용이 아닌 발신자에 대한 의심이 설득 효과를 차단하는 현상—은 ML 모델 평가에서 우리가 잘 다루지 않는 변수입니다.

모델의 F1-score나 ROC-AUC가 아무리 높아도, 사용자가 그 모델을 신뢰하지 않으면 실질적 정확도는 제로입니다. 의료 AI가 백신 오정보를 바로잡으려 해도, 사용자가 그 AI를 '편향된 존재'로 인식하면 올바른 정보가 수용되지 않습니다. 이건 단순히 AI 윤리의 문제가 아니라 프로덕션 환경에서의 모델 유효성(validity) 문제입니다. Precision-Recall 곡선 어디에도 '사용자가 결과를 믿지 않을 확률'은 포함되어 있지 않으니까요.

로봇 AI의 데이터 공백: 인터넷이 없는 도메인의 비극

LLM은 인터넷 전체를 학습 데이터로 쓸 수 있었지만, 로봇 AI에는 그에 상응하는 데이터 소스가 없습니다. NVIDIA의 DreamDojo가 주목받는 이유가 여기에 있습니다. 이 프로젝트는 유튜브 등 인간 동작 비디오 44,000시간을 활용해 물리적 조작(manipulation)의 잠재 표현(latent representation)을 학습합니다.

핵심 아이디어는 '대응 문제(correspondence problem)'를 우회하는 것입니다. 인간 손과 로봇 그리퍼는 구조가 다르고, 카메라 앵글도 일정하지 않습니다. 픽셀을 모터 명령에 직접 매핑하는 대신, 인간과 로봇 모두에 적용되는 움직임의 공유 표현(shared representation)—latent actions—을 학습합니다. 레이블이 없는 비디오 데이터를 활용하기 때문에 확장성도 확보됩니다.

그런데 여기서도 저는 같은 질문을 던집니다. "이 44,000시간의 인간 비디오에는 어떤 편향이 있을까요?" 유튜브 데이터는 특정 언어권, 특정 인구 집단, 특정 유형의 작업에 편중되어 있습니다. 산업용 로봇이 수행해야 할 정밀 조립이나 의료용 로봇의 섬세한 조작은 유튜브에 잘 올라오지 않습니다. sim-to-real 갭이 여전히 존재한다는 팀의 솔직한 인정은 높이 사지만, 데이터 분포 편향이 어느 도메인에서 어느 정도의 성능 저하로 나타나는지에 대한 ablation study 결과가 궁금합니다. 논문(arXiv:2602.06949)에서 확인해볼 지점입니다.

양자화: 모델 크기를 줄이는 대가는 정확히 얼마인가

데이터 품질 문제와 별개로, 모델이 배포 단계에서 만나는 또 다른 신뢰성 위협이 있습니다. LLM 양자화(Quantization)입니다. FP32 → INT4로 정밀도를 낮추면 7B 파라미터 모델 기준으로 메모리 요구량이 약 14GB에서 4GB로 줄어들고 추론 속도도 향상됩니다. 서빙 비용 절감 효과는 명확합니다.

그런데 양자화 오차(quantization error)가 모델의 어떤 능력을 얼마나 깎아내는지는 태스크마다 다릅니다. GPTQ와 AWQ는 각각 GPU 최적화와 활성화 인지 가중치 보호 전략으로 4-bit에서도 성능 저하를 최소화하려 하지만, '최소화'가 구체적으로 어느 수준인지는 벤치마크 데이터셋과 평가 지표에 따라 크게 달라집니다. 특히 논리적 추론, 수학 계산, 코드 생성처럼 정밀도에 민감한 태스크에서 4-bit 양자화 후 성능 저하는 단순 텍스트 생성보다 더 두드러집니다.

현재 업계에서 4-bit를 '골디락스 지점'으로 부르는 경향이 있는데, 이건 평균적 성능 기준의 이야기입니다. 특정 고위험 도메인(의료 진단, 법률 문서 분석)에서 양자화 모델을 배포할 때는 도메인 특화 벤치마크로 별도 검증이 필수입니다. 일반 언어 이해 벤치마크에서 FP16 대비 1~2% 성능 차이가, 실제 임상 NLP 파이프라인에서는 False Negative rate의 유의미한 증가로 나타날 수 있기 때문입니다.

네 가지 문제가 가리키는 하나의 구조적 취약점

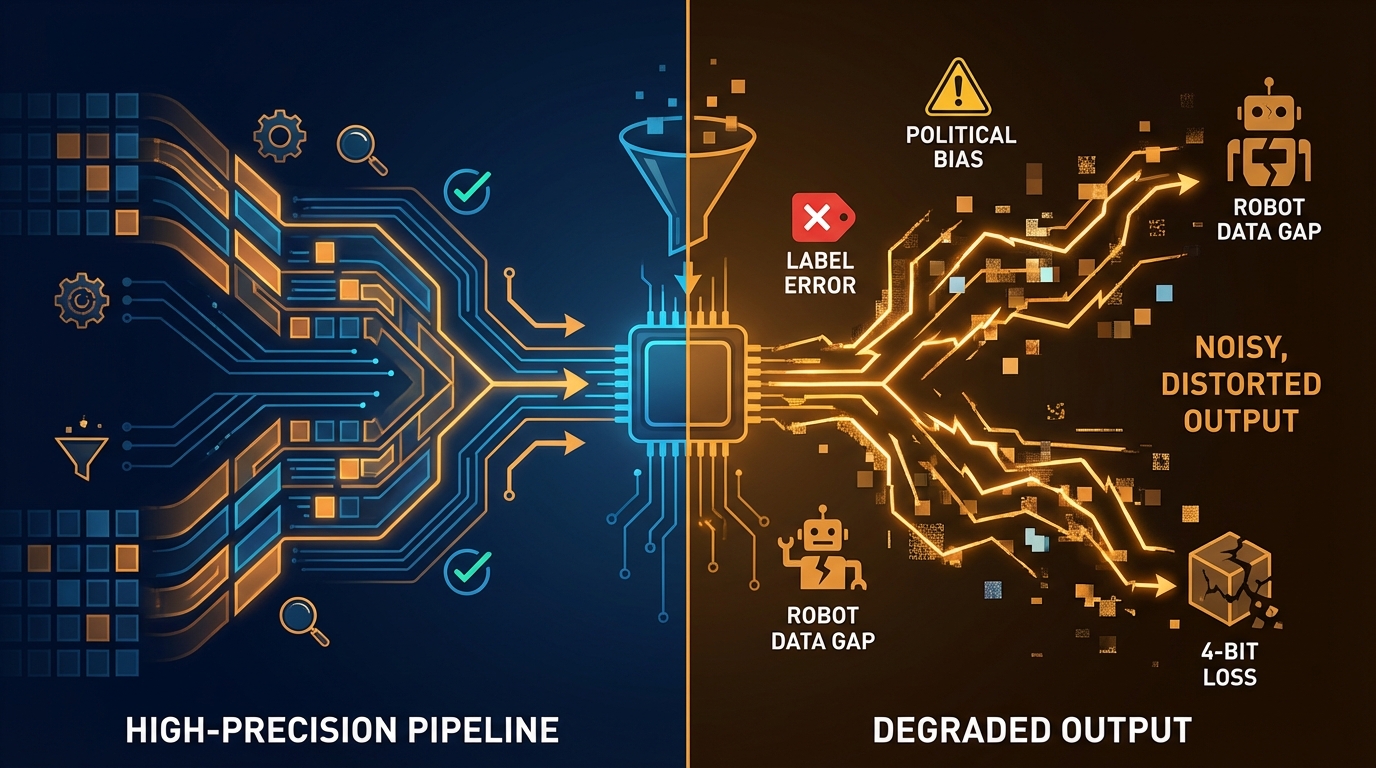

지금까지 살펴본 네 가지 이슈—라벨링 불일치, 편향 인식에 의한 신뢰도 붕괴, 도메인 데이터 부족, 양자화 정밀도 손실—는 표면적으로는 서로 다른 문제처럼 보이지만, 공통된 구조적 취약점을 공유합니다. 모델의 입력과 출력 사이 어딘가에서 정보가 손실되거나 왜곡되고, 그 왜곡이 최종 사용자의 의사결정에 영향을 미친다는 것입니다.

데이터 주석 시장이 2034년까지 28억 달러로 성장해도, 라벨 품질 검증 체계가 없다면 그 성장은 부실한 학습 데이터의 규모 확장일 뿐입니다. AI 모델의 실제 편향 여부와 별개로, 사용자가 편향됐다고 인식하는 순간 모델의 유효성은 실질적으로 감소합니다. 44,000시간의 인간 비디오가 로봇 학습의 돌파구가 될 수 있지만, 데이터 분포의 편향은 배포 후 특정 도메인에서 예상치 못한 성능 저하로 나타날 것입니다. 그리고 4-bit 양자화의 효율성은 매력적이지만, 정밀도가 요구되는 태스크에서는 정확히 그 비용을 측정한 뒤 배포를 결정해야 합니다.

전망: 신뢰성은 지표가 아니라 파이프라인으로 설계해야 합니다

AI 신뢰성을 높이는 방법은 단일 지표를 개선하는 것이 아닙니다. 데이터 수집 → 주석 → 학습 → 양자화 → 배포 → 사용자 인식 각 단계에서 신뢰성을 설계하고 모니터링하는 파이프라인이 필요합니다.

구체적으로는 이런 방향입니다. 주석 단계에서는 inter-annotator agreement를 측정하고 임계값 이하의 샘플을 재작업 큐로 보내는 자동화된 품질 게이트가 필요합니다. 편향 문제에는 기술적 de-biasing과 함께 사용자 커뮤니케이션 전략이 병행되어야 합니다—레이든 대학 연구가 보여준 것처럼, 인식된 편향은 실제 편향만큼 모델 유효성에 영향을 미칩니다. 양자화 배포 시에는 범용 벤치마크가 아닌 실제 서비스 태스크 기반의 성능 회귀 테스트(regression test)를 CI/CD 파이프라인에 포함시켜야 합니다.

데이터 주석 도구 시장의 성장 곡선이 AI 신뢰성의 향상 곡선과 동행하려면, 시장 규모가 아니라 검증 가능한 품질 지표가 성장의 기준이 되어야 합니다. 지금 우리에게 부족한 것은 더 많은 라벨이 아니라, 더 나은 라벨 품질 측정 방법입니다.