AI 제품/에이전트에서 제일 큰 착각은 ‘더 좋은 모델=더 좋은 비즈니스’입니다. 실제로는 운영비(토큰/호출)가 가격 정책과 마진을 갉아먹고, 신뢰성(최신 데이터 접근)이 온보딩 신뢰를 깨서 전환율을 떨어뜨립니다. 여기서 비용 30~80%를 줄이는 최적화와 할루시네이션을 줄이는 Tool Use를 묶으면, “이거 바이럴 될 것 같은데?” 수준의 데모가 아니라 CAC↓, LTV↑로 바로 연결되는 그로스 레버가 됩니다.

dev.to의 AI API 비용 절감 글은 포인트가 명확합니다. “모델을 바꾸지 않고도” 프롬프트 캐싱, 스마트 모델 라우팅, 배치 처리, 토큰 다이어트만으로 비용을 크게 줄일 수 있다는 것(출처: dev.to ‘How to Cut Your AI API Costs…’). 특히 프롬프트 캐싱은 코드 변경이 거의 없거나(일부는 자동) 히트율만 잡히면 효과가 폭발합니다. 지원봇처럼 시스템 프롬프트가 길고 반복되는 서비스라면, 입력 토큰 비용이 사실상 ‘고정비’인데 이걸 캐시로 깎는 순간 단위경제(Unit Economics)가 달라져요.

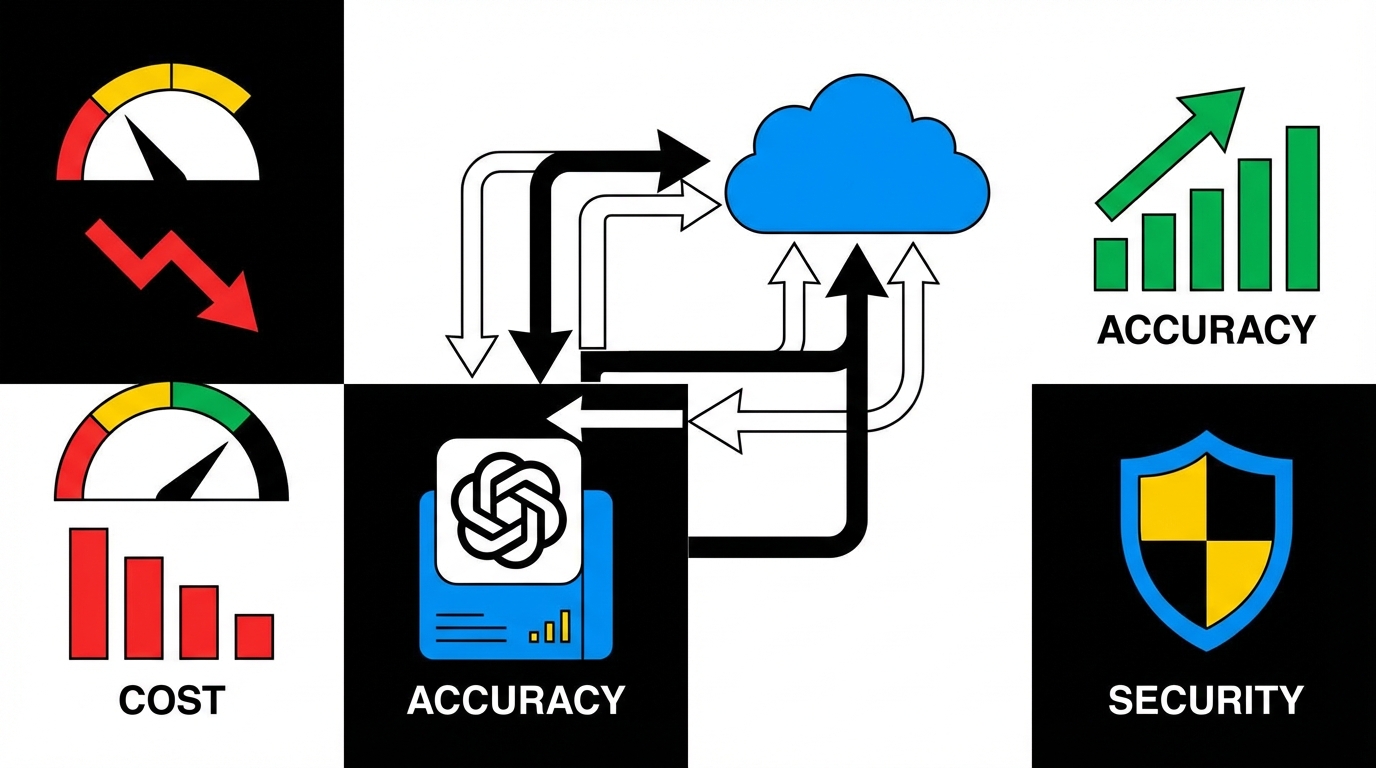

여기에 에이전트 운영 현실을 더하면 더 재밌어집니다. OpenClaw 사례에서 로컬 모델만 쓰면 무한 루프/툴콜 환각이 터지고, 클라우드 플래그십 모델만 쓰면 24/7 에이전트가 토큰을 태워버립니다(출처: dev.to ‘OpenClaw with Local Models…’). 그래서 답은 “로컬 vs 클라우드”가 아니라 하이브리드 라우팅입니다. 루틴 작업은 로컬/저가 모델로 처리하고, 고위험·고난도만 상위 모델로 에스컬레이션. 이 구조는 비용을 최대 80%까지도 줄이면서, 실패율도 같이 낮출 수 있는 전형적인 성장 해킹 포인트입니다.

하지만 비용만 줄이면 끝? 아닙니다. 금융 에이전트가 ‘그럴듯하게 틀린 숫자’를 말하는 문제는 모델 지능이 아니라 데이터 신선도 문제였죠. 학습 컷오프 이후의 값은 LLM이 “추론”이 아니라 “그럴듯한 회상”으로 답해버립니다(출처: dev.to ‘Why your AI agent keeps hallucinating financial data…’). 이때 RAG를 직접 운영하는 건 유지보수 지옥이 되기 쉽고, 더 깔끔한 해법은 실시간 데이터 API를 Tool로 붙여서 추론 시점에 조회하게 만드는 겁니다. 이 한 줄이 ‘할루시네이션’이라는 불신을 ‘검증 가능한 답’으로 바꿔서, 유료 전환에 결정적으로 작동합니다.

그로스 관점 시사점은 3가지입니다. (1) 가격/마진 레버: 캐싱+배치+토큰 다이어트로 호출당 원가를 30~75% 깎으면, 프리미엄 기능을 더 공격적으로 노출해도 CAC 회수가 빨라집니다. (2) 퍼널 레버: 모델 라우팅/하이브리드 라우팅으로 “대기시간/실패율/비용”을 동시에 최적화하면, 온보딩 첫 세션에서 ‘답변 품질 들쭉날쭉’으로 이탈하는 구간을 줄일 수 있어요. Conversion rate가 얼마나 오를까요? 제품마다 다르지만, 최소한 에러율과 응답 지연이 줄어드는 만큼 D1과 유료 체험 시작률이 같이 움직일 확률이 큽니다. (3) 리텐션 레버: Tool Use로 최신 데이터·근거 링크를 강제하면, “AI가 헛소리한다”는 핵심 이탈 사유를 제거합니다. 리텐션은 기능 추가보다 신뢰 회복에서 더 크게 오릅니다.

전망은 간단합니다. 앞으로 AI 제품의 경쟁은 ‘모델 벤치마크’가 아니라 운영 파이프라인의 설계 능력으로 갈립니다. 캐시 히트율, 라우팅 정책, 배치로 돌릴 작업 정의, 그리고 어떤 도메인은 무조건 Tool로 조회하게 할지—이 네 가지가 곧 제품의 P&L과 퍼널 지표가 됩니다. 빨리 테스트해봐야 돼요. 지금 당장 할 수 있는 실험은: “반복되는 시스템 프롬프트 캐싱 적용 → 라우팅 규칙 2단계(저가/고가) 도입 → 비실시간 작업 배치 전환 → 최신 데이터 도메인(금융/가격/재고/뉴스)은 Tool 강제” 이 조합입니다. 모델 바꾸지 않고도, 성장 곡선이 바뀔 준비가 되어 있습니다.