'SOTA 달성'이라는 말 앞에서 멈추는 이유

ML 데이터 분석가로 일하다 보면 하나의 습관이 생깁니다. 누군가 "이 모델이 벤치마크 1위를 달성했습니다"라고 말할 때, 박수보다 먼저 세 가지 질문을 꺼내는 것입니다. 샘플이 충분한가요? 테스트셋이 오염되지 않았나요? 이 지표가 실제로 우리가 측정하고 싶은 것을 측정하고 있나요? 최근 공개된 두 편의 연구—비드래프트의 FINAL Bench와 arXiv의 VeRA(arXiv:2602.13217)—는 이 세 질문이 단순한 의심이 아니라, 현 AI 평가 생태계의 핵심 구조 문제임을 데이터로 보여줍니다.

문제 1: 우리가 측정하지 않은 것이 가장 중요할 수 있다

MMU, GPQA, HumanEval—현 AI 평가의 글로벌 표준들은 공통적으로 최종 정답의 정확도만 측정합니다. 정답에 이르는 과정에서 모델이 얼마나 오류를 인식하고 스스로 교정했는지는 어떤 지표에도 잡히지 않습니다. 이건 분류 문제에서 Accuracy만 보고 Precision과 Recall을 무시하는 것과 구조적으로 같은 실수입니다.

비드래프트가 허깅페이스와 GitHub에 동시 공개한 FINAL Bench는 이 사각지대를 정면으로 겨냥합니다. 15개 학문 도메인, 100개 전문가 수준 과제로 구성된 이 벤치마크는 AI가 '인지적 함정(hidden trap)'에 빠지는 것이 아니라, 빠진 뒤 스스로 빠져나오는 과정을 다섯 개 축(과정품질·메타인지정확도·오류복구·통합깊이·최종정답)으로 분리 측정합니다. 평가 지표 설계 관점에서 보면 단일 스칼라 점수를 다차원 벡터로 분해한 것이고, 이게 바로 이 벤치마크가 기존 평가와 근본적으로 다른 지점입니다.

데이터가 드러낸 'Humble Deceiver' 패턴

GPT-5.2, Gemini 3 Pro, Claude Opus 4.6, DeepSeek-V3.2, Kimi K2.5 등 글로벌 SOTA LLM 9종, 총 1,800건의 평가 결과는 꽤 충격적입니다.

- MA(선언적 메타인지, '틀릴 수 있다고 말하는 능력'): 평균 0.694

- ER(절차적 메타인지, '실제로 오류를 찾아 고치는 능력'): 평균 0.302

- 전체 평가의 79.6%(215건)에서 ER이 최저점(0.25) 기록

통계적으로 MA와 ER 사이의 갭(0.392)은 이 두 능력이 거의 독립적으로 작동함을 시사합니다. 모델들은 "제가 틀릴 수도 있습니다"라는 말을 유창하게 하지만, 정작 오류를 탐지하고 수정하는 루프는 작동하지 않는 것입니다. 연구팀이 이를 '겸손한 기만자(Humble Deceiver)'라 명명한 건 마케팅적 수사가 아니라 데이터에서 귀납된 패턴입니다.

더 주목할 발견은 Ablation study 격의 결과입니다. 자기교정 구조를 적용했을 때 전체 성능 향상(+9.30점, +15.4%)의 114.7%가 ER 단 하나의 축에서 발생했고, 나머지 4개 축의 합산 기여는 -14.7%였습니다. 이건 correlation이 아닙니다. 구성 요소를 분리해 기여도를 측정한 것이므로 인과 관계에 가깝습니다. 지식의 양도, 추론 능력도, 최종 정확도 개선도 아닌—자기교정 하나가 병목이라는 결론입니다.

리더보드에서는 Kimi K2.5가 FINAL Score 68.71점으로 1위, ER 0.450으로 유일하게 유의미한 자기교정 점수를 기록했습니다. 흥미롭게도 SWE-Bench 코딩 비교(dev.to, 2026)에서 가장 높은 점수(72.7%)를 기록한 Claude Sonnet 4.6의 동급 모델인 Claude Opus 4.6은 FINAL Bench에서 56.04점으로 9개 모델 중 최하위였습니다. 태스크가 다르면 순위가 뒤집힌다—이것 자체가 단일 벤치마크 의존의 위험성을 보여주는 실증입니다.

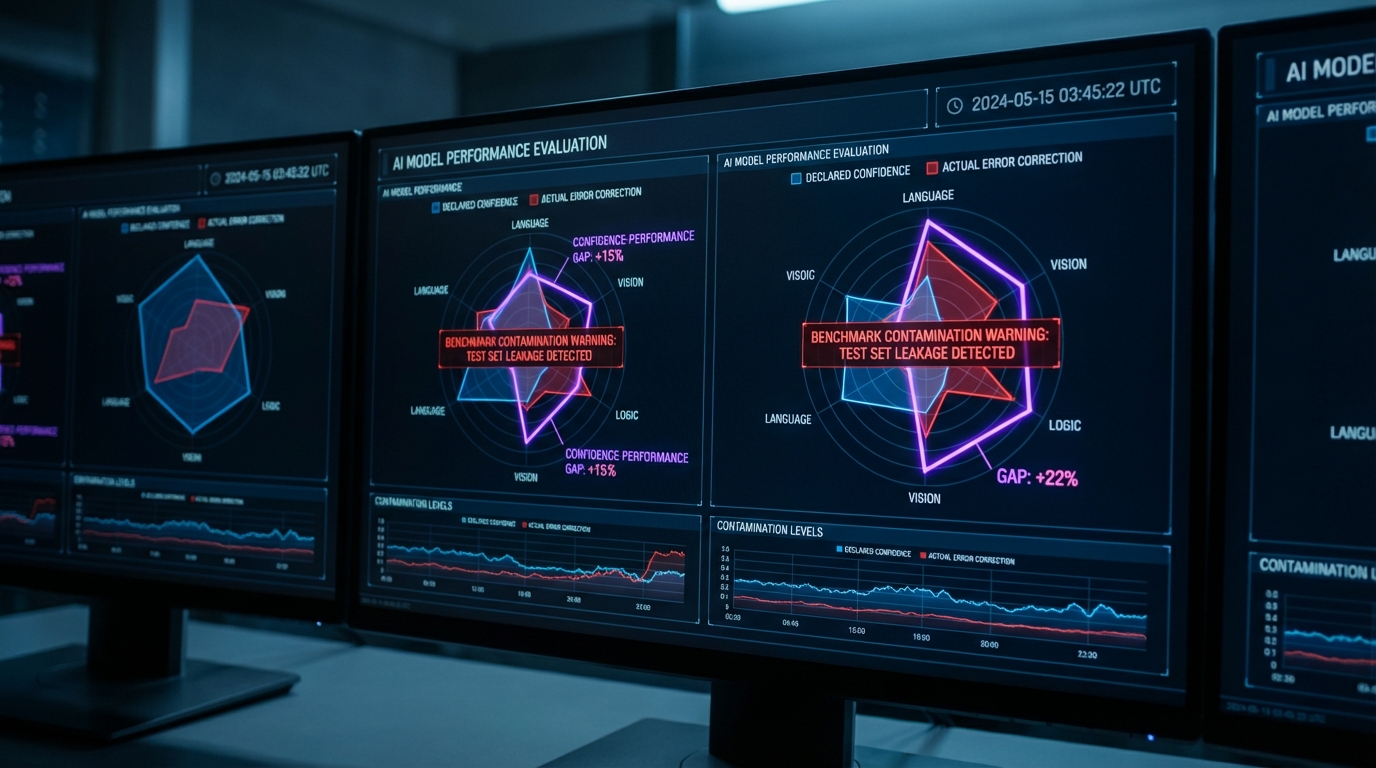

문제 2: 정적 벤치마크는 이미 게임이 끝난 운동장이다

FINAL Bench가 '무엇을 측정하는가'의 문제를 다룬다면, VeRA는 '측정 도구 자체가 오염되지 않았는가'를 다룹니다. VeRA(Verified Reasoning Data Augmentation at Scale)의 핵심 아이디어는 단순합니다. 하나의 시드 문제를 '실행 가능한 명세(executable spec)'—템플릿 + 생성기 + 결정론적 검증기—로 변환해 무제한의 검증된 변형 문제를 만드는 것입니다.

두 가지 모드가 실무적으로 중요합니다. - VeRA-E: 의미적으로 동등한 재작성 문제로 암기/오염 패턴 탐지 - VeRA-H: 난이도를 체계적으로 높인 강화 변형으로 진짜 추론 능력 측정

16개 프론티어 모델을 대상으로 한 실험에서 VeRA-E는 실제 오염 패턴을 노출했습니다. 라벨은 인간 어노테이터의 추측이 아니라 검증기(verifier)에서 자동 생성되므로 라벨링 품질 문제도 제거됩니다. 데이터 파이프라인 관점에서 보면, 이건 Feature Store에서 데이터를 고정해두지 않고 지속적으로 신선한 평가 데이터를 생성하는 MLOps 패턴을 벤치마크에 적용한 것입니다.

SWE-Bench 72.7%—이 숫자는 얼마나 믿을 수 있나?

dev.to에서 소개된 2026년 AI 코딩 모델 비교는 SWE-Bench Verified 점수를 핵심 지표로 사용합니다. Claude Sonnet 4.6의 72.7%는 인상적입니다. 하지만 VeRA가 제기한 오염 문제를 여기에 적용하면 자연스럽게 이런 질문이 나옵니다. SWE-Bench의 GitHub 이슈들이 이미 학습 데이터에 포함되어 있진 않을까요? SWE-Bench는 실제 오픈소스 저장소의 이슈를 기반으로 하기 때문에, 데이터 오염 가능성이 구조적으로 내재되어 있습니다. VeRA-E 방식의 동등 재작성을 SWE-Bench에 적용했을 때도 동일한 순위가 유지되는지—그 재현 가능성이 확인되기 전까지 72.7%라는 숫자는 조건부 신뢰에 머물러야 합니다.

시사점: 벤치마크를 읽는 세 가지 체크리스트

세 연구를 종합하면 ML 실무자가 벤치마크 수치를 볼 때 물어야 할 질문이 명확해집니다.

- 이 지표가 실제로 필요한 능력을 측정하는가? 코딩 에이전트에 메타인지가 필요하다면 SWE-Bench만으로는 부족합니다. FINAL Bench처럼 다차원 축으로 분해된 평가가 필요합니다.

- 테스트셋이 오염되지 않았는가? 정적 벤치마크는 시간이 지날수록 게임 가능성이 높아집니다. VeRA처럼 동적으로 신선한 문제를 생성하는 평가 파이프라인이 신뢰도를 높입니다.

- 실제 운영 환경에서도 이 성능이 나오는가? 벤치마크 1위 모델이 프로덕션에서 다른 순위를 보이는 건 FINAL Bench의 Claude Opus 사례에서 이미 확인됩니다.

전망: 평가 자체가 경쟁 우위가 되는 시대

FINAL Bench는 논문이 아직 게재 심사 중이고, 샘플 사이즈(100개 과제, 9개 모델)가 통계적 일반화를 위해 충분한지는 추가 검증이 필요합니다. VeRA 역시 16개 모델 실험에서 오염 패턴을 '노출'했다고 하지만, 구체적인 오염 정도의 정량화가 공개 논문에서 더 상세히 확인되어야 합니다.

그럼에도 방향성은 분명합니다. 단일 정확도 점수 하나로 모델을 줄 세우던 시대는 끝나가고 있습니다. 평가 지표 설계 자체가 AI 연구의 핵심 경쟁력이 되는 시대가 오고 있습니다. 어떤 모델이 '얼마나 많이 아는가'보다, '자기가 모르는 것을 아는가'—그리고 그것을 측정할 수 있는 벤치마크를 누가 설계하는가—가 다음 라운드의 진짜 싸움입니다.