'알고리즘 문제'라는 착각

모델이 잘 안 된다고 하면 가장 먼저 나오는 반응은 대개 이렇습니다. "아키텍처를 바꿔볼까?" "하이퍼파라미터 튜닝이 덜 됐나?" "더 큰 모델로 가야 하나?" 하지만 현장 데이터를 들여다보면 문제의 뿌리는 거의 항상 다른 곳에 있습니다. 데이터입니다. 세 가지 최근 사례가 이 명제를 서로 다른 각도에서 동시에 증명하고 있습니다.

사례 1: 수백만 개의 유세포 분석 데이터, 그런데 쓸 수 없다

2025년 6월, NIST·FDA·NIAID가 공동으로 "AI and Flow Cytometry" 워크숍을 개최했습니다. 스탠퍼드, 예일, 메이요 클리닉, BD Life Sciences 등이 참여한 이 자리의 핵심 결론은 충격적으로 단순했습니다. 수백만 개의 유세포 분석(flow cytometry) 데이터셋이 AI 적용에 부적합하다. 연간 3~5만 건씩 새로 생성되고, FlowRepository·Cytobank·ImmPort에 수십만 개의 공개 파일이 쌓여 있지만, 서로 '대화'하지 못합니다.

2020년 Bras 등이 공개 FCS 파일 211,359개를 분석한 결과, 대다수가 FCS 표준을 기술적으로 준수하지 않는 것으로 나타났습니다. 가장 큰 문제는 거창한 결함이 아니라 지극히 평범한 혼란이었습니다. 같은 마커(예: CD3)가 CD3, CD3-FITC, FL1-A, BV421-A :: CD3 등 수십 가지 이름으로 제각각 저장되어 있습니다. 숙련된 연구자라면 패널 시트를 보고 머릿속에서 맵핑하면 그만이지만, ML 모델에게 FL1-A와 CD3-FITC가 동일한 생물학적 마커라는 사실을 알 방법이 없습니다.

이건 correlation이 아니라 구조적 문제입니다. FlowCore나 FlowJo 같은 FCS 파서가 이 혼란을 수십 년에 걸쳐 '견디도록(tolerate)' 패치되어 온 것이 오히려 문제를 가려왔습니다. '견디는 것'과 '학습하는 것'은 근본적으로 다른 연산입니다.

그렇다면 해결 불가능한가? 그렇지 않습니다. 2025년 5개 기관 멀티센터 연구는 반전 포인트를 제시합니다. 서로 다른 패널 구성을 사용하는 5개 기관에서 215개 샘플을 수집해 급성 골수성 백혈병(AML) 분류 모델을 구축했습니다. 방법은 단순했습니다. 모든 패널에서 공통된 16개 파라미터만 추출하고, CytoNorm으로 배치 효과(batch effect)를 정규화한 것입니다. 결과는 다음과 같습니다.

| 지표 | 수치 |

|---|---|

| Accuracy | 98.15% |

| AUC | 99.82% |

| Sensitivity | 97.30% |

| Specificity | 99.05% |

이 결과가 중요한 이유는 숫자 자체보다 함의 때문입니다. 알고리즘 한계가 아니었습니다. 데이터 인프라의 부재가 문제였습니다. 공통 파라미터에 합의하고 배치 효과만 잡아내면 5개 기관의 이질적인 데이터가 거의 완벽한 분류기를 만들어냅니다. NIST Flow Cytometry Standards Consortium(FCSC)은 현재 5개 워킹그룹을 운영 중이며, WG5는 AI/ML 적용을 위한 표준 참조 데이터셋 구축에 집중하고 있습니다. 멤버십 비용이 연 2만 5천 달러로 대형 기관에만 열려 있다는 점은 아쉽지만, 산출물인 참조 자료와 표준 방법론은 궁극적으로 전체 필드에 공개될 예정입니다.

사례 2: ChatGPT가 OCD 환자를 더 아프게 만드는 구조

조지아 공과대학교 Grace Barkhuff의 연구(arXiv, "Reassurance Robots: OCD in the Age of Generative AI")는 AI 모델의 데이터 편향 문제를 운영 환경의 맥락에서 드러냅니다. 강박장애(OCD) 관련 Reddit 커뮤니티에서 AI·ChatGPT를 언급한 게시물 100개를 수집·분석한 결과, 세 가지 패턴이 반복해서 나타났습니다. AI로부터 안심을 구하는 강박적 질문, 의사결정을 AI에 위임하는 행동, 그리고 AI 자체가 유발하는 새로운 강박 주제(표절 의심, 직업 불안, AI 실존 공포)입니다.

여기서 데이터 품질 관점의 핵심 질문을 던져야 합니다. 샘플 사이즈가 충분한가요? 100개의 Reddit 게시물은 작은 수치입니다. 연구자 본인도 이 연구가 의학적 치료 지침이 아님을 명시했고, 자기 선택 편향(self-selection bias)이 내재된 Reddit 특성상 OCD 환자 전체 집단을 대표하지 않을 수 있습니다. 그러나 연구의 가치는 다른 곳에 있습니다. HCI(인간-컴퓨터 상호작용) 연구 데이터베이스에서 제목에 'OCD'를 포함한 논문이 단 9편이었고, AI와 OCD의 관계를 정면으로 다룬 논문은 단 한 편도 없었다는 사실. 이것이 진짜 데이터 공백입니다.

ChatGPT는 왜 '안심 로봇'이 되는가? 이건 correlation이지 causation이 아닙니다만, 메커니즘은 명확합니다. ChatGPT는 24시간 응답하고, 판단하지 않으며, 질문자의 맥락에 맞게 개인화된 답변을 제공합니다. 이 특성이 OCD 순환(강박사고 → 강박행동 → 일시적 안도 → 강화)에서 반복 확인 행동을 강화하는 완벽한 조건이 됩니다. 한 사용자의 표현처럼 "구글 검색도 안심이 되긴 하는데, ChatGPT는 내 상황에 딱 맞게 답해줘서 끊기가 너무 힘들어요"—이것은 개인화(personalization)가 특정 취약 집단에게 negative outcome을 강화하는 분포 외(out-of-distribution) 시나리오입니다. 실제 운영 환경에서도 이 성능이 나올까요? 라는 질문의 반대편—실제 운영 환경에서는 설계 의도와 전혀 다른 결과가 나올 수 있습니다.

사례 3: 선형 회귀가 다시 가르쳐주는 것

Stanford CS229 선형 회귀 정리(Velog)는 두 사례와 다른 층위에 있지만, 데이터 품질 논의에서 놓치기 쉬운 기초를 짚어줍니다. 비용 함수 J(θ)는 예측값과 실제값의 오차를 정의하고, 경사 하강법은 그 오차를 최소화하는 방향으로 가중치를 조정합니다. 정규 방정식(Normal Equation)은 반복 없이 단번에 최적해를 구하지만, 피처 수 n이 10,000을 넘으면 역행렬 계산 비용이 폭증합니다.

이 기초 공식들이 유세포 분석 사례에 직접 연결됩니다. 베이스라인 대비 얼마나 개선되었나요? CytoNorm 배치 효과 정규화는 본질적으로 형광 강도 분포(distribution)를 실험실 간에 정렬하는 작업입니다. 이것 없이는 같은 CD3 마커라도 기관마다 다른 수치 범위를 가지며, 모델이 학습하는 것은 생물학적 신호가 아니라 기관별 측정 노이즈가 됩니다. 경사 하강법이 수렴해도, 그 수렴점이 의미 없는 로컬 미니마일 수 있습니다. 이 데이터에는 어떤 편향이 있을까요?—배치 효과는 ML에서 가장 고전적이고 가장 자주 간과되는 편향입니다.

시사점: 세 사례가 하나로 수렴하는 지점

세 사례는 서로 다른 도메인(생명과학, 정신건강 AI, ML 기초)에서 동일한 명제를 반복합니다.

-

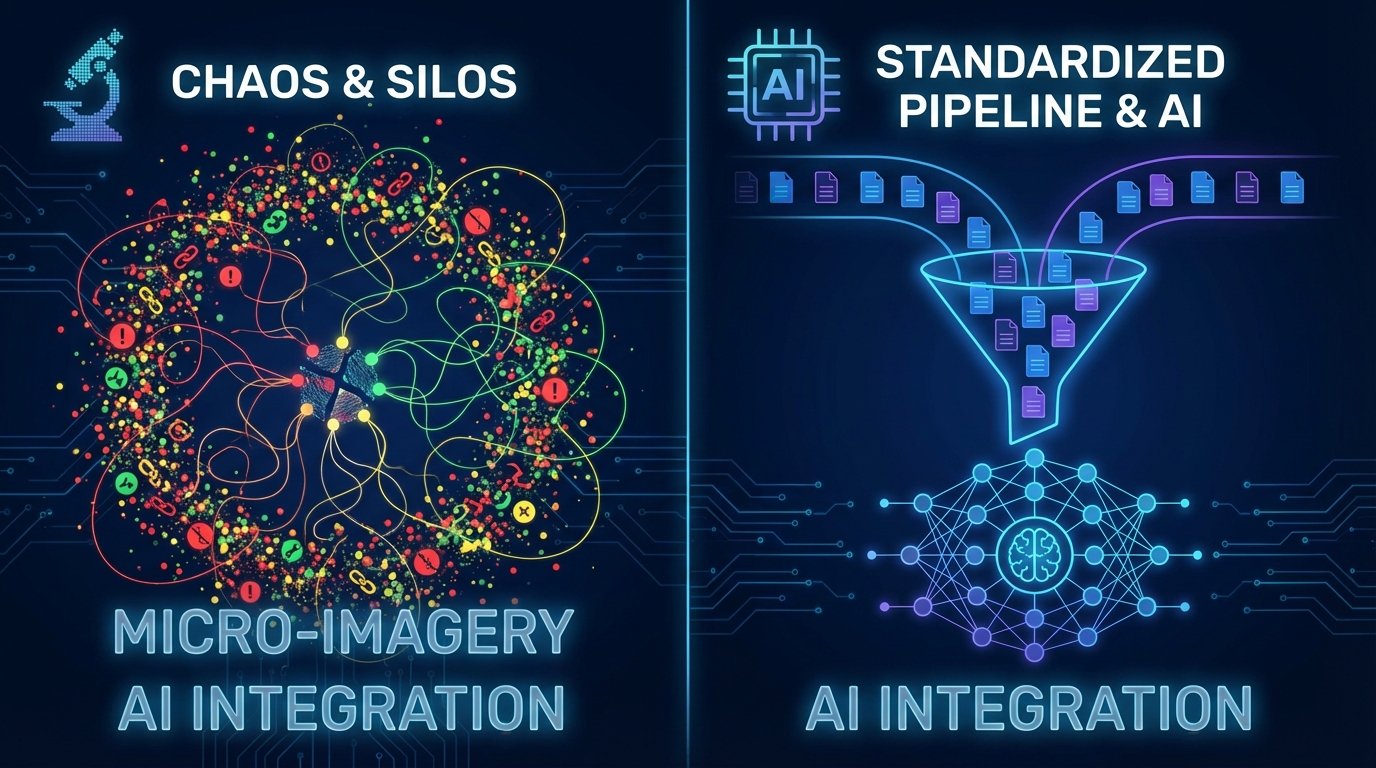

데이터 표준화 없는 모델 고도화는 기반 없는 고층 건물입니다. 유세포 분석 커뮤니티가 FlowCore로 혼란을 '견뎌온' 것처럼, 많은 ML 파이프라인이 전처리 레이어로 데이터 품질 문제를 가리고 있습니다.

-

운영 환경의 분포는 훈련 분포와 다릅니다. ChatGPT가 OCD 환자에게 해가 되는 것은 모델 자체의 결함이 아니라, 설계 시 고려되지 않은 사용자 서브그룹이 만들어내는 데이터 드리프트의 결과입니다.

-

공백 자체가 편향입니다. HCI 연구에서 OCD가 '투명 인간' 취급을 받아온 것처럼, 학습 데이터에서 특정 집단이 과소 대표되면 모델은 그 집단에 대해 체계적으로 실패합니다. Recall이 낮은 클래스를 찾아내는 것이 왜 중요한지 다시 한번 확인됩니다.

전망: 표준화 vs. 적응형 파이프라인

NIST FCSC가 택한 경로는 '먼저 표준화, 그다음 AI'입니다. 장점은 분명합니다—표준화된 데이터로 훈련된 모델은 일반화 성능이 높고 규제 검증이 가능합니다. 단점도 명확합니다—수년이 걸리며, 그사이 비표준 데이터는 계속 쌓입니다.

반대편에는 '데이터가 비표준이어도 AI가 적응하는' 접근이 있습니다. LLM으로 자유형식 메타데이터를 온톨로지에 맵핑하고, 에이전트가 파일마다 동적으로 분석 파이프라인을 조정하는 방식입니다. 이것은 더 빠르지만, 재현 가능성(reproducibility)과 해석 가능성(interpretability) 문제를 안고 있습니다. Ablation study 결과는 어떤가요? 적응형 시스템에서 어느 구성 요소가 성능에 실제로 기여하는지 검증하기가 훨씬 어렵습니다.

두 접근은 대립이 아니라 레이어입니다. 단기적으로는 공통 파라미터 추출과 배치 효과 정규화라는 실용적 방법으로 크로스랩 일반화를 확보하고, 중장기적으로 NIST 수준의 데이터 인프라를 구축하는 것이 현실적 로드맵입니다. ChatGPT-OCD 사례에서는 같은 질문이 반복될 때 응답을 제한하거나 전문가 상담을 안내하는 기능—즉 모델 레벨이 아닌 데이터 피드백 레벨의 개입—이 먼저입니다.

결국 질문은 하나로 모입니다. 우리는 지금 어떤 데이터로 무엇을 측정하고 있는가? 모델 카드에 Accuracy 98%를 적기 전에, 그 숫자가 어떤 데이터 분포에서 나왔는지, 어떤 집단이 빠져 있는지, 배포 환경의 분포와 얼마나 다른지를 먼저 물어야 합니다. 그게 ML 엔지니어링의 시작점입니다.