근거는 있나요? — 숫자가 전부가 아닌 이유

요즘 ML 커뮤니티에는 'SOTA 달성', '99% AUC', '351% 망각 감소' 같은 수치가 넘쳐납니다. 그런데 저는 벤치마크 숫자를 볼 때마다 먼저 이 질문을 꺼냅니다. 샘플 사이즈가 충분한가요? 베이스라인은 공정한가요? 실제 운영 환경에서도 이 성능이 재현되나요? 최근 dev.to에 올라온 세 편의 글은, 각기 다른 복잡도의 모델이 각기 다른 방식으로 이 질문들을 통과(하거나 통과하지 못)하는 장면을 잘 보여줍니다.

Case 1. CRMA — '제로 포게팅'의 통계적 진실

Continual Learning 분야의 고질병인 Catastrophic Forgetting(치명적 망각) 을 해결했다는 CRMA(Constrained Residual Mixing Adapter) 논문이 눈길을 끕니다. TinyLlama 1.1B와 Mistral 7B에서 4개 순차 도메인(Medical·Legal·Code·Finance)에 걸쳐 평균 드리프트 -0.1%, 반면 Naive 파인튜닝은 +351% 망각을 기록했다고 주장합니다. 숫자만 보면 인상적입니다.

그런데 Ablation study 결과는 어디에 있나요? 비교 대상이 'Naive 파인튜닝' 단 하나뿐이라는 점이 걸립니다. EWC(Elastic Weight Consolidation), Progressive Neural Network, LoRA 기반 Continual Learning 등 기존 SOTA 기법들과의 비교가 없으면 베이스라인이 공정하다고 보기 어렵습니다. 또한 4개 도메인, 2개 모델 크기라는 실험 설계는 일반화 성능(generalization) 을 주장하기엔 샘플 공간이 협소합니다. 저자 스스로도 '독립 검증에 협조하겠다'고 밝혔는데, 이는 재현 가능성(reproducibility)이 아직 커뮤니티 레벨에서 확인되지 않았음을 의미합니다. 결론: 흥미로운 아이디어지만, 이건 correlation처럼 보이는 수치이지 causation이 증명된 논문은 아닙니다.

Case 2. GMM+Fisher Vector+SVM vs. Agentic AI — 정밀도 우위의 조건

유세포 분석(Flow Cytometry) 영역에서는 완전히 다른 철학의 대결이 펼쳐지고 있습니다. dev.to의 비교 분석 글은 AHEAD Medicine의 GMM→Fisher Vector→SVM 파이프라인과 LLM 기반 에이전틱 시스템 Flow Monkey를 해부합니다.

AHEAD의 숫자는 강합니다. 5개 기관 215개 샘플로 학습, AUC 99.82%, 독립 검증(196샘플)에서도 AUC 98.71%. 학습→검증 간 정확도 낙폭이 약 4%p로 멀티센터 데이터 특성상 납득 가능한 범위입니다. Fisher Vector가 50,000개 세포를 단일 고차원 벡터로 압축하는 방식은 정보 손실을 최소화하는 수학적으로 우아한 접근이며, SVM 분류기는 이 고차원 공간에서 마진을 극대화합니다. 베이스라인 대비 개선폭도 명확하고, 실험 설계도 비교적 엄밀합니다.

그러나 이 성능은 조건부입니다. 16개 공유 마커가 존재하는 AML vs. 비종양 이진 분류에 최적화된 파이프라인입니다. 학습 데이터에 없는 새 마커 패널이 들어오면 모델은 침묵하거나 실패합니다. 반면 Flow Monkey는 정확도에서 지지만, CD39·TIM-3·LAG-3 같이 한 번도 학습하지 않은 마커 조합을 면역학 지식 기반 추론으로 처리할 수 있습니다. Latency는 LLM 추론 호출 다수로 샘플당 30~60초로 늘어나지만, 범용성이라는 트레이드오프를 얻습니다. 정밀도(Precision)와 유연성(Flexibility)은 같은 축 위에 있지 않습니다.

Case 3. Logistic Regression으로 가짜뉴스 잡기 — 단순함의 힘

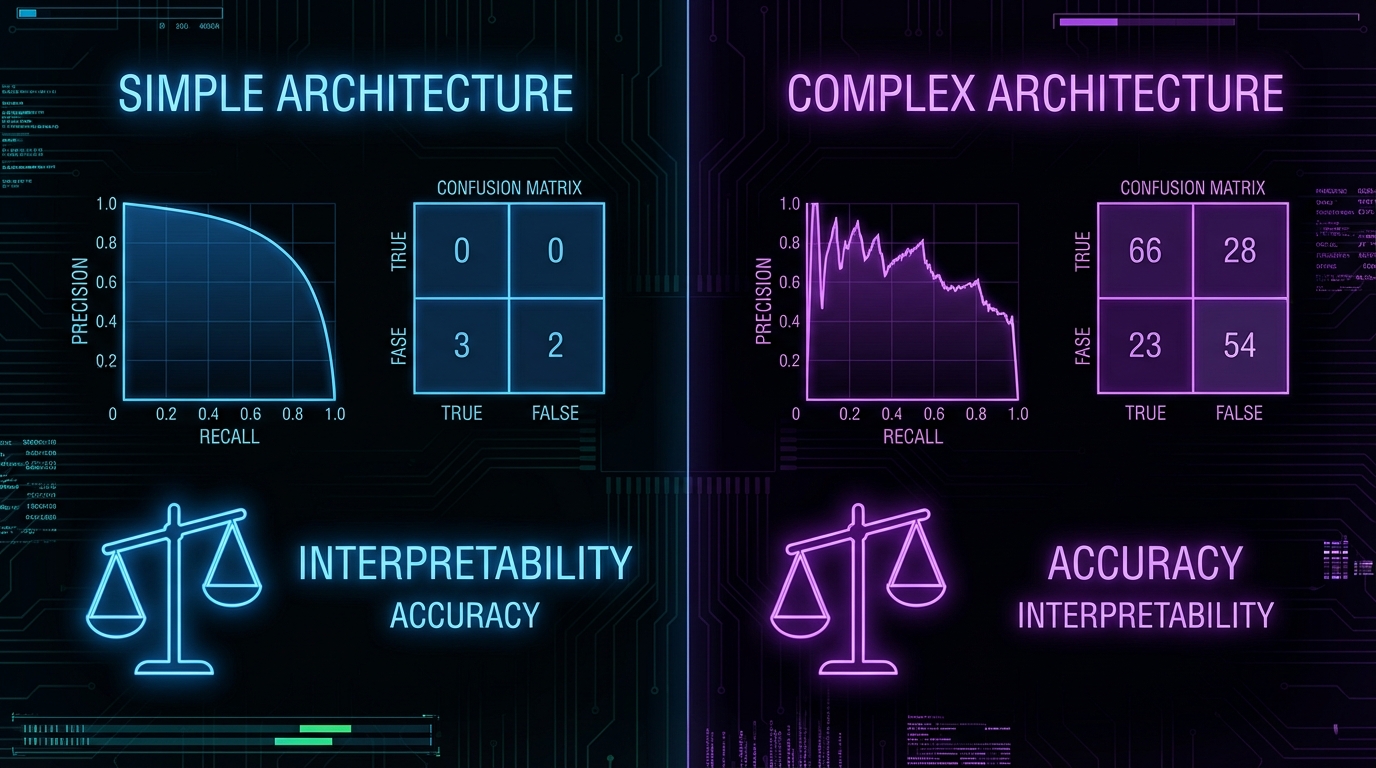

세 번째 사례는 TF-IDF + Logistic Regression으로 가짜뉴스를 이진 분류하는 고전적 접근입니다. BERT, GPT 계열 모델이 NLP를 지배하는 시대에 왜 굳이 로지스틱 회귀인가요?

답은 해석 가능성(Interpretability) 에 있습니다. 모델 계수를 분석하면 '어떤 단어가 가짜뉴스 예측에 얼마나 기여했는가'를 직접 읽어낼 수 있습니다. 이는 블랙박스 트랜스포머 모델이 제공하지 못하는 투명성입니다. Precision·Recall·F1-score를 균형 있게 모니터링하면서 클래스 불균형(class imbalance) 문제만 적절히 처리한다면, 실제 운영 환경에서도 충분히 경쟁력 있는 베이스라인이 됩니다.

물론 한계도 있습니다. 풍자(sarcasm), 맥락 의존적 허위 정보, 감정적으로 과장된 언어는 TF-IDF 피처만으로는 포착이 어렵습니다. 그러나 이건 단순 모델의 실패가 아니라 피처 엔지니어링의 미완성입니다. 감성 점수, 개체명 인식(NER), 출처 신뢰도 피처를 추가한다면 복잡한 딥러닝 모델에 근접하는 성능을 훨씬 낮은 비용으로 달성할 수 있습니다.

시사점 — '복잡할수록 좋다'는 편견을 버려야 합니다

세 사례를 관통하는 메시지는 명확합니다. 모델 복잡도와 실용 가치는 정비례하지 않습니다.

| 모델 | 강점 | 약점 | 적합한 Use Case |

|---|---|---|---|

| CRMA (LLM 어댑터) | 망각 억제 (주장) | 재현성 미검증, 비교군 부족 | Continual Learning 연구 |

| GMM+FV+SVM | 고정밀도, 빠른 추론 | 패널 일반화 불가 | 잘 정의된 임상 분류 |

| Agentic LLM | 범용 추론, 제로샷 | 낮은 정확도, 높은 Latency | 탐색적·신규 패널 분석 |

| Logistic Regression | 해석 가능, 저비용 | 복잡한 언어 패턴 한계 | 책임성이 중요한 분류 |

알고리즘 선택은 Use case의 제약 조건이 결정해야 합니다. 임상 진단처럼 정밀도와 속도가 생사를 가르는 환경에서는 GMM+SVM이 맞습니다. 법적 책임(accountability)이 따르는 의사결정 시스템에서는 Logistic Regression의 계수 해석이 SHAP 값보다 더 실용적일 수 있습니다. 새로운 도메인을 빠르게 탐색해야 하는 연구 환경에서는 Agentic 시스템이 빛을 발합니다.

전망 — 실험 설계가 먼저, 모델 선택은 그 다음

앞으로 ML 커뮤니티가 집중해야 할 것은 더 복잡한 모델 발명이 아니라 더 엄밀한 실험 설계입니다. 통계적 유의성(p-value)과 충분한 샘플 사이즈 없이 발표된 수치는 마케팅에 가깝습니다. CRMA처럼 흥미로운 아이디어도 독립 재현 실험, 다양한 도메인에서의 Ablation study, 기존 SOTA와의 공정한 비교를 거쳐야 비로소 '발견'이 됩니다.

데이터 드리프트 모니터링, 프로덕션 환경에서의 성능 저하(distribution shift), 라벨링 품질 관리—이 MLOps 요소들이 어떤 화려한 아키텍처보다 실제 시스템의 신뢰도를 결정합니다. 결국 가장 좋은 모델은 가장 복잡한 모델이 아니라, 자신의 한계를 알고 그 한계를 투명하게 드러내는 모델입니다.