핵심 이슈: 모델이 배포된 순간부터 진짜 문제가 시작된다

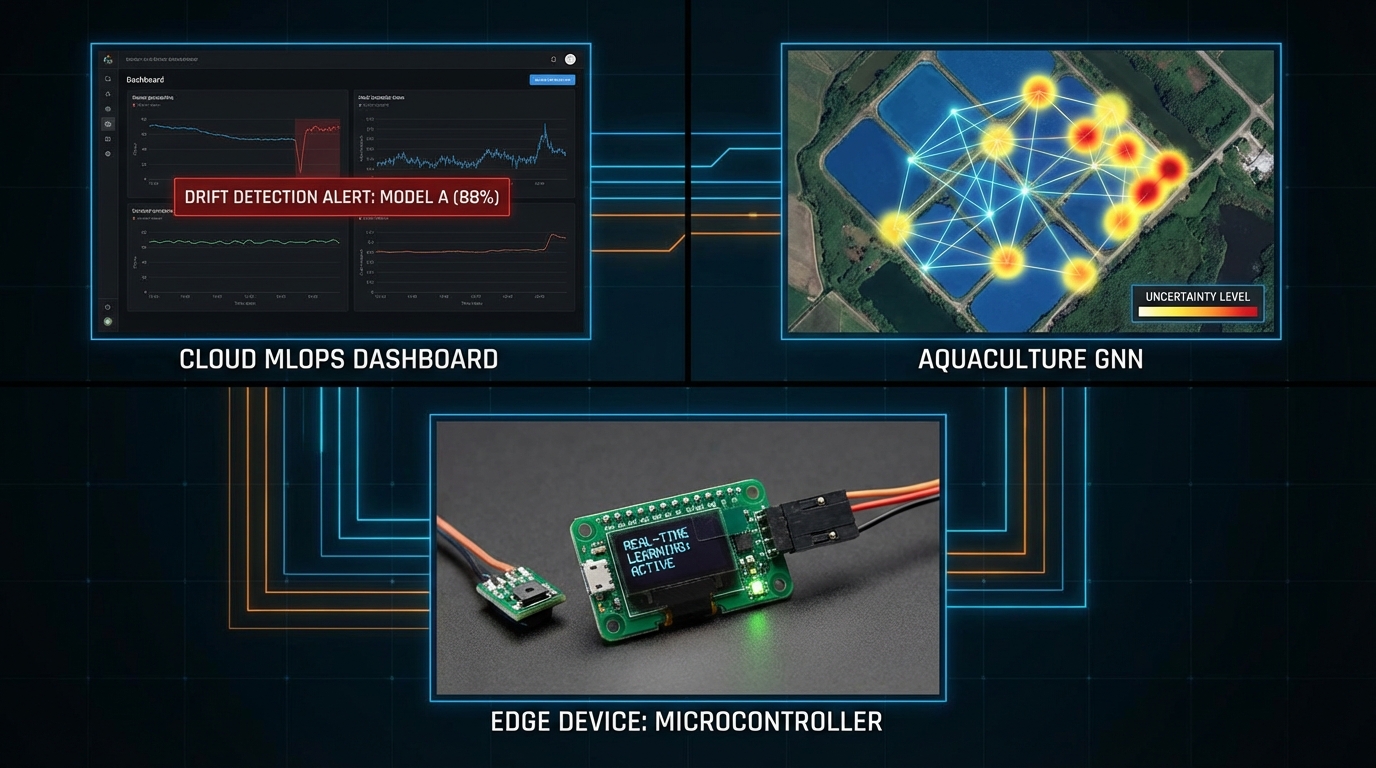

'모델 성능 X% 달성'이라는 문장 앞에서 저는 항상 같은 질문을 던집니다. "그거 프로덕션에서도 나오나요?" 최근 dev.to에 올라온 세 편의 글—MLOps 파이프라인 구축기, 확률적 그래프 신경망(PGNN) 적용 사례, TinyML 온디바이스 학습 라이브러리 embml 소개—은 서로 다른 스택을 다루지만, 결국 같은 질문에 대한 답을 찾고 있습니다. 훈련 환경 밖에서도 신뢰할 수 있는 ML 시스템을 어떻게 만드는가.

맥락 해석 ①: MLOps — 배포는 시작이지 끝이 아니다

dev.to의 신용평가 모델 MLOps 구축기는 솔직한 고백으로 시작합니다. "훈련은 전체 작업의 20%에 불과하다." 나머지 80%는 API 서빙, 컨테이너화, CI/CD, 모니터링, 재학습 파이프라인입니다. 이 글에서 실질적으로 주목할 부분은 Evidently AI를 활용한 데이터 드리프트 감지 구성입니다. 신용평가처럼 입력 분포가 경기 사이클, 금리, 사회적 이벤트에 따라 조용히 변하는 도메인에서는 모델이 '틀렸다'는 사실을 눈치채기까지 수개월이 걸릴 수 있습니다. 모니터링 없이는 F1-score가 유리창처럼 깨지는 순간을 로그에서 사후 발견하게 됩니다.

한 가지 짚고 넘어가야 할 점이 있습니다. 이 튜토리얼은 합성 데이터(synthetic data) 5,000건으로 훈련한 모델을 사용합니다. np.random.seed(42) 로 재현성을 확보한 건 좋지만, 합성 데이터로 만든 드리프트 감지 베이스라인이 실제 금융 데이터의 분포를 얼마나 대표하는지는 별개의 문제입니다. 이건 correlation이지 causation이 아닙니다—드리프트가 '감지된다'는 것과 '의미 있는 드리프트를 감지한다'는 것은 다릅니다. 그럼에도 FastAPI + Docker + GitHub Actions + Evidently AI 스택의 레퍼런스 아키텍처로서의 가치는 충분합니다.

맥락 해석 ②: PGNN — 예측값보다 예측의 불확실성이 더 중요할 때

동남아시아 새우 양식장에서 출발한 PGNN 연구는, 어쩌면 ML이 가장 자주 실패하는 지점을 정확히 건드립니다. 센서가 오작동하고, 관찰값은 주관적이고, 번역은 근사치다. 이런 환경에서 포인트 예측(point prediction)은 위험합니다. 모델이 "산소 농도 정상"이라고 단언할 때, 그 확신의 근거는 무엇인가요?

dev.to의 해당 연구는 PyTorch Geometric 기반 이종 그래프(HeteroData)에 Monte Carlo Dropout을 얹어 베이지안 근사 추론을 구현합니다. 핵심 아이디어는 간단합니다. 추론 시에도 드롭아웃을 켜둔 채로 여러 번 포워드 패스를 돌리면, 예측값의 분산이 모델 불확실성의 proxy가 됩니다. 예: "A3 펜에서 12시간 내 산소 급감 확률 85%, 신뢰도 높음." 이 숫자가 의미 있으려면 캘리브레이션(calibration)이 중요합니다—predicted probability 85%가 실제로 85%의 빈도로 발생해야 합니다. Ablation study에서 MC 샘플 수에 따른 분산 수렴 여부를 확인했는지 궁금한 대목입니다.

알고리즘 선택 관점에서도 흥미롭습니다. GNN은 공간적 의존성(수질이 인접 펜에 미치는 영향)을 자연스럽게 인코딩하고, XLM-R 임베딩은 태국어·베트남어·영어 텍스트를 동일한 시맨틱 공간에 매핑합니다. 다만 이 이종 그래프의 엣지 정의(규제 문서 ↔ 펜, 이해관계자 ↔ 펜)가 실제 운영에서 얼마나 안정적으로 유지되는지—즉, 그래프 구조 자체의 드리프트를 어떻게 다룰 것인지는 여전히 열린 문제입니다.

맥락 해석 ③: TinyML — 서버가 없는 곳에서의 신뢰성

embml은 정반대의 제약 조건에서 출발합니다. 동적 할당도 없고, 외부 의존성도 없고, Python 런타임도 없습니다. 순수 C99로 ESP32·STM32F4·RP2040에서 돌아가는 온라인 학습 라이브러리입니다. TinyML의 전통적 패러다임—"훈련은 서버에서, 추론만 엣지에서"—을 정면으로 거스릅니다.

성능 trade-off 관점에서 뜯어보면 흥미롭습니다. SGD 기반 선형/로지스틱 회귀는 수렴 속도가 느린 대신 메모리 footprint가 최소입니다. RLS(Recursive Least Squares)는 학습률 튜닝 없이 빠르게 수렴하지만, P 행렬(N×N 공분산)을 메모리에 유지해야 해서 N이 커지면 즉시 MCU 메모리 한계에 부딪힙니다. Echo State Network는 고정된 reservoir를 플래시에 올리고 선형 readout만 RLS로 학습—계산 비용과 적응성의 균형에서 가장 영리한 타협입니다.

핵심 가치는 latency가 아닙니다. 센서 드리프트 후 6개월, 서버 없이, 현장에서 스스로 교정하는 능력입니다. 온도 보상 예제에서 linear_update()를 수백 샘플 돌리면 모델이 현장 조건에 수렴한다는 주장은 직관적으로 타당하지만—샘플 사이즈가 충분한가요? 수렴 기준은 어떻게 정의했나요? 이 부분은 도메인별 실증 검증이 필요합니다.

시사점: 세 접근법이 가리키는 공통 좌표

세 기사를 관통하는 키워드는 적응성(adaptability)입니다. MLOps는 분포 변화를 감지하고 재학습으로 대응하고, PGNN은 불확실성을 예측에 포함시켜 신뢰 구간을 제공하고, TinyML은 아예 모델이 현장에서 스스로 업데이트됩니다. 방법론은 달라도, 모두 '배포 후 세계'의 변화에 어떻게 반응할 것인가를 다룹니다.

실무적으로는 세 접근법이 배타적이지 않습니다. MLOps 파이프라인에 불확실성 추정을 추가하면 드리프트 감지의 민감도가 높아집니다. TinyML 디바이스의 온라인 학습 로그를 중앙 Feature Store에 수집하면 클라우드 모델 재학습의 품질이 올라갑니다. PGNN의 uncertainty score는 어떤 샘플을 재라벨링해야 할지 능동 학습(active learning) 기준으로 쓸 수 있습니다.

전망: '신뢰성'이 다음 성능 지표가 된다

벤치마크 경쟁이 포화되면서, 다음 차별화 축은 모델이 얼마나 오래, 얼마나 예측 가능하게 작동하는가로 이동하고 있습니다. Accuracy나 ROC-AUC는 스냅샷 지표입니다. 프로덕션에서 진짜 중요한 건 6개월 후 그 숫자가 얼마나 유지되는가, 이상 징후를 얼마나 빨리 감지하는가, 그리고 불확실한 상황에서 모델이 '모른다'고 솔직하게 말할 수 있는가입니다.

MLOps 모니터링, 베이지안 불확실성 정량화, 온디바이스 적응 학습은 각각 이 질문에 대한 부분 답안입니다. 세 도구를 조합하는 팀이 단일 지표 최적화에 머문 팀보다 프로덕션 신뢰성 경쟁에서 앞서게 될 것입니다. 물론—재현 가능성과 통계적 유의성을 갖춘 실험 결과로 증명된다면요.