'베이스라인 대비 얼마나 개선됐나요?'—이게 진짜 질문입니다

온디바이스 AI 담론에서 가장 자주 등장하는 수식어는 '빠르다'와 '작다'입니다. 그런데 ML 분석가 입장에서 이 두 단어만큼 맥락 없이 소비되는 말도 없습니다. 이번 주 주목할 만한 두 가지 발표—Moonshine ASR과 KAIST의 메타 예측(Meta Prediction) 기술—는 구체적인 숫자를 제시했다는 점에서 일단 합격점을 줄 수 있습니다. 하지만 '숫자가 있다'는 것과 '숫자가 충분하다'는 것은 다른 이야기입니다.

Moonshine ASR: 파라미터 효율은 인상적, 그런데 평가 조건은?

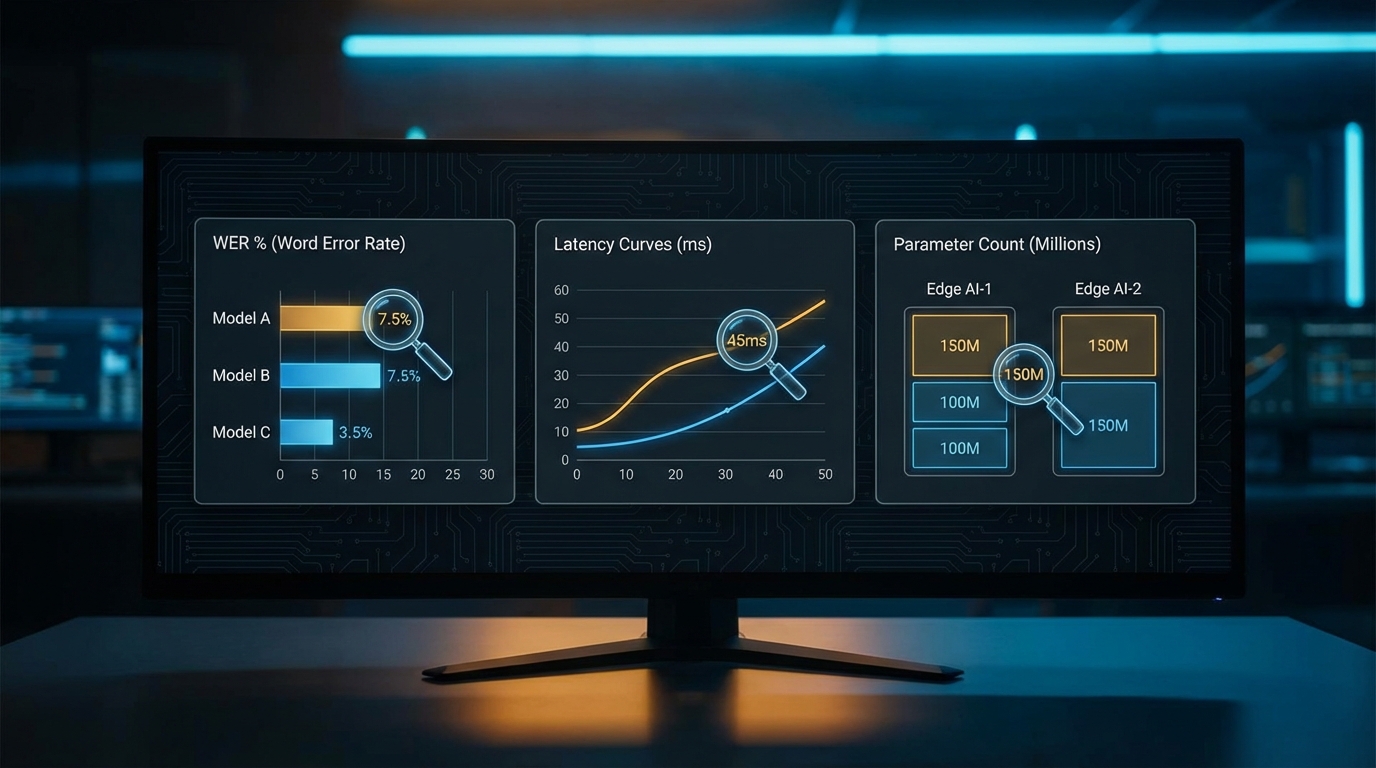

Moonshine Medium Streaming은 245M 파라미터로 WER 6.65%를 기록했습니다. 비교 대상인 Whisper Large v3는 1.5B 파라미터에 WER 7.44%. 수치만 보면 파라미터를 6분의 1로 줄이면서 WER을 약 1.2%p 개선한 셈입니다. 파라미터 효율(parameter efficiency) 관점에서 이건 분명한 진전입니다.

그런데 여기서 멈추면 안 됩니다. 몇 가지 질문이 남습니다.

첫째, 평가 데이터셋의 분포입니다. Hacker News 커뮤니티에서도 지적됐듯, "정확도 향상"이 영어 기준인지 다국어 기준인지 명확하지 않습니다. 한국어 Tiny 모델의 WER 6.46%는 흥미롭지만, 이게 어떤 테스트셋에서 측정됐는지 언어별 WER 표가 공개되지 않으면 비교가 불가능합니다. 이건 재현 가능성(reproducibility) 문제입니다.

둘째, 스트리밍 환경 전용 지표의 부재입니다. 정적 WER은 배치(batch) 추론 성능입니다. 스트리밍 ASR에서 실제로 중요한 건 '부분 안정성(partial stability)'—몇 ms마다 중간 전사 결과가 뒤집히는 비율입니다. 커뮤니티의 날카로운 지적처럼, 첫 토큰 지연(first-token latency), 실시간 비율(real-time factor), 1~3초 구간의 수정 토큰 비율 같은 지표가 없으면 실제 대화형 애플리케이션 UX를 예측하기 어렵습니다.

셋째, 리더보드 순위입니다. HuggingFace OpenASR Leaderboard에서 Parakeet V2/V3와 Canary-Qwen이 Moonshine보다 높은 성능을 보입니다. 다만 Parakeet V3는 600M 파라미터로 Moonshine Medium 대비 2.4배 큰 모델입니다. '절대 성능' vs. '파라미터당 성능'—어느 축으로 비교하느냐에 따라 결론이 달라집니다. 단순 WER 비교는 이 트레이드오프를 숨깁니다.

KAIST 메타 예측: 29/30 승률의 통계적 의미

KAIST 이상완 교수팀의 메타 예측(Meta Prediction) 연구는 예측 부호화(Predictive Coding) 기반의 대안적 학습 알고리즘입니다. 핵심 아이디어는 모델이 결과만 예측하는 게 아니라 '예측 오차가 어떻게 변할지'까지 예측하도록 설계해, 깊은 신경망에서 발생하는 기울기 소실(vanishing gradient) 문제를 구조적으로 해결하겠다는 것입니다.

30가지 실험 중 29개에서 역전파(Backpropagation) 대비 높은 정확도—이건 꽤 강한 주장입니다. ICLR 2026 채택이라는 동료 심사(peer review)를 통과했다는 점도 신뢰도를 높입니다.

그럼에도 ML 분석가로서 몇 가지는 반드시 확인해야 합니다.

Ablation study 결과는 어떤가요? 메타 예측의 성능 향상이 '예측 오차 재예측'이라는 핵심 아이디어 자체에서 오는 건지, 아니면 아키텍처 변경이나 다른 하이퍼파라미터 조정의 부수 효과인지 구성 요소별 기여도를 분리해야 합니다. 논문 전문에서 이 부분이 어떻게 다뤄졌는지가 이 연구의 진짜 가치를 결정합니다.

실패한 1개 실험도 무시할 수 없습니다. 어떤 조건에서 역전파가 우세했는지, 그 boundary condition을 이해하는 것이 실용적 적용 범위를 결정합니다.

일반화 성능(generalization)도 중요합니다. 논문 실험 환경과 실제 프로덕션 데이터 사이에는 항상 분포 차이(distribution shift)가 있습니다. 뉴로모픽 컴퓨팅·엣지 AI 적용 가능성을 주장하려면, 해당 도메인 데이터에서의 추가 검증이 필요합니다.

로컬 LLM 실운영 사례: 비용 데이터가 말해주는 것

이론적 벤치마크를 현실 운영 지표로 연결하는 사례가 있습니다. MFS Corp의 하이브리드 LLM 전략은 2025년 2월 실제 청구서를 공개했습니다. 월 100만 토큰 처리 기준, 클라우드 전용 시 예상 비용 600~800달러 대비 하이브리드(로컬 추론 + 선택적 클라우드) 전략으로 실제 지출 12.20달러—약 98% 비용 절감입니다.

이 숫자는 인상적이지만, 그대로 받아들이면 안 됩니다. 로컬 추론 비용을 '전기세 5달러'로만 계산했는데, GPU 하드웨어 감가상각, 유지보수 인건비, 모델 업데이트 관리 비용은 포함되지 않았습니다. Total Cost of Ownership(TCO) 관점에서 재계산이 필요합니다.

그럼에도 이 사례가 유용한 이유는, 태스크 복잡도에 따른 모델 라우팅 전략을 데이터로 보여주기 때문입니다. 루틴 고빈도 태스크 → 로컬(Llama, Mistral 4비트 양자화), 중간 복잡도 → Claude Sonnet, 전략적 의사결정 → Claude Opus. 양자화에 따른 품질 손실이 80%의 태스크에서 유의미하지 않다는 경험적 관찰은 온디바이스 AI 모델 선택 기준에 실용적인 시사점을 줍니다.

세 가지 발표가 수렴하는 지점

세 사례를 함께 놓으면 하나의 패턴이 보입니다. 온디바이스 AI는 더 이상 '가능한가'의 문제가 아니라 '어느 태스크에, 어느 크기의 모델로, 어떤 품질 손실을 감수하고'라는 최적화 문제로 이동했습니다.

Moonshine은 파라미터 효율과 엣지 배포 가능성을 실증했고, KAIST 메타 예측은 역전파를 대체할 수 있는 로컬 친화적 학습 알고리즘의 가능성을 열었으며, MFS Corp 사례는 실운영에서의 비용-품질 트레이드오프 의사결정 프레임을 보여줬습니다.

하지만 세 발표 모두 공통적으로 프로덕션 환경에서의 데이터 드리프트 대응, 장기 성능 모니터링, 재학습 파이프라인에 대한 답을 아직 내놓지 않았습니다. 벤치마크 정확도와 실제 운영 정확도 사이의 간극—이게 온디바이스 AI가 다음으로 풀어야 할 진짜 숙제입니다.

분석가의 체크리스트

온디바이스 AI 성능 발표를 볼 때 이 질문들을 먼저 던지세요.

- WER/정확도 측정에 사용된 테스트셋의 도메인과 언어 분포는?

- 베이스라인 모델의 하이퍼파라미터 튜닝 수준은 동일한가? (불공정한 비교 방지)

- 스트리밍 ASR이라면 정적 WER 외 latency 분포, partial stability 지표는?

- ablation study로 어느 구성 요소가 성능 향상을 주도했는지 분리됐는가?

- 로컬 추론 비용 계산에 TCO(하드웨어, 유지보수)가 포함됐는가?

- 재현 코드와 데이터가 공개됐는가?

숫자는 이야기의 시작입니다. 맥락이 이야기를 완성합니다.