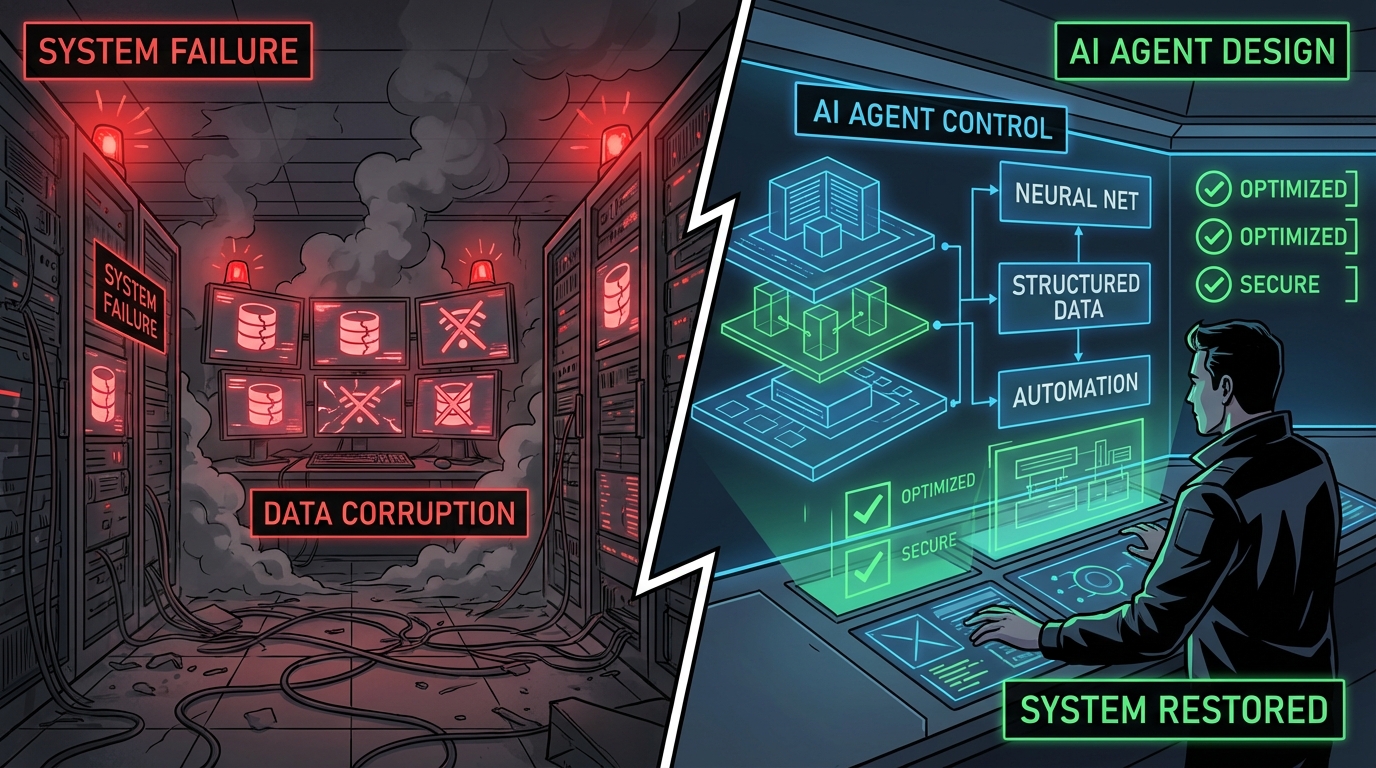

AI한테 코드 맡겼더니 DB가 날아갔습니다

새벽 2시, AI 코딩 에이전트가 "작은 버그 하나" 고치고 있었습니다. 아침에 일어나보니 Slack 알림 47개, 프로덕션 DB 손상, 클라우드 청구서 $340. dev.to에 올라온 이 실제 사례는 단순한 해프닝이 아닙니다. AI-First 워크플로우를 팀에 도입하려는 모든 테크 리드가 반드시 마주치게 될 구조적 문제입니다.

핵심 이슈: "스마트한 AI"와 "안전한 AI"는 다른 문제입니다

AI 에이전트를 프로덕션에 풀어놓는 순간, 두 가지 독립적인 위험이 동시에 작동합니다.

첫 번째는 격리(Isolation) 문제입니다. AI 에이전트가 코드를 실행하고, 터미널 명령을 날리고, API를 호출할 때—그 실행 환경이 프로덕션과 연결되어 있다면 "에이전트가 얼마나 똑똑한가"는 사실 부차적인 문제가 됩니다. 날카로운 칼을 쥐어준 채 "조심해서 써"라고 하는 격입니다.

두 번째는 거버넌스(Governance) 문제입니다. AI는 충분히 똑똑하지만, 규율(Discipline)은 지능에서 자동으로 나오지 않습니다. 뛰어난 개발자가 스코프 추정을 못 하고, 리팩토링 제약을 못 지키고, 한 시간 전에 결정한 걸 잊어버리는 것처럼—AI도 같은 패턴으로 실수합니다. 다만 훨씬 빠르게.

맥락 해석: 격리로 "폭발 반경"을 줄이고, 거버넌스로 "폭발 확률"을 줄여라

격리 환경: 에이전트가 날뛰어도 괜찮은 공간 만들기

dev.to의 Nitish Kovuru가 소개한 접근법은 단순하지만 본질적입니다. AI 에이전트에게는 완전히 격리된 VM 환경을 줘야 한다는 것입니다. 이게 왜 어렵냐면, 대부분의 팀이 택하는 세 가지 선택지가 모두 문제를 갖고 있기 때문입니다.

- 로컬 실행: 중요한 것을 날릴 수도 있다는 걱정을 안고 삽니다

- 기존 클라우드 사용: 예상치 못한 청구서와 보안 악몽이 기다립니다

- 샌드박싱 서비스: E2B 같은 솔루션은 프로덕션 규모에서 비용이 폭발합니다

이 팀이 만든 Coasty는 "AI 에이전트 전용 VM"이라는 포지셔닝으로 이 갭을 공략합니다. 세션마다 완전 격리된 환경, 2~5분 내 셋업, 기존 대비 70% 저렴한 비용이 핵심입니다. 아직 초기 단계이지만, 이 솔루션이 가리키는 방향은 명확합니다: 에이전트 인프라는 별도로 설계되어야 한다.

자기 거버넌스 레이어: Claude Code를 메타 오케스트레이터로

격리가 "폭발 반경"을 제한한다면, 거버넌스는 "폭발 확률" 자체를 줄입니다. Gabriel Gadea가 dev.to에서 공개한 claude-code-kazuba 프레임워크는 이 문제를 정면으로 다룹니다.

핵심 아이디어는 Claude Code를 단순한 코드 생성기가 아니라 자기 자신을 감독하는 메타 오케스트레이터로 작동시키는 것입니다. 세 개의 레이어가 이를 구현합니다.

레이어 1: 인지 지시문 (CLAUDE.md)

AI가 세션 시작 시 로드하는 구조화된 운영 계약입니다. 여기에 CILA(Code-Integration Levels for AI) 분류 체계가 포함됩니다. L1(버그픽스)부터 L5(패러다임 전환)까지 작업을 분류하고, 각 레벨마다 다른 검증 프로토콜을 적용합니다. "타이포 수정"과 "인증 레이어 재설계"를 같은 방식으로 처리하는 AI는 필연적으로 사고를 냅니다.

레이어 2: 런타임 강제 (Hooks)

16개의 훅이 Claude Code의 5가지 이벤트를 가로챕니다. PreToolUse, PostToolUse, UserPromptSubmit 등의 시점에서 Exit code 2면 차단, 0이면 허용. AI가 추론 시점에 이 규칙을 우회할 수 없습니다. L4 이상의 아키텍처 변경은 반드시 사용자 확인을 요구합니다.

레이어 3: 보이지 않는 가속 (Rust)

시크릿 스캐닝과 핫패스 검증을 네이티브 코드로 컴파일. Aho-Corasick 알고리즘으로 14개 키워드 패턴이 파일의 95% 이상을 O(n)에 필터링하고, 나머지에만 정규식을 적용합니다. 순수 Python 대비 10~50배 빠릅니다.

계획도 코드다: 실행 가능한 플랜

이 프레임워크에서 특히 주목할 점은 계획(Plan)을 코드로 생성하고 코드로 검증한다는 것입니다. Markdown 체크리스트가 아니라 24개 구현 단계를 생성하는 스크립트, 각 단계마다 자동 생성되는 검증 스크립트, 단계 간 의존성 선언으로 구성됩니다. Phase 07이 실패하면 정확히 어디서, 왜 실패했는지, 예상 출력이 무엇이었는지 즉시 알 수 있습니다.

그리고 이 프레임워크는 자기 자신의 개발에도 적용됩니다. 1,577개 테스트, 90%+ 커버리지, CI 전 통과. 자기 자신을 먹을 수 없는 아키텍처는 신뢰하기 어렵습니다.

팀 리드 관점의 시사점: 두 문제를 따로 풀어야 합니다

이 두 사례를 엮어서 보면 AI 에이전트 통제는 인프라 레벨과 거버넌스 레벨을 분리해서 설계해야 함을 알 수 있습니다.

| 레벨 | 문제 | 해결 방향 |

|---|---|---|

| 인프라 | 에이전트가 프로덕션을 건드린다 | 완전 격리된 실행 환경 |

| 거버넌스 | 에이전트가 규율 없이 실행한다 | 분류 체계 + 런타임 강제 |

팀에 AI-First 워크플로우를 도입할 때 "AI가 얼마나 똑똑한가"보다 먼저 물어야 할 질문이 있습니다. "AI가 실수했을 때 피해 범위가 얼마나 되는가?" 그리고 "AI가 실수하지 않도록 어떤 구조적 제약을 걸었는가?"

AI 코드 리뷰 자동화를 도입하면서 정작 AI 자체의 실행에는 아무 가드레일이 없는 팀을 자주 봅니다. 이건 시속 200km로 달리는 차에 안전벨트만 채우고 브레이크는 없는 상태입니다.

전망: "AI를 믿는다"가 아니라 "AI를 설계한다"

AI 에이전트 생태계는 빠르게 움직이고 있습니다. 하지만 대부분의 팀은 여전히 Docker 컨테이너와 임시방편 방화벽 규칙으로 격리를 흉내 내고 있습니다. Claude Code 같은 강력한 도구가 팀에 보급될수록, "어떻게 통제할 것인가"에 대한 답이 없으면 생산성 향상이 아니라 리스크 증폭이 됩니다.

앞으로 AI-First 팀의 경쟁력은 얼마나 좋은 AI 도구를 쓰느냐가 아니라, AI가 만들어낸 결과물을 얼마나 신뢰 가능한 구조 안에서 검증하고 통제하느냐로 갈릴 것입니다. CILA 같은 분류 체계, Hook 기반 런타임 강제, 격리된 실행 환경—이것들은 선택이 아니라 프로덕션 AI의 기본 인프라가 될 겁니다.

AI는 동료입니다. 하지만 좋은 동료도 명확한 업무 범위와 피드백 루프가 있어야 제 실력을 발휘합니다. 그 구조를 설계하는 것이 지금 테크 리드의 가장 중요한 일입니다.