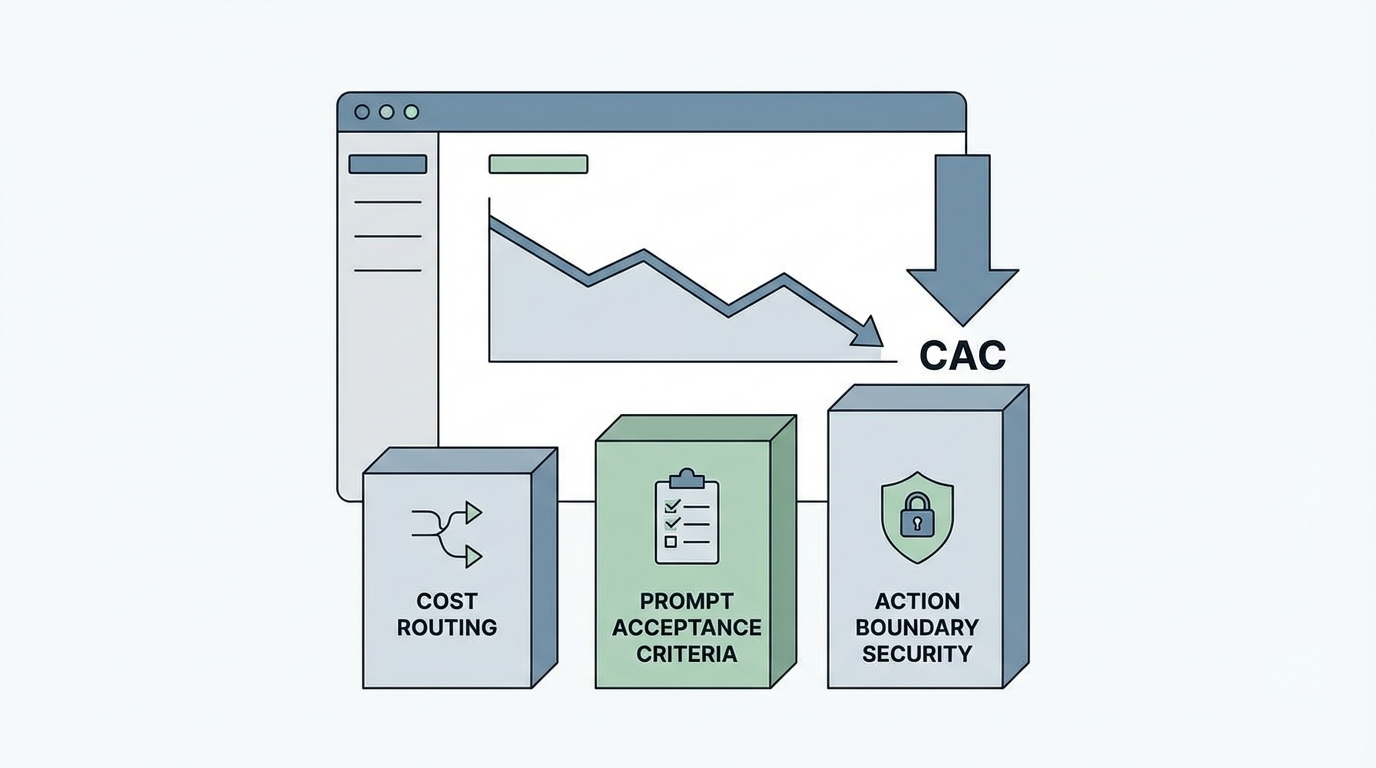

AI 제품에서 CAC가 튀는 순간은 대개 ‘광고를 더 해서’가 아닙니다. 데모는 잘 되는데 유저가 결제 직전에 멈추거나(불안), 쓰다가 그만두거나(불안+비용), 엔터프라이즈는 보안 질문에서 멈춥니다. 성능은 상향평준화되고 있어요. 이제 CAC는 COGS(모델 호출 비용)와 신뢰(보안·가드레일)가 직접 결정합니다.

dev.to에서 나온 네 가지 글이 공통으로 말하는 건 이거예요: “모델을 고르는 게임”이 아니라 “운영을 설계하는 게임”이라는 것. Sparse MOA의 모델 라우팅으로 62% 비용 절감(Thomas Perry Jr.), 프롬프트의 Acceptance Criteria로 출력 품질을 스펙화(Nova Elvaris), 그리고 에이전트의 고위험 툴 호출을 실행 직전에 막는 PIC(Provnenance & Intent Contracts) 프로토콜(Fabio Salvadori), 마지막으로 프롬프트/로그의 PII 토큰화+감사로그 체인(CloakLLM)까지. 이 3가지 레버를 붙이면 “이거 바이럴 될 것 같은데?”가 아니라 “Conversion rate가 진짜 오르겠는데?”로 바로 갑니다.

첫 번째 레버: 모델 라우팅(스파스 앙상블)로 COGS를 깎아 CAC를 낮추기. Sparse MOA 사례는 라우팅을 ‘전두엽’처럼 두고, 모든 요청에 모든 모델을 태우지 않습니다. 6개 서브스트레이트 중 1~3개만 발화시키고, 4개는 로컬(Ollama)로 돌려 API 비용을 0에 가깝게 만들죠. 결과가 강력합니다. 50개 동시 에이전트에서 호출 수가 300→115로 줄어 62% 절감, 품질 손실은 없었다고 합니다(dev.to, “Sparse MOA…”).

그로스 관점에서 이건 단순한 비용 최적화가 아니라 가격/플랜 실험의 공간을 만들어줍니다. 예: (1) 프리티어의 메시지 한도를 늘려 Activation을 올리거나 (2) 동일 가격에 더 많은 실행을 제공해 전환을 올리거나 (3) 엔터프라이즈에 “비용 예측 가능”을 세일즈 포인트로 꽂을 수 있어요. CAC가 높은 채널(검색/광고)에서조차, 단위경제가 개선되면 손익분기 ROAS가 내려가 스케일이 됩니다. 빨리 테스트해봐야 돼요: 라우팅 전/후로 요청당 비용, 첫 가치 도달까지의 실패율, 유료 전환율을 같이 보세요.

두 번째 레버: Prompt Acceptance Criteria로 ‘품질을 고정’해서 전환·리텐션을 올리기. 많은 팀이 “모델이 말을 안 들어요”라고 하는데, 사실은 “검증 가능한 완료 조건”이 없습니다. Acceptance Criteria를 먼저 쓰고, 그다음 프롬프트를 쓰는 방식은 출력 품질을 ‘감’이 아니라 ‘스펙’으로 만듭니다(dev.to, “Prompt Acceptance Criteria…”).

이게 왜 CAC를 낮추냐면, 품질이 흔들리면 온보딩에서 마찰이 터집니다. 유저는 1~2번만 헛발질해도 떠나요. 반대로 “항상 같은 형식/같은 수준”이 나오면 리뷰 비용이 줄고, 업무에 끼워 넣기 쉬워져 TTV(Time to Value)가 짧아집니다. 특히 B2B는 “환각으로 인한 리스크”가 구매 저항의 핵심인데, ‘Must not(하지 말 것)’과 ‘Self-check(기준 감사)’를 넣는 순간 신뢰가 올라갑니다. 실험 아이디어: 핵심 유즈케이스 3개를 정해서 (A) 기존 프롬프트 vs (B) AC 템플릿 적용 프롬프트로 A/B 하고, 첫 세션에서 성공률, 재시도 횟수, D7 리텐션을 보세요. 여기서 수치가 올라가면 CAC는 자연히 내려갑니다(같은 유입에서 더 많이 남으니까).

세 번째 레버: 액션 바운더리에서 ‘실행 직전 차단’으로 신뢰를 제품화하기. 에이전트가 위험한 건 “말”이 아니라 “행동”입니다. Guardrails는 출력 텍스트를 예쁘게 만들지만, 툴 호출(송금, 삭제, 데이터 내보내기)을 막진 못합니다. PIC 프로토콜은 그 갭을 찌릅니다. 고위험 액션 전에 에이전트가 구조화된 제안서를 제출하고(intent/impact/provenance/evidence/action), 신뢰된 증거가 없으면 fail-closed로 차단합니다(dev.to, “Your AI Agent Just Hallucinated a Wire Transfer…”).

이건 그로스에 직결됩니다. “보안/컴플라이언스 때문에 도입 못해요”가 “우리도 써볼 수 있겠는데요?”로 바뀌는 순간, 세일즈 사이클이 줄고 CAC가 내려가요. 여기에 CloakLLM이 제안하는 PII 토큰화 + 변조 불가능한 감사 로그(해시 체인)까지 붙이면, EU AI Act(2026-08-02) 같은 규제 대응이 “나중에 하자”가 아니라 “지금 도입하면 구매 이유”가 됩니다(dev.to, “Every LLM Prompt You Send Is Plaintext…”). 신뢰는 마케팅 문구가 아니라 프로토콜+로그로 증명되는 시대입니다.

시사점은 명확합니다. AI 제품 그로스는 이제 ‘모델 성능 PR’이 아니라 (1) 라우팅으로 원가를 낮추고 (2) 스펙 기반 프롬프트로 품질을 고정하고 (3) 실행 직전 검증으로 사고 확률을 0에 가깝게 만드는 것에서 터집니다. 이 세 가지는 모두 “엔지니어링”처럼 보이지만, 실제로는 CAC와 전환율을 건드리는 가장 빠른 레버예요. Growth Hack 할 수 있을 것 같아요.

전망: 모델은 더 싸지고 더 비슷해질 겁니다. 대신 제품 간 격차는 운영 레이어(라우팅·검증·감사·프롬프트 스펙)에서 벌어져요. 여기서 이긴 팀은 두 가지를 얻습니다. (1) 같은 품질을 더 싸게 제공해 가격 경쟁력이 생기고 (2) 신뢰를 증명해 엔터프라이즈/고가치 유저를 더 낮은 CAC로 데려옵니다. 다음 스프린트에 바로 할 일은 하나: “우리 제품에서 돈이 새고(모델 호출), 신뢰가 깨지고(환각/보안), 유저가 이탈하는 지점(액션/승인)“을 퍼널로 그린 다음, 위 3개를 가장 큰 누수 지점부터 얹어보는 것. 숫자로 바로 답이 나올 겁니다.