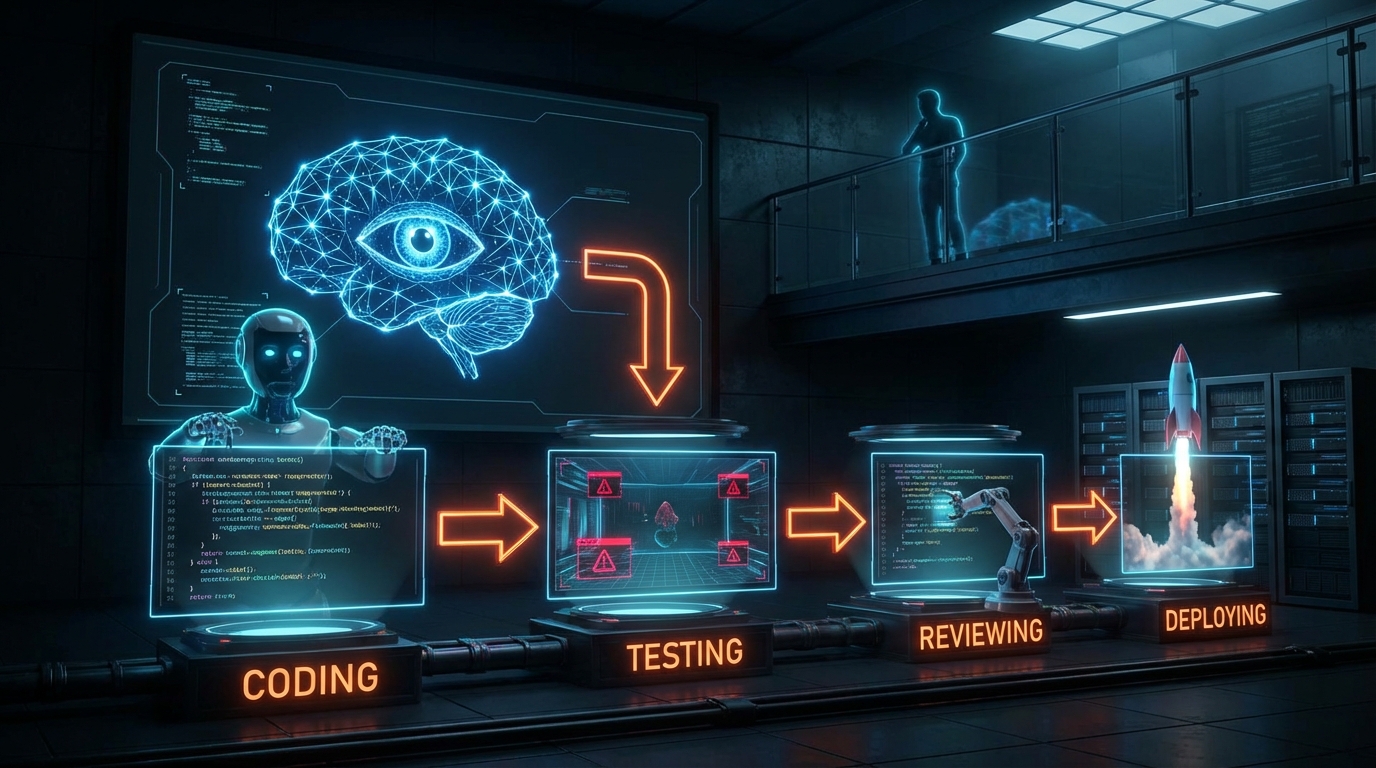

코딩 어시스턴트로 시작된 AI 도입이 이제 '개발 이후' 단계까지 삼키고 있습니다. 배포, QA, 코드 리뷰, 커밋 컨텍스트 보존—이 네 가지 영역에서 동시에 의미 있는 변화가 포착되고 있습니다. 이건 각개격파식 도구 도입이 아니에요. 기획에서 배포까지 하나의 루프로 연결되는 풀사이클 AI-First 워크플로우가 실제로 구현되기 시작한 신호입니다.

배포: 에이전트가 인프라를 직접 만진다

dev.to에 올라온 실험 글이 눈길을 끌었습니다. 개발자가 Claude에 MCP(Model Context Protocol) 서버를 연결해 Next.js 앱을 자동 배포하는 과정인데요—Dockerfile도, YAML도, 빌드 설정도 없이 프롬프트 한 줄로 Kubernetes 위에 HTTPS 앱이 올라갔다는 겁니다. 30초 만에요.

더 흥미로운 건 그 이후입니다. 같은 대화 안에서 Postgres 데이터베이스를 만들고, 환경변수를 연결하고, 에러 로그를 조회하고, 앱을 재시작하는 일련의 흐름이 창 전환 없이 하나의 채팅 스레드 안에서 완결됐습니다. '코드 작성 → 배포 → 에러 확인 → 픽스 → 재배포'라는 루프가 에이전트 안에서 닫힌 거예요.

이게 왜 중요하냐면—기존의 고통은 핸드오프에 있었습니다. 에이전트가 코드를 완성해줘도, 배포 대시보드, DB 설정, env 관리는 여전히 인간 몫이었죠. MCP가 그 갭을 메우기 시작했습니다.

QA: "테스트해줘"를 자연어로 말하는 시대

AI가 배포만 가져간 게 아닙니다. QA도 바뀌고 있어요. Vercel AI SDK와 Agent Browser를 조합한 QA 에이전트 구현 사례를 보면, 이런 식입니다:

"로그인 페이지에서 잘못된 자격증명을 입력하고, 에러 메시지가 표시되는지 확인해줘"

Selenium 스크립트도, Cypress 설정도 필요 없습니다. LLM이 Headless Chromium을 직접 조작하면서 페이지의 접근성 스냅샷을 읽고, 요소를 클릭하고, 타이핑하고, 결과를 검증합니다. CSS 셀렉터나 XPath 없이 시맨틱하게 DOM을 이해하는 방식이라 UI가 바뀌어도 테스트가 덜 깨지는 구조예요.

이 아키텍처에서 주목할 점은 모델 교체 비용이 0에 가깝다는 겁니다. LLM Gateway를 통해 Claude, GPT-4o, Gemini를 문자열 하나로 바꿀 수 있어요. 특정 LLM 벤더에 종속되지 않고 QA 파이프라인을 운영할 수 있다는 의미입니다.

코드 리뷰: 커밋 직전에 에이전트가 감시한다

AI가 코드를 빠르게 생성할수록, 그 코드를 검증하는 레이어도 강해져야 합니다. git-lrc는 git commit 훅에 AI 리뷰를 심는 도구예요. 커밋 전 diff를 분석해서 인라인 코멘트로 문제를 짚어줍니다—유출된 자격증명, 고비용 클라우드 연산, 민감 정보가 포함된 로그 등.

"AI 에이전트는 코드를 빠르게 지우고, 로직을 바꾸고, 버그를 심는다—당신에게 알리지 않고"—이 문장이 핵심입니다. 코딩 에이전트의 속도가 높아질수록 이런 게이트키퍼 레이어가 반드시 필요합니다. AI가 생성한 코드를 AI가 리뷰하는 구조, 저는 이걸 AI-in-the-loop 코드 거버넌스라고 부릅니다.

60초 셋업, 완전 무료라는 점에서 팀 온보딩 장벽도 낮습니다. 지금 당장 팀 레포에 붙여볼 만한 도구예요.

커밋 컨텍스트: AI가 쓴 코드, 왜 이렇게 됐는지 기록해야 한다

배포와 QA를 자동화해도, 왜 그런 결정을 내렸는가를 추적하지 않으면 기술 부채가 쌓입니다. dev.to의 한 글이 이걸 정면으로 다룹니다. AI가 생성한 코드에는 선택의 이유가 없습니다. 왜 axios를 fetch 대신 썼는지, 어떤 엣지 케이스를 고려했는지—커밋 메시지에 AI 세션 컨텍스트를 함께 남기지 않으면 6개월 뒤 팀원은 맥락 없는 코드 앞에 서게 됩니다.

제안된 커밋 구조는 단순합니다: 생성에 사용한 프롬프트의 의도, 주요 결정 이유, AI가 다루지 않은 엣지 케이스를 커밋 메시지에 포함시키는 것. 작은 습관이지만, AI-First 팀의 코드베이스 가독성을 장기적으로 지키는 핵심 프랙티스입니다.

시사점: 루프가 닫혔다, 이제 감독 설계가 남았다

네 가지 흐름을 한 줄로 정리하면 이렇습니다:

- 배포: MCP + 에이전트 → 인프라 자동화, 창 전환 없는 풀사이클 루프

- QA: LLM + Headless Browser → 자연어 기반 테스트 자동화

- 코드 리뷰: git hook + AI → 커밋 전 자동 품질/보안 게이트

- 컨텍스트 보존: 커밋 메시지에 AI 세션 기록 → 장기 유지보수 가능성 확보

이제 개발자의 역할은 코드를 직접 작성하는 것에서 에이전트가 올바른 결정을 내리도록 감독하고, 그 결정의 맥락을 보존하는 것으로 이동하고 있습니다. 루프는 닫혔습니다. 남은 건 그 루프 위에 어떤 감독 레이어를 설계하느냐입니다.

전망: AI-First 워크플로우의 다음 전선

한 개발자가 6개의 AI 에이전트로 36시간 안에 1만 5천 줄짜리 스트리밍 플랫폼을 프로덕션에 올렸다는 사례—이게 이미 일어나고 있는 일입니다. 속도는 더 빨라질 거예요. 하지만 속도가 빨라질수록 팀 차원에서 어디서 인간이 개입해야 하는가를 명확히 정의하지 않으면 컨텍스트 없는 코드, 검증 없는 배포, 맥락 없는 변경이 쌓이게 됩니다.

다음 전선은 '더 많은 자동화'가 아니라 '어떤 결정은 반드시 인간이 내려야 하는가'를 설계하는 것입니다. AI가 풀사이클을 돌리기 시작한 지금, 테크 리드의 진짜 역할이 거기에 있습니다.