'정확도 0.9996 vs 0.9995'—이 차이가 정말 중요한가요?

dev.to에 올라온 CPU 환경 8개 ML 모델 벤치마크를 보면 흥미로운 숫자가 등장합니다. 신용카드 사기 탐지 데이터셋에서 CatBoost와 RandomForest의 정확도 차이는 0.0001입니다. 통계적으로 유의미한 차이냐고요? 3-Fold CV로는 판단하기 어렵습니다. 그런데 레이턴시는 다릅니다. RandomForest P95가 25ms, SmartKNN이 0.31ms—무려 80배 차이입니다. 정확도 숫자는 사실상 동일한데, 운영 비용은 80배 벌어집니다. 이게 바로 '벤치마크가 프로덕션에서 거짓말하는' 첫 번째 방식입니다.

숫자 자체가 아니라 '무엇을 측정했는가'가 문제다

해당 벤치마크의 실험 설계는 나름 엄격합니다. 동일한 전처리, 하이퍼파라미터 튜닝 없음, CPU 전용, P95 레이턴시 측정. 그러나 여기서 반드시 던져야 할 질문이 있습니다. 샘플 사이즈가 충분한가요? 3-Fold CV는 분산 추정에 한계가 있습니다. Adult, Santander, Fraud Detection 데이터셋은 공개 벤치마크 데이터—여러분의 프로덕션 데이터 분포와 얼마나 가깝습니까? 더 중요하게는, 단일 추론 P95를 측정했지만 배치 추론, 동시 요청, 메모리 압박 상황에서의 레이턴시는 측정하지 않았습니다. 실제 운영 환경에서도 이 숫자가 나올까요? 그건 별개의 실험입니다.

벤치마크와 프로덕션 사이의 간극: scikit-learn 사례

scikit-learn 프로덕션 배포 사례는 이 간극을 더 구체적으로 보여줍니다. 크립토 결제 게이트웨이의 트랜잭션 리스크 스코어링 시스템—요구 조건은 레이턴시 50ms 이하, 초당 1,000 요청 처리, 주간 무중단 모델 업데이트입니다. Gradient Boosting이 AUC 0.96으로 최고 성능을 냈고 P95 레이턴시는 1.8ms로 예산 내에 들어왔습니다. 여기까지는 벤치마크와 프로덕션이 일치하는 것처럼 보입니다.

그런데 진짜 문제는 여기서 시작됩니다. 데이터셋 불균형—정상 거래 99%, 사기 거래 1%. 이 상황에서 accuracy는 완전히 의미 없는 지표입니다. 99%짜리 더미 모델도 accuracy 0.99를 찍습니다. 이 사례가 올바르게 접근한 부분은 Precision-Recall curve를 사용해 Recall 90% 기준 최적 임계값을 찾은 것입니다. ROC-AUC도 중요하지만, 극단적 불균형 데이터에서는 PR-AUC가 더 의미 있는 지표입니다. 벤치마크 리더보드가 accuracy나 ROC-AUC만 보여줄 때, 이 맥락을 놓치면 프로덕션에서 반드시 터집니다.

문서 추출 벤치마크: 9~50배 차이의 진짜 의미

Kreuzberg vs Unstructured.io 비교는 또 다른 각도를 보여줍니다. RAG 파이프라인용 문서 추출에서 Rust 네이티브 엔진이 Python 기반 대비 9~50배 처리량 차이를 냈다고 주장합니다. 숫자가 인상적입니다. 그러나 '근거는 있나요?'를 먼저 물어야 합니다.

이 벤치마크에서 주목할 점은 투명성입니다. 재현 가능한 테스트, 실제 워크로드 데이터셋(PDF·Office 문서·이미지·다국어 텍스트), 라이브 대시보드 제공. 방법론적으로 검토할 부분은 있지만—벤치마크 발행 주체가 Kreuzberg 팀이라는 점은 명백한 이해충돌입니다—데이터 타입별로 편차가 크다는 사실 자체는 중요한 시사점을 줍니다. 깨끗한 텍스트 PDF에서는 대부분 >95% 성공률을 보이지만, OCR이 필요한 스캔 문서나 복잡한 레이아웃에서는 구조화 추출 성공률이 10~30%p 하락합니다. 이건 상황에 따라 다르다는 뜻이고, '9~50배 빠르다'는 단일 숫자로 프로덕션 결정을 내리면 안 된다는 뜻입니다. 여러분의 실제 문서 분포로 테스트하지 않는 한, 그 숫자는 그저 숫자입니다.

AI 에이전트 평가의 딜레마: 확률적 출력을 어떻게 측정하나

벤치마크 문제는 전통적인 ML 모델에서 끝나지 않습니다. AI 에이전트 자동화 평가 프레임워크가 다루는 LLM 기반 에이전트는 동일한 입력에도 출력이 달라지는 확률적 시스템입니다. TF-IDF 기반 코사인 유사도로 응답을 평가하는 접근법은 구현이 간단하지만, 시맨틱 동치(semantic equivalence)를 완전히 포착하지 못합니다. '환불은 3~5 영업일 소요됩니다'와 '환불 처리에는 3에서 5 영업일이 걸립니다'는 의미상 동일하지만 표면적 표현이 다릅니다.

더 근본적인 문제는 무엇을 측정하는가입니다. 응답 정확도? 태스크 완료율? 규정 준수? 각 지표는 서로 다른 실패 모드를 잡아냅니다. 고객 지원 봇이 정확한 정보를 주면서 공격적인 톤을 사용한다면—정확도는 높고 사용자 만족도는 낮습니다. 이건 단일 메트릭으로 포착할 수 없는 문제입니다. 에이전트 평가에서 가장 위험한 것은 '시나리오 테스트를 통과했으니 프로덕션에서도 괜찮다'는 착각입니다. 이건 correlation이지 causation이 아닙니다.

프로덕션 현실에서 벤치마크를 올바르게 읽는 법

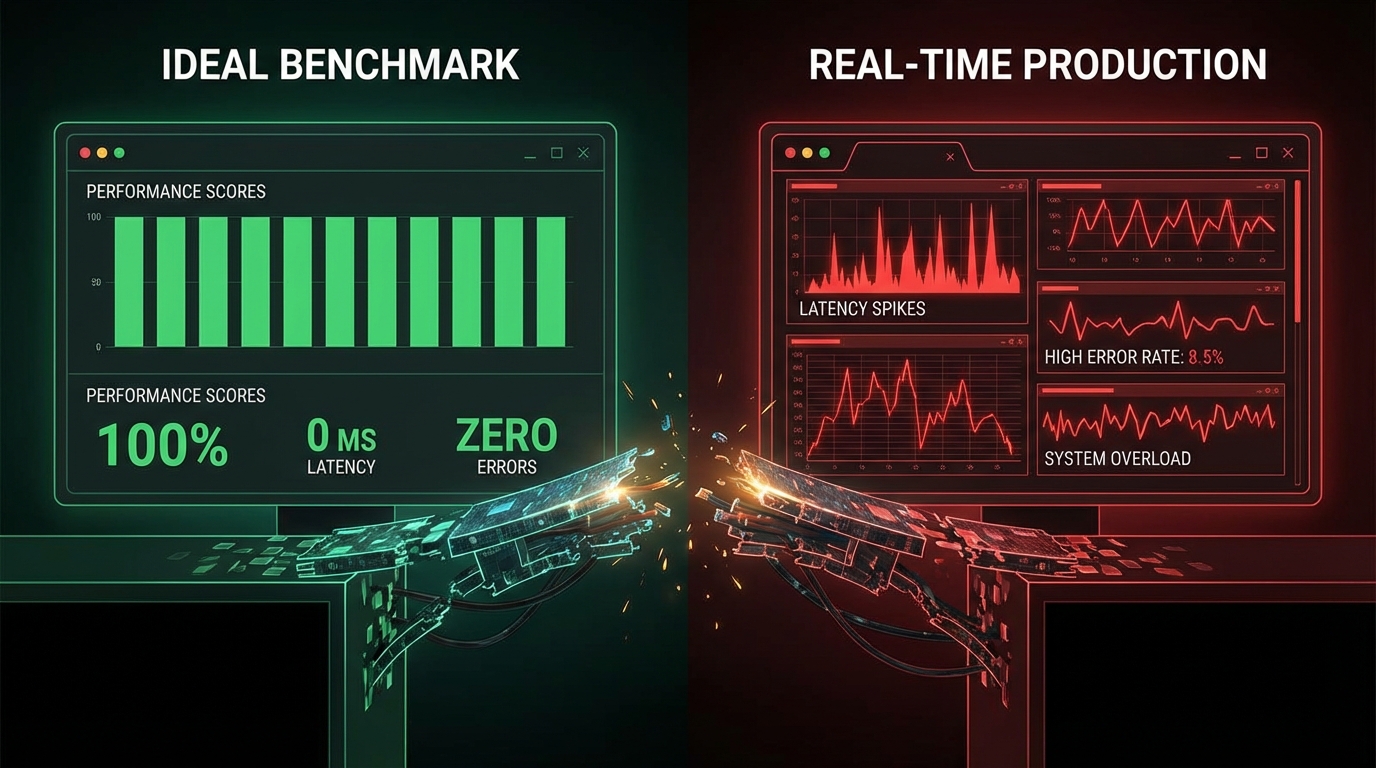

네 가지 소스를 관통하는 공통 패턴이 있습니다. 벤치마크 숫자가 프로덕션에서 거짓말하는 방식은 대략 세 가지입니다.

첫째, 측정 조건의 이상화. CPU 벤치마크는 단일 추론을 측정했지만, 프로덕션은 동시 요청·메모리 경쟁·네트워크 지연이 복합됩니다. 문서 추출 벤치마크는 I/O와 네트워크를 격리했지만, 실제 파이프라인은 그렇지 않습니다.

둘째, 데이터 분포의 불일치. 공개 벤치마크 데이터셋은 '쉬운' 케이스에 편향되어 있을 가능성이 높습니다. OCR 복잡 문서에서 30%p 하락, 불균형 데이터에서 accuracy 무의미—이건 예외가 아니라 규칙입니다.

셋째, 단일 지표의 함정. 정확도 0.0001 차이에 집중하면 80배 레이턴시 격차를 놓칩니다. AUC에 집중하면 Recall을 놓칩니다. 처리량에 집중하면 추출 품질 하락을 놓칩니다.

scikit-learn 배포 사례가 보여준 올바른 접근법은 명확합니다. 요구 조건을 먼저 정의하고(50ms 레이턴시, 1,000 RPS, 90% Recall), 그 조건에 맞는 지표를 측정하고, 임계값을 명시적으로 설정합니다. Ablation study처럼 각 구성 요소의 기여도를 분리하고—여기서는 Pipeline에 전처리를 포함시켜 직렬화하는 설계가 프로덕션 불일치를 방지합니다.

시사점: 벤치마크를 어떻게 써야 하는가

벤치마크 숫자를 버려야 한다는 뜻이 아닙니다. 올바르게 읽어야 한다는 뜻입니다. 실전에서 체크해야 할 질문들입니다.

- 베이스라인 대비 개선폭은? 절대 수치보다 상대적 향상이 중요합니다.

- 내 데이터 분포에서도 이 숫자가 나오는가? 벤치마크 데이터셋과 프로덕션 데이터의 분포 차이를 측정하세요.

- 어떤 실패 모드가 측정되지 않았는가? 벤치마크가 격리한 조건이 실제로 격리 가능한지 검토하세요.

- 재현 가능한가? 코드와 데이터와 환경이 공개되지 않은 벤치마크는 절반만 믿으세요.

- 누가 측정했는가? 이해충돌 여부를 반드시 확인하세요.

모델 선택은 리더보드 순위가 아닙니다. RandomForest가 정확도에서 CatBoost와 0.0001 차이인데 레이턴시가 80배 느리다면, 대부분의 프로덕션 시스템에서 정답은 CatBoost입니다. 엔지니어링은 제약 최적화입니다—벤치마크는 그 최적화를 위한 하나의 데이터 포인트일 뿐, 결론이 아닙니다.