병목은 드라마틱하게 터지지 않는다

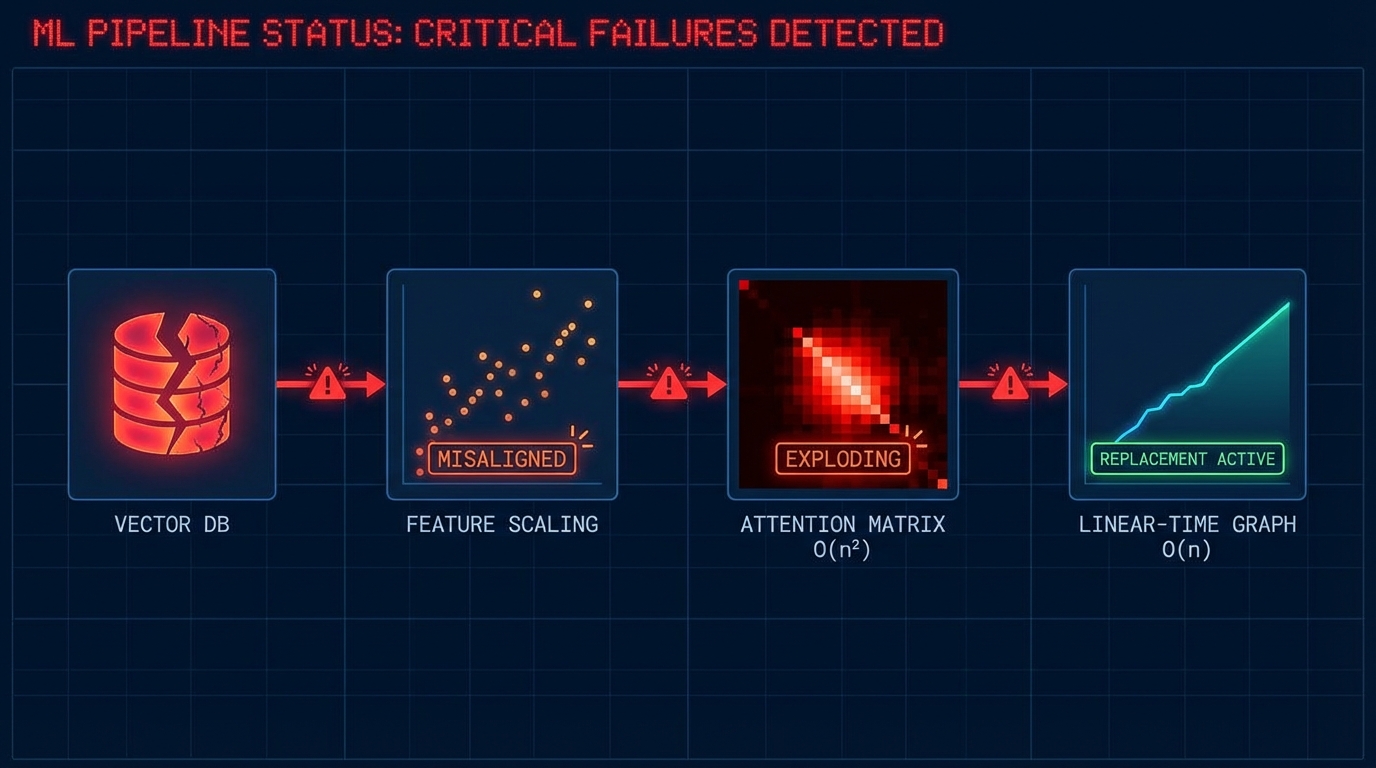

프로덕션 ML 시스템이 무너질 때, 대부분의 팀은 모델 자체를 의심한다. 하이퍼파라미터를 다시 튜닝하고, 더 큰 모델로 교체하고, 클라우드 인스턴스를 업그레이드한다. 그런데 실제 원인은 훨씬 앞 단계에 있다. 데이터 파이프라인, 피처 스케일링, 그리고 아키텍처 연산 복잡도—이 세 층위에서 조용히, 그리고 측정 가능한 방식으로 병목이 발생한다.

오늘은 최근 공개된 네 가지 분석을 교차하며, '왜 죽는가'가 아니라 '어디서 병목이 발생하고 어떻게 수치로 잡아내는가'를 해부한다.

병목 1: 벡터 DB 안에 쌓이는 쓰레기 — 청크와 임베딩 드리프트

dev.to에 올라온 RAG 프로덕션 실패 분석에서 가장 눈에 띈 숫자는 0.857이다. 레이어별 정확도가 각각 95%라고 가정할 때, 리트리벌 × 리랭킹 × 생성 단계를 곱하면 전체 성공률은 85.7%로 떨어진다. 쿼리 여섯 번 중 한 번은 실패한다는 뜻이다. 데모에서는 절대 포착되지 않는 숫자다.

이 실패의 80%는 청크 경계 파괴에서 시작된다고 해당 분석은 주장한다. 2025년 CDC Policy RAG 연구를 인용하면, 고정 크기(512토큰) 청킹의 Faithfulness Score는 0.47~0.51인 반면, 의미 단위 최적화 청킹은 0.79~0.82를 기록했다. 같은 문서, 같은 모델, 다른 청킹 전략만으로 Faithfulness가 약 60% 개선된다. 이 수치, 근거는 있는가? 단일 도메인(정책 문서) 실험이라는 점에서 일반화에는 주의가 필요하지만, 방향성 자체는 충분히 설득력이 있다.

더 교활한 병목은 임베딩 드리프트다. 지식베이스를 한 번 임베딩하고 6개월 방치하면 어떻게 될까. 코사인 유사도 기반 드리프트 공식으로 시뮬레이션하면, 월 1~2%씩 누적되어 6개월 후 Drift(t) ≈ 0.076 수준에 도달한다. 리트리벌 품질이 조용히 떨어지는 동안 어떤 에러 로그도 뜨지 않는다. 이건 모니터링 지표에 임베딩 유사도 분포를 반드시 포함해야 하는 이유다. PSI(Population Stability Index)나 주기적 코사인 분포 검사를 파이프라인에 심어두지 않으면, 모델 성능 하락을 데이터 드리프트가 아닌 모델 문제로 오인하게 된다.

병목 2: 정규화 누락 — 같은 데이터, 반대 예측

dev.to의 데이터 정규화 크래시 시나리오는 수치로 설명하는 방식이 명쾌하다. KNN, PCA, 신경망 세 알고리즘이 정규화 전후로 얼마나 달라지는지 보여준다.

이커머스 이탈 예측 데이터셋에서 Feature X₁(30일 지출액, ~$9,000대)과 X₂(30일 로그인 횟수, 1~18회)를 정규화 없이 KNN에 넣으면, 유클리드 거리 계산에서 X₁의 절댓값 차이가 X₂를 완전히 압도한다. 그 결과 직관과 반대되는 예측('Retained' → 'Churned')이 나온다. Min-Max 정규화 한 줄로 예측이 뒤집힌다. 같은 데이터, 같은 알고리즘, 정반대 결과다.

PCA는 더 조용하게 망가진다. Var(X₁) ≈ 21,875 대 Var(X₂) ≈ 54.7, 약 400배 차이로 인해 PCA는 X₁만으로 분산의 99.75%를 설명한다고 판단하고 X₂(로그인 빈도)를 그냥 버린다. 에러도, 경고도, 아무 알림도 없이. 만약 로그인 빈도가 이탈 예측의 핵심 피처라면, 모델의 성능 상한선은 학습 시작 전에 이미 인위적으로 낮아진 셈이다.

신경망에서는 Gradient Vanishing이 즉각 발생한다. 비정규화 입력값 9,500을 초기 가중치 0.01과 곱하면 z ≈ 95.18이 되고, Sigmoid(95.18) ≈ 1.000이 되어 그래디언트 σ'(z) = 0.000, 뉴런이 즉사한다. 정규화 후 z ≈ 0.02면 σ'(z) ≈ 0.25, 학습이 정상 작동한다. 하이퍼파라미터 튜닝 이전에 피처 스케일을 먼저 점검해야 하는 이유가 수식으로 증명된다.

병목 3: Softmax의 O(n²) 벽 — 아키텍처 연산 복잡도

데이터 파이프라인을 아무리 완벽하게 만들어도, 모델 아키텍처 자체에 병목이 내재되어 있다면 프로덕션 확장이 막힌다. Velog에 정리된 Performer 논문 리뷰("Rethinking Attention with Performers")는 이 문제를 정확히 짚는다.

표준 Transformer의 Self-Attention은 시퀀스 길이 n에 대해 O(n²) 시간 및 공간 복잡도를 가진다. 토큰 1만 개면 어텐션 계산이 1억 번 필요하다. 컨텍스트가 조금만 길어져도 GPU 메모리가 제곱으로 팽창하며 OOM이 발생한다. 이 벽은 RAG 컨텍스트 창을 128K~200K 토큰으로 늘리는 방향과 정면 충돌한다.

Performer가 제안한 FAVOR+(Fast Attention Via positive Orthogonal Random Features)는 Softmax 어텐션을 커널 근사(Kernel Approximation)로 대체해 선형 시간 O(n·d)으로 연산을 줄인다. 핵심 아이디어는 Q와 K를 분리 가능하도록 변환해 거대한 n×n 어텐션 행렬을 아예 만들지 않는 것이다. 논문 실험에서는 65,536 길이 시퀀스에서도 OOM 없이 학습을 완료했으며, 정확도 그래프가 기존 Transformer와 거의 완벽히 겹쳤다고 보고한다. 근사가 아니라 Unbiased Estimation이기 때문에 성능 하락이 없다는 주장이다. 재현 가능성과 다른 도메인에서의 일반화 성능은 여전히 검증이 필요하지만, 방향성은 명확하다.

MS OPCD: 시스템 프롬프트를 파라미터 안으로

AI타임스가 보도한 Microsoft의 OPCD(On-Policy Context Distillation) 프레임워크는 또 다른 병목—추론 시 반복되는 긴 시스템 프롬프트 비용—을 정면으로 겨냥한다.

기업 LLM 배포에서 수천~수만 토큰짜리 시스템 프롬프트는 매 쿼리마다 처리되며 latency와 비용을 직접 증가시킨다. OPCD는 이 프롬프트를 모델 파라미터 안에 내재화하는 '교사-학생' 구조를 사용한다. 특히 기존 오프-폴리시 방식의 노출 편향(Exposure Bias) 문제를 해결하기 위해 역방향 KL 발산(Reverse KL Divergence) 최소화와 학생 모델 자체 생성 궤적 기반 학습을 도입했다.

수치 결과가 흥미롭다. 8B 파라미터 모델의 수학 문제 정확도가 75.0% → 80.9%(+5.9%p), 1.7B 소형 모델의 Frozen Lake 내비게이션 성공률이 6.3% → 38.3%(+32%p), 3B Llama 모델의 안전·유해성 분류 정확도가 30.7% → 83.1%(+52.4%p)로 상승했다. 베이스라인이 워낙 낮은 케이스들이라 절대 수치 해석에 주의가 필요하다. 30.7%→83.1%는 인상적이지만, 30.7%짜리 베이스라인이 어떤 세팅이었는지 맥락 확인이 선행되어야 한다.

한편 OPCD는 파국적 망각(Catastrophic Forgetting)에서 오프-폴리시 대비 약 4%p 높은 범용 성능을 유지했다. 연구진도 명시하듯, 자주 변하는 대규모 DB에는 여전히 RAG가 적합하다. OPCD는 고정된 지식·정책·행동 지침에 특화된 보완재다.

측정하지 않으면 보이지 않는다: 통합 진단 관점

네 가지 분석을 교차하면 프로덕션 ML 병목의 구조가 보인다.

| 병목 레이어 | 증상 | 측정 지표 |

|---|---|---|

| 청크 품질 | 환각 증가, Faithfulness 하락 | Faithfulness Score, 청크 경계 감사 |

| 임베딩 드리프트 | 리트리벌 품질 무성 하락 | 코사인 유사도 분포, PSI |

| 피처 스케일 | 예측 반전, Gradient Vanishing | 피처 분산 비율, 그래디언트 노름 |

| 어텐션 복잡도 | OOM, 긴 컨텍스트 처리 불가 | GPU 메모리 사용량, 처리 시간 vs n |

| 시스템 프롬프트 비용 | 추론 latency, 쿼리당 비용 상승 | TTFT, 토큰 처리량, 추론 비용 |

공통점이 있다. 이 병목들은 모두 조용히 발생하고, 모니터링 지표를 명시적으로 설계하지 않으면 감지되지 않는다. Faithfulness Score를 파이프라인에 심지 않으면 청크 품질 하락을 모른다. 임베딩 분포 모니터링이 없으면 드리프트를 6개월 후에야 안다. 피처 분산 비율을 체크하지 않으면 PCA가 핵심 피처를 조용히 버리는 걸 모른다.

시사점: '잘 돌아가는 모델'에서 '측정 가능한 시스템'으로

이 글에서 다룬 분석들이 공유하는 메시지는 하나다. 프로덕션 ML의 진짜 과제는 모델 성능 개선이 아니라 병목 측정 체계 구축이다.

청크 품질은 Faithfulness Score로, 임베딩 안정성은 코사인 분포 모니터링으로, 피처 전처리는 학습 전 분산 비율 감사로, 아키텍처 병목은 시퀀스 길이별 메모리 프로파일링으로 측정할 수 있다. 측정 지표가 없는 곳에서의 튜닝은 블랙박스 안을 더듬는 것과 다르지 않다.

Performer의 FAVOR+가 수학적으로 우아한 이유도 같은 맥락이다. 근사치로 속도를 높이는 것이 아니라, 불편 추정(Unbiased Estimation)으로 정확도를 유지하면서 복잡도를 O(n)으로 낮췄다는 점—즉 trade-off를 수식으로 명시하고 증명했다는 점이 핵심이다. 프로덕션에서 '왜 느려졌는가'를 대답하려면 먼저 복잡도가 어디서 제곱으로 증가하는지를 알아야 한다.

전망: 측정 가능한 파이프라인이 경쟁력이 된다

2025~2026년 RAG 아키텍처의 분기(CAG·Agentic RAG·Distilled RAG)와 OPCD 같은 파라미터 내재화 접근법의 등장은, 결국 '어떤 지식을 어떤 층위에서 관리할 것인가'라는 설계 판단으로 수렴한다. 자주 바뀌는 지식은 리트리벌로, 고정된 정책·행동 지침은 파라미터 내재화로, 긴 컨텍스트는 아키텍처 효율화로—각 병목에 맞는 측정 지표와 해결 전략이 달라야 한다.

모델 아키텍처가 아무리 정교해져도, 데이터 파이프라인의 품질과 피처 전처리의 정확성이 받쳐주지 않으면 프로덕션 성능은 무너진다. 이건 correlation이 아니라 causation이다. 그리고 그 인과관계는 수치로 측정할 수 있다.