결론부터 말할게요. CSS 한 줄 바꿨다고 Safari에서 체크아웃 버튼이 3mm 밀려나 있는 걸, QA도 못 잡고 프로덕션 배포까지 나가버린 경험—한 번쯤 있죠? 저는 그 버튼 하나 때문에 새벽 두 시에 핫픽스 PR 올린 적 있습니다. 그 순간 머릿속에 가장 먼저 든 생각은 "비주얼 리그레션 테스트가 있었으면..."이었어요. 근데 막상 도입하려니 Puppeteer 세팅부터 baseline 관리, CI 불안정성까지—배보다 배꼽이 더 커지는 상황이 펼쳐지죠.

비주얼 버그는 왜 이렇게 잘 새어나갈까요

수동 QA는 솔직히 한계가 명확해요. 사람 눈은 2px 차이를 다크모드 + 모바일 Safari 조합에서 일관되게 잡아낼 수 없거든요. 게다가 배포 주기가 빨라지면 QA 자체가 병목이 됩니다. 그렇다고 Puppeteer 기반 자동화를 붙이면? 타이밍 이슈, 폰트 렌더링 차이, 네트워크 지연으로 인한 false positive가 쏟아지고, 결국 팀에서 '테스트가 또 틀렸네' 하며 무시하는 문화가 생기죠. 이게 진짜 무서운 거예요. 테스트 신뢰도가 떨어지면 테스트 자체가 없는 것만 못합니다.

API 캡처 + pixelmatch 조합, 생각보다 실용적입니다

dev.to 기사에서 소개된 PageBolt + pixelmatch 패턴은 아키텍처 자체가 깔끔해요. 브라우저 인프라 관리는 PageBolt가, 픽셀 비교 로직은 순수 Node.js 기반 pixelmatch가 각자 담당하는 구조입니다. Figma에서 볼 때는 괜찮았는데 실제 구현하면 달라지는 그 갭—이걸 잡아주는 게 바로 픽셀 단위 diff 이미지거든요. threshold: 0.1 설정으로 렌더링 노이즈는 걸러내고, diff 비율이 0.5%를 넘으면 CI를 실패시키는 로직은 실무에서 바로 가져다 쓸 수 있는 수준입니다.

특히 GitHub Actions 워크플로우를 보면 PR마다 스테이징 배포 → 스크린샷 캡처 → pixelmatch 비교 → diff 이미지 아티팩트 업로드 → PR 코멘트까지 전체 파이프라인이 추가 CI 시간 15초 안에 돌아가요. iphone_14_pro, macbook_pro_14 두 디바이스 커버리지를 동시에, 인프라 한 줄 안 건드리고요. Puppeteer 셀프호스팅이라면 EC2 비용 월 $100~300에 유지보수 8~10시간이 더 들어가는 걸 생각하면, $29짜리 스타터 플랜은 솔직히 고민할 이유가 없어 보입니다.

그런데 이게 왜 'UX 연속성' 얘기까지 이어지냐고요?

조금 각도를 바꿔볼게요. 비주얼 리그레션 테스팅의 핵심은 결국 사용자가 어제 봤던 화면과 오늘 보는 화면 사이의 일관성을 지키는 거잖아요. 버튼이 갑자기 3px 내려가 있거나, 카드 컴포넌트 그림자가 사라지거나, 다크모드에서 텍스트 대비가 흐릿해지는 순간—사용자 입장에서는 '이 서비스 뭔가 이상한데?' 하는 불신이 생깁니다. WCAG 기준 대비 비율 4.5:1도 한 번의 배포로 무너질 수 있고, 접근성 이슈는 Lighthouse 점수에 즉각 반영되죠.

Anthropic이 건드린 것도 같은 문제입니다

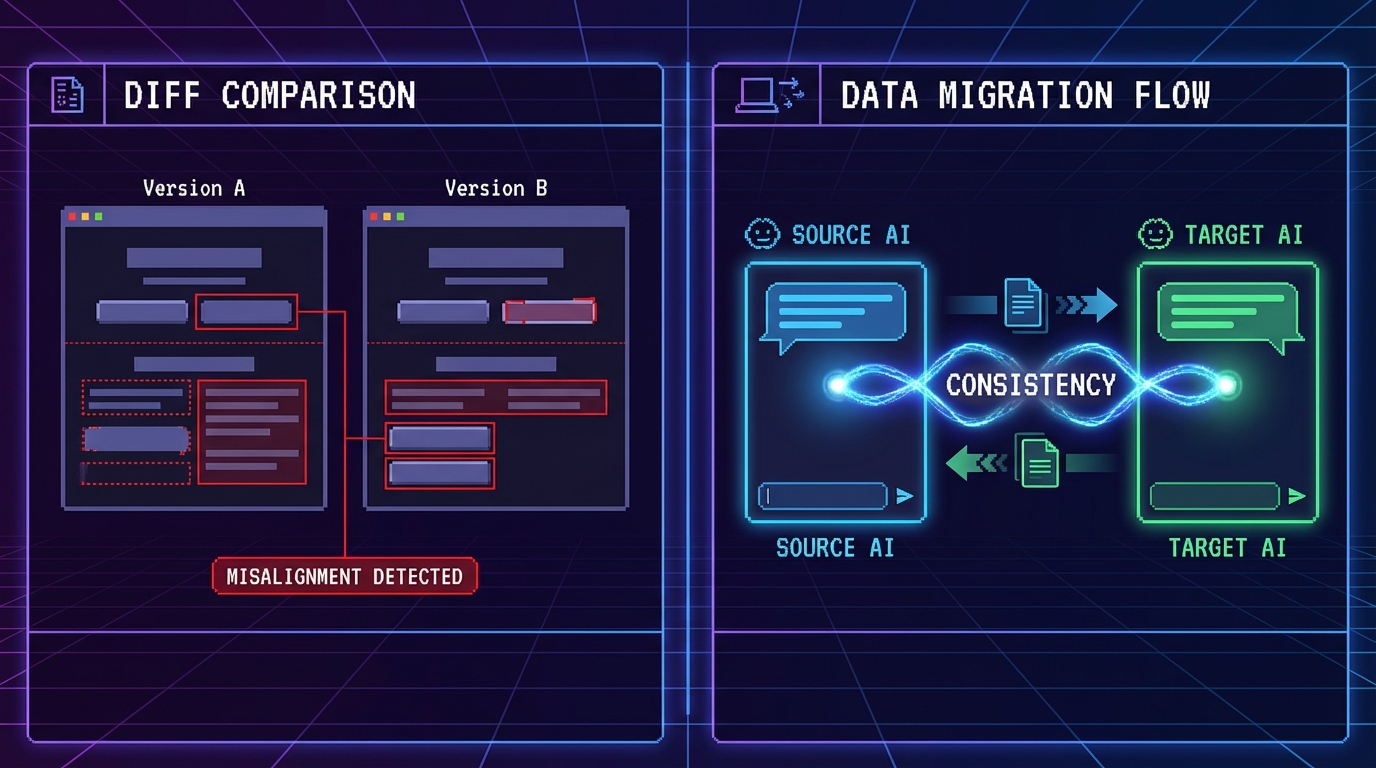

Anthropicが 출시한 메모리 마이그레이션 도구(geeknews, 민심뉴스 보도)는 언뜻 AI 경쟁 마케팅처럼 보이지만, 프론트엔드 관점에서 보면 전혀 다른 레이어의 UX 연속성 문제를 다루고 있어요. ChatGPT에서 Claude로 전환할 때 '처음부터 다시 나를 설명해야 한다'는 경험—이건 사용자 여정(Journey)의 단절이에요. 온보딩 플로우에서 컨텍스트가 초기화되는 순간, 유저 이탈률이 튀는 건 어떤 서비스든 마찬가지입니다.

복사-붙여넣기 한 번으로 기존 맥락을 Claude 메모리에 이식한다는 발상은, 서비스 전환 경험에서 가장 큰 UX 장벽인 '학습 비용'을 제거하는 인터랙션 설계예요. Hacker News 코멘트를 보면 반응이 엇갈리긴 합니다—컨텍스트 오염을 우려하는 쪽도 있고, "계정 전체 메모리 없이는 LLM을 제대로 쓸 수 없다"는 쪽도 있어요. 이 양극단이 공존하는 건, 결국 메모리 기능의 투명성과 사용자 제어권 설계가 아직 최적점을 못 찾았다는 신호입니다. '내가 기억하는 것을 직접 보고 수정할 수 있다'는 Claude의 설계 방향은, UX 원칙으로 보면 맞는 방향이에요.

디자인 일관성과 맥락 연속성, 같은 뿌리입니다

비주얼 리그레션 테스팅과 AI 메모리 마이그레이션—두 이슈를 나란히 놓으면 공통점이 보여요. 둘 다 사용자가 기대하는 상태와 실제 제공되는 상태 사이의 갭을 최소화하는 문제입니다. 픽셀 단위로 diff를 잡아내는 테스트 파이프라인이나, 이전 AI 서비스의 맥락을 끊김 없이 이식하는 마이그레이션 도구나—사용자 입장에서는 '내가 쓰던 그 서비스가 맞네'라는 신뢰를 유지시켜 주는 장치예요.

프론트엔드 팀이 비주얼 리그레션을 무시하면 1px 차이가 전환율을 갉아먹고, 서비스가 메모리 연속성을 제공하지 않으면 사용자는 전환 비용을 치르고 이탈합니다. 두 경우 모두 신뢰가 무너지는 지점은 놀랍도록 닮아 있어요.

지금 당장 해볼 수 있는 것들

비주얼 리그레션 테스팅 도입을 미루고 있다면, PageBolt 무료 티어(월 100 요청, 카드 불필요)로 체크아웃 페이지 한 곳만 먼저 잡아보세요. npm install pngjs pixelmatch에 GitHub Actions 워크플로우 15분이면 첫 번째 diff 이미지를 PR에서 볼 수 있습니다. 번들 사이즈 걱정도 없어요—pixelmatch는 순수 Node.js라 CI 환경 어디서든 돌아갑니다.

단, 한 가지 주의할 점. baseline 업데이트 전략을 팀에서 먼저 합의해야 해요. 디자인 토큰이 바뀌거나 컴포넌트 라이브러리 버전이 올라가면, 50개 baseline 스크린샷을 일괄 갱신해야 하는데—이 타이밍을 놓치면 false positive가 쏟아지고, 다시 '이 테스트 믿을 수 없어' 문화로 회귀합니다. 테스트 코드보다 테스트 문화가 먼저예요.

전망: '일관성'이 품질 지표의 중심이 됩니다

Container Queries, :has() 선택자 같은 새로운 CSS 기능이 확산될수록, 컴포넌트가 컨텍스트에 따라 렌더링을 달리하는 경우가 늘어납니다. 이건 비주얼 리그레션 테스트 케이스가 기하급수적으로 늘어난다는 뜻이기도 해요. 디바이스 매트릭스 × 다크모드 × 컨테이너 크기 조합—수동으로는 절대 커버할 수 없습니다.

AI 서비스 쪽도 마찬가지예요. LLM 경쟁이 성능 벤치마크를 넘어 '얼마나 끊김 없이 사용자 맥락을 이어가느냐'로 이동하고 있는 건, 결국 프론트엔드가 수십 년째 붙들고 있는 일관성 문제와 같은 전선입니다. 픽셀 하나, 맥락 한 줄—작은 갭이 신뢰를 무너뜨리기 전에 잡아내는 것, 그게 프론트엔드 품질의 본질이에요.