이번 주, 세 개의 숫자가 쏟아졌다

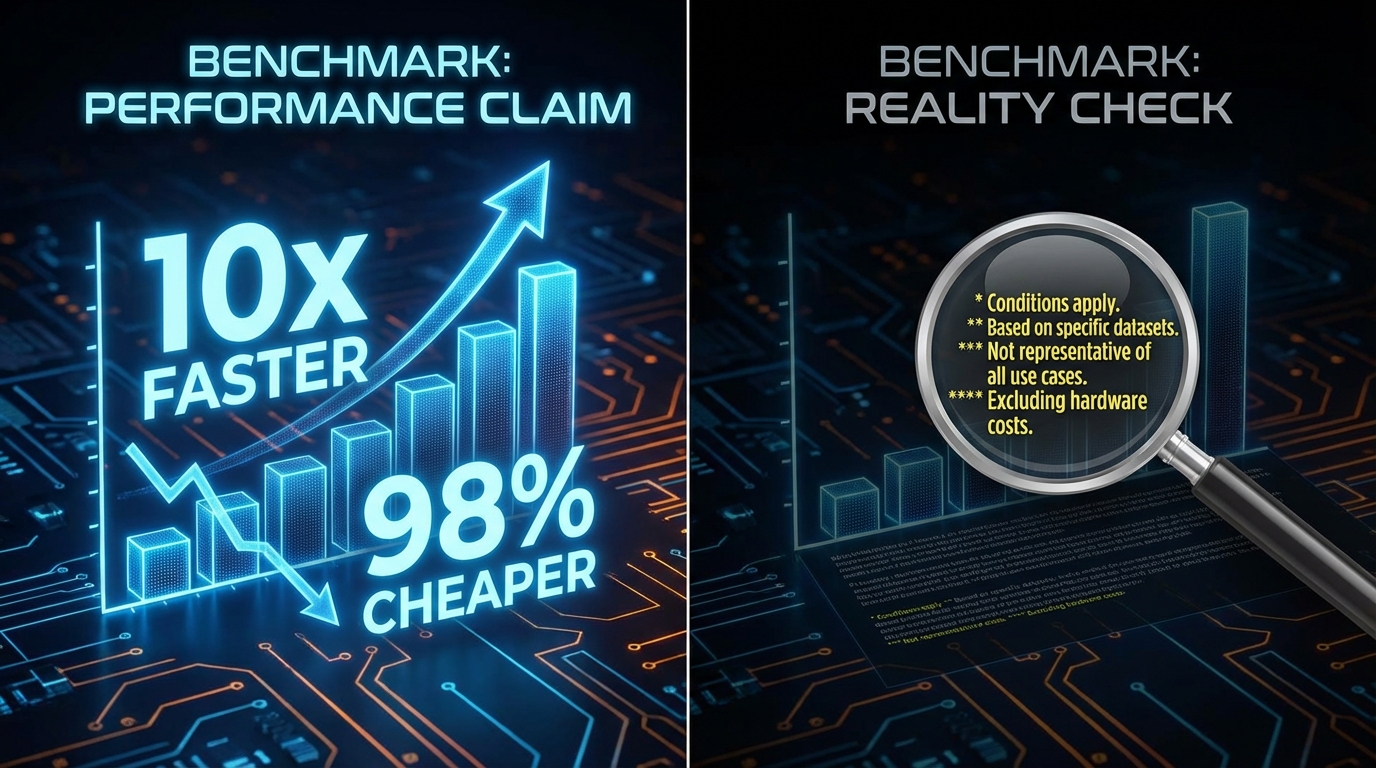

알리바바 Qwen3.5-9B가 13배 큰 모델을 이긴다. AWS S3 Vectors가 기존 벡터 DB 대비 98% 비용을 줄인다. 한국 스타트업 디노티시아의 VDPU가 경쟁사 대비 10배 빠르다. 일주일 사이에 AI 인프라 관련 벤치마크·비용 수치가 동시에 터졌다. 숫자는 인상적이다. 문제는 이 숫자들이 각자 전혀 다른 '조건의 감옥' 안에 갇혀 있다는 점이다.

Qwen3.5-9B의 '13배 큰 모델 능가' — 어느 벤치마크에서?

AI타임즈 보도에 따르면, 알리바바가 공개한 오픈소스 모델 Qwen3.5-9B는 OpenAI의 gpt-oss-120B를 GPQA Diamond(81.7 vs 80.1점)와 MMMLU 다국어 벤치마크에서 앞섰다. 매개변수 차이가 13배 이상임에도 효율성으로 우위를 점했다는 주장이다.

근거는 있다. 기술적 배경도 설득력이 있다. Gated Delta Networks(선형 어텐션 계열)와 MoE(희소 전문가 혼합)를 결합한 하이브리드 아키텍처는 메모리 병목을 줄이고 추론 지연을 낮추는 데 실제로 효과적인 접근이다. 멀티모달 토큰을 학습 초기부터 융합했다는 설계도 단순히 비전 인코더를 붙이는 방식보다 이론적으로 우위가 있다.

그러나 여기서 반드시 물어야 할 것이 있다. 어느 벤치마크에서 이겼는가? GPQA Diamond 81.7 vs 80.1은 1.6점 차이다. 이것이 통계적으로 유의미한 차이인지, 테스트셋 분포 차이에서 비롯된 노이즈인지 ablation study 없이는 알 수 없다. MMMU-Pro에서 70.1점으로 Gemini 2.5 Flash-Lite(59.7점)를 앞섰다는 수치는 인상적이지만, 이 벤치마크가 실제 프로덕션 태스크와 얼마나 상관관계(correlation)가 있는지는 별개의 문제다. 이건 correlation이지 causation이 아니다.

더 중요한 질문은 재현 가능성(reproducibility)이다. 가중치가 Apache 2.0으로 공개됐으니 독립적인 평가가 가능하다는 점은 긍정적이다. M1 맥북 에어에서 로컬 실행이 가능하다는 커뮤니티 반응도 실질적인 엣지 배포 가능성을 시사한다. 하지만 'M1 맥북에서 실행 가능'과 'M1 맥북에서 발표된 성능이 재현된다'는 전혀 다른 문장이다. 실제 디바이스 환경에서 latency와 throughput 측정값이 공개된 논문이나 기술 보고서가 없다면, 이 숫자는 아직 반쪽짜리다.

S3 Vectors의 98% 비용 절감 — 조건을 읽지 않으면 함정이다

dev.to의 기술 분석 포스트는 Amazon S3 Vectors를 사용할 경우 OpenSearch Serverless 대비 RAG 파이프라인 비용을 98% 줄일 수 있다고 주장한다. 구체적인 수치가 있다. OpenSearch Serverless는 쿼리가 없어도 4 OCU(2 인덱싱 + 2 검색) 최소 비용으로 월 ~$700이 발생한다. S3 Vectors는 동일한 dev/test 환경에서 ~$8로 운영 가능하다.

이 수치는 특정 조건에서 정확하다. 하지만 조건을 빼면 오해의 소지가 크다. 해당 포스트 자체에서도 명시하고 있듯이, S3 Vectors는 하이브리드 검색(벡터 + 키워드)을 지원하지 않는다. 쿼리 지연(latency)은 100~800ms로, OpenSearch Serverless의 10~100ms 대비 최대 8배 높다. 처리량(throughput)도 수백 QPS 수준으로 수천 QPS를 지원하는 OpenSearch와 비교가 되지 않는다.

98% 비용 절감은 dev/test 환경, 저빈도 내부 문서 검색, 자연어 질의 기반 시나리오에서만 성립한다. 고객 대면 실시간 챗봇, 상품 코드나 정책 번호 같은 정확 매칭이 필요한 케이스, 스테이징-프로덕션 동일 환경이 필요한 경우에는 OpenSearch가 여전히 적합하다. TCO 분석은 항상 워크로드 프로파일링이 선행되어야 한다. '98%'라는 숫자만 가져다 쓰면 프로덕션 전환 시 낭패를 본다.

dev.to의 AI 스케일링 비용 분석 기사가 지적하듯, 많은 팀이 프로토타입 단계를 벗어나는 순간 비용이 비선형적으로 증가한다는 사실을 간과한다. 인퍼런스 비용이 훈련 비용을 초과하는 시점이 반드시 온다. S3 Vectors는 그 사이클의 초기 단계—낮은 쿼리 빈도, 개발·검증 환경—에서 탁월한 선택이지만, '비용 절감 수치'를 프로덕션 계획에 그대로 대입하는 것은 금물이다.

VDPU의 '10배 속도, 80% TCO 절감' — 베이스라인이 어디인가

디일렉 보도에 따르면, 국내 AI 반도체 스타트업 디노티시아는 VDPU(데이터 연산 가속 반도체) 기반 스토리지 솔루션 '씨홀스'를 통해 경쟁사 대비 10배 높은 속도와 기존 대비 80% TCO 절감을 주장한다. RAG 파이프라인에서 발생하는 메모리 병목과 KV 캐시 관리 문제를 스토리지 계층에서 직접 처리한다는 아키텍처 발상 자체는 흥미롭다. GPU 기반 솔루션의 전력 소모 문제를 해결하는 방향으로, 엔비디아 ICMS 구조와 보완적인 포지션을 노린다는 전략도 합리적이다.

그런데 '경쟁사 대비 10배'와 '기존 대비 80% 절감'에서 가장 먼저 물어야 할 것이 있다. 베이스라인이 누구인가? 어떤 워크로드 조건에서 측정했는가? 벤치마크 데이터셋의 분포는 실제 운영 환경과 일치하는가? 실물 칩 없이 소프트웨어로만 2024년 매출 31.5억 원을 달성했다는 점은 실제 고객 검증이 어느 정도 이루어졌음을 시사하지만, 올 하반기 첫 번째 스토리지 제품 발표 예정이라는 일정을 감안하면 10배·80% 수치는 아직 시뮬레이션이나 내부 테스트 기반일 가능성이 높다.

스타트업의 기술 발표에서 성능 수치는 종종 최적 조건(best-case scenario)에서 측정된다. 프로덕션 환경에서의 다양한 쿼리 패턴, 데이터 드리프트, 동시 접속 부하 조건에서도 이 수치가 유지되는지가 진짜 질문이다. 실물 제품 출시 후 독립적인 third-party 벤치마크가 나올 때까지는 이 숫자를 '목표값'으로 읽는 것이 합리적이다.

세 수치가 공통으로 숨기는 것: 워크로드 조건과 비교 대상

Qwen3.5-9B의 벤치마크 우위, S3 Vectors의 98% 절감, VDPU의 10배 속도. 이 세 숫자는 각자 다른 맥락에서 나왔지만, 공통된 패턴을 갖는다. 수치가 성립하는 조건이 본문 안에 이미 제시되어 있지만, 헤드라인에는 조건이 없다.

9B가 120B를 이긴 것은 특정 벤치마크 2~3개에서이고, 전반적인 성능 분포나 Out-of-Distribution 일반화 성능은 아직 충분히 검증되지 않았다. 98% 비용 절감은 제로 트래픽에 가까운 dev/test 환경에서의 비교다. 10배 속도는 실물 칩이 아직 출시 전이다.

이것이 이 수치들이 '거짓'이라는 의미가 아니다. 조건 내에서는 정확하다. 문제는 숫자가 조건 없이 소비될 때 발생한다. ML 시스템을 설계하는 입장에서 이 수치를 활용하려면 반드시 선행해야 할 것들이 있다. 본인의 워크로드를 프로파일링하고, 해당 조건이 발표 환경과 얼마나 일치하는지를 먼저 검증해야 한다. Qwen3.5-9B를 도입하려면 자체 도메인 태스크에서 A/B 테스트를 설계하고 통계적 유의성을 확인해야 한다. S3 Vectors는 QPS와 latency SLA를 먼저 정의한 후 선택해야 한다. VDPU는 실물 제품 GA 이후 독립 벤치마크를 기다리는 것이 현명하다.

전망: '스몰 모델 + 스마트 인프라'의 트레이드오프는 구조화되고 있다

세 소스를 관통하는 더 큰 흐름은 하나다. AI 인프라의 경쟁 축이 '최대 성능'에서 '비용-성능 효율'로 이동하고 있다. Qwen3.5 Small 시리즈는 GPU 클러스터 없이 엣지에서 에이전트를 돌리려는 시도고, S3 Vectors는 벡터 DB의 최소 비용 진입 장벽을 사실상 제거했으며, VDPU는 GPU가 해결하지 못한 메모리-스토리지 병목을 전용 칩으로 가속하려는 접근이다.

이 방향성은 맞다. 그리고 dev.to의 AI 스케일링 비용 분석이 지적하듯, 2026년의 진짜 질문은 '이 모델을 만들 수 있나?'가 아니라 '이 모델을 감당할 수 있나?'다. 비용 민감도가 높아질수록 '조건부 우위'를 가진 솔루션들이 더 많이 등장할 것이고, 각 수치의 조건을 읽는 능력이 ML 엔지니어의 핵심 역량이 된다.

샘플 사이즈가 충분한지, 베이스라인이 공정한지, 프로덕션 환경에서도 이 성능이 재현되는지. 이 세 가지 질문을 잃지 않는 것이 지금 AI 인프라 홍수 속에서 올바른 의사결정을 내리는 유일한 방법이다.