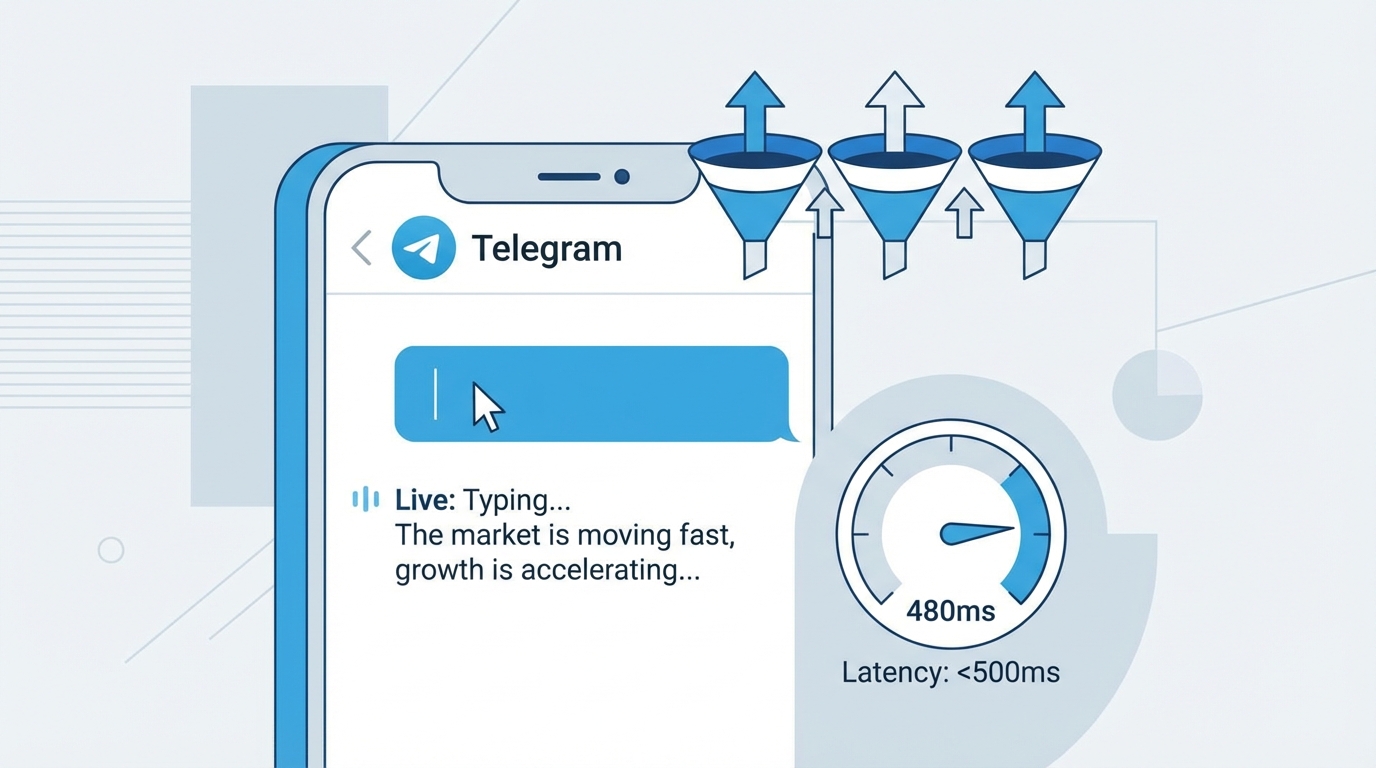

텔레그램이 Bot API 9.3+에서 챗봇의 스트리밍 응답(글자 단위 실시간 업데이트)을 지원하기 시작했습니다(geeknews가 x.com/durov 인용해 전함). 겉으로는 “답변이 빨리 보인다” 정도의 UX 업데이트지만, 그로스 관점에선 완전히 다릅니다. 저비용 메시징 채널이 즉시 ‘고효율 전환 퍼널’로 변신할 수 있는 트리거예요.

핵심은 대화형 UX에서 유저가 기다리는 시간을 견디는 방식입니다. 기존 메시지 단위 응답은 모델이 길어질수록 “아직인가?”가 커지고, 그 순간 이탈이 터집니다. 반면 스트리밍은 인지된 대기시간(perceived latency)을 깎습니다. 같은 5초가 걸려도, 0.2초 만에 첫 글자가 나오면 유저는 “작동한다”를 확신하거든요. 이거… Activation이 오를 것 같은데?

여기에 geeknews에 함께 소개된 사례—500ms 이하 지연의 음성 에이전트를 직접 구축한 글(ntik.me)—을 붙이면 더 선명해집니다. 그 글의 메시지는 단순히 “빠른 모델을 써라”가 아니라, STT→LLM→TTS를 스트리밍 파이프라인으로 오케스트레이션하고, TTFT(첫 토큰 시간)·지역 배치·WebSocket 워밍풀 같은 병목을 직접 깎아 첫 반응을 500ms 안에 넣었다는 겁니다. 즉, 이제 ‘응답 속도’는 기술 지표가 아니라 전환을 움직이는 실험 변수가 됩니다.

그로스 해커 시선에서 가장 짜릿한 포인트는 이거예요. 텔레그램 봇은 원래도 CAC가 낮은 채널입니다(푸시 알림 대비 도달/열람이 강하고, 설치 장벽이 낮음). 그런데 스트리밍이 붙는 순간, 메시징 안에서 (1) 첫 경험의 마찰 제거 → (2) 유용함 체감 시간 단축 → (3) 다음 액션 유도가 훨씬 쉬워져요. 이건 AARRR로 치면 Acquisition은 그대로인데 Activation/Retention이 올라가 LTV가 뛰는 구조라서, 결과적으로 CAC 회수가 빨라집니다.

바로 테스트 가능한 가설로 바꿔보면: ① 첫 토큰/첫 글자까지의 시간(FTT)을 200ms/500ms/1s로 나눈 버전 A/B, ② 스트리밍 시작과 동시에 “제가 지금 처리 중인 단계” 같은 마이크로 프로그레스 메시지를 넣는 버전, ③ 답변 완성 전에 CTA를 먼저 노출(예: “원하면 템플릿으로 저장할까요?”)하는 버전. Conversion rate가 얼마나 오를까요? 제품군마다 다르겠지만, 체감상 대기 불안이 큰 시나리오(예약/상담/견적/고객지원)에서는 D1 활성화와 첫 전환이 유의미하게 튈 확률이 높습니다.

그리고 ‘음성’까지 확장하면 게임이 더 커집니다. 500ms 이하 응답은 단지 빠른 게 아니라, 유저가 대화를 턴테이킹이 자연스럽다고 느끼는 임계점에 접근합니다(ntik.me 글의 핵심도 결국 turn-taking). 텍스트 스트리밍(텔레그램)과 음성 저지연(에이전트)을 한 팀에서 같이 잡으면, “응답이 빠른 채널 = 전환이 잘 되는 채널”이라는 새로운 퍼널 공식을 만들 수 있어요. 이거 바이럴 될 것 같은데? 텔레그램은 공유/포워딩이 기본 UX라, “대답이 즉시 나오는 봇”은 추천/재방문을 동시에 먹습니다.

전망은 명확합니다. 스트리밍은 이제 AI UX의 기본값이 되고, 경쟁은 “정답률”보다 반응성·취소(barge-in)·중단 처리·지역 지연 최적화 같은 오케스트레이션으로 옮겨갑니다. 메시징 플랫폼이 스트리밍을 네이티브로 지원하기 시작한 지금, 팀이 해야 할 일은 하나예요. 빨리 테스트해봐야 돼! 텔레그램 봇에서 스트리밍을 켜고(가능하면 FTT 로깅까지), ‘응답 속도’를 Activation/Conversion의 레버로 설계해보세요. 성능 개선이 곧 성장으로 연결되는, 드물게 깔끔한 판이 열렸습니다.