AI 코딩 도구, 아직 '반쪽짜리'인 이유

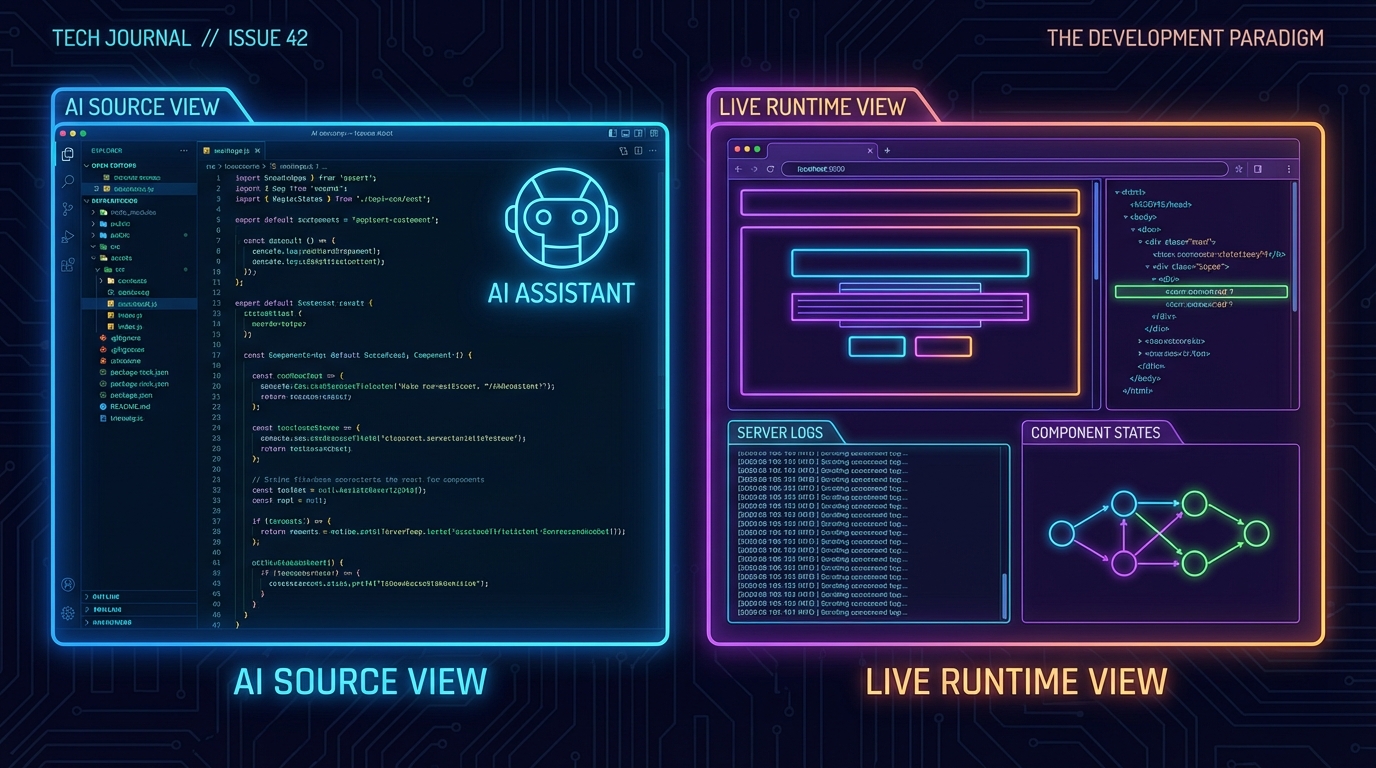

Cursor, GitHub Copilot, Claude Code를 팀에 도입하고 나서 가장 먼저 드는 의문이 있습니다. "왜 AI가 화면에 뭐가 뜨는지를 모르지?" 소스 파일은 다 줬는데, 실제 브라우저에서 렌더링된 컴포넌트 상태나 서버 로그는 AI가 전혀 보지 못합니다. 이게 2026년 현재 AI 코딩 도구의 첫 번째 구조적 한계입니다.

팀을 AI-First로 리빌딩하면서 저도 이 장벽을 계속 마주쳤는데요. 최근 커뮤니티에서 올라온 네 가지 사례를 엮어보니, AI 코딩 도구를 실전에서 제대로 쓰려면 해결해야 할 문제가 명확하게 보였습니다.

한계 1: AI는 런타임을 못 본다—'describe-check-fix 루프'의 늪

dev.to에 올라온 런타임 인식 도구 비교 글이 이 문제를 정확하게 짚었습니다. AI 코딩 도구는 소스 파일만 읽습니다. 렌더링된 DOM, 계산된 스타일, 클라이언트 레이아웃, 서버 미들웨어 상태—이 모든 게 AI에겐 '블랙박스'입니다. 결과적으로 팀은 AI가 수정 → 브라우저 확인 → 틀림 → 다시 설명 이라는 루프를 반복하게 됩니다.

이를 해결하려는 도구들이 등장하고 있습니다. Frontman은 Next.js·Astro·Vite 같은 프레임워크 미들웨어로 동작해 클라이언트와 서버 런타임을 동시에 MCP로 AI에 노출합니다. 브라우저에서 요소를 클릭하면 소스 파일과 라인까지 역추적해 수정하는 방식이죠. Stagewise는 YC S25 지원을 받은 브라우저 프록시 방식으로, React·Vue·Angular를 지원하고 기존 IDE 에이전트와 브리지 모드로 연동됩니다. Google의 Chrome DevTools MCP는 DevTools 상태를 MCP 도구로 노출하는 실험적 프로젝트이고, Elixir 생태계라면 Tidewave가 DB 쿼리·스택 트레이스·런타임 상태까지 AI에 파이핑합니다.

"이거 Claude한테 넘겨줄 때 런타임 컨텍스트가 없으면 AI가 절반은 추측으로 코드를 쓰는 거예요." 팀에 AI 코딩 도구를 도입할 때 런타임 인식 여부를 도구 선택 기준에 반드시 넣어야 하는 이유입니다.

한계 2: 세션이 끊기면 컨텍스트도 사라진다—Cursor 히스토리 동기화

두 번째 장벽은 멀티 디바이스 환경입니다. 노트북에서 Cursor로 작업하던 중 데스크톱으로 자리를 옮기면? 지금까지 AI와 나눴던 대화, 아키텍처 결정 맥락, 디버깅 실마리—전부 이전 머신에 묶여 있습니다. Cursor는 채팅 데이터를 클라우드가 아닌 로컬 SQLite DB에 저장하기 때문에 기본 동기화 기능이 없습니다.

dev.to에 소개된 cursaves는 이 문제를 CLI 하나로 해결합니다. cursaves push로 대화를 private git 저장소에 gzip 압축 JSON 스냅샷으로 저장하고, 다른 머신에서 cursaves pull로 복원합니다. 단순해 보이지만 내부 구현은 꽤 정교합니다—git remote URL로 프로젝트를 매칭하고, 파일 경로를 대상 머신 환경에 맞게 자동 재작성하며, SSH 원격 워크스페이스도 지원합니다.

"팀원들이 VM이나 SSH 환경에서 Cursor로 작업하는 경우에 컨텍스트 유실이 심각한데, 이걸 자동화하면 우리가 더 중요한 일에 집중할 수 있어요." 팀 워크플로우에 cursaves 같은 컨텍스트 동기화 레이어를 추가하는 것, 단순한 편의 기능이 아니라 AI 에이전트의 축적된 이해를 팀 자산으로 보존하는 인프라 결정입니다.

한계 3: AI가 해결한 지식은 세션이 끝나면 증발한다—CommonTrace

세 번째 문제는 더 근본적입니다. AI 에이전트가 새벽 2시에 까다로운 배포 이슈를 해결했습니다. 세션이 끝나면? 그 해법은 사라집니다. 다음 에이전트, 다른 프로젝트, 다른 팀원—같은 문제를 처음부터 다시 풉니다.

CommonTrace는 이 '집단 기억 소멸' 문제를 뇌과학에서 영감을 받은 아키텍처로 해결하려는 시도입니다. Claude Code 플러그인으로 동작하며, 에이전트가 에러를 해결하거나 아키텍처 결정을 내릴 때 그 지식을 공유 저장소에 기여합니다. 검색 알고리즘이 흥미로운데—유사도, 신뢰도, Ebbinghaus 망각 곡선 기반 감쇠, 맥락 일치도를 종합 스코어로 계산합니다. 여러 에이전트가 독립적으로 같은 해법을 발견하면 그게 강한 신뢰 신호가 되는 '수렴 감지' 로직도 있습니다.

빌더가 공유한 핵심 교훈이 인상적입니다. "로컬 저장소를 백과사전으로 만들려 했는데 그게 틀렸다. 로컬은 작업 메모리고, API가 백과사전이다." AI-First 팀을 설계할 때 에이전트의 학습을 팀 지식으로 어떻게 축적할지—이 질문에 CommonTrace는 하나의 실험적 답을 제시합니다.

한계 4: AI가 생성한 코드를 검증 없이 배포하면—실패 사례 해부

네 번째이자 가장 위험한 함정입니다. AI가 짜줬으니까 괜찮겠지—이 생각이 브로큰 코드 배포로 이어집니다. dev.to에 공개된 사례가 이를 날카롭게 보여줍니다. 개발자는 Claude.ai 대화를 수집하는 브라우저 익스텐션을 AI와 함께 만들어 배포했습니다. Ctrl+A로 전체 선택, Ctrl+C로 복사하면 익스텐션이 인터셉트하는 로직—논리적이고 깔끔해 보였습니다.

실제로는 사용자 메시지만 캡처했습니다. AI 응답, 아티팩트, 뷰포트 위 콘텐츠—전부 누락. Claude.ai는 React SPA에 가상 스크롤링을 쓰기 때문에 데이터가 DOM이 아닌 JavaScript 상태에 있었던 겁니다. 그리고 작성자는 이렇게 고백합니다. "나는 그걸 만들던 속도와 같은 속도로 리뷰했다."

"AI로 리뷰 받아보니까 이런 게 나오더라고요"라고 말하기 전에, AI가 생성한 코드를 인간이 얼마나 깊이 검증하고 있는지를 돌아봐야 합니다. 저자의 결론은 명확합니다. "생성이 싸졌다고 리뷰도 싸게 하면 안 된다. 'AI 코드를 거절한 사례와 이유'를 문서화하는 것이 팀 문화가 되어야 한다."

시사점: AI-First 워크플로우 설계의 4개 체크포인트

네 가지 사례를 종합하면, AI 코딩 도구를 실전에 투입할 때 팀이 반드시 설계해야 할 체크포인트가 보입니다.

① 런타임 컨텍스트: 도구 선택 시 AI가 소스만 보는지, 런타임까지 보는지 확인하세요. describe-check-fix 루프는 생산성을 잡아먹습니다.

② 컨텍스트 연속성: 멀티 디바이스·SSH 환경이라면 채팅 히스토리 동기화를 팀 인프라로 구성하세요. 축적된 AI 컨텍스트는 팀 자산입니다.

③ 지식 보존: 에이전트가 해결한 것들이 다음 세션에도 활용되는지 설계하세요. CommonTrace 같은 접근이 아직 초기지만, 이 방향의 고민은 지금 당장 시작해야 합니다.

④ 검증 의식: AI가 생성한 코드는 검증 없이 배포하지 않는 팀 문화를 만드세요. "AI가 짰으니까"는 면죄부가 아닙니다. 거절 사례를 문서화하고, 무엇을 캡처하지 못하는지를 먼저 묻는 습관이 핵심입니다.

전망: 도구는 빠르게 진화 중, 팀의 설계는 아직 뒤따르지 못하고 있다

런타임 인식 AI 도구 카테고리에 Google이 Chrome DevTools MCP로 진입했다는 것, 그리고 YC가 Stagewise에 투자했다는 것—이건 이 방향이 인프라가 된다는 신호입니다. AI 에이전트 간 지식 공유, 세션을 넘는 컨텍스트 연속성도 이미 개발자들이 직접 해결책을 만들고 있습니다.

하지만 도구가 아무리 빠르게 진화해도, 팀이 그 도구를 어떻게 워크플로우에 통합하느냐의 설계가 따라가지 못하면 효과는 반감됩니다. "AI가 생성해준 걸 기반으로 우리가 다듬는" 협업 모델—그 다듬는 과정의 깊이가 2026년 AI-First 팀의 실질적 경쟁력을 가릅니다. 기획 단계부터 AI를 끼는 것만큼, 배포 전 AI 생성물을 검증하는 습관을 팀에 심는 것도 테크 리드의 핵심 역할입니다.