'정확도 77% 달성.' 논문이나 블로그 포스트에서 이 문장을 보는 순간, 저는 반사적으로 두 가지를 묻게 됩니다. '베이스라인이 뭔가요?'와 '그 정확도, 실제 운영 환경에서도 재현되나요?' dev.to에 공개된 Student Dropout Analysis 사례는 Random Forest와 XGBoost를 활용해 학생 중도 탈락 예측에서 77% 이상의 분류 정확도를 보고합니다. 수치 자체는 나쁘지 않습니다. 하지만 이 숫자 하나로 모델을 배포하는 순간, 파이프라인 전반의 빈틈이 프로덕션에서 터지기 시작합니다.

이 사례가 흥미로운 건 성능 지표 때문이 아니라, 블랙박스 문제를 직접 인식하고 SHAP으로 해소하려 했다는 점입니다. 전 세계 대학교 중도 탈락률이 30~50%에 달하고, 동기 부족이 73.7%, 학업 성취 저하가 57.9%, 재정적 어려움이 31.6%의 사례에서 주요 원인으로 지목된 상황에서 단순히 '이 학생은 중도 탈락 위험군'이라는 예측만으론 충분하지 않습니다. 교육 담당자가 '왜 이 학생이 위험한가'를 알아야 개입이 가능하니까요. SHAP(Shapley Additive Explanations)은 GPA, 등록금 연체액 같은 각 피처가 최종 리스크 스코어에 기여한 한계적 기여분을 정량화합니다. 이건 단순한 시각화 도구가 아니라, 모델 해석 가능성(Interpretability)을 정책 개입의 근거로 전환하는 XAI 파이프라인입니다. Ablation study를 통해 어떤 피처가 실제로 예측력을 끌어올리는지 검증했는지는 별도로 확인이 필요하지만, 방향성 자체는 정확합니다.

그런데 여기서 반드시 짚고 넘어가야 할 질문이 있습니다. 이 데이터에는 어떤 편향이 있을까요? 사하라 이남 아프리카와 분쟁 지역의 젠더 격차가 언급되듯, 교육 데이터는 지역·경제·문화적 편향이 심하게 개입됩니다. 특정 지역 데이터로 학습된 모델을 다른 맥락에 배포할 때 distribution shift가 발생하고, 이는 F1-score 급락으로 이어집니다. 샘플 사이즈가 충분한가요? 학습·검증·테스트 셋의 분포가 실제 운영 환경과 일치하는가요? 이 질문들에 답하지 못한 채 배포 버튼을 누르는 건, 77%라는 숫자를 마케팅 수치로 소비하는 것과 다르지 않습니다.

전통적 ML의 '정확도' 집착은 GenAI 영역에서 더 심각한 문제를 낳습니다. 같은 dev.to의 GenAI 평가 프로덕션 가이드는 이 점을 정면으로 지적합니다. 생성형 AI에서 출력 공간은 사실상 무한합니다. 응답이 사실적으로 정확하지만 맥락에 부적절할 수 있고, 문장은 완벽하지만 완전히 환각(hallucination)일 수 있습니다. 단일 정확도 지표로는 이 복잡성을 잡을 수 없습니다.

이 가이드가 제안하는 다차원 평가 프레임워크는 네 축으로 구성됩니다. ① 정확성·근거(Grounding): RAG 시스템에서 응답이 검색된 문서에서 실제로 도출됐는지—'LLM-as-a-judge' 패턴으로 평가합니다. ② 운영 효율성: TTFT(Time to First Token), TPOT(Tokens Per Output Token), 요청당 비용을 추적합니다. ③ 신뢰성·안전성: 탈옥 시도 거부율, PII 마스킹 일관성을 측정합니다. ④ 사용자 정렬도: 클립보드 복사, 재시도 쿼리 부재 같은 행동 신호를 프록시로 활용합니다. 특히 주목할 부분은 복합 스코어링 시스템입니다. grounding 0.6, latency_score 0.2, cost_score 0.2의 가중치로 단일 헬스 스코어를 산출하는 방식은—가중치 설정 자체가 도메인 가정을 내포한다는 점에서—이 가중치가 왜 이렇게 설정됐는지 explainability가 필요합니다. 이건 correlation이지 causation이 아닙니다.

평가 아키텍처 측면에서 이 가이드의 핵심 통찰은 '평가를 추론 경로에서 분리하라'는 원칙입니다. 평가 서비스가 추론 경로와 병렬로 작동해야 하고, 평가 로직 업데이트가 핵심 애플리케이션 재배포를 트리거해선 안 됩니다. 그리고 'Evaluation Anti-pattern'으로 지목된 '분산 무시(Ignoring Variance)'는 실무에서 가장 자주 저지르는 실수입니다. 비결정론적 LLM 출력을 단일 샘플로 평가하는 건 통계적으로 무의미합니다. N=5 또는 N=10 반복 실행 후 평균내는 것이 최소한의 신뢰 구간 확보 방법입니다.

이 모든 평가 파이프라인이 의미 있으려면, 어떤 데이터로 무엇을 평가했는지를 재현 가능하게 추적하는 시스템이 먼저 갖춰져야 합니다. dev.to에 공개된 DataTracker 프로젝트는 이 문제를 정면으로 다룹니다. Git이 소스 코드를 위한 버전 관리를 제공하듯, 데이터셋에도 동일한 원칙이 필요합니다. DataTracker의 핵심 설계는 콘텐츠 주소 지정 저장(Content-Addressed Storage)입니다. 파일을 이름이 아니라 SHA-256 해시로 저장함으로써, 동일한 내용의 데이터셋은 자동으로 중복 제거(deduplication)됩니다. SQLite를 인덱스로 활용해 원자적 트랜잭션을 보장하는 방식은—Foreign Key를 기본 OFF로 두는 SQLite의 함정까지 명시적으로 언급한 점이 인상적입니다. 이 구조가 MLOps 파이프라인에 주는 시사점은 명확합니다. 모델 버전과 데이터셋 버전이 1:1로 추적되지 않으면, 재현 가능성(reproducibility)은 환상에 불과합니다.

데이터 버전 관리가 기술 인프라 문제라면, 데이터 품질 관리는 조직 운영 문제입니다. Velog에 공개된 지속적 데이터 품질관리 고민 글은 이 점을 솔직하게 드러냅니다. '오류 발견 → 수정 → 해결'의 반응적 루프는 시간이 지나면 같은 문제가 반복됩니다. 데이터 품질 문제의 근원은 단순 오류가 아니라 프로그램 + 데이터 구조 + 운영 프로세스 + 시스템 인터페이스가 복합적으로 작용한 결과이기 때문입니다. 환경 파악 → 품질 진단 → 원인 분석 → 품질 개선 → 지속 관리의 5단계 흐름은 데이터 프로파일링을 진단 도구로 활용하고, 데이터 품질 지표(완전성·정확성·일관성·적시성·유일성·유효성)를 기준으로 정량 진단을 수행하는 체계입니다. 특히 '품질이 개선됐다고 끝이 아니다—지속 관리 체계를 구축해야 한다'는 결론은, 데이터 드리프트(data drift) 모니터링 없이 모델을 방치하면 어떤 결과가 오는지를 경험으로 증명한 실무자의 언어입니다.

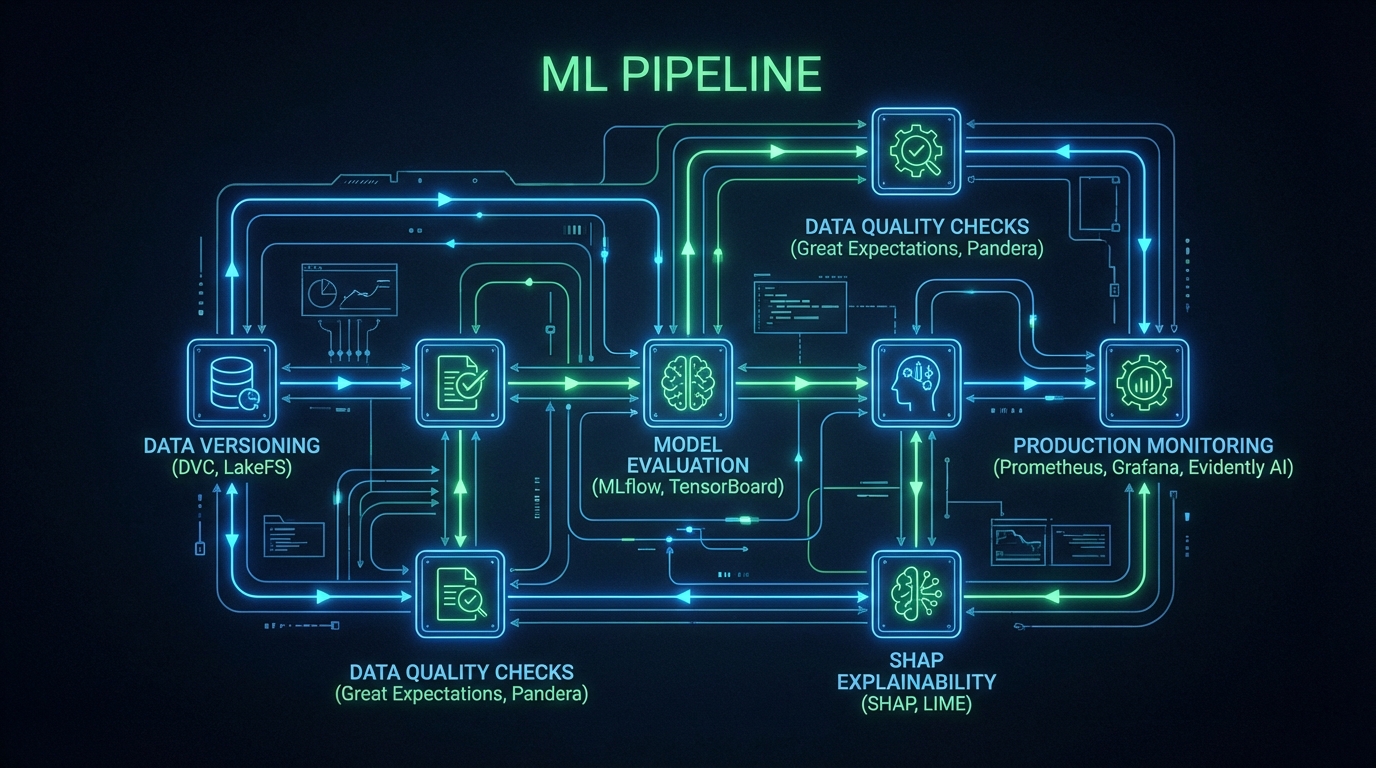

네 개의 소스를 하나의 체크리스트로 정리하면 이렇게 됩니다. 배포 전에 반드시 답해야 할 질문들입니다. 첫째, 데이터 품질: 학습 데이터의 분포가 실제 운영 환경과 일치하는가? 편향 출처는 식별됐는가? 데이터 프로파일링이 완료됐는가? 둘째, 데이터 버전 관리: 이 모델을 학습시킨 정확한 데이터셋 버전을 6개월 후에도 재현할 수 있는가? 셋째, 모델 해석 가능성: 예측 결과를 도메인 전문가가 이해하고 개입할 수 있는 형태로 설명할 수 있는가? SHAP 같은 XAI 도구가 파이프라인에 통합돼 있는가? 넷째, 다차원 평가: 정확도 외에 latency, 비용, 안전성, grounding이 복합 스코어로 측정되고 있는가? 오프라인 Gold Dataset 평가와 온라인 실시간 가드레일이 분리 운영되는가? 다섯째, 지속 모니터링: 모델 배포 후 데이터 드리프트와 성능 저하를 감지하는 재학습 트리거가 설정돼 있는가?

'SOTA 달성'이라는 표현이 더 이상 신뢰의 근거가 되지 않는 시대입니다. 재현 가능성, 일반화 성능, 프로덕션 latency—이 세 가지를 동시에 충족하지 못하는 모델은 실험 환경의 숫자일 뿐입니다. 앞으로 ML 파이프라인 설계의 무게중심은 점점 더 '모델 선택'에서 '데이터·평가 인프라 설계'로 이동할 것입니다. GenAI 평가 가이드의 표현을 빌리자면, 성공적인 시스템은 가장 좋은 모델을 찾아서가 아니라, 가장 좋은 평가 루프를 구축해서 만들어집니다. 배포 버튼을 누르기 전에, 체크리스트를 먼저 닫으세요.