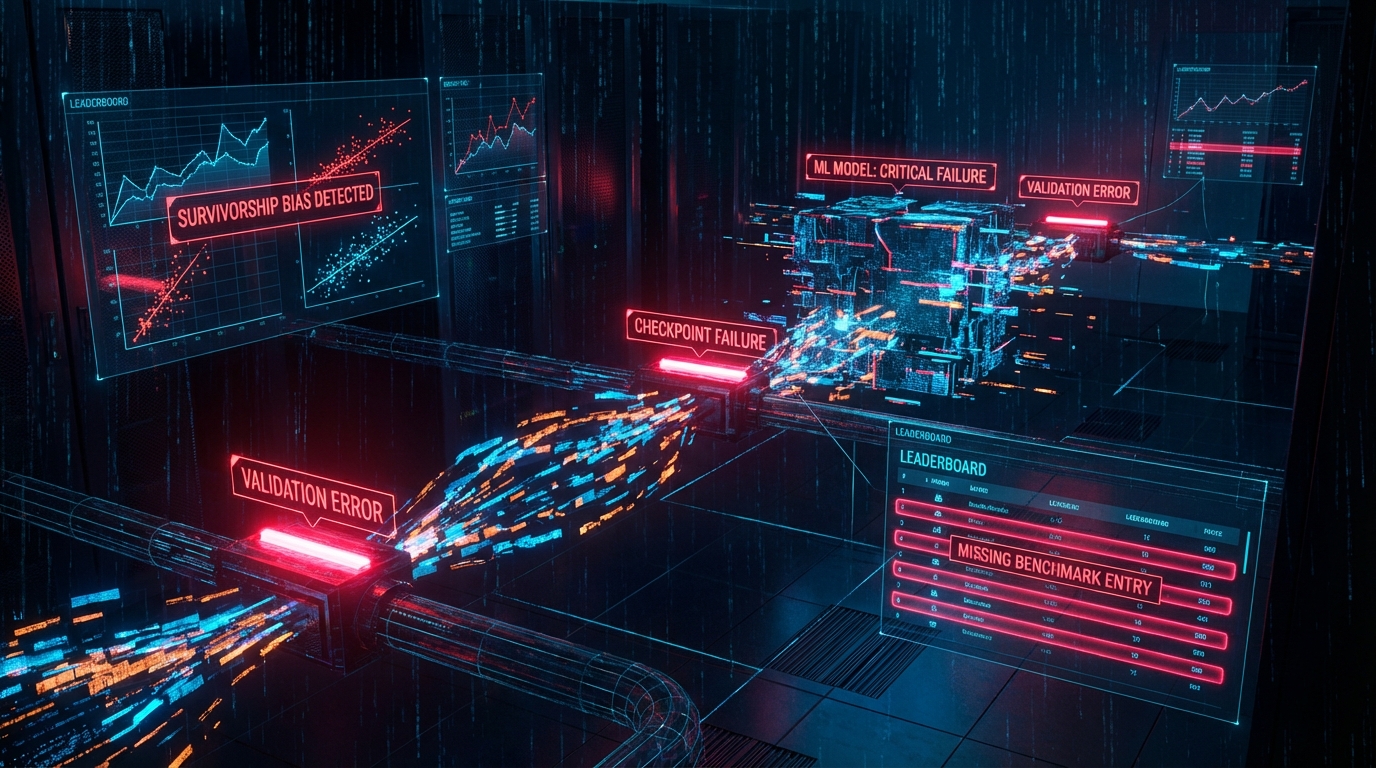

모델 탓을 하기 전에, 데이터 파이프라인을 먼저 의심하라

'샘플 사이즈가 충분한가요?'라는 질문보다 더 근본적인 질문이 있다. 그 샘플이 실제 예측 대상을 대표하는가? Gartner는 AI 프로젝트의 85%가 데이터 품질 또는 데이터 관리 부재로 실패한다고 보고한다. 알고리즘이 약해서가 아니다. 모델에 공급되는 데이터 파이프라인이 부러져 있기 때문이다. CrowdFlower·IBM 연구에 따르면 AI 프로젝트 전체 노력의 70~80%는 모델 학습 이전의 데이터 준비 단계에서 소비된다. 그럼에도 많은 팀이 데이터 파이프라인을 '나중에 처리할 것'으로 미룬다. 이것이 실패의 첫 번째 분기점이다.

생존 편향: NBA 모델이 '0분'을 예측 못 하는 이유

dev.to에 공개된 CourtVision NBA 분석 사례는 생존 편향(Survivorship Bias)이 ML 모델에 어떻게 조용히 침투하는지를 교과서처럼 보여준다. NBA API의 PlayerGameLog 엔드포인트는 실제로 출전한 경기의 로그만 반환한다. 부상으로 결장한 Joel Embiid의 해당 경기 데이터는 존재하지 않는다. 결과적으로 단일 회귀 모델은 '0분 출전'이라는 클래스를 학습한 적이 없고, 결장이 확실한 선수에게도 11분 같은 '그럴듯한 양수 값'을 돌려보낸다.

이 문제의 해결책은 모델 튜닝이 아니라 인제스트 파이프라인 수정이었다. 팀 로스터에 등록됐지만 게임 로그에 나타나지 않은 모든 선수에 대해 Minutes=0, Status=INACTIVE 합성 행(synthetic row)을 직접 삽입했다. 그리고 아키텍처를 2단계로 분리했다. Stage A: HistGradientBoostingClassifier로 출전 여부 확률(play_probability)을 먼저 추정한다. Stage B: play_probability >= 0.5인 경우에만 HistGradientBoostingRegressor로 출전 시간을 예측한다. 이 구조가 없으면 회귀 모델은 '결장 선수'와 '28분 출전 선수'를 같은 특성 공간에서 억지로 보간(interpolate)한다.

데이터 누수: .shift(1) 한 줄이 프로덕션을 구한다

같은 사례에서 또 하나의 함정이 드러난다. 롤링 통계 피처를 설계할 때 .expanding().mean().shift(1) 순서를 지키지 않으면 데이터 누수(Data Leakage)가 발생한다. N번째 경기의 피처에 N번째 경기 결과가 포함되는 순간, 학습 시 AUC-ROC는 인상적으로 보이지만 경기 시작 전 예측이 필요한 프로덕션 환경에서는 완전히 무너진다. '실제 운영 환경에서도 이 성능이 나올까요?'라는 질문에 답하기 위해서는 시간적 순서(temporal ordering)를 엄격히 지키는 검증 함수가 필수다. 이 팀은 validate_no_leakage() 함수를 별도로 구현해 특정 선수의 5번째 경기에서 피처값이 0~4번째 경기 평균과 0.01 이내로 일치하는지 단위 테스트했다. 이것이 ablation이다. 작지만 이 한 줄의 검증이 프로덕션 실패를 막았다.

또한 주목할 점은 클래스 불균형 문제다. 스타 플레이어는 결장 사례가 드물어 분류기가 '출전'에 편향된 학습을 한다. 결과적으로 play_probability = 0.98이지만 실제 확률은 0.92일 수 있다—모델이 과신(overconfident)하는 구간이다. 이런 Precision-Recall 트레이드오프는 클래스 가중치(class weight) 조정이나 임계값(threshold) 최적화 없이는 해결되지 않는다.

벤치마크의 함정: 숫자를 숨길수록 평균이 올라가는 역설

데이터 품질 문제가 모델 내부에서 발생한다면, 벤치마크 신뢰성 문제는 모델 외부 평가 설계에서 발생한다. 국내에서 공개된 ALL Bench 리더보드는 기존 벤치마크 생태계의 구조적 문제를 정면으로 지적한다. 허깅페이스 Open LLM Leaderboard는 오픈소스 모델만 다루고, Artificial Analysis는 속도·가격에 특화되어 있으며, LMArena는 사람 선호도 기반이라 정량적 재현이 어렵다. 어떤 리더보드도 GPT·Claude·Gemini를 동일 기준으로 비교하지 않는다.

더 심각한 문제는 점수 계산 방식이다. 대부분의 리더보드는 제출하지 않은 벤치마크 항목을 평균에서 제외한다. 이는 결과를 적게 제출할수록 평균이 올라가는 역설을 만든다. 약점 벤치마크를 슬그머니 건너뛰면 리더보드 순위가 올라간다—이건 데이터 조작이 아니라 평가 설계의 허점이다. ALL Bench는 미제출 항목을 0점 처리하고 10개 합산 후 10으로 나누는 방식으로 이 문제를 차단한다. 재현 가능성(reproducibility)과 공정한 비교를 위한 최소한의 설계다.

이 리더보드가 추가한 메타인지(metacognition) 지표도 주목할 만하다. 정답을 맞히는 정확도보다 틀렸을 때 스스로 바로잡을 수 있는가를 측정한다. 프로덕션 환경에서 LLM의 실제 위험은 오답 자체가 아니라 오답을 확신하며 제공하는 것이기 때문이다.

세 가지 실패의 공통 구조: 검증의 부재

세 가지 사례를 관통하는 공통 원인은 하나다. 검증(validation) 레이어의 부재. dev.to의 데이터 엔지니어링 아티클이 지적하듯, 프리텍스트 스타트업의 fraud detection 모델이 재학습 후 성능이 20% 하락한 이유는 전처리 스크립트에서 핵심 피처가 삭제됐기 때문이었다. 데이터 버전 관리(DVC, Delta Lake)가 없었기에 문제 추적에 며칠이 걸렸다. NBA 모델은 .shift(1)의 순서 오류가 누수를 만들었고, 이를 잡은 것은 단위 테스트였다. 벤치마크 리더보드는 미제출 항목 처리 정책 하나로 신뢰성이 결정됐다.

이건 correlation이 아니라 causation이다. 검증이 없으면 데이터는 조용히 부패하고, 모델은 침묵 속에 성능을 잃는다.

시사점: Data-Centric AI로의 전환이 필요한 이유

Andrew Ng이 강조한 것처럼, 데이터 품질 개선이 아키텍처 변경보다 더 큰 성능 향상을 가져오는 경우가 많다. 그러나 여전히 많은 팀이 모델 튜닝에 리소스를 집중한다. 실제로 필요한 것은 다음 세 가지다.

- 데이터 파이프라인의 지속성: Apache Airflow, Kafka 등으로 데이터를 일회성 처리가 아닌 지속 운영 시스템으로 설계한다.

- 누수·편향에 대한 능동적 검증: 시간적 순서를 지키는 피처 엔지니어링, 생존 편향을 제거하는 합성 데이터 인제스트, Great Expectations 같은 데이터 검증 프레임워크의 적용.

- 벤치마크 수치의 비판적 해석: SOTA 발표를 볼 때 어떤 벤치마크를 제출하지 않았는지, 평가 기준이 프로덕션 use case와 일치하는지를 먼저 확인한다.

전망: 프로덕션 ML의 신뢰성은 '데이터 인프라'에서 결정된다

2026년의 ML 경쟁은 더 큰 모델이 아니라 더 신뢰할 수 있는 데이터 인프라로 수렴하고 있다. Google과 Tesla가 모델 아키텍처보다 데이터 파이프라인에 더 많은 투자를 하는 이유가 여기 있다. 벤치마크 숫자가 프로덕션에서 재현되지 않는다면 그 숫자는 마케팅이다. 모델이 결장 선수에게 출전 시간을 예측한다면 그 모델은 신뢰할 수 없다. 데이터 드리프트를 감지하지 못한다면 배포 이후는 블랙박스다.

'근거는 있나요?' 이 질문을 모델 성능 수치에만 던질 것이 아니라, 학습 데이터의 구성 방식과 벤치마크의 평가 설계에도 동등하게 던져야 한다. 프로덕션 ML의 신뢰성은 그 질문에 얼마나 정직하게 답하느냐에서 시작된다.