단일 모델 의존, 얼마나 위험한가?

프로덕션 LLM 시스템에서 '단일 모델 의존'은 단순히 나쁜 설계가 아닙니다. 계량 가능한 리스크입니다. OpenAI API의 p99 레이턴시가 튀는 순간, 또는 rate limit에 걸리는 순간, 시스템 전체가 멈춥니다. dev.to에 공개된 LiteLLM 고가용성 아키텍처 분석에 따르면 GitHub 기준 33,800개 이상의 스타를 받은 오픈소스 AI 게이트웨이 LiteLLM이 이 문제를 해결하기 위해 설계된 이유가 바로 여기 있습니다. gpt-4o가 500 에러를 반환하는 순간, 동일한 프롬프트가 claude-3 또는 Gemini 1.5 Pro로 자동 라우팅됩니다. 사용자는 약간의 레이턴시 증가를 경험하지만, 크래시 화면은 보지 않습니다.

하지만 이건 시작일 뿐입니다. 단순 폴백(fallback) 전환은 가용성 문제를 해결하지만, 성능과 비용의 최적점은 해결하지 못합니다.

앙상블 패턴: 4가지 구조와 그 트레이드오프

dev.to의 GenAI 플랫폼 모델 앙상블 설계 아티클은 단일 폴백을 넘어 4가지 앙상블 패턴을 제시합니다. 데이터 분석 관점에서 각 패턴의 비용-성능 트레이드오프를 정리하면 다음과 같습니다.

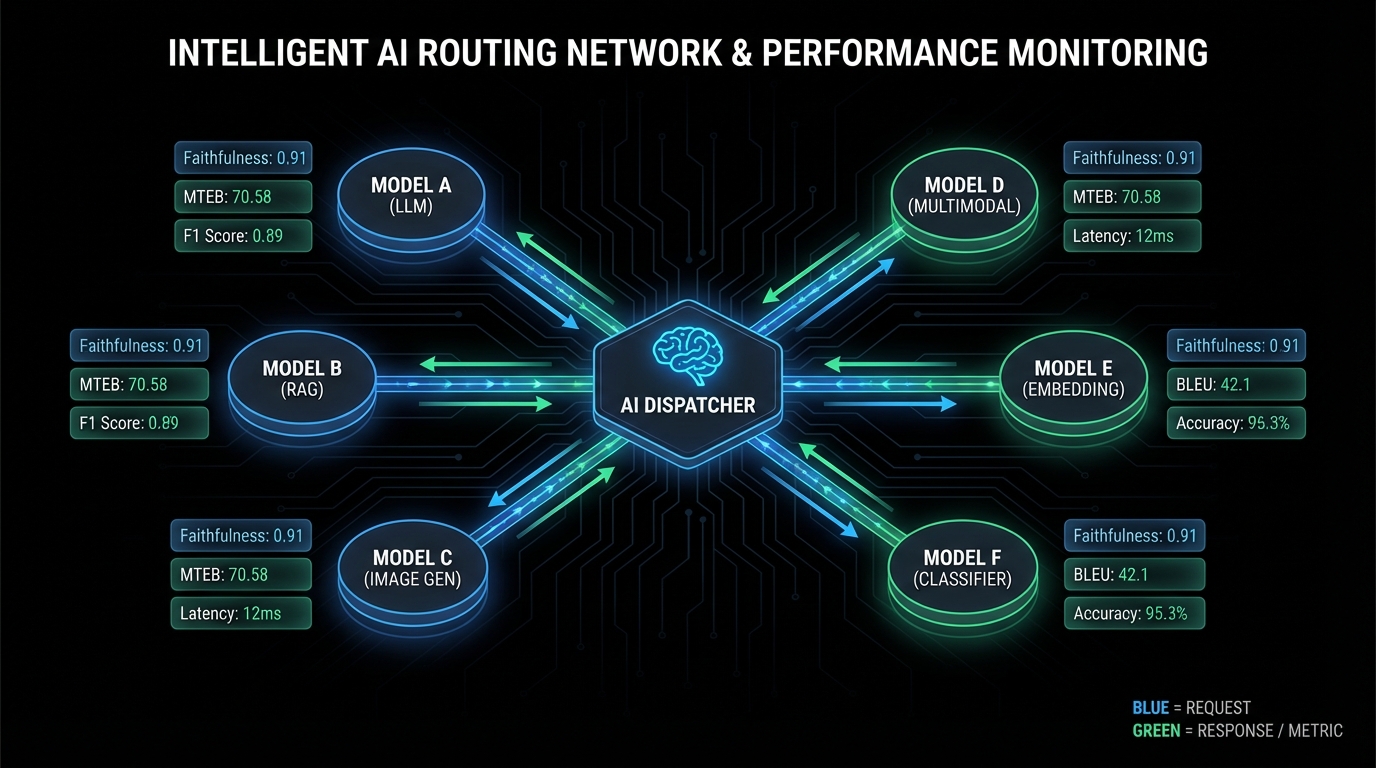

라우팅 앙상블(Dispatcher Pattern): 입력 복잡도에 따라 8B 소형 모델 또는 70B 추론 모델로 분기합니다. 라우터 자체가 경량 분류기여야 한다는 점이 중요합니다. 라우터가 틀리면 전체 비용 최적화가 무너집니다. 라우터의 정확도(precision/recall)를 별도로 측정하고 있나요? 이 질문부터 던져야 합니다.

검증 앙상블(Judge Pattern): 1차 모델이 응답을 생성하고, 2차 모델이 환각·안전성·논리 일관성을 감사합니다. 순차 실행이므로 레이턴시가 누적됩니다. 검증 모델이 1차 모델과 동일한 프로바이더 계열이면 같은 방식으로 실패할 가능성이 높습니다. 동종 모델 앙상블의 함정입니다.

합의 앙상블(Jury Pattern): 동일 프롬프트를 복수 모델에 병렬 전송하고 의미적 유사도 또는 다수결로 최종 출력을 결정합니다. 토큰 비용은 모델 수에 비례해 증가하며, 전체 레이턴시는 가장 느린 모델의 p99에 고정됩니다. 비용이 n배 늘어날 때 실제 품질 향상은 얼마인가요? Ablation study 없이 이 패턴을 도입하면 '주방 싱크대 앙상블(Kitchen Sink Ensemble)' 안티패턴에 빠집니다.

전문가 앙상블(MoE-at-System-Level): 검색, 요약, 코드 생성 등 서브태스크를 분해해 각기 다른 특화 모델에 할당합니다. RAG 파이프라인이 전형적인 사례입니다.

RAG에서의 실측 수치: 베이스라인이 어디냐가 핵심

dev.to의 2026년 RAG용 오픈소스 LLM 비교 분석은 이 설계 논의에 실측 데이터를 제공합니다. 중요한 점은 이 아티클이 MMLU나 HumanEval 같은 범용 벤치마크가 아니라, RAG 특화 지표—RAGAS Faithfulness, MTEB Multilingual Retrieval, Needle-in-Haystack 통과율—를 기준으로 삼았다는 겁니다.

결과를 요약하면:

| 모델 | 역할 | Faithfulness | 컨텍스트 | 레이턴시(A10G) |

|---|---|---|---|---|

| Qwen3-30B-A3B | 생성 | 0.91 | 262K | 1.2s |

| DeepSeek-R1 | 생성(추론) | 0.89 | 128K | 2.1s |

| Llama 3.3 70B | 생성(범용) | 0.88 | 128K | 2.5s |

| Qwen3-Embedding-8B | 임베딩 | MTEB 70.58 | — | — |

| BGE-M3 | 임베딩 | MTEB 63.0 | — | — |

Qwen3-30B-A3B가 1위를 차지한 이유는 단순히 Faithfulness 0.91 때문이 아닙니다. MoE 아키텍처로 30B급 출력을 3B급 추론 비용으로 달성한다는 점, 262K 컨텍스트 윈도우로 50개 이상의 청크를 오버플로우 없이 처리한다는 점이 프로덕션 비용 방정식을 바꿉니다.

단, 여기서 반드시 물어야 할 질문이 있습니다. 이 수치는 어떤 조건에서 측정됐나요? 테스트 데이터셋(RAGBench)이 여러분의 도메인 데이터 분포와 얼마나 일치하나요? A10G GPU 기준 레이턴시가 여러분의 인프라에서 재현될까요? Faithfulness 0.91과 0.88의 차이가 통계적으로 유의한가요—샘플 사이즈는요?

설계의 핵심 함정: 이건 correlation이지 causation이 아닙니다

세 소스를 통합해 보면 공통적으로 강조되는 안티패턴이 하나 있습니다. 동종 모델 앙상블입니다. 동일 프로바이더, 동일 학습 데이터 계열의 모델들은 같은 방식으로 실패합니다. 합의 앙상블을 구성했는데 세 모델이 모두 같은 방향으로 환각을 일으킨다면, Jury Pattern은 오히려 오류를 증폭시킵니다.

또한 '라우팅 효율'은 추적해야 할 핵심 지표입니다. 라우터가 소형 모델로 처리 가능한 태스크를 대형 모델로 과잉 프로비저닝하고 있다면, 앙상블의 비용 최적화 효과가 사라집니다. Routing Efficiency = (소형 모델로 성공 처리된 요청) / (전체 요청)을 별도 메트릭으로 모니터링해야 합니다.

그리고 RAG에서 임베딩 모델과 생성 모델은 독립적으로 최적화할 수 없습니다. 최고의 생성 모델(Faithfulness 0.91)도 잘못된 청크를 받으면 환각합니다. MTEB 70.58의 임베딩 모델도 생성 모델이 컨텍스트를 무시하면 무의미합니다. 두 모델의 조합을 end-to-end로 평가하는 파이프라인이 없다면, 개별 벤치마크 수치는 거짓 안도감을 줄 뿐입니다.

시사점: 오케스트레이션 설계는 관측 가능성(Observability)에서 시작된다

멀티모델 오케스트레이션의 복잡도는 단일 모델 대비 선형이 아닌 지수적으로 증가합니다. 이를 제어하려면 서브-리퀘스트 수준의 트레이싱이 필수입니다. 어떤 모델이 최종 응답에 기여했는지, 검증 단계에서 몇 퍼센트의 응답이 거부됐는지, 라우터는 올바른 모델을 선택했는지를 attribution metadata로 기록해야 합니다.

LiteLLM 같은 AI 게이트웨이는 벤더 락인 제거와 폴백 자동화를 단순화하지만, 그것만으로 프로덕션 오케스트레이션이 완성되지는 않습니다. 라우터의 분류 정확도, 앙상블 구성 모델의 이질성(heterogeneity), RAG 파이프라인의 end-to-end 평가 루프—이 세 가지가 갖춰지지 않은 멀티모델 시스템은 복잡도만 늘고 신뢰성은 낮아지는 최악의 결과를 낳습니다.

결국 멀티모델 오케스트레이션은 아키텍처 패턴의 문제가 아니라 측정 설계의 문제입니다. 어떤 지표를, 어떤 단계에서, 어떤 기준선(baseline)과 비교해 추적할 것인지를 먼저 정의하지 않으면, 앙상블은 그저 비용을 n배 곱하는 장치에 불과합니다.