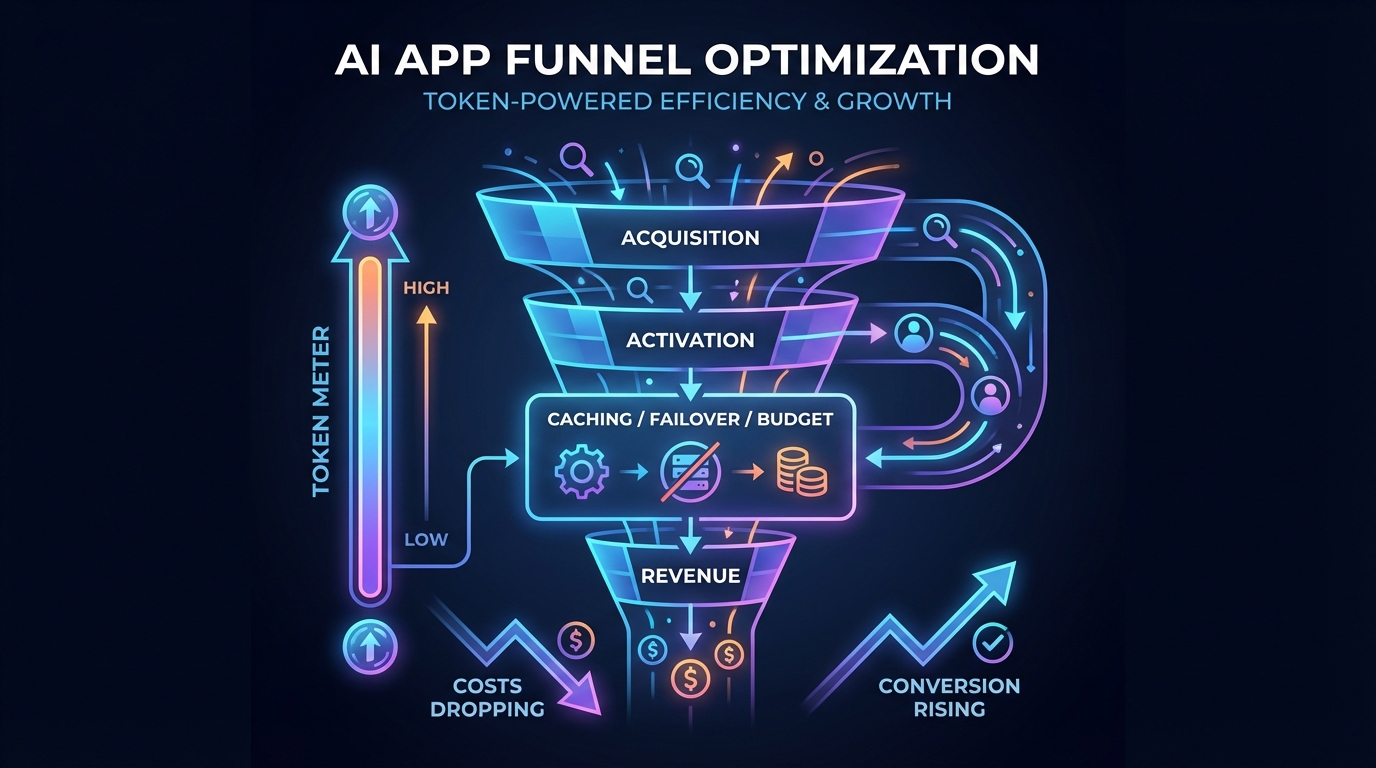

AI 제품이 PMF를 지나 스케일로 들어가는 순간, 경쟁력은 ‘모델 성능’보다 ‘단위경제(Unit Economics)’에서 갈립니다. 여기서 가장 자주 터지는 병목이 COGS—토큰/호출 비용입니다. 토큰이 새는 구조라면, 유료 플랜 가격을 올릴수록 해지가 늘고(가치 대비 비싸짐), 가격을 내릴수록 마진이 무너져 채널 확장이 막힙니다. 결국 토큰 비용은 곧 전환율입니다.

dev.to의 llmux 사례는 이 병목을 “기술=성장 레버”로 깔끔하게 보여줍니다. 코드 변경 거의 없이(환경변수 하나) LLM 호출 앞단에 5MB짜리 Rust 바이너리를 두고 캐싱/페일오버/레이트리밋/비용 트래킹을 붙였더니 비용이 40% 줄었다는 이야기죠. 핵심은 비용 절감 자체가 아니라, 그 절감이 가격·전환·CAC를 동시에 움직일 수 있는 ‘여지’를 만든다는 점입니다. (출처: dev.to의 llmux 아티클)

왜 게이트웨이가 그로스 레버인가? 첫째, Cost blindness(오늘 얼마 썼는지 모름)는 곧 ‘가격 실험 불가’로 이어집니다. 비용을 모르면 ARPU/LTV를 설계할 수 없고, 유료 전환 퍼널에서 “이 유저는 남길수록 손해인가?”를 판단하지 못합니다. llmux처럼 호출 단위로 모델/프로바이더별 비용을 잡아주면, 비로소 플랜별 원가선을 그을 수 있습니다.

둘째, 캐싱은 전환율을 해치지 않고 마진을 올리는 드문 카드입니다. 동일 프롬프트/동일 요청이 반복되는 영역(온보딩 가이드, 템플릿 생성, 테스트/CI, FAQ성 질의)은 생각보다 많습니다. 여기에 TTL을 둔 응답 캐싱만 올려도 “같은 품질, 더 싼 원가”가 됩니다. 이는 곧 ① 무료 체험의 사용량(크레딧) 확대, ② 첫 결제 장벽 하향, ③ 프로모션/제휴 채널로의 CAC 확장으로 직결됩니다.

셋째, 페일오버는 리텐션 레버입니다. 한 프로바이더 장애가 곧 앱 다운이면 D1/D7에서 신뢰가 깨지고, 재방문 비용(리마케팅)이 올라갑니다. llmux처럼 자동 페일오버가 있으면 장애를 “전환 훼손 이벤트”에서 “백그라운드 비용 상승” 정도로 바꿉니다. 즉, 비용을 조금 더 내더라도 리텐션을 지키는 선택지가 생깁니다.

토큰 효율 전쟁은 ‘툴 설계’에서도 벌어집니다. dev.to의 Vercel agent-browser 분석은 MCP 기반 브라우저 도구가 세션 시작부터 JSON Schema 툴 정의로 1만~1.7만 토큰을 선납하는 문제를 지적합니다. 반면 CLI 기반으로 “명령 실행 → 극도로 짧은 응답”을 만들면 툴 자체 오버헤드가 0에 가깝고, 10-step 자동화에서 토큰이 크게 줄어 성공률과 속도가 올라갑니다. 여기서도 결론은 동일합니다. 토큰을 덜 먹는 인터페이스가 더 오래 쓰이고(리텐션), 더 싸게 팔 수 있으며(전환), 더 넓은 채널로 확장됩니다(CAC). (출처: dev.to의 agent-browser 아티클)

시사점은 명확합니다. 스케일 단계의 AI 제품은 “더 똑똑한 프롬프트”보다 “덜 읽고, 덜 말하게 만드는 시스템”이 이깁니다. Claude Code 토큰 절감 팁에서 반복적으로 등장하는 것도 결국 같은 패턴입니다: 불필요한 파일 읽기 차단(.claudeignore), 재읽기 방지, 출력 축소. 이는 제품화하면 곧바로 COGS 개선으로 바뀝니다. (출처: dev.to의 Claude Code 토큰 절감 아티클)

당장 실행 가능한 실험 설계(전/후 비교)로 옮기면 빠릅니다. (1) LLM 게이트웨이를 붙여 요청당 토큰/비용, 캐시 히트율, 실패율을 계측하고 (2) 특정 구간(예: 온보딩/템플릿/브라우저 자동화)에 캐싱·요약·CLI형 툴 인터페이스를 적용한 뒤 (3) 전/후로 유료전환율, 결제까지 걸린 시간, 무료→유료 사용량 임계점 도달률을 봅니다. 핵심은 “비용이 줄었다”가 아니라 “같은 가격에서 전환이 올랐는가 / 같은 전환에서 CAC를 더 태울 수 있는가”로 판정하는 것입니다.

전망: AI 제품의 다음 경쟁 단위는 ‘기능’이 아니라 토큰 경제학이 내장된 인프라가 될 가능성이 큽니다. 게이트웨이(캐싱/예산/페일오버)+툴 인터페이스(토큰 오버헤드 최소화)+세션/컨텍스트 설계(재사용·압축)가 합쳐져야, 가격정책이 유연해지고 채널이 열립니다. 스케일을 막는 건 모델이 아니라, 모델을 호출하는 방식입니다. 그래서 토큰 비용을 낮추는 팀이 결국 전환율을 올립니다.