프로덕션 환경에서 RAG(Retrieval-Augmented Generation) 시스템을 서빙할 때 맞닥뜨리는 최대 병목은 검색된 문서의 '리랭킹(Reranking)' 연산 복잡도와 방대한 컨텍스트로 인한 API 호출 비용이다. 단순히 Retrieval 정확도만 높인다고 시스템이 완성되지 않는다. 결국 LLM의 컨텍스트 윈도우에 문서를 밀어 넣는 과정에서 발생하는 토큰 낭비와 추론 지연(Latency)을 정량적으로 통제하지 못하면, P99 지연 시간은 기하급수적으로 치솟는다. 이 비용-성능 트레이드오프를 타개하기 위한 핵심 전략은 알고리즘 차원의 복잡도 축소와 인프라 차원의 캐싱으로 귀결된다.

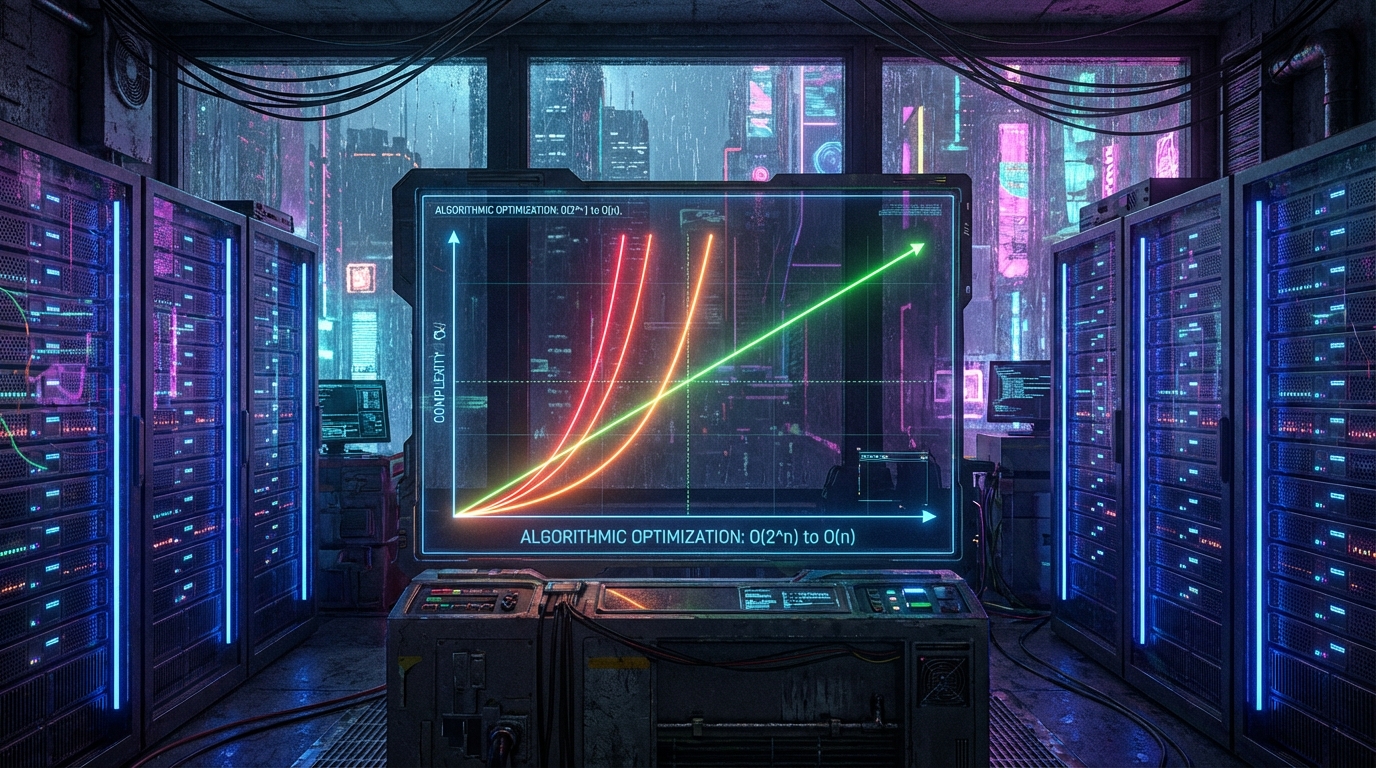

최근 'Large Language Models are Effective Text Rankers' 논문에서 제안된 PRP(Pairwise Ranking Prompting) 기법은 리랭킹 단계의 연산 비효율을 수학적으로 해결한 훌륭한 사례다. 기존 Listwise 방식은 문서 누락, 순서 불일치 등 LLM 특유의 환각(Hallucination)을 유발했고, Pointwise 방식은 캘리브레이션 부재로 신뢰성(Reliability)이 떨어졌다. 반면 PRP는 문서 두 개만 짝지어 비교하는 방식으로 프롬프트를 단순화했다. 주목할 점은 Sliding Window와 Heapsort 방식을 도입해 $O(N^2)$이던 비교 연산 복잡도를 $O(N)$ 또는 $O(N \log N)$ 수준으로 선형화했다는 것이다. 실험 결과, 20B 파라미터의 오픈소스 모델(FLAN-UL2)만으로 상용 GPT-4와 대등한 NDCG@10 성능을 달성하며, '태스크 복잡도 통제'가 '파라미터 크기'를 압도할 수 있음을 정량적으로 증명했다.

알고리즘 최적화와 더불어, 시스템 레벨의 '컨텍스트 캐싱(Context Caching)'은 비용 절감의 결정적 레버리지다. 최근 공개된 Gemini의 캐싱 아키텍처 데이터에 따르면, 32,768 토큰 이상의 대규모 컨텍스트를 캐싱할 경우 후속 요청의 토큰 처리 비용을 표준 요금 대비 75%까지 낮출 수 있다. 특히 대규모 문서 분석이나 배치 처리 시, 'Flash 모델을 통한 지연 없는 키워드 추출'과 'Pro 모델을 통한 고정밀 생성'으로 라우팅(Routing)을 분리하고 캐시를 재사용하는 파이프라인은 리소스 사용량 최적화의 교과서적 접근을 보여준다.

이 두 데이터 포인트가 시사하는 바는 명확하다. 성공적인 GenAI 파이프라인은 단일 거대 모델의 컨텍스트 윈도우에 의존하는 것이 아니라, 각 구성 요소를 독립적으로 분리하고 최적화해야 한다는 것이다. PRP 방식을 통해 오픈소스 모델로 리랭킹 성능을 확보하면 데이터 유출(Label Leakage) 위험과 API 종속성을 동시에 제거할 수 있다. 여기에 캐싱 만료 시간(TTL, 기본 1시간)과 배치 윈도우를 동기화하는 엔지니어링이 결합되면, 생성 품질(Generation Quality)의 훼손 없이 토큰당 비용(Cost-per-token)을 극단적으로 방어할 수 있다.

향후 생성형 AI 시스템의 경쟁력은 '누가 더 영리하게 문맥을 압축하고 재사용하는가'에 달렸다. 프로덕션 환경의 AI 엔지니어라면, 단순히 RAG 벤치마크 점수를 올리는 데 매몰될 것이 아니라, A/B 테스트를 통해 캐싱 적중률(Cache Hit Ratio)을 모니터링하고 리랭킹 알고리즘의 시간 복잡도를 프로파일링해야 한다. 통계적 유의성이 검증된 $O(N)$ 최적화와 75%의 토큰 할인율, 이 두 가지 수치적 무기 없이 대규모 엔터프라이즈 AI의 ROI를 논하는 것은 어불성설이다.