AI 에이전트를 제품에 붙일 때 실패하는 패턴은 늘 같다. 데모에선 똑똑한데, 프로덕션에선 비용(단위경제) 이 새고 신뢰(안전·통제) 가 무너진다. 그 순간 전환은 내려가고(불안해서 결제/승인 안 함), 리텐션은 깨진다(한 번 사고 나면 재방문 안 함). 이번에 나온 세 가지 신호—구글의 지속 메모리 아키텍처(aitimes), 리퀴드 AI의 로컬 에이전트(aitimes), 그리고 에이전트 보안 모델 전환(dev.to의 엔터프라이즈 보안 논의)—는 이 두 축을 동시에 잠그는 방법을 꽤 실전적으로 보여준다.

먼저 COGS. 구글은 ‘Always On Memory Agent’ 오픈소스에서 지속 메모리를 SQLite에 구조화 저장하고, 메모리 통합을 주기적으로 수행하면서도 벡터DB/임베딩 인프라를 아예 빼는 설계를 제시했다(aitimes). 핵심은 “검색 인프라를 따로 운영하지 말고, LLM이 정리·요약·갱신을 맡게 하자”는 접근이다. 여기서 그로스 관점의 포인트는 명확하다. 벡터DB는 기능이 아니라 운영비(인덱싱·동기화·파이프라인)와 장애면적을 키우는 COGS 고정비가 되기 쉽다. 특히 중소 규모 팀·단일 제품에서 ‘기억’ 기능은 금방 프리미엄이 아니라 적자로 변한다.

구글이 경량 모델(제미나이 3.1 플래시-라이트)을 전제로 “24시간 에이전트도 저비용”을 강조한 것도 같은 맥락이다(aitimes). 항상 켜져 있는 에이전트는 결국 (1) 수집 → (2) 정리 → (3) 재호출이 반복되는데, 이 루프가 곧 토큰 청구서가 된다. 인프라를 줄이고 모델을 가볍게 만들면, ‘기억’이 기능 추가가 아니라 비용 구조 최적화로 바뀐다.

하지만 비용만 낮추면 끝이 아니다. 지속 메모리는 곧바로 신뢰 부채를 만든다. 누가 메모리를 수정/삭제할 수 있는지, 어떤 정보가 통합되는지, 에이전트가 “무엇을 학습했는지”를 어떻게 감사할지 같은 질문이 바로 튀어나온다(aitimes). 제품 관점으로 번역하면: 메모리가 커질수록 사용자는 ‘편리함’보다 ‘불안함’을 먼저 느낀다. 그리고 불안은 전환을 갉아먹는 가장 빠른 마찰이다.

여기서 리퀴드 AI의 로컬 에이전트(LocalCowork)가 던지는 힌트가 크다(aitimes). 노트북 내부에서 모델·데이터·툴 실행을 끝내고, 툴 호출 전 과정을 로컬 감사 로그로 남기는 설계는 “데이터를 밖으로 보내지 않는다”는 프라이버시 이점뿐 아니라, 기업 구매에서 결정적인 증적(auditability) 을 기본값으로 만든다. 특히 금융·의료처럼 규제가 강한 시장에선 ‘성능’보다 “누가, 언제, 어떤 도구를, 어떤 입력으로 실행했는가”가 PoC를 통과시키는 문턱이다. 즉 로컬+감사로그는 단순 보안 기능이 아니라 엔터프라이즈 CAC를 낮추는 세일즈 자산이 된다.

다만 로컬이라고 자동화가 곧바로 성숙하는 건 아니다. 리퀴드가 공개한 수치에서 다단계 워크플로 완료율이 26%에 머문 점은 중요한 현실 체크다(aitimes). 이 데이터는 “완전 자율”을 팔기보다, 초기에는 에이전트를 ‘도구 디스패처(추천+실행 보조)’ 로 포지셔닝하는 쪽이 전환·리텐션에 유리하다는 뜻이다. 사용자가 중간에 끼어들어 수정할 수 있으면 실패 비용이 낮아지고, 실패가 곧바로 이탈로 이어지는 구간(Activation~D7)을 방어할 수 있다.

그리고 마지막 퍼즐이 보안 모델의 전환이다. dev.to 글은 포인트를 정확히 찍는다. 에이전트가 ‘답변’이 아니라 ‘행동’을 하기 시작하면 보안은 “누가 로그인했나”가 아니라 “어떤 권한을, 어떤 에이전트에게, 어떤 작업 범위로 위임했나” 의 문제가 된다. NIST가 2026년 들어 AI 에이전트 보안에 대해 RFI, 아이덴티티/권한 컨셉 페이퍼, 표준 이니셔티브까지 연달아 움직이는 건 시장이 곧 같은 방향으로 가격을 매긴다는 신호다(dev.to). 즉, 권한 위임·툴 레벨 정책·행동 계보(lineage)가 없는 에이전트는 기능이 좋아도 대규모 배포에서 CAC가 폭증한다(보안 심사·법무·리스크 오너 설득 비용).

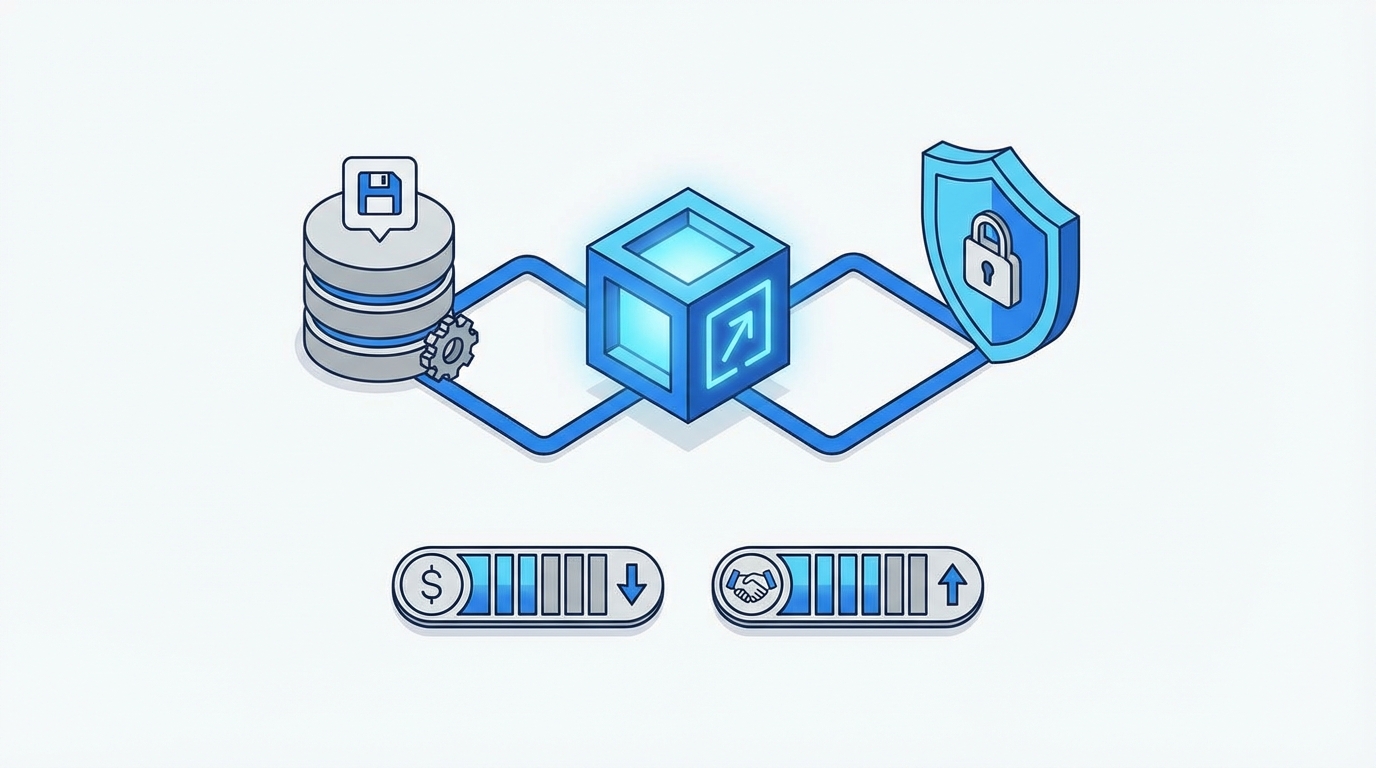

시사점은 한 줄로 정리된다: 에이전트의 단위경제는 ‘메모리’에서 새고, 신뢰는 ‘권한’에서 터진다. 그래서 실행 순서도 바뀌어야 한다. (1) 메모리는 벡터DB부터 깔기보다, 구글처럼 구조화 저장+주기 통합으로 운영비를 먼저 낮추고(aitimes) (2) 실행은 로컬/온프렘 또는 최소 범위 툴부터 시작해 감사 로그를 기본값으로 두며(aitimes) (3) 권한은 사람 세션/공유 키를 빌려 쓰지 말고 에이전트 전용 아이덴티티·단기 자격증명·툴별 정책 게이트로 ‘과잉 대리(excessive agency)’를 막아야 한다(dev.to). 이 3가지가 갖춰지면, 에이전트는 비용센터가 아니라 전환을 망치지 않는 자동화가 된다.

전망: 앞으로 ‘에이전트 경쟁’은 모델 성능보다 운영 비용(메모리·인프라)과 위임 통제(아이덴티티·정책·감사) 를 기본 패키지로 얼마나 잘 묶느냐에서 갈릴 가능성이 크다. 벡터DB를 빼는 실용 아키텍처, 로컬 실행과 로그 기반의 규정 준수, NIST가 밀어붙이는 위임 권한 표준화 흐름이 한 방향으로 수렴하고 있다. 제품팀 관점에서 이건 기회다. “똑똑한 에이전트”가 아니라 “싸고, 안전해서, 도입이 빠른 에이전트”를 만들면—COGS와 CAC를 동시에 낮추는 스케일 구간이 열린다.