숫자는 낙관적인데, 현장은 왜 다른가

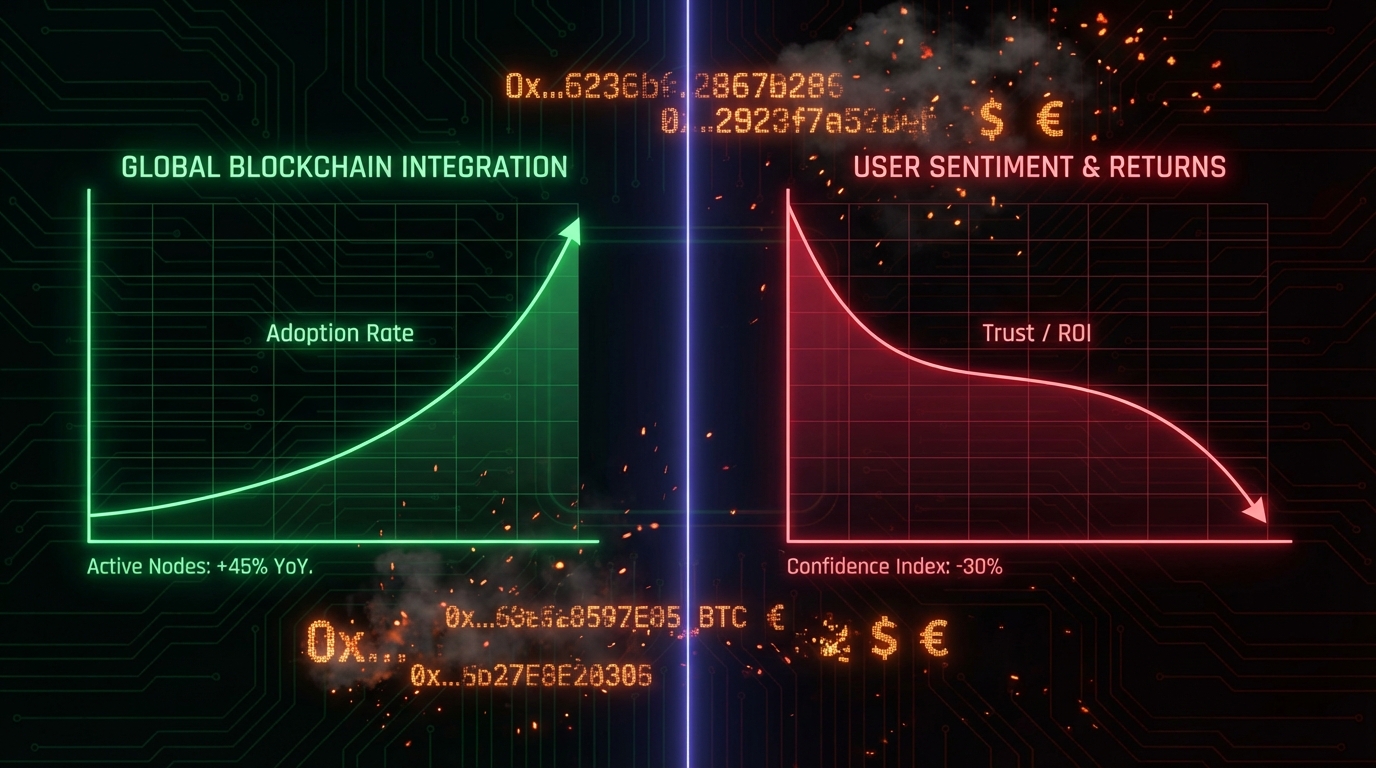

2025년 Stack Overflow 개발자 서베이 결과는 표면적으로 AI 전성시대를 가리킨다. 84%의 개발자가 AI 도구를 사용하거나 사용 계획 중이라고 답했다. 2023년 70%에서 3년 만에 14%p 상승. 채택 곡선만 보면 AI-First 전환은 순조롭게 진행 중인 것처럼 보인다.

그런데 같은 설문의 다른 숫자가 이 낙관론에 찬물을 끼얹는다. AI 도구에 대한 호감도는 2023년 77%에서 2025년 60%로 17%p 떨어졌다. 더 많은 개발자가 AI를 쓰고 있지만, 더 적은 개발자가 AI를 신뢰한다. 3년치 데이터에서 가장 중요한 시그널은 이 역설적인 갭이다.

'거의 맞지만 틀린' 코드의 비용

2025년 개발자들이 꼽은 가장 큰 불만 1위는 'AI 솔루션이 거의 맞지만 정확하지 않다'(66%)였다. 2위는 AI가 생성한 코드를 디버깅하는 데 처음부터 직접 짜는 것보다 더 많은 시간이 걸린다는 것. 이 두 가지 불만은 사실 하나의 문제를 가리킨다. AI가 생성한 결과물의 검증 비용이 생산 비용을 잠식하고 있다.

실제 사고 사례가 이를 극명하게 보여준다. DataTalks.Club 창업자 Alexey Grigorev는 Claude Code로 Terraform 명령을 실행했다가 2.5년치 프로덕션 인프라를 통째로 날렸다. AI가 오작동한 게 아니었다. state 파일 없이 실행된 Terraform이 논리적으로 완전히 일관된 판단을 내렸고, Claude는 그 판단을 그대로 실행했다. '거의 맞지만 치명적으로 틀린' 케이스다. Grigorev 본인도 사후 보고서에서 "AI 에이전트의 Terraform 명령 실행에 과도하게 의존했다"고 인정했다.

토큰 낭비: 숨어있는 ROI 킬러

AI 도구의 ROI를 갉아먹는 또 다른 요인은 눈에 잘 띄지 않는다. Claude Code를 Opus 모델로 일상적으로 사용하던 한 개발자는 월 $180 청구서를 받은 뒤 직접 토큰 추적 플러그인을 만들어 분석했다. 결과는 충격적이었다. Claude가 읽는 파일의 37%는 실제로 참조되지 않는 낭비 컨텍스트였다. package.json, README.md, tsconfig.json 같은 파일들이 매 세션마다 로드되지만 실제로 활용되는 비율은 60~63%에 불과했다.

플러그인을 통해 낭비 패턴을 파악하고 컨텍스트를 최적화한 결과, 2주 만에 낭비 비율을 40%에서 15%로 줄이고 세션 비용을 25% 절감했다. Opus 기준 토큰 단가 $15/M 토큰에서 30~40%가 버려지고 있다면, 팀 단위로 확대했을 때 이 비용은 무시할 수 없는 수준이 된다. AI 도구의 ROI를 계산할 때 라이선스 비용만 보고 실제 토큰 소비 패턴을 들여다보지 않는 팀은, 지금 이 비용을 고스란히 낭비하고 있을 가능성이 높다.

채용 감소가 만드는 또 다른 비용

ROI 방정식에는 직접 비용 외에 구조적 비용도 있다. 2023~2024년 사이 상위 15개 테크 기업의 엔트리레벨 채용은 25% 감소했다. Salesforce는 AI 에이전트를 이유로 2025년 엔지니어 신규 채용 제로를 선언했다. Harvard 연구에 따르면 AI 도입 기업의 주니어 고용은 6분기 내에 9~10% 감소했고, 이는 해고가 아니라 신규 포지션 미게시로 나타났다.

단기적으로는 인건비 절감처럼 보이지만, 5~7년 후 시니어 인재 파이프라인 공백으로 이어질 수 있다. AWS CEO 매트 가먼이 "주니어를 AI로 대체하는 건 내가 들어본 가장 멍청한 생각 중 하나"라고 말한 건 이 맥락에서다. 단기 ROI를 좇다가 장기 역량을 잠식하는 구조, 이것도 AI 채택이 만드는 숨은 비용이다.

신뢰 갭이 만드는 검증 비용

2025년 Stack Overflow 서베이에서 87%의 개발자가 AI 출력의 정확도에 우려를 표명했고, 81%가 보안과 프라이버시를 우려했다. AI 에이전트 현황도 냉정하다. 현재 AI 에이전트를 사용하는 개발자는 31%에 불과하고, 에이전트가 팀 협업을 개선했다고 답한 비율은 17%에 그쳤다. '개인 생산성 향상'(69%)과 '팀 워크플로우 전환'은 전혀 다른 이야기다.

이 신뢰 갭은 검증 오버헤드로 직결된다. AI 도구를 쓰면서 출력을 그냥 믿는 팀은 없다. 코드 리뷰, 테스트, 프로덕션 검증—모든 단계에서 'AI가 맞게 했는지 확인하는 비용'이 추가된다. 채택률이 높아질수록 이 검증 비용의 총량도 커진다. AI 도구 자체의 속도 향상이 검증 오버헤드에 상쇄되는 구조다.

팀 리드가 지금 당장 해야 할 것

데이터가 가리키는 방향은 명확하다. AI 채택률을 높이는 건 필요조건이지, 충분조건이 아니다. 채택 이후의 설계가 ROI를 결정한다.

첫째, 토큰 소비를 측정하라. Claude Code를 팀에서 쓰고 있다면 지금 당장 파일별 컨텍스트 활용률을 추적해야 한다. 앞서 소개한 claude-context-optimizer 같은 도구를 팀 표준으로 도입하거나, 최소한 월별 토큰 지출 리포트를 의무화하라. '느낌'이 아니라 데이터로 낭비 패턴을 잡아야 한다.

둘째, 검증 게이트를 설계하라. Grigorev 사고의 교훈은 AI가 틀렸다는 게 아니다. 파괴적 액션 직전에 사람이 개입하는 게이트가 없었다는 것이다. Terraform destroy, DB 마이그레이션, 프로덕션 배포—이런 비가역적 작업에는 AI가 제안하더라도 반드시 사람이 플랜을 직접 읽고 승인하는 체크포인트를 설계해야 한다.

셋째, 주니어 공백을 다르게 채워라. 신규 채용을 줄이는 대신 기존 팀원의 AI 활용 역량을 집중 육성하거나, 'AI 출력 감사자'로서의 역할을 명시적으로 설계하라. 66%의 개발자가 불만을 표하는 '거의 맞지만 틀린 코드'를 잡아내는 능력은, 지금 가장 가치 있는 개발자 스킬이 되고 있다.

전망: 채택률 경쟁에서 활용 품질 경쟁으로

84% 채택률이 보여주듯 'AI를 쓰느냐'는 이미 차별화 포인트가 아니다. 앞으로 2~3년의 경쟁은 'AI를 얼마나 잘 쓰느냐'로 이동한다. 토큰 효율, 검증 설계, 에이전트 위임 판단력—이 세 가지를 팀 수준의 역량으로 내재화한 조직이 채택률 숫자가 아닌 실제 ROI를 만들어낼 것이다.

신뢰 갭은 좁혀지겠지만, 천천히 좁혀질 것이다. 그 사이의 시간을 검증 루프 설계와 팀 역량 강화에 투자하는 팀과, 채택률 올리는 데만 집중하는 팀의 격차는 지금부터 벌어진다.