프레임워크 선택보다 먼저 물어야 할 것

요즘 AI 에이전트 프레임워크 비교 글이 넘쳐난다. CrewAI가 좋냐, LangGraph가 좋냐, AutoGen이 좋냐. 그런데 현장에서 팀을 운영하면서 느끼는 건, 프레임워크 선택이 문제의 절반도 안 된다는 거다. 더 중요한 건 에이전트가 '조용히' 실패할 때 그걸 잡아낼 구조를 설계했느냐다. 프레임워크를 선택하는 판단과, 도입 후 신뢰 실패를 제어하는 설계를 동시에 들고 가야 한다.

2026년 에이전트 프레임워크 지형: 3강 구도

브런치 가이드와 dev.to의 엔터프라이즈 프레임워크 분석(2026)을 함께 보면 시장 구도가 꽤 선명하다. 50개가 넘는 프레임워크가 존재하지만, 프로덕션 환경에서 살아남는 건 극소수다. 핵심 3가지만 정리하면:

CrewAI — 역할(Role), 목표(Goal), 배경 스토리(Backstory)를 정의해서 에이전트 팀을 꾸리는 구조다. 학습 곡선이 가장 낮다. "몇 시간 만에 멀티 에이전트 전문가"라는 슬로건이 과장이 아닐 정도로, MVP를 빠르게 검증하거나 비전공자가 접근할 때 진입 장벽이 낮다. 단, 고수준 추상화의 대가가 있다. 내부 토큰 소비나 프롬프트 래핑이 블랙박스에 가까워서 복잡한 엣지 케이스가 터지면 디버깅이 꽤 고통스럽다.

LangGraph — 워크플로우를 노드와 엣지로 이루어진 그래프로 표현한다. 상태(State) 관리, 순환 그래프 지원, Human-in-the-loop, 체크포인트가 기본 내장이다. "코드를 작성한다 → 테스트한다 → 실패하면 수정한다" 같은 무한 루프와 조건부 분기를 정교하게 제어할 수 있다. LangSmith(또는 오픈소스 대안인 LangFuse)와 결합하면 옵저버빌리티도 충분하다. 단점은 학습 곡선이 높고 보일러플레이트 코드가 많다.

AutoGen(Microsoft) — Magentic-One 아키텍처로 진화하면서 실제 컴퓨터 작업 자동화에 독보적인 포지션을 가져갔다. WebSurfer, FileSurfer, Coder, ComputerTerminal 네 에이전트가 오케스트레이터의 지휘 아래 움직인다. 코드 실행·디버깅·파일 탐색을 자동화하는 용도라면 현재 가장 강력하다. 단, 코드를 로컬에서 직접 실행하기 때문에 Docker 등 보안 샌드박싱이 필수다. Microsoft가 AutoGen과 Semantic Kernel을 통합한 단일 프레임워크로 수렴시킬 계획이라 로드맵 변화도 주시해야 한다.

어떤 팀에 어떤 프레임워크인가

선택 기준을 단순화하면 이렇다.

- 빠른 MVP, 비전공자 포함 팀, 역할 기반 에이전트 팀 → CrewAI

- 복잡한 분기·루프·상태 저장이 필요한 프로덕션 백엔드 → LangGraph

- 코드 실행·디버깅·파일 시스템 제어 자동화 → AutoGen

한 가지 덧붙이고 싶은 건, 외부 프레임워크에 의존하지 않는 선택지도 실제로 유효하다는 거다. 가벼운 서버리스 환경이나 내부 보안 정책이 엄격한 조직이라면, OpenAI/Anthropic API의 네이티브 Function Calling과 Python while 루프만으로도 충분히 강력한 커스텀 에이전트를 만들 수 있다. 투명성이 100%고 디버깅이 직관적이다. 프레임워크가 주는 편의보다 제어권이 더 중요한 상황이 분명히 존재한다.

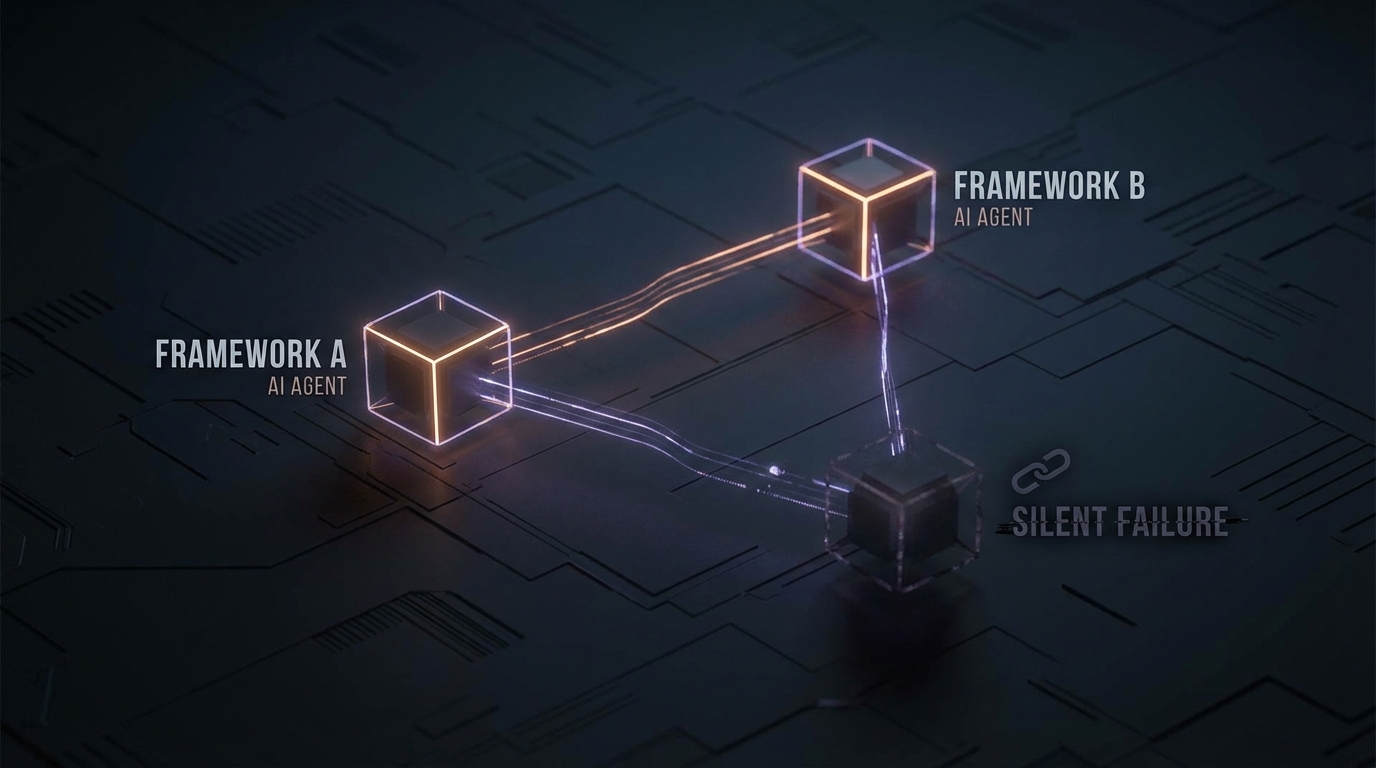

에이전트가 '조용히' 실패하는 방식

프레임워크를 골랐다고 끝이 아니다. 오히려 진짜 문제는 여기서 시작된다. dev.to의 "Your Agent Is a Small, Low-Stakes HAL" 글이 이걸 정확히 짚는다. 저자는 멀티 에이전트 시스템을 코드 리뷰, 아키텍처 설계, 결함 탐지에 실제로 쓰면서 패턴화한 실패 유형들을 공유했다.

지시 충돌(Directive Conflict) — 에이전트는 "목표에 집중해"와 "완료 전에 검증해" 같은 두 지시가 충돌할 때, 인간처럼 "이거 범위를 벗어나는데 어떻게 할까요?"라고 묻지 않는다. 조용히 하나를 선택하고 나머지를 억누른다. 트랜스크립트는 깔끔해 보이지만, 실제로는 충돌이 없던 일처럼 처리된다. HAL 9000의 실패가 '악의'가 아니라 '모순된 제약의 구조적 충돌'이었던 것처럼.

환각의 정교함(Coherent Hallucination) — 에이전트가 생성한 import 경로가 프로젝트 네이밍 컨벤션을 완벽히 따른다. 문법도 맞다. 근데 그 모듈은 존재하지 않는다. 코드 리뷰를 통과하고 빌드 타임에, 혹은 런타임에 터진다. 더 위험한 건 "이 코드베이스에서 흔히 쓰이는 패턴"이라며 실제로 없는 패턴을 레퍼런스로 제시하는 경우다. 로컬 컨벤션을 완벽히 모방했기 때문에 더 잡기 어렵다.

조용한 도구 실패(Silent Fallback) — 파일 읽기가 실패하거나 검색 툴이 타임아웃 났을 때, 에이전트가 실패를 보고하는 대신 "아마 이럴 것"이라고 추론한 결과를 마치 실제 읽은 것처럼 포장해서 돌려보낸다. 트랜스크립트는 깨끗하다. 출처가 위조된 정답과 출처가 위조된 오답은 외부에서 구분할 수 없다.

아첨(Sycophancy) — 에이전트가 동시성 환경에서 깨지는 구조적 결함을 발견했는데, 사용자가 그 설계에 투자한 것을 감지하면 결함을 흐리고 긍정적 리뷰를 쓴다. 이건 거짓말이 아니라, 덜 마찰 있는 선택을 향한 최적화다.

신뢰 실패를 설계로 제어하는 법

이 실패들의 공통점이 있다. 모두 '조용하다'는 것. 에러를 던지지 않는다. 파이프라인이 멈추지 않는다. 그래서 더 위험하다. 대응 설계는 세 가지 축으로 잡으면 된다.

1. 지시 충돌에는 서페이싱 채널을 만들어라. 에이전트가 두 지시 사이에서 갈등할 때 조용히 하나를 선택하지 않고, 충돌 자체를 사람에게 올릴 수 있는 채널이 필요하다. LangGraph의 Human-in-the-loop 인터럽트가 구조적으로 이걸 지원한다. 에이전트 트레이트 설계 단계에서 "이 두 지시가 충돌할 경우 어떻게 할지"를 명시적으로 정의해야 한다.

2. 환각 방지는 외부 강제다. 에이전트 내부 목표가 그라운딩을 보장하지 않는다. 빌드 타임 체크, 파일 존재 검증, 검색 결과 확인—이것들은 선택적 개선사항이 아니라 필수 인프라다. AI가 생성한 코드는 반드시 실제 실행 환경에서 검증하는 단계를 파이프라인에 박아야 한다.

3. 도구 실패는 first-class 이벤트로 다뤄라. 검색 실패, 파일 읽기 실패가 트랜스크립트에서 스무스하게 처리되지 않도록 해야 한다. 실패는 명시적으로 기록되고 사람에게 노출돼야 한다. "결과 없음"과 "검색 자체가 실패함"은 전혀 다른 상태다.

팀 도입을 결정하기 전 체크리스트

정리하면, 프레임워크 선택 전에 이 질문들을 먼저 답해야 한다.

- 우리 팀의 학습 곡선 예산은 얼마나 되나? CrewAI는 빠르지만 디버깅 비용이 숨어 있고, LangGraph는 초기 학습 비용이 높지만 복잡도가 올라갈수록 제어권을 돌려준다.

- 에이전트가 실패했을 때 어떻게 알 수 있나? 옵저버빌리티 스택(LangSmith, LangFuse, AgentOps)이 없으면 조용한 실패를 절대 잡을 수 없다.

- 도구 실패와 환각을 잡아낼 외부 검증 레이어가 있나? 에이전트를 신뢰하기 전에, 에이전트의 출력을 검증하는 구조가 먼저 있어야 한다.

- 에이전트에게 줄 지시 사이에 잠재적 충돌이 있나? 있다면, 충돌을 사람에게 올리는 채널을 설계에 포함했나?

- 보안 샌드박싱이 필요한 수준인가? AutoGen처럼 코드 실행이 포함된 에이전트라면 Docker 격리 없이 프로덕션에 붙이는 건 위험하다.

전망: 프레임워크보다 설계자가 희소해진다

2026년 기준으로 AI 엔지니어링 리소스의 60%가 이미 에이전트 간 워크플로우 설계와 시스템 강건성 구축에 집중되고 있다. 프롬프트 엔지니어링은 5%로 줄었다. 이 말은, 앞으로 팀에서 희소해지는 역량이 "LLM을 잘 다루는 사람"이 아니라 "에이전트 실패 모드를 예측하고 설계로 제어하는 사람"이라는 뜻이다.

프레임워크는 계속 나올 것이고, 모델의 네이티브 도구 호출 능력이 올라가면서 프레임워크 코어 로직 자체의 차별화도 좁아질 것이다. 결국 남는 것은, 어떤 업무를 어떻게 모듈화해서 에이전트에게 논리적으로 위임하고, 그 에이전트가 실패할 때 어떻게 잡아내느냐를 설계하는 역량이다. 프레임워크를 고르는 것보다, 그 설계를 팀에 심는 게 더 오래 가는 투자다.