앤트로픽이 Claude Code에 AI 코드 리뷰 기능을 추가했다. PR이 올라오면 멀티 에이전트가 병렬로 코드베이스를 분석하고, 버그 심각도를 색상으로 분류해 인라인 코멘트로 돌려준다. 앤트로픽 내부 데이터에 따르면 이 기능 도입 이후 실질적인 리뷰 코멘트를 받은 PR 비율이 16%에서 54%로 뛰었고, 1,000줄 이상 대형 PR의 84%에서 평균 7.5개의 이슈가 발견됐다. 오탐률은 1% 미만. 숫자만 보면 꽤 인상적이다.

그런데 여기서 잠깐 멈춰야 한다. 이 기능이 실제로 팀에 의미 있으려면, 전제 조건이 하나 있다. 팀이 Claude Code를 이미 쓰고 있어야 한다. 그리고 바로 이 지점에서 현실은 훨씬 냉정하다.

_dev.to_에 올라온 GitHub Copilot 채택 실패 분석 글은 많은 팀이 겪고 있는 민낯을 정확하게 짚는다. 라이선스를 구매하고, 공지 이메일을 보내고, 6주 후에 확인해보면 사용량 그래프가 스키 슬로프처럼 급락해 있다. 도구의 문제가 아니다. 워크플로우 통합의 실패다.

실패 패턴은 세 가지로 압축된다. 첫째, 도구만 도입하고 기존 프로세스는 그대로 둔다. PR 리뷰 기준, 완료 정의, 속도 지표가 변하지 않은 채로 "Copilot 써라"고 하면 개발자는 보일러플레이트 생성에 쓰다가 결과물 이해하느라 두 배 시간을 쓰고 결국 멈춘다. 둘째, AI를 '코드 써주는 주니어'로 취급한다. 가장 ROI가 높은 사용처는 자동완성이 아니라 낯선 코드베이스 설명, 테스트 케이스 생성, PR 요약, 문서 작성이다. 자동완성만 쓰면 전체 가치의 10%만 쓰는 셈이다. 셋째, 팀 내에 '무엇이 잘 되는지'가 공유되지 않는다. 효과적인 프롬프트를 발견한 사람이 팀 공유 문서에 올리고, 다 같이 쓰고, 다듬는 루프가 없으면 학습은 개인에서 끝난다.

Claude Code는 Copilot과 다른 멘탈 모델을 요구한다. 자동완성 도구가 아니라 에이전트다. 테스트를 돌리고, 실패를 보고, 통과할 때까지 반복한다. 멀티파일 리팩터링을 직접 실행한다. 라이브러리를 먼저 조사하고 코드를 쓴다. 이건 '내 생각을 빠르게 완성해주는 도구'가 아니라 '문제를 위임하고 결과를 검토하는 구조'다. 팀이 이 차이를 이해하지 못하면 Claude Code도 6주 후 같은 운명을 맞는다.

채택 전략은 단계적으로 설계해야 한다. 1~2주차는 리스크 없는 고가시성 작업부터다. 문서 작성, 테스트 생성, 회의록 요약처럼 AI가 명확하게 시간을 절약해주는 작업에서 시작해 팀이 '이거 되네'를 경험하게 만든다. 3~4주차에는 실제 개발 워크플로우 한 곳에 통합한다. "PR 준비 45분 → 15분"처럼 구체적이고 측정 가능한 지점을 고른다. 5~6주차부터 팀 내 프롬프트 라이브러리를 만든다. 설문이 아니라 실제로 쓰는 프롬프트 10개를 모아서 레트로에서 리뷰한다. 이 루프가 돌기 시작하면 확장할 근거가 생긴다. 근거 없이 확장하면 또 스키 슬로프다.

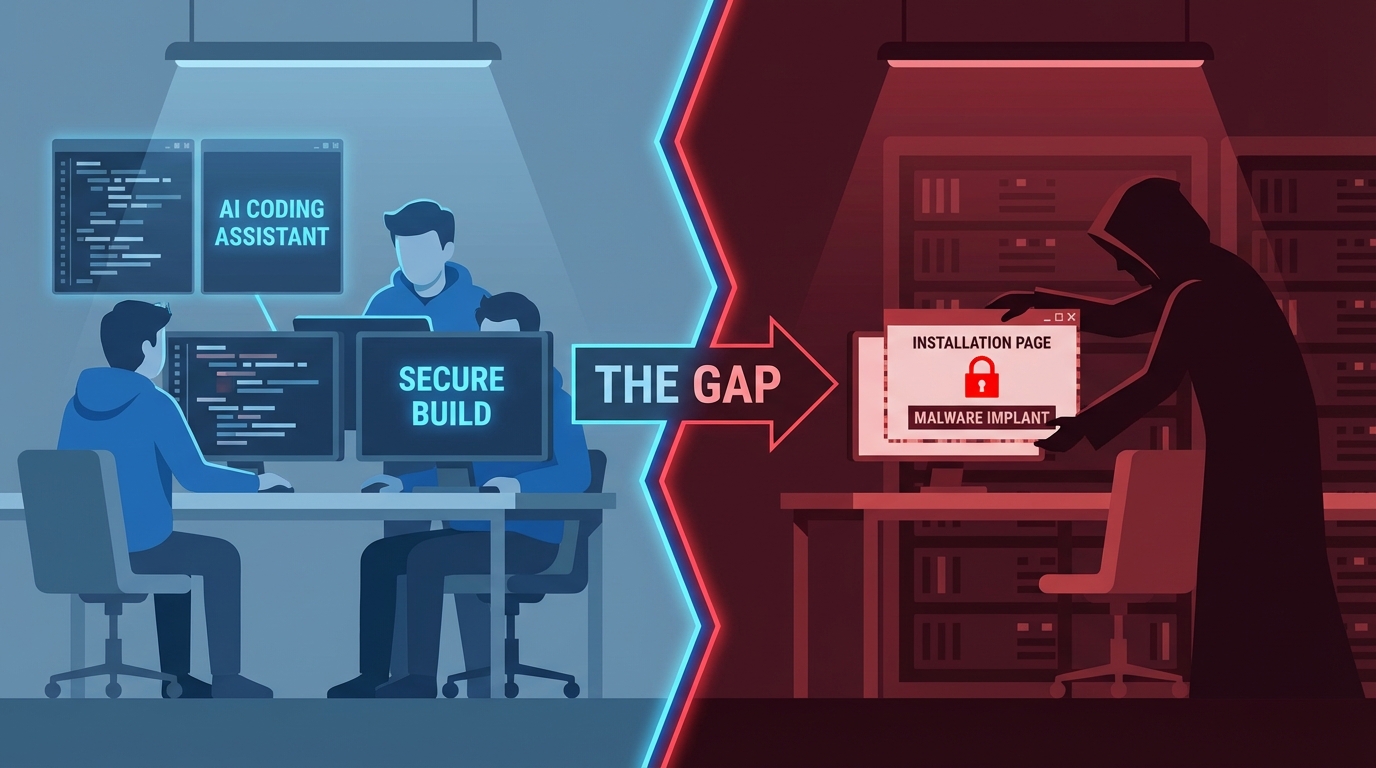

그런데 도구를 제대로 도입하려는 바로 그 순간, 새로운 위협이 생겨났다. Push Security 연구팀이 확인한 Claude Code 사칭 사이트는 공식 레이아웃, 브랜딩, 문서 사이드바를 완벽하게 복제했다. 페이지 내 모든 링크는 실제 공식 사이트로 연결된다. 단 하나, 설치 명령어만 다르다. 그 명령어를 터미널에 붙여넣으면 Amatera 인포스틸러가 설치된다. 브라우저 비밀번호, 세션 토큰, 암호화폐 지갑, 시스템 정보가 빠져나간다.

유입 경로는 구글 검색 광고였다. "Claude Code install"을 검색했을 때 스폰서 결과가 사칭 사이트로 연결됐다. 이 수법이 특히 위험한 이유는 타이밍이다. 새 도구를 처음 설치할 때, 공식 문서처럼 생긴 페이지의 명령어를 터미널에 복붙하는 건 개발자의 자연스러운 행동이다. 공격자는 이 맥락을 정확히 겨냥했다. 세션 토큰이 탈취되면 2단계 인증 없이도 코드 저장소, 클라우드 콘솔, 업무용 SaaS 계정까지 연쇄 침해로 이어진다. 일반 피싱보다 개발자에게 훨씬 치명적인 이유다.

대응 방법은 세 가지다. 검색 스폰서 결과를 무시하고 공식 사이트는 북마크로 직접 접근한다. 설치 명령어를 실행하기 전에 공식 소스에서 독립적으로 URL을 확인한다. 가능하면 복사 대신 직접 타이핑한다. 눈에 보이지 않는 악성 내용이 클립보드에 숨어있을 수 있기 때문이다. 결국 핵심은 출처를 신뢰하는 것이 아니라 출처를 직접 확인하는 습관이다.

세 가지 사례를 한 줄로 꿰면 이렇게 된다. Claude Code 코드 리뷰는 AI가 만들어내는 코드 폭증을 품질 측면에서 받아낼 수 있다는 걸 보여준다. Copilot 채택 실패 분석은 도구가 있어도 워크플로우 설계 없이는 팀에 뿌리내리지 못한다는 걸 증명한다. 사칭 악성코드 사례는 도구를 처음 도입하는 바로 그 순간이 공격 표면이라는 걸 일깨운다.

AI-First 팀 리빌딩을 말할 때 도구 선택 이야기를 먼저 꺼내는 경우가 많다. 하지만 실제 현장에서 더 자주 막히는 건 선택 이후다. 라이선스를 사고, 슬랙에 공지하고, 아무도 안 쓰거나, 아무나 마구 쓰거나, 잘못된 곳에서 다운받거나. 세 가지 함정 모두 도구의 문제가 아니다. 설계와 습관과 보안 의식의 문제다. 이 세 가지가 먼저 준비되지 않으면, AI 코딩 도구는 팀에 뿌리내리기 전에 사고부터 난다.