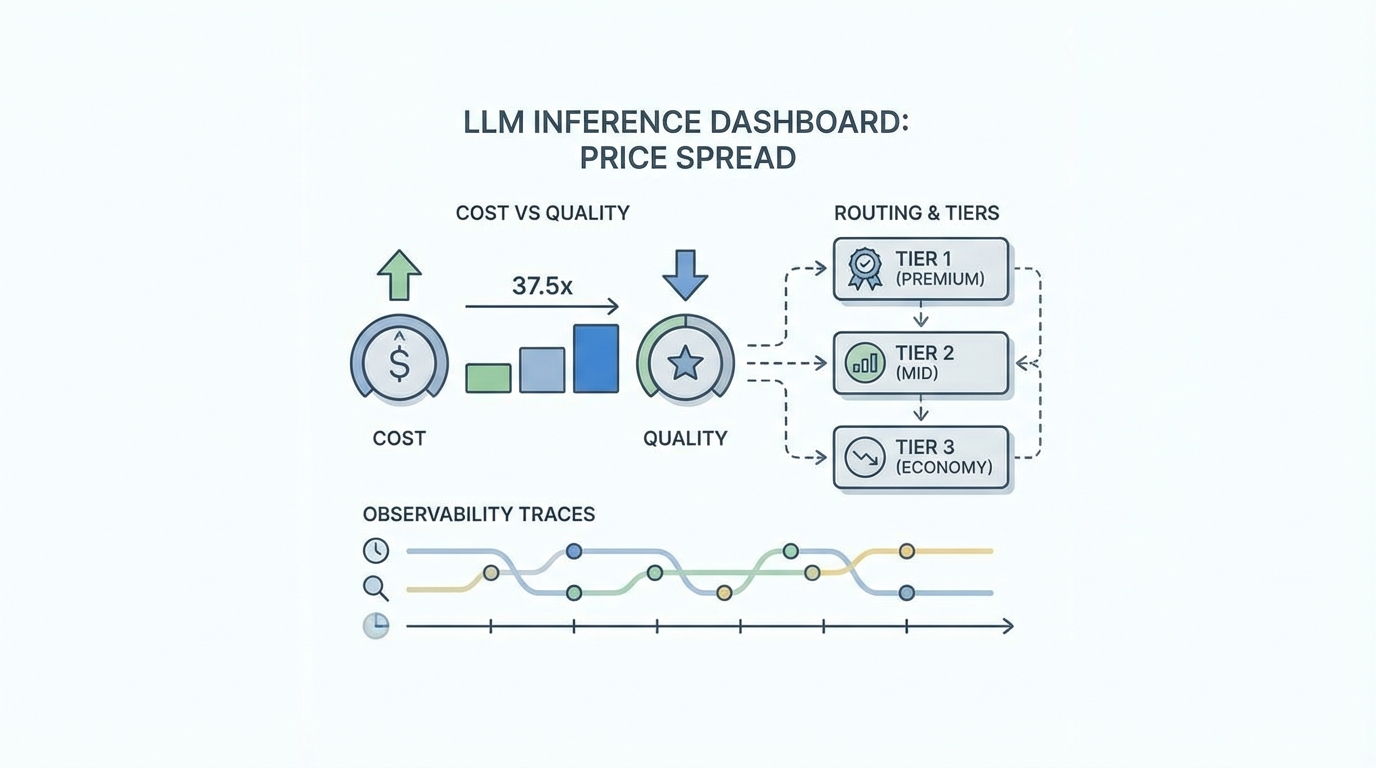

AI 제품/에이전트 비즈니스에서 성장의 본질은 “기능 추가”가 아니라 “같은 품질을 더 낮은 COGS로 제공하는 능력”이다. dev.to의 Llama 70B 추론 공급자 비교에 따르면, 동일 급 모델인데도 토큰 단가가 최저 $0.24/M(DeepInfra)에서 최고 $9.00/M(Anthropic Sonnet)까지 37.5배 벌어진다. 이 격차는 마케팅이 아니라 단위경제가 성장을 결정한다는 신호다.

핵심 이슈는 ‘최저가를 쓰자’가 아니다. 대부분 팀은 자기 워크로드가 요구하는 신뢰성·지연시간·품질 기준과, 실제로 지불하는 인퍼런스 티어가 불일치한다. 가격표를 보면 DeepInfra/Hyperbolic 같은 최적화 API는 배칭·퀀타이즈(FP8/BF16)로 가격을 내리고, Groq/Fireworks는 초저지연을 위해 하드웨어 프리미엄을 받는다. OpenAI/Anthropic은 범용 플랫폼+독점 모델 프리미엄, Akash 같은 GPU 렌탈은 “하드웨어는 싸 보여도 운영·서빙 비용이 새어 나가” 토큰당 원가가 올라갈 수 있다(출처: dev.to Llama 70B pricing 비교 글).

이 맥락을 성장 관점에서 번역하면 간단하다. ARPU가 고정된 구독/좌석 과금에서는 COGS가 곧 마진이며, 마진이 실험 예산(채널 테스트, 온보딩 개선, 리텐션 리워드)을 만든다. 즉 추론비용 최적화는 ‘비용 절감’이 아니라 다음 성장 실험을 살리는 “자본 효율 레버”다. 특히 에이전트는 루프·재시도·컨텍스트 팽창으로 토큰이 비선형으로 튀기 때문에, 모델 단가보다 “워크로드 단위(예: per-task) 비용”을 먼저 고정해야 한다.

여기서 관측성(Observability)이 비용/품질 동시최적화의 조향장치가 된다. dev.to의 2026 LLM Observability 도구 비교 글이 지적하듯, 전통 APM은 환각·품질 드리프트·토큰 폭주를 못 잡는다. Langfuse(오픈소스/자가호스팅), Helicone(프록시로 2분 셋업), LangSmith(LangChain 친화), Braintrust(평가 게이트), Phoenix(RAG/드리프트), Datadog(엔터프라이즈 통합) 등은 공통적으로 “비용 트래킹+트레이싱+평가”를 제공한다(출처: dev.to Observability 도구 비교 글). 중요한 건 툴 이름이 아니라, (1) 모델/버전별 비용, (2) 기능별 토큰 사용, (3) 실패/재시도 패턴, (4) 품질 점수의 최소 기준을 같은 대시보드에서 묶는 것이다.

실무 시사점은 ‘티어 라우팅’ 전략으로 정리된다. ① 기본값을 최저가로 두고(예: Llama 70B 저가 티어), ② 특정 조건에서만 프리미엄 티어로 승격한다(예: VIP 유저, 고난도 작업, 낮은 확신도, SLA 필요한 업무). ③ 그리고 승격/강등 규칙을 관측성 데이터로 자동 튜닝한다. 이 구조가 되면 “품질을 위해 비싼 모델을 상시 사용”하는 97% 예산 누수를 막으면서도, 필요한 순간에는 품질/신뢰를 지킨다.

또 하나의 포인트는 프로덕션 갭이다. dev.to의 에이전트 프로덕션 실패 분석은 문제를 ‘모델’이 아니라 ‘설정’으로 본다. 에스컬레이션 규칙, 컨텍스트 신선도 체크, 재시작 복구, 세션 예산(max_steps/max_tokens), 스키마 검증이 없으면 에이전트는 조용히 잘못된 결정을 내리거나 무한 루프로 비용을 태운다(출처: dev.to Prototype-to-Production gap 글). 즉 관측성은 비용 절감을 넘어, “실패가 비용으로 번지는 경로(루프/재시도/잘못된 액션)”를 차단해 리텐션과 신뢰를 함께 지킨다.

전망: 앞으로 AI 제품의 경쟁은 ‘더 똑똑한 모델’보다 “더 정교한 라우팅+평가+예산 통제”로 이동한다. 가격은 실시간으로 흔들리고, 공급자 간 격차는 더 벌어질 수 있다. 따라서 팀이 가져가야 할 로드맵은 명확하다. (1) 기능/유저/작업 단위로 비용을 귀속시키고, (2) 품질 지표(정확도·해결률·CSAT)를 함께 트래킹하며, (3) 라우팅과 세션 예산을 정책으로 고정한다. 이 3가지를 깔면, 추론비용과 품질은 더 이상 트레이드오프가 아니라 ‘데이터로 동시에 최적화’하는 성장 엔진이 된다.