검증 병목은 이미 팀의 일상이 됐다

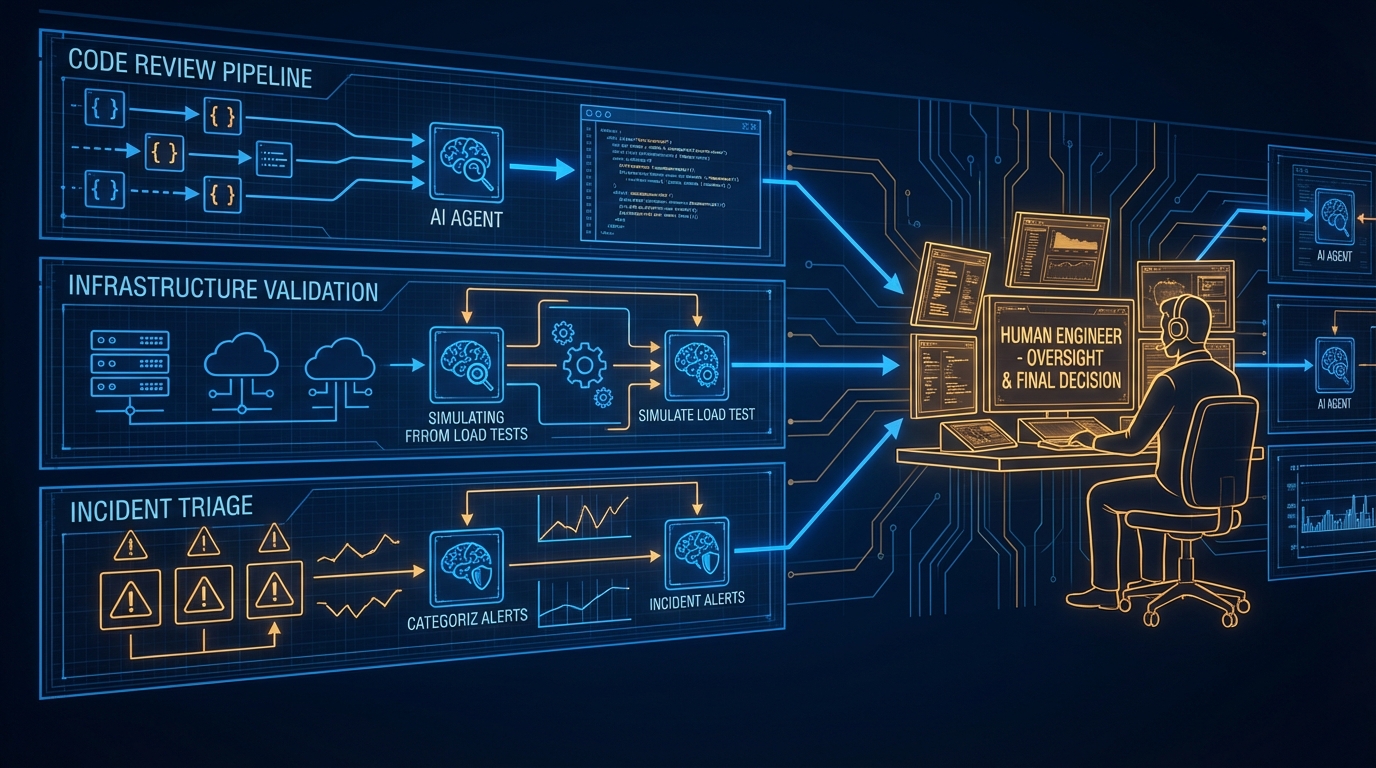

AI 코딩 도구가 팀에 퍼지면서 코드 출력량은 올라갔다. 앤트로픽은 자사 엔지니어 1인당 코드 출력량이 지난 1년간 200% 증가했다고 밝혔다. 문제는 그 다음이다. 코드가 빨라진 만큼 리뷰·검증·장애 대응이 새로운 병목이 됐다. 이제 AI가 그 병목 자체를 자동화하기 시작했다. 코드 리뷰, 인프라 검증, 온콜 트리아지까지. 세 가지 현장 사례를 보면 방향은 분명한데, 팀이 설계해야 할 것도 그만큼 선명해진다.

사례 1: Claude Code Review — 리뷰도 에이전트 팀이 맡는다

앤트로픽이 발표한 Claude Code Review는 PR이 열리는 순간 AI 에이전트 팀을 자동 투입하는 구조다. 에이전트는 버그를 탐색하고, 오탐지를 줄이기 위한 교차 검증을 수행하며, 중요도에 따라 결과를 순위화한 뒤 PR에 요약 코멘트와 인라인 코멘트를 남긴다. 실제 PR 승인 여부는 사람이 결정한다.

내부 운용 데이터가 흥미롭다. 변경 라인이 1,000줄 이상인 대규모 PR에서는 84%에서 문제를 감지했고 평균 7.5건을 발견했다. 엔지니어 대다수가 감지 내용에 동의했으며, 오류라는 지적은 1% 미만이었다. 평균 리뷰 시간은 20분.

다만 비용 구조는 팀이 반드시 계산해야 한다. PR 1회당 15~25달러 어치 토큰을 소비한다. 50줄 미만 소규모 PR의 감지율은 31%, 평균 0.5건에 그쳤다. 모든 PR에 동일하게 붙이는 방식은 비용 대비 효율이 낮다. PR 규모와 리스크 등급에 따라 에이전트 투입 기준을 설계하는 것이 먼저다.

사례 2: Amazon Q + GitHub MCP — 인프라 리뷰 병목을 시스템으로 푼다

dev.to에 공유된 클라우드 아키텍트 Sarvar의 사례는 조직 구조 문제를 AI로 풀어낸 현장 기록이다. 두 팀의 모든 인프라 리뷰·보안 승인·비용 검증이 자신을 통과해야 했고, 결국 본인이 병목이 됐다. 해법으로 선택한 건 Amazon Q Developer CLI와 GitHub MCP 서버의 조합이었다.

MCP를 통해 Amazon Q가 GitHub 레포지토리에 직접 접근하게 하고, 팀별 리뷰 기준(암호화 여부, IAM 최소 권한, 태깅 표준, 비용 경고 임계치)을 체크리스트로 구조화했다. PR 리뷰에 걸리던 2~4시간이 10~20분으로 줄었고, 두 팀 리드에게 동일한 셋업을 이전해 병목을 분산시켰다.

여기서 주목할 포인트는 도구가 아니라 설계 방식이다. AI가 보는 기준이 명확하지 않으면 리뷰는 일관성이 없고 팀은 AI 결과를 신뢰하지 않는다. 리뷰 가이드라인을 먼저 문서화하고, 그것을 AI가 참조하는 컨텍스트로 주입한 뒤 파일럿 팀에서 2주 검증하고 나서 확장했다는 점이 이 사례의 핵심이다.

사례 3: AI 온콜 트리아지 — 새벽 3시를 덜 깨는 구조

dev.to에 올라온 또 다른 실험은 온콜 런북 자체를 AI로 대체한 시도다. PagerDuty 알림이 오면 AI 에이전트가 로그와 메트릭을 분석해 가능한 근본 원인, 심각도 분류, 디버깅 스텝, 권장 조치를 자동으로 반환하는 구조다. Redis 연결 풀 포화로 인한 API 레이턴시 스파이크를 3분 만에 초기 진단한 사례가 대표적이다. 일반적인 휴먼 트리아지 시간인 15~20분과 비교된다.

그러나 두 번은 완전히 틀렸다. AI는 데이터베이스 경합이 원인이라고 판단했지만, 실제 원인은 잘못 설정된 피처 플래그였다. 이 실험에서 나온 결론이 명쾌하다: AI에게 프로덕션 변경 권한을 주지 마라. AI는 반복적인 조사 루틴을 맡고, 결정은 사람이 한다.

세 사례가 함께 가리키는 것

공통 패턴이 있다. 세 사례 모두 AI를 '결정자'가 아닌 '첫 번째 레이어'로 설계했다. Claude Code Review는 승인을 사람에게 남겼고, Q 기반 인프라 리뷰는 아키텍트의 판단을 보조했으며, AI 온콜은 엔지니어에게 컨텍스트를 건네고 멈췄다.

이 설계가 작동하려면 팀이 미리 풀어야 할 것들이 있다.

리뷰 기준의 명시화. AI가 검토하는 기준이 코드베이스와 팀 컨벤션에 맞게 구조화돼 있지 않으면, 에이전트의 결과는 참고도 못 하는 노이즈가 된다. 체크리스트를 먼저 만들고, 그걸 AI가 읽는 컨텍스트로 넣는 순서가 중요하다.

투입 기준의 설계. PR 크기, 변경 리스크, 시스템 도메인에 따라 AI 에이전트를 언제 붙이고 얼마나 깊게 돌릴지 정해야 한다. 비용과 속도 사이의 트레이드오프는 팀마다 다르다.

파일럿 후 확장. 두 사례 모두 한 팀에서 먼저 검증하고 나서 확장했다. AI 결과를 신뢰하기까지의 시간과 교정 비용을 과소평가하면 확산이 오히려 혼란을 만든다.

AI 검증 레이어, 팀의 통제 설계가 선행돼야 한다

자동화된 검증 레이어는 팀의 병목을 실질적으로 줄일 수 있다. 숫자가 이미 보여준다. 하지만 도구를 켜기 전에 팀이 결정해야 할 것들이 있다. AI가 뭘 보고, 어떤 기준으로 판단하며, 어디서 멈추고 사람에게 넘길지. 이 설계 없이 자동화 레이어만 쌓으면, 속도는 올라가도 통제권은 흐릿해진다.

AI가 리뷰하고 장애를 분석하는 세상이 되는 건 시간문제다. 중요한 건 그 레이어를 어떻게 설계하느냐다. 팀이 지금 가장 먼저 해야 할 일은 도구를 고르는 게 아니라, 자동화가 개입하는 지점과 사람이 결정하는 지점을 명확히 그어두는 것이다.