생성형 AI 에이전트 시스템을 프로덕션 환경에 배포할 때 가장 빈번하게 마주하는 병목은 외부 API를 호출(Tool Calling)하는 과정에서 발생하는 파라미터 매칭 오류다. 개발자 커뮤니티 dev_to의 실증 데이터에 따르면, 3단계 이상 중첩(Nested)된 JSON 스키마를 LLM에게 요구할 경우 페이로드 생성 실패율은 15~25%까지 치솟는다. 이는 모델의 추론 능력이 부족해서가 아니라, 구조적 복잡성이 토큰 생성 과정의 인지 부하(Cognitive load)를 임계점 이상으로 끌어올리기 때문이다.

이러한 현상은 LLM의 근본적인 아키텍처 한계에서 기인한다. LLM은 토큰을 좌에서 우로 예측하는 자기회귀(Autoregressive) 모델이다. 내부적으로 병렬적인 '구문 검사기(Syntax checker)'를 가동하지 않기 때문에, 중첩된 괄호가 늘어날수록 모델이 추적해야 하는 어텐션(Attention) 상태값은 기하급수적으로 복잡해진다. 결과적으로 괄호를 조기에 닫아버리거나(Premature closing), 배열 위치를 혼동하는 환각(Hallucination)이 필연적으로 발생하게 되며, 이는 곧바로 재시도(Retry)로 이어져 시스템의 P99 지연 시간을 심각하게 훼손한다.

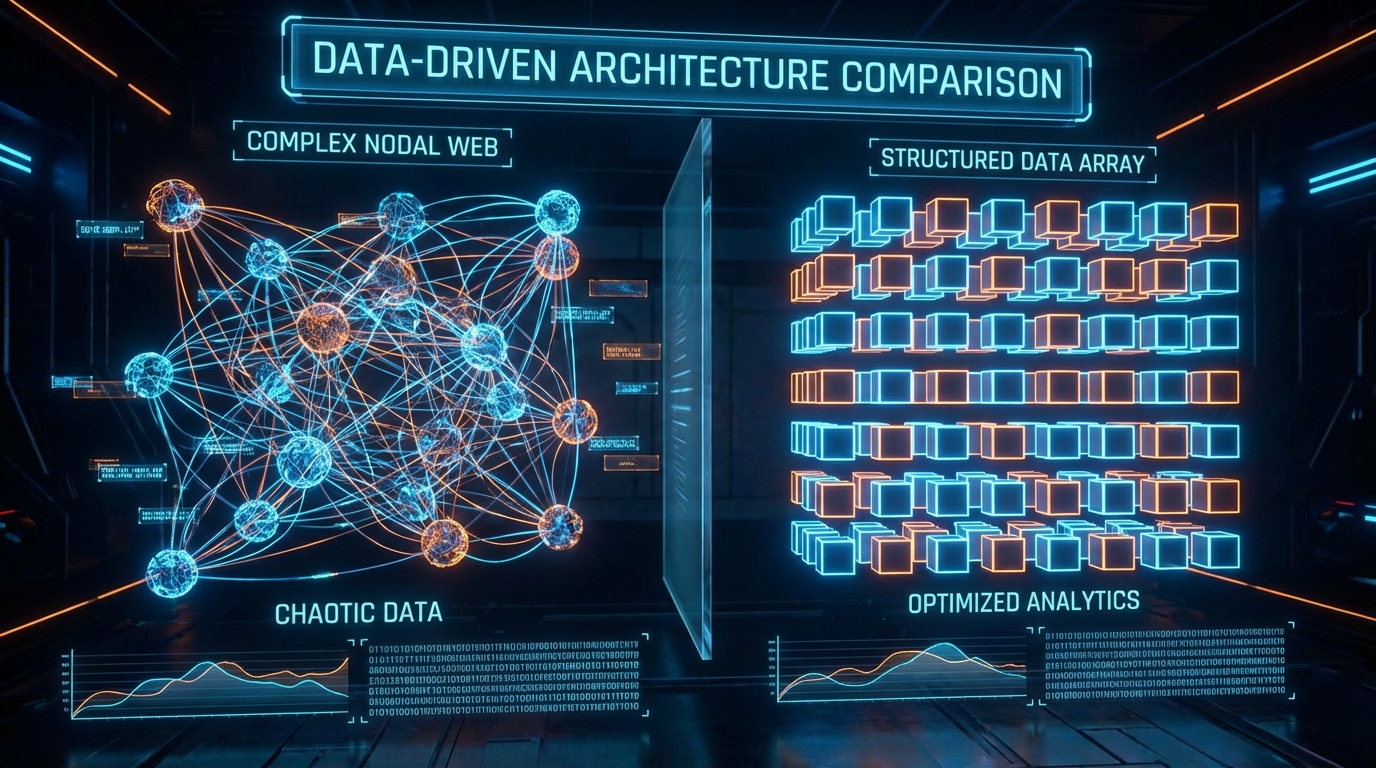

이 문제에 대한 가장 데이터 중심적이고 우아한 해결책은 스키마의 '평탄화(Flattening)'다. API가 요구하는 중첩 구조(예: customer: { address: { city: "Seoul" } })를 LLM에게는 1차원의 키-값 쌍(예: customer_address_city: "Seoul")으로 노출하는 것이다. 실험 결과에 따르면, 이 단순한 평탄화 작업만으로도 도구 호출 정확도는 75~85%에서 95% 이상으로 급격히 상승하며, 호출당 평균 재시도 횟수는 0.5~1.0회에서 0.1회로 삭감된다. 평탄화된 키 이름이 길어져 입력 토큰 사용량은 미세하게 증가할 수 있으나, 재시도 실패로 인해 버려지는 출력 토큰 비용을 감안하면 전체 비용-성능 트레이드오프(Cost-Performance Trade-off) 관점에서 압도적인 이득이다.

기술 블로그 Velog의 분석에서도 알 수 있듯, 도구 호출의 최적화는 '요청'뿐만 아니라 '응답' 페이로드의 정규화까지 수반해야 완성된다. API의 원시 응답(Raw response)이 과도하게 길거나 복잡하면 컨텍스트 윈도우가 오염되어 다음 추론 단계의 품질(Faithfulness)이 급락한다. 따라서 응답 데이터를 배열 슬라이싱(Array slicing)이나 깊이 가지치기(Depth pruning)와 같은 '스마트 잘림(Smart truncation)' 기법으로 압축하여, 구조적 맥락만 LLM에 전달하는 데이터 파이프라인 설계가 필수적이다.

결론적으로, 신뢰할 수 있는 에이전트 시스템을 구축하기 위해서는 LLM에게 완벽한 구문 분석을 기대하는 '희망 기반 아키텍처'를 버려야 한다. 대신 MCP(Model Context Protocol) 래퍼나 결정론적(Deterministic) 미들웨어를 배치하여, LLM은 평탄화된 스키마로 가볍게 추론하고 미들웨어가 이를 복잡한 REST API 규격으로 재조립(Unflatten)하도록 역할을 분리해야 한다. 이는 할루시네이션을 아키텍처 레벨에서 원천 차단하고 프로덕션 환경의 연산 효율성을 극대화하는 가장 강력한 엔지니어링 표준이 될 것이다.