지금 프론트엔드 개발자가 느끼는 이중 압박

AI 코딩 도구가 개발 속도를 끌어올리는 동시에, 사용자는 점점 더 즉각적인 인터랙션을 당연하게 여기고 있다. 한쪽에서는 'AI로 하루 만에 피처를 배포했다'는 이야기가 들리고, 다른 한쪽에서는 느린 페이지 전환과 예측 불가한 AI 생성 코드로 인한 장애 소식이 들린다. 속도와 품질, 이 두 마리 토끼를 동시에 잡아야 하는 압박은 지금 이 시대 프론트엔드 개발자에게 가장 현실적인 숙제다.

Next.js 네비게이션: 세 가지 최적화가 조합될 때 비로소 완성된다

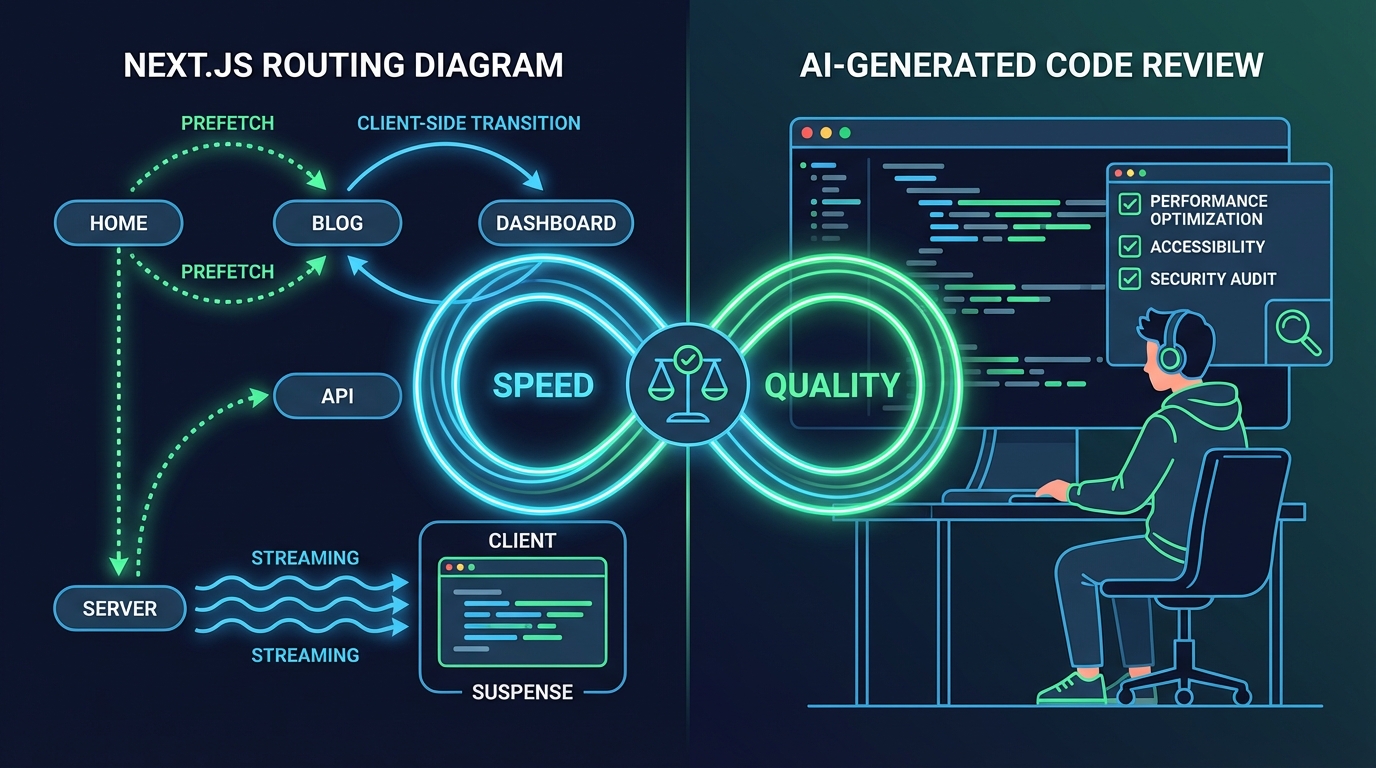

velog의 기술 분석에 따르면, Next.js의 네비게이션 성능은 prefetching, streaming, client-side transitions라는 세 축이 독립적으로 작동하는 게 아니라 조합되어 시너지를 낸다는 구조로 설계되어 있다. 이 중 하나라도 빠지면 사용자 체감 속도가 눈에 띄게 떨어진다.

<Link> 컴포넌트는 뷰포트에 진입하는 순간 백그라운드에서 해당 라우트를 prefetch한다. <a> 태그가 클릭 시점에 서버 요청을 시작하는 것과는 근본적으로 다른 UX다. 단, prefetch 전략은 라우트 유형에 따라 달라진다. static route는 전체가 prefetch되지만, dynamic route는 loading.tsx가 없으면 prefetch 자체가 skip된다. 무한 스크롤처럼 링크가 대량으로 존재하는 UI에서는 prefetch={false} 또는 hover 시에만 prefetch하는 패턴으로 불필요한 네트워크 요청을 줄이는 것이 실무에서 바로 적용 가능한 접근이다.

streaming은 loading.tsx 파일 하나로 활성화된다. Next.js가 내부적으로 page.tsx를 <Suspense> boundary로 감싸기 때문에, 직접 Suspense를 작성하지 않아도 된다. prefetch된 loading skeleton이 먼저 표시되고 실제 콘텐츠가 준비되면 교체되는 구조는 TTFB·FCP·TTI 등 Core Web Vitals를 실질적으로 개선한다. client-side transitions는 shared layout을 그대로 유지하면서 현재 페이지 부분만 교체해 전체 리로드 없이 자연스러운 전환을 만든다.

이 세 가지 최적화에서 실무 개발자가 가장 자주 놓치는 함정은 두 가지다. 첫째, dynamic route에 loading.tsx를 추가하지 않는 것. 피드백 없이 서버 응답을 기다리는 UI는 사용자에게 앱이 멈춘 것처럼 느껴진다. 둘째, generateStaticParams 미적용. dynamic segment가 있는 라우트에 이를 설정하면 빌드 타임에 정적 생성이 되어 매 요청마다 dynamic rendering으로 폴백되는 병목을 제거할 수 있다. 느린 네트워크 환경을 위한 useLinkStatus의 pending 상태 활용도 놓치기 쉬운 디테일이다.

AI 워크플로우 통합: 세 가지 역할로 나누면 오용이 줄어든다

dev.to의 실용 가이드는 AI를 단일 도구가 아닌 세 가지 역할로 구분해서 접근할 것을 제안한다. 이 프레임은 AI 코딩 도구를 막연히 쓰다가 '결과물을 이해 못 하는 상황'에 빠지는 것을 막는 현실적인 가이드라인이다.

첫 번째는 '탐색과 디버깅'이다. 에러 메시지와 관련 코드 컨텍스트를 AI에 붙여넣는 것은 5년 된 Stack Overflow 답변을 뒤지는 것보다 훨씬 효율적이다. AI를 주니어 개발자 멘토링하듯 대하고, 언어·프레임워크·에러·코드 스니펫을 명확히 제공할수록 응답의 질이 높아진다.

두 번째는 '초안 생성'이다. React 컴포넌트 구조, SQL 마이그레이션 스크립트, 유닛 테스트 스텁처럼 반복적이고 구조가 명확한 작업에 AI는 강력하다. 그러나 핵심 비즈니스 로직이나 복잡한 알고리즘을 모호한 설명으로 생성하게 하면, 디버깅 시간이 직접 작성하는 것보다 더 길어진다. AI가 생성한 코드는 반드시 이해하고, 검토하고, 내 것으로 만들어야 한다.

세 번째는 '코드 리뷰어와 설명자'다. 낯선 레거시 코드나 라이브러리 문서를 AI에 던지면 즉각적인 페어 프로그래머로 활용할 수 있다. 잠재적 버그나 안티패턴을 짚어주는 이 역할은 생각보다 저평가되어 있다.

규율을 잃으면 속도가 부채로 쌓인다

dev.to의 또 다른 글 'Don't Abandon the Discipline'은 AI 시대의 가장 위험한 함정을 정확히 짚는다. AI 코딩 도구로 오후 한나절에 완성된 피처를 배포할 수 있게 되자, 팀들이 코드 리뷰·Agile 스프린트·자동화 테스트 같은 검증 프로세스를 '속도를 방해하는 것'으로 여기고 버리기 시작했다는 것이다.

2025 DORA Report는 AI 도입이 배포 안정성을 오히려 7.2% 낮췄다고 보고한다. AI는 증폭기다. 좋은 조직의 강점은 키우지만, 나쁜 조직의 문제도 같은 속도로 키운다. CodeRabbit의 470개 PR 분석에서는 AI 작성 코드가 사람 작성 코드보다 1.7배 많은 이슈를 포함했고, 로직 에러는 75%, 가독성 이슈는 3배 더 많았다.

이 글이 지적하는 핵심은 '이중 포기(Double Abdication)'다. Agile의 지속적 검증을 버리면 무엇을 만들어야 하는지에 대한 이해를 잃고, AI에 코드 작성을 위임하면 어떻게 만들었는지에 대한 이해를 잃는다. 이 두 가지가 동시에 일어날 때, 팀은 아무도 이해하지 못하는 코드를, 아무도 검증하지 않은 가정 위에 쌓아올리게 된다. 새벽 3시에 장애가 터졌을 때 그 코드를 고쳐야 하는 사람은 결국 그것을 생성한 사람이다.

세 가지 시사점: 지금 당장 바꿀 수 있는 것들

이 세 가지 관점을 하나로 엮으면, '빠름'과 '좋음'을 동시에 추구하기 위한 실천 원칙이 보인다.

첫째, Next.js 최적화는 체크리스트로 관리하라. dynamic route를 만들 때는 loading.tsx와 generateStaticParams를 디폴트로 추가하는 팀 컨벤션을 만들어라. 무한 스크롤이 있는 페이지라면 hover prefetch 패턴을 적용해 불필요한 네트워크 요청을 차단하라. 이 습관은 Core Web Vitals 점수를 시스템적으로 지킨다.

둘째, AI는 역할을 정해두고 써라. 탐색·디버깅, 초안 생성, 코드 이해라는 세 역할 중 어디에 AI를 쓰고 있는지 의식적으로 구분하면 오용의 여지가 줄어든다. GitHub Copilot, Cursor 같은 IDE 통합 도구는 컨텍스트가 자동 제공되어 상호작용의 질 자체가 높아진다. 커스텀 인스트럭션을 설정해 AI의 기본 응답 수준을 팀 코딩 컨벤션에 맞추는 것도 유효하다.

셋째, 속도가 올라갈수록 검증 루프를 더 촘촘히 유지하라. Agile의 본질은 빠른 빌드가 아니라 빠른 학습이었다. AI가 빌드 속도를 압축해줄수록, 사용자 검증과 코드 리뷰에 확보된 시간을 더 투자해야 한다. AI가 생성한 코드일수록 리뷰는 더 꼼꼼히 해야 한다는 역설을 팀 문화로 내재화해야 한다.

전망: '규율 있는 속도'가 다음 경쟁력이다

AI 코딩 도구는 이제 월 200달러로 누구나 살 수 있는 도구다. 빠른 생성 능력 자체는 더 이상 경쟁 우위가 아니다. 진짜 차별점은 그 속도 위에 어떤 구조와 규율을 얹느냐에 있다. Next.js의 prefetching·streaming·client-side transitions 삼각편대를 정확히 이해하고 일관되게 적용하는 팀, AI를 역할에 맞게 규율 있게 사용하면서 검증 루프를 놓치지 않는 팀이 다음 단계의 경쟁력을 갖게 될 것이다.

속도와 품질은 트레이드오프가 아니다. 설계의 문제다.