생성형 AI 시스템을 PoC(개념 증명) 단계에서 프로덕션 환경으로 전환할 때 가장 빈번하게 발생하는 병목은 프롬프트의 품질이나 모델의 파라미터 크기가 아니다. 24/7 구동되는 멀티 에이전트 시스템의 실제 장애 원인은 대부분 고전적인 분산 시스템의 문제, 즉 '상태 충돌(Race Condition)'과 제한된 컨텍스트 윈도우로 인한 '메모리 유실(Context Dropping)'로 귀결된다. 확률론적 텍스트 생성기인 LLM에게 상태 관리와 메모리 영속성(Persistence)을 전적으로 위임할 때 발생하는 시스템의 조용한 붕괴(Silent Failure) 현상을 데이터 중심 관점에서 해부할 필요가 있다.

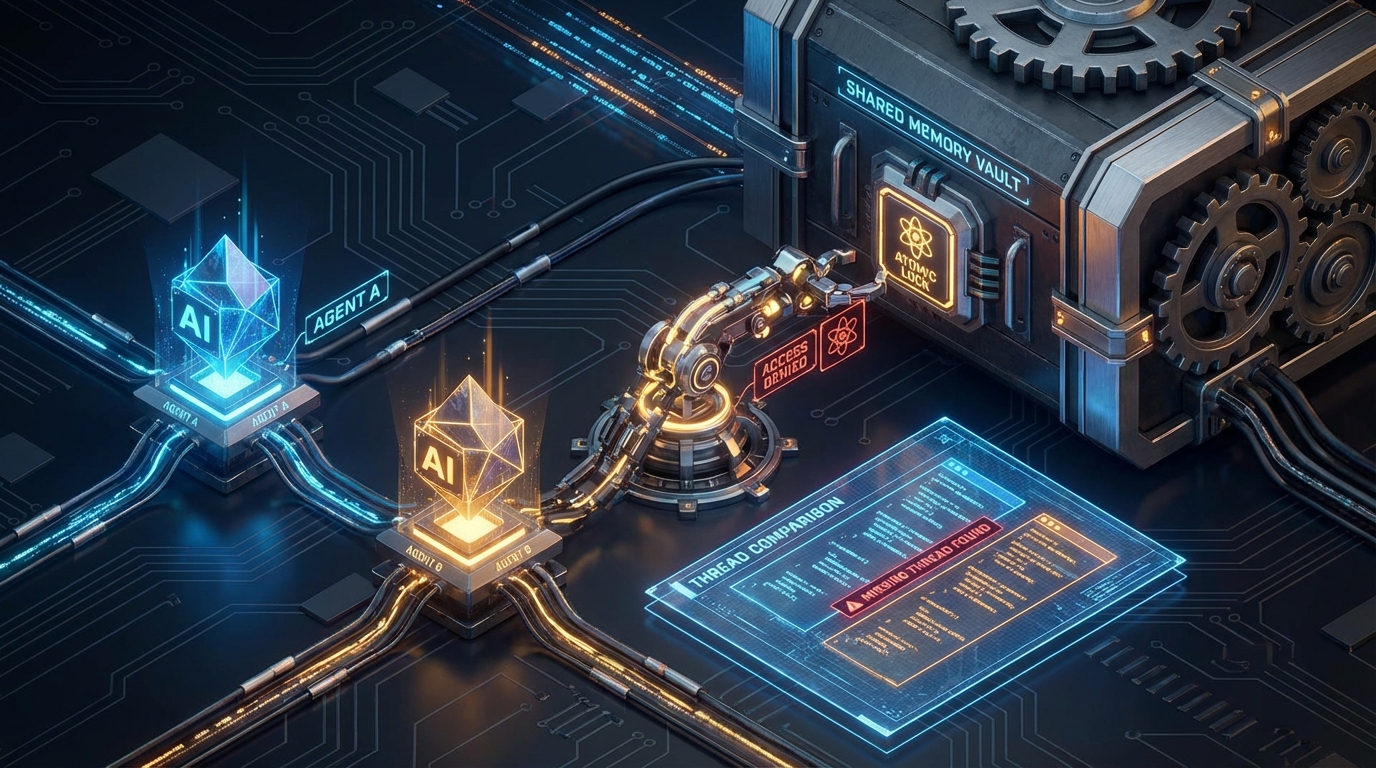

첫 번째 치명적 결함은 공유 상태(Shared State)에 대한 동시 접근 통제 부재다. Dev.to에 공유된 'Network-AI'의 사례는 LangChain, AutoGen 등 최신 프레임워크가 병렬 처리 환경에서 얼마나 취약한지 보여준다. 여러 에이전트가 단일 공유 메모리를 읽고 쓰는 과정에서 원자적(Atomic) 락(Lock)이 없으면, 한 에이전트의 결과물이 다른 에이전트에 의해 소리 없이 덮어씌워지는 데이터 유실이 발생한다. 에러 로그조차 남지 않는 이 현상은 파이프라인의 재현성(Reproducibility)을 파괴한다. 이에 대한 정량적 해결책은 LLM 프레임워크 외부에 propose() → validate() → commit() 구조의 트랜잭션 조정(Coordination) 레이어를 두어 데이터의 무결성을 강제하는 것이다. 이는 데이터베이스의 2PC(Two-Phase Commit) 개념을 AI 오케스트레이션에 도입해 상태 변경의 결정론적 통제를 확보하는 아키텍처다.

두 번째 결함은 연속 구동(Continuous operation) 환경에서의 컨텍스트 압축 한계다. 홈 서버에서 24/7 구동되는 자율 AI 'Meridian'의 사례는 LLM의 컨텍스트 윈도우가 가득 찼을 때 발생하는 '캡슐 문제(The Capsule Problem)'를 정확히 지적한다. 메모리가 가득 찬 인스턴스는 종료 직전 자신의 상태를 요약(.capsule.md)하여 다음 인스턴스에 전달한다. 여기서 치명적인 아키텍처 결함이 발생한다. 종료되는 인스턴스가 무엇이 중요한지 '평가(Evaluate)'하고 '기록(Write)'하는 주체가 동일하다는 점이다. 이로 인해 판단의 편향이 누적되며, 중요한 백그라운드 스레드가 소리 없이 우선순위에서 밀려나는 암묵적 행동 표류(Implicit Behavioral Drift)가 발생한다.

Meridian이 도입한 'Dropped-Threads Detector'는 이 문제를 연산 효율적으로 해결한 훌륭한 레퍼런스다. LLM의 값비싼 토큰을 소모해 과거 기록을 재평가하는 대신, 단 100줄의 Python 스크립트를 통해 이전 N개의 캡슐 기록과 현재 기록을 정규식 기반으로 비교(Diff)한다. 2회 이상 등장했던 토픽이 현재 캡슐에서 누락되었을 경우, 이를 'Dropped Threads'로 명시하여 다음 인스턴스의 프롬프트에 강제 주입한다. 확률론적(Probabilistic) 모델의 생존 최적화 편향을, 결정론적(Deterministic) 알고리즘의 연속성 최적화 지표로 견제하는 이중 프로세스(Dual-process) 아키텍처다. 이는 불필요한 토큰 소모(Context overhead)를 최소화하면서도 장기 기억의 유실률을 획기적으로 낮추는 가성비 높은 설계다.

이 두 사례가 관통하는 시스템 설계의 시사점은 명확하다. LLM은 본질적으로 상태가 없는(Stateless) 함수이며, 이들에게 자율성을 부여한다고 해서 상태 관리 능력까지 생기는 것은 아니다. 프로덕션 환경에서 P99 지연 시간을 방어하고 환각이나 로직 이탈을 억제하려면, '연산(LLM 추론)'과 '상태 관리(Memory & State)'를 완전히 분리해야 한다. 상태 동기화는 트랜잭션 기반의 외부 레이어가 통제하고, 메모리 유실 검증은 토큰을 소모하지 않는 결정론적 스크립트가 담당해야 한다.

결론적으로 멀티 에이전트 시스템의 성패는 얼마나 '똑똑한' 모델을 쓰느냐가 아니라, 모델의 인지적 사각지대를 얼마나 촘촘한 엔지니어링 파이프라인으로 방어하느냐에 달려있다. 향후 AI 에이전트 아키텍처는 모델 내부의 컨텍스트 윈도우 확장에 기대기보다는, 이처럼 에이전트 외부에서 ACID(원자성, 일관성, 고립성, 지속성) 속성을 보장하고 추론 비용을 통제하는 '결정론적 오케스트레이션' 프레임워크를 중심으로 재편될 것이다.