생성형 AI를 프로덕션, 특히 의료와 같은 하이 스테이크(High-stakes) 버티컬 도메인에 배포할 때 가장 위험한 접근은 '단일 범용 모델'에 모든 태스크를 의존하는 것입니다. 최근 국내 의료진이 발표한 두 건의 임상 LLM 성능 검증 결과는, 분류(Classification)와 생성(Generation)이라는 서로 다른 태스크에서 최적화해야 할 목적 함수와 평가지표가 완전히 다르다는 통계적 사실을 명확히 입증합니다.

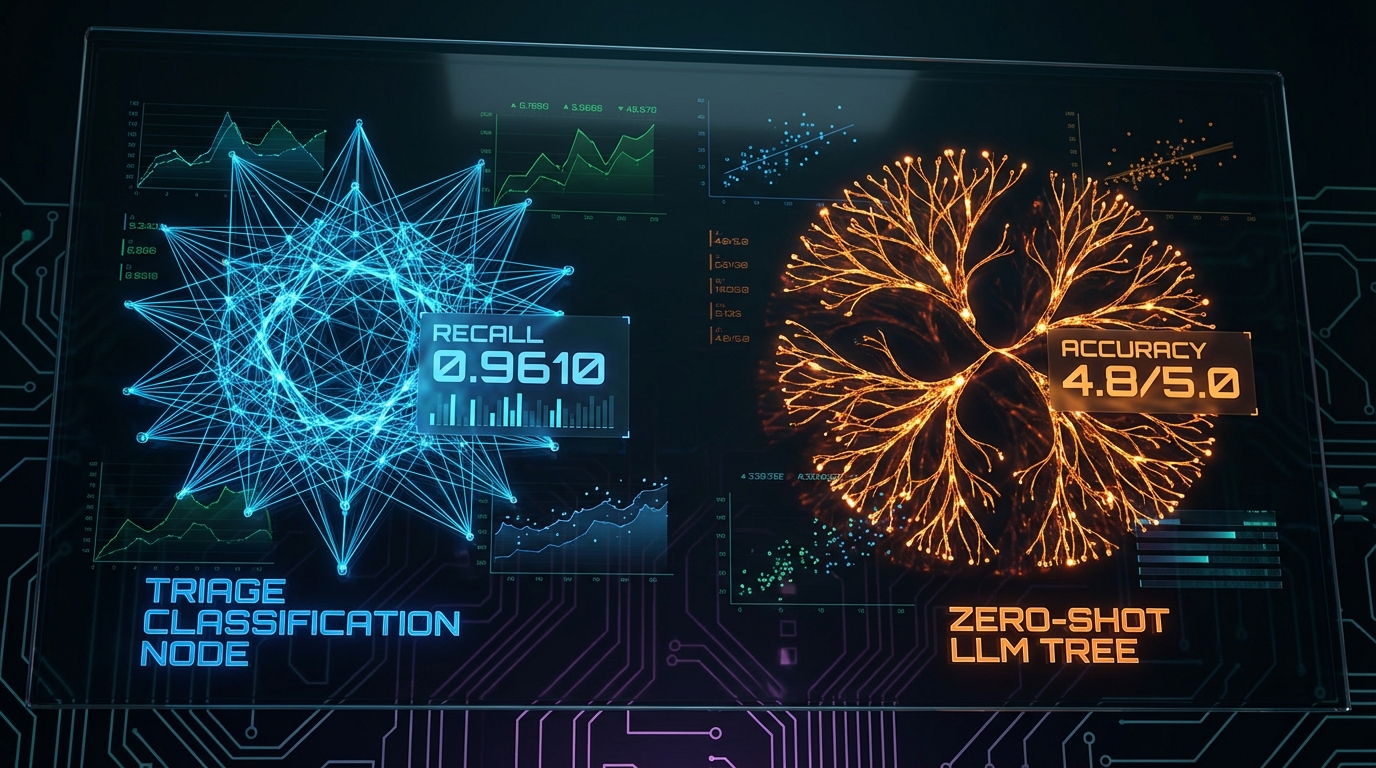

고려대 안산병원 이수교 교수팀의 응급실 중증도(KTAS) 분류 연구는 분류 시스템에서의 '재현율(Recall)' 최적화의 중요성을 보여주는 완벽한 벤치마크입니다. 실제 임상 대화 1,057건을 활용한 검증에서 파인튜닝된 모델의 재현율은 0.9610을 기록해, 제로샷(Zero-shot) 기반의 ChatGPT(0.5352)를 압도했습니다. 응급실 트리아지 라우팅 알고리즘에서 위음성(False Negative, 중증 환자를 경증으로 오분류)은 치명적인 시스템 장애로 직결됩니다. 따라서 프롬프트 엔지니어링에 의존하는 범용 LLM보다, 도메인 특화 데이터로 파인튜닝하여 재현율을 극대화한 모델이 프로덕션 환경의 성능과 안전성 측면에서 우월한 아키텍처임을 시사합니다.

반면, 한림대동탄성심병원 송시영 교수팀의 무릎 인공관절수술 QA 연구는 범용 LLM의 제로샷 생성 품질과 안전장치(Guardrail)가 유발하는 '도움-무해성 트레이드오프(Helpfulness-Harmlessness Trade-off)'를 정량적으로 해부합니다. 전문의 블라인드 평가(5점 리커트 척도) 결과, GPT-4와 Gemini 1.5 등은 평균 4.8점 이상의 높은 정확도를 보였습니다. 여기서 주목해야 할 통계적 이상치(Outlier)는 평균 4.07점을 기록한 Gemini Advanced의 결과입니다. 전문의 상담을 권유하는 기각률(Refusal rate)이 높게 나타난 것은 모델의 지식 부족이 아닌, 할루시네이션(Hallucination)을 억제하기 위한 보수적인 RLHF(인간 피드백 기반 강화학습) 정렬이 과도하게 작동하여 생성 품질을 억제한 결과로 해석해야 합니다.

이 두 데이터 세트가 엔지니어들에게 던지는 시사점은 명확합니다. 의료 AI 파이프라인 구축 시, 인풋 데이터의 노이즈가 심하고 치명도 높은 라우팅 단계(환자 중증도 분류)에서는 일반화 성능을 희생하더라도 도메인 데이터로 파인튜닝된 SLM(Small Language Model)을 앞단에 배치하여 분류 정확도와 P99 지연 시간(Latency)을 최적화해야 합니다. 반면 환자 교육이나 정보 제공과 같은 비결정적(Non-deterministic) 생성 태스크에는 파라미터 규모가 크고 지식 베이스를 갖춘 범용 LLM을 백엔드로 연동하는 하이브리드 오케스트레이션이 필요합니다.

향후 의료 LLM 벤치마크의 과제는 평가의 자동화와 재현성 확보입니다. 현재의 5점 리커트 척도 기반 휴먼 이밸류에이션은 시간과 비용이 높고 주관성이 개입될 여지가 있습니다. 따라서 프로덕션 RAG 프레임워크를 도입하여 답변의 사실성(Faithfulness)과 맥락 관련성(Answer Relevance)을 독립된 LLM-as-a-Judge 파이프라인으로 정량화하고, 실제 서빙 환경에서의 토큰 효율성 및 추론 리소스 최적화 지표를 함께 모니터링하는 체계적인 접근이 요구됩니다.