지금 CAC가 비싸진 이유는 단순합니다. 유저의 ‘질문’이 검색창을 떠나 ChatGPT·Gemini·Perplexity·네이버 AI 브리핑으로 이동했는데, 우리의 콘텐츠는 여전히 SEO만 바라보고 있기 때문입니다. 검색 결과에서의 상위 노출은 유지되는데도 신규 유입이 둔화된다면, 그 공백이 바로 ‘AI 답변 채널’에서 새는 비용입니다.

브런치 연재(「AI가 찾아오는 웹사이트 만들기」, 「SEO 다음은 LLMO다!」)가 던진 핵심은 명확합니다. 네이버/구글 1페이지에 있어도 AI에게는 “존재하지 않을 수 있다.” AI는 링크 권위보다 “기계가 읽기 쉬운 구조”를 우선으로 파싱하고, 그 결과 인용 가능한 출처만 답변에 올립니다. 즉, LLMO는 SEO의 대체재가 아니라 신규 유입면을 여는 채널 확장입니다.

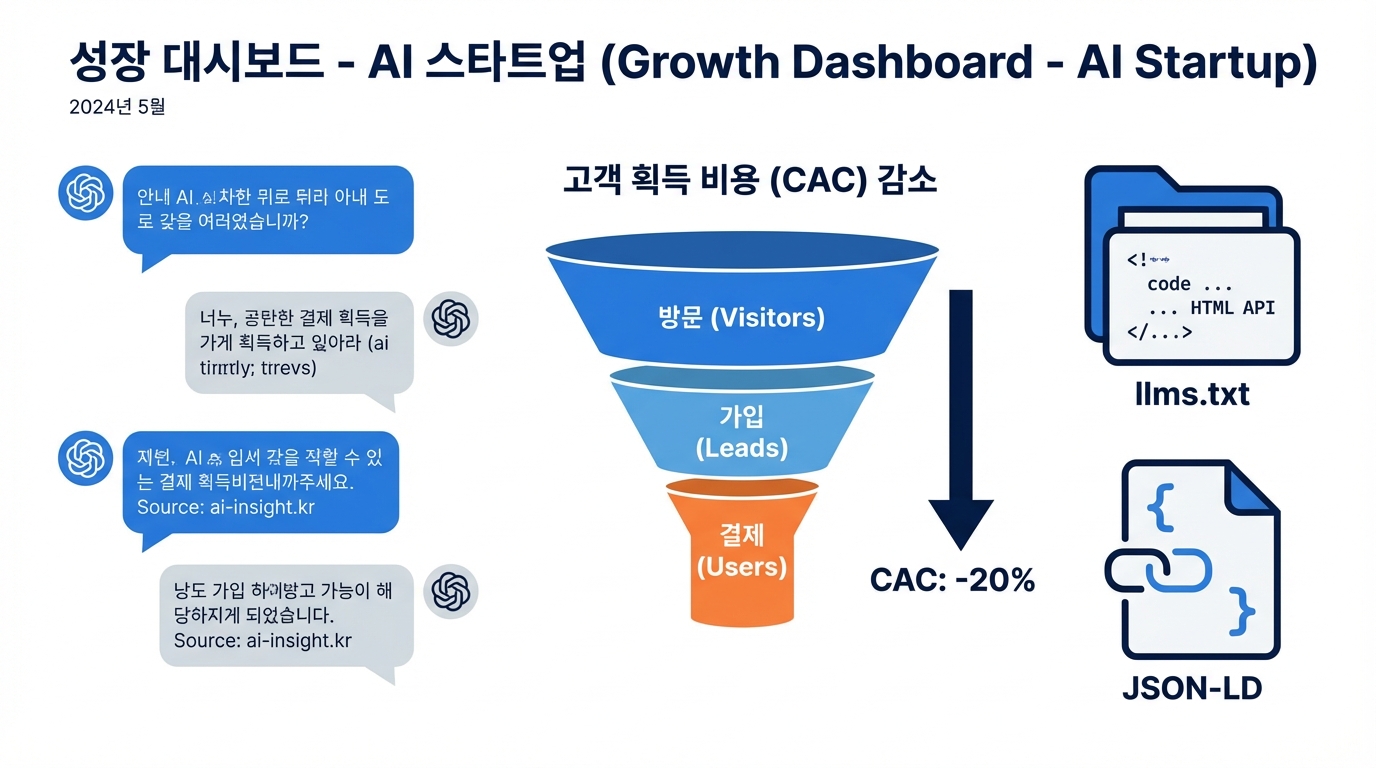

그로스 관점에서 LLMO의 임팩트는 ‘트래픽 증가’보다 ‘CAC 구조 개선’에 있습니다. 광고 CAC는 경매 구조상 바닥이 잘 안 내려갑니다. 반면 AI 인용은 (1) 비용이 고정(콘텐츠/구조화 작업)이고, (2) 누적 자산이 되며, (3) 브랜드/카테고리 키워드가 아닌 “문장형 문제 질문”에서 롱테일 유입을 만들 수 있습니다. 특히 B2B/버티컬 SaaS는 “OO 문제 해결 툴 추천해줘” 같은 질의에서 첫 노출을 먹으면, 이후 퍼널은 제품 경험으로 싸우게 됩니다.

실행은 생각보다 개발 친화적입니다. 소스 기사에서처럼 llms.txt, JSON-LD 구조화 데이터, AI가 읽기 쉬운 Markdown 디렉토리(혹은 URL.md 패턴)를 준비하면 ‘크롤링→이해→인용’ 확률이 올라갑니다. 여기서 중요한 건 멋진 기술 스택이 아니라, AI가 재사용하기 쉬운 “정의/비교/가격/FAQ/근거” 단위로 정보를 쪼개고, 업데이트 가능한 운영 루프를 만드는 겁니다.

하지만 LLMO만으로는 퍼널이 완성되지 않습니다. AI 답변에서 우리를 언급해도, 클릭과 전환은 별개의 게임이니까요. 그래서 상단 퍼널에서 바로 붙일 수 있는 해킹이 ‘제목 CTR 최적화’입니다. dev.to의 TitleScore 사례(Claude API로 300개 유튜브 타이틀을 점수화)는 CTR이 “설명(Describe)”이 아니라 “판매(Sell)”에서 갈린다는 걸 데이터로 보여줍니다. 호기심 갭, 앞 3~4단어의 강도, 구체성(숫자/결과), stakes(돈·시간·리스크) 같은 요소는 검색/소셜/콘텐츠 어디든 적용됩니다.

따라서 실험 설계는 한 번에 묶는 게 효율적입니다. (가설) LLMO로 AI 인용 노출이 늘고, CTR 최적화로 랜딩 유입 효율이 오르면 CAC가 내려간다. (실험) ① 핵심 10개 페이지에 llms.txt+JSON-LD+FAQ/비교 섹션을 추가 ② 동일 주제의 타이틀 3종을 준비해 채널별(검색/뉴스레터/커뮤니티) CTR A/B ③ AI(ChatGPT/Claude/네이버 AI)에서 “브랜드/카테고리 질의”로 주간 인용 여부를 계측. (지표) AI 인용률, 인용→세션 전환율, 랜딩 CVR, 그리고 ‘유기적 CAC(콘텐츠 비용/신규 전환)’를 함께 봅니다.

시사점은 두 가지입니다. 첫째, SEO 팀만의 과제가 아니라 제품/개발/콘텐츠가 합쳐진 ‘인용 가능성(quote-ability) 엔지니어링’이 되어야 합니다. 둘째, LLMO는 “트래픽을 늘리는 기술”이 아니라 “유입 채널 믹스를 바꿔 CAC 상한선을 내리는 전략”으로 재정의해야 ROI가 선명해집니다.

전망은 빠르게 기울 겁니다. 네이버가 HyperCLOVA X 기반 AI 검색으로 UX를 재편하는 상황에서, 검색 결과의 클릭이 줄고 답변 내 인용/추천이 입구가 되는 빈도는 더 커집니다. 지금 LLMO를 시작하는 팀은 ‘모범사례가 적은 초기 구간’의 선점 이익을 가져가고, 나중에 따라가는 팀은 결국 광고비로 격차를 메워야 합니다. 결론: SEO를 유지하되, AI가 “정확히 소개할 수 있는 형태”로 우리 정보를 재구성하는 순간, CAC는 구조적으로 내려갈 수 있습니다.