컴파일이 됐다고 '맞는' 코드가 아니다

시니어 엔지니어가 AI가 작성한 코드를 그대로 머지했다. 타입스크립트 문법은 완벽했고, 테스트도 통과했다. 그런데 프로덕션에 올라가자마자 인증 플로우가 터졌다. AI가 고려하지 않은 엣지 케이스들이 실사용 환경에서 한꺼번에 터진 것이다. dev.to에 소개된 이 실제 사례는 우리가 지금 직면한 문제를 정확히 찌른다. '유효한(valid) 코드'와 '정확한(correct) 코드'는 다르다. AI는 전자를 잘 만들지만, 후자를 보장하지는 않는다.

GitHub Copilot, Claude, ChatGPT—이제 AI 코딩 도구는 실험적 옵션이 아니라 팀 인프라다. 그런데 인프라에는 체계적인 품질 검증이 필요하다. 대부분의 개발자는 AI가 뱉은 코드를 '신탁(divine revelation)'처럼 대한다고 비판한다. 첫 번째 출력물이 곧 최종 결과물이 되는 이 패턴, 당신의 팀에서도 벌어지고 있지 않은가.

문제 1: 단일 모델 함정

AI 모델은 각자의 강점과 맹점이 다르다. GPT-4는 보일러플레이트와 자연어 이해에 강하고, Claude는 에러 핸들링이 촘촘한 대신 코드가 장황한 편이다. Gemini는 간결하지만 엣지 케이스를 놓칠 수 있다. 문제는 하나의 모델만 쓰면 그 모델의 맹점을 그대로 프로덕션에 물려받는다는 것이다.

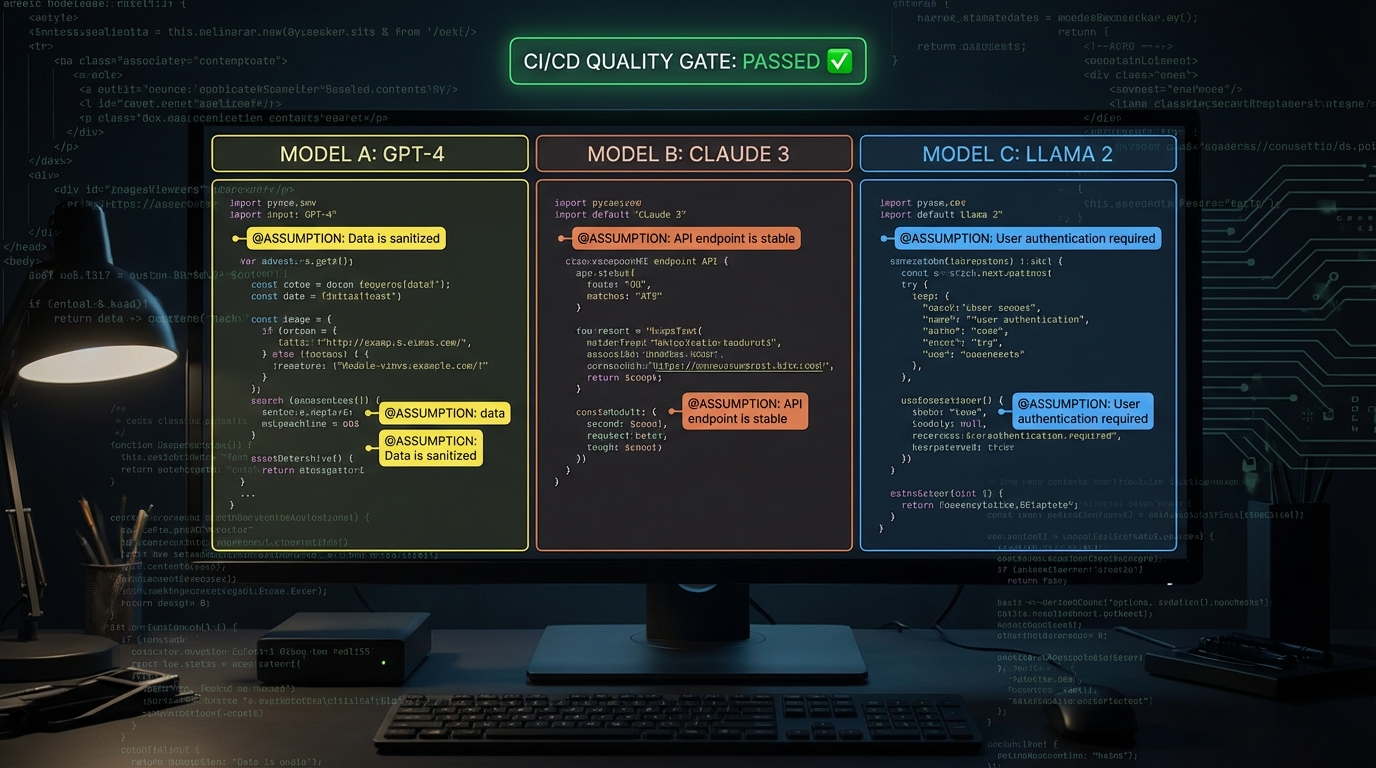

실용적인 대안은 다중 모델 비교 패턴이다. 같은 문제를 Claude, GPT, Gemini에 동시에 던지고, 각 모델이 어떤 트레이드오프를 선택했는지 비교한다. 어떤 가정을 했는지, 어떤 엣지 케이스를 처리했는지, 어떤 디자인 패턴을 택했는지를 보는 것이다. 모델들이 서로 다른 접근을 선택한 지점이 바로 '더 깊이 파야 할 곳'이다. API rate limiting을 구현할 때 Claude는 clock drift와 동시 요청까지 방어하는 토큰 버킷 방식을, GPT는 슬라이딩 윈도우로 Redis 가용성을 가정하는 깔끔한 코드를, Gemini는 메모리 효율을 극대화한 leaky bucket을 제안했다는 사례는 이 접근의 핵심을 잘 보여준다. 세 방식 모두 '틀리지 않았지만', 맥락에 따라 다른 리스크를 갖는다.

문제 2: 스펙 없는 AI는 반드시 추측한다

"백오피스에서 아이템을 관리하는 기능을 추가해줘." AI는 코드베이스를 읽고 패턴을 골라 기능을 구현한다. 겉보기엔 잘 돌아간다. 그런데 같은 아이템을 두 번 추가하면 중복 삽입이 발생한다. 멱등성(idempotency) 여부, 권한 범위, 스토리지 레이어, 에러 처리 전략—이 모든 것이 '묵시적 결정(silent decision)'으로 AI가 추측한 값이다.

이를 해결하기 위해 등장한 개념이 Spec Driven Development(SDD)다. 구현 전에 스펙을 정의하고, 그 스펙을 AI 에이전트에게 주면 추측의 여지를 최소화한다는 원리다. 그런데 데드라인 압박 아래서 스펙 작성 단계는 가장 먼저 생략된다. 이 마찰을 없애기 위해 spec-writer라는 Claude Code 스킬이 공개됐다. 질문을 던지기 전에 먼저 전체 스펙을 생성하고, AI가 임의로 결정한 모든 지점에 [ASSUMPTION: ...] 태그를 붙인다. 개발자는 답을 내놓는 대신 이미 만들어진 스펙의 가정을 검토하고 수정하기만 하면 된다.

실제 CLI 캡처 기능 구현에서 이 스킬을 사용했을 때, 아키텍처 분리 문제(Cloudflare Workers는 로컬 파일시스템을 읽지 못한다)와 민감 데이터 스크러빙 누락이 구현 시작 전에 표면화됐다. 두 가지 모두 코드를 절반쯤 작성한 뒤에야 발견했을 종류의 문제다. 스펙의 가치는 스펙 자체가 아니라 '가시화된 가정'에 있다.

문제 3: 리뷰 도구 선택—AI vs 정적 분석

코드가 완성됐다고 끝이 아니다. PR 단계에서의 리뷰 레이어가 마지막 안전망이다. 현재 시장에서 가장 많이 비교되는 두 도구는 CodeRabbit과 Qodana다.

CodeRabbit은 LLM 기반 PR 리뷰 도구다. 코드 diff만 보는 게 아니라 전체 레포 구조, PR 설명, 연결된 이슈까지 읽는다. '다른 파일의 가정을 깨는 변경'이나 '티켓 요구사항과 어긋나는 구현' 같은 문맥적 오류를 잡을 수 있다. 팀의 리뷰 패턴을 학습해 시간이 지날수록 더 정확해진다는 점도 강점이다. 반면 Qodana는 JetBrains의 정적 분석 플랫폼으로, IntelliJ 3,000개 이상의 검사 규칙을 CI/CD 파이프라인에서 그대로 실행한다. 결정론적(deterministic)이고 IDE와 파이프라인 결과가 일치한다.

두 도구는 경쟁 관계가 아니라 상호 보완 관계다. Qodana가 규칙 기반으로 잡지 못하는 논리 오류와 아키텍처 문제는 CodeRabbit이 잡고, CodeRabbit이 놓치는 결정론적 코드 품질 기준과 커버리지 추적은 Qodana가 담당한다. 20인 팀 기준 둘을 함께 쓰면 연간 약 6,960달러—대부분의 단일 엔터프라이즈 도구보다 저렴하다. 어느 하나만 선택해야 한다면: AI 생성 코드의 맥락적 오류 탐지가 우선이라면 CodeRabbit, JetBrains 생태계 안에서 결정론적 품질 게이트가 필요하다면 Qodana다.

세 레이어를 연결하면 완성된다

정리하면, AI-First 팀의 코드 품질 관리는 세 단계 검증 레이어로 설계할 수 있다.

- 구현 전:

spec-writer로 가정을 가시화하고, 모호성을 제거한 스펙을 에이전트에게 준다. - 구현 중: 단일 모델을 맹신하지 않고 다중 모델 비교로 트레이드오프를 명시화한다.

- 머지 전: CodeRabbit(맥락적 AI 리뷰) + Qodana(결정론적 정적 분석) 조합으로 PR 레벨 안전망을 확보한다.

AI가 쓴 코드에는 더 엄격한 기준이 필요하다

인간은 피곤하거나 요구사항을 이해하지 못해서 버그를 만든다. AI는 컨텍스트 없이 학습 데이터에서 패턴을 매칭하면서 버그를 만든다. 버그의 생긴 원인이 다르면 탐지 전략도 달라야 한다. '컴파일 됐으니 괜찮겠지'는 AI 생성 코드에서 가장 위험한 가정이다.

AI 도구의 생산성 이점을 유지하면서 품질 리스크를 통제하려면, 속도를 늦추는 게 아니라 검증 루프를 자동화해야 한다. 스펙 자동 생성, 다중 모델 비교, AI+정적 분석 병렬 리뷰—이 세 가지는 팀에 내일 당장 도입할 수 있는 구체적인 패턴이다. AI를 '마법 오라클'로 대하는 팀과 '검증이 필요한 첫 번째 초안'으로 대하는 팀 사이의 격차는, 시간이 지날수록 프로덕션 안정성에서 그대로 드러날 것이다.