생성형 AI 에이전트 시스템에서 '영구 메모리(Persistent Memory)' 구현은 더 이상 컨텍스트 윈도우(Context Window) 확장의 문제가 아니다. 최근 Dev.to에 공개된 두 건의 기술 분석에 따르면, 단순 컨텍스트 주입 방식은 토큰 비용의 선형적 증가와 P99 지연 시간(Latency) 저하를 유발하며, 플랫 파일이나 SQLite 기반의 순수 벡터 검색(Vector Search)은 정확한 API 키나 에러 코드 탐색과 같은 렉시컬(Lexical) 매칭에서 치명적인 한계를 드러낸다. 이는 RAG 파이프라인 최적화 시 독립적으로 측정되어야 할 Retrieval 정확도와 Generation 품질이 혼재되면서 발생하는 전형적인 안티패턴이다.

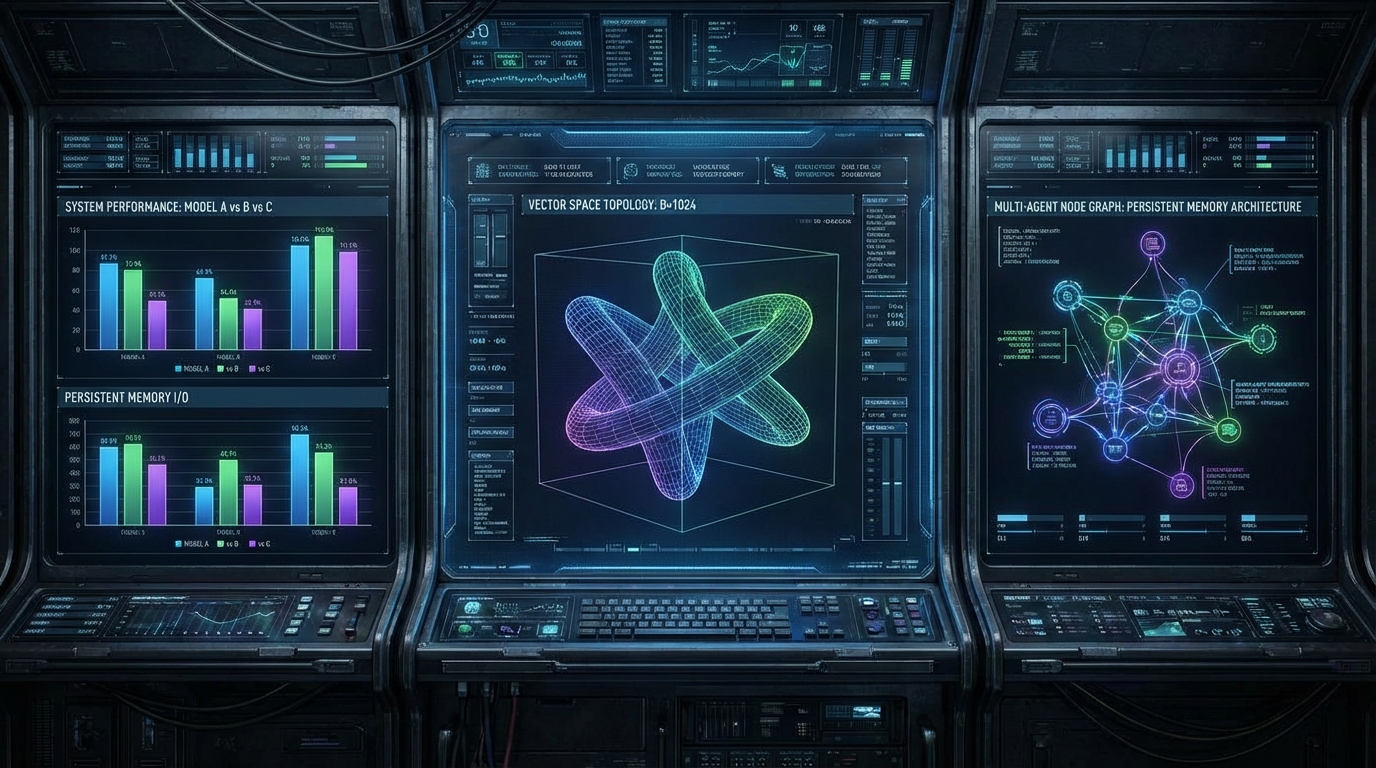

이러한 병목은 상용 메모리 시스템 5종의 LoCoMo 벤치마크(81개 다중 세션 QA 페어) 데이터에서 명확히 입증된다. 클라우드 LLM에 의존하는 MemMachine(91.7%)이나 Zep(~85%), Letta(~83.2%)가 상위권을 차지하지만, 주목해야 할 것은 아키텍처의 트레이드오프다. 독립 연구로 개발된 SuperLocalMemory(SLM)는 4채널 RRF(Reciprocal Rank Fusion) 기반의 수학적 검색(BM25 + 지식 그래프 + 시간 감쇠 + Fisher-Rao 기하학)만을 사용하여 클라우드 API 호출 없이 74.8%(Mode A)의 성능을, 클라우드 합성을 더해 87.7%(Mode C)의 SOTA급 재현율(Recall)을 달성했다. 이는 막대한 토큰 비용 지불 없이도 구조적 검색 알고리즘만으로 벤치마크 유효성의 80% 이상을 캡처할 수 있음을 정량적으로 증명한다.

특히 프로덕션 환경의 다중 에이전트(Multi-Agent) 시스템에서 메모리 아키텍처의 핵심은 임베딩 공간(Embedding Space)의 기하학적 동기화와 하이브리드 가중치 설계에 있다. SurrealDB와 MCP(Model Context Protocol) 기반으로 구축된 최신 메모리 데몬 사례를 보면, 벡터 유사도(70%)와 BM25(30%)를 베이지안 퓨전(Bayesian Fusion)으로 결합하고 빈도와 시간 감쇠(Temporal Decay) 페널티를 부여하여 RAG의 고질적 문제인 의미론적 표류(Semantic Drift)를 통제한다. 더불어 RocksDB 백엔드를 활용한 5-hop 지식 그래프 탐색을 68 마이크로초(µs) 만에 처리함으로써, 기존 SQLite가 겪는 N+1 재귀 쿼리의 I/O 병목을 해소했다. 여기서 3개의 독립된 에이전트가 동일한 nomic-embed-text 로컬 임베딩 모델을 공유하게 한 점은, 다중 에이전트 간 메모리 스코프(Global/Agent/Session)의 벡터 공간 위상을 일관성 있게 유지하기 위한 필수불가결한 설계다.

결론적으로 에이전트 메모리의 진화 방향은 LLM의 블랙박스 추론에 메모리 관리를 전적으로 위임하는 방식(예: Letta)에서, 독립적이고 관측 가능한 로컬 수학적 검색 레이어로 디커플링(Decoupling)되는 추세로 전환되고 있다. 이는 2026년 발효될 EU AI 법(AI Act)에 따른 데이터 주권 이슈와 완벽히 맞물린다. ML 엔지니어는 에이전트 시스템을 평가할 때 단순 벤치마크 총점에 매몰될 것이 아니라, 하이브리드 Retrieval의 Context Precision 메트릭이 단일 임베딩 모델의 기하학적 특성에 어떻게 반응하는지, 그리고 로컬 중심의 RRF 퓨전이 프로덕션 서빙 비용(COGS)을 얼마나 극적으로 감축시킬 수 있는지 그 통계적 유의성을 철저히 검증해야 할 것이다.