[핵심 이슈] LLM 에이전트의 물리적 병목: 컨텍스트 팽창과 메모리 압축의 역설 현재 생성형 AI 씬을 지배하는 가장 위험한 착각은 "컨텍스트 윈도우가 클수록 성능이 비례하여 향상된다"는 맹신이다. 프로덕션 환경에서 에이전트를 서빙해보면, 무분별한 컨텍스트 주입은 필연적으로 'Context Rot(컨텍스트 부패)'과 'Lost in the Middle' 현상을 유발하며 추론 서버의 P99 지연 시간을 폭증시킨다. 이를 해결하기 위해 에이전트 플랫폼 단에서 수행하는 표준 압축(Compaction)은 본질적으로 치명적인 손실 압축(Lossy Compression)이다. 비용과 성능의 트레이드오프를 최적화하려면, 무식하게 컨텍스트를 늘리거나 텍스트를 뭉텅이로 잘라내는(Chunking) 기존 RAG 방식에서 벗어나, '구조화된 온디맨드(On-demand) 회수'라는 아키텍처적 결단이 필요하다.

[맥락 해석 1] Chunk RAG의 한계와 AST 기반 구조화 검색의 95% 토큰 감축 최근 Dev.to에 공개된 'Bringing The Receipts' 벤치마크 리포트는 코드 리트리벌(Code Retrieval) 태스크에서 기존 Chunk 기반 RAG의 비효율성을 명확한 수치로 폭로한다. FastAPI 등 3개의 실제 레포지토리를 대상으로 한 실험에서, 파일을 통째로 읽는 Naive 방식은 186만 토큰을 소모한 반면, Tree-Sitter 기반으로 AST(추상 구문 트리)를 분석해 함수/클래스 단위의 심볼만 정밀 타격하는 jCodeMunch 시스템은 단 9.2만 토큰만을 사용했다. 무려 95%의 토큰 압축률(20.2배 효율화)이다. 더욱 통계적으로 유의미한 데이터는 검색 정확도(Precision)다. Chunk RAG가 74%의 정확도에 머문 반면, AST 기반 구조화 검색은 96%를 달성했다. 이는 프롬프트 엔지니어링 수준을 넘어, 정보의 단위(Unit of Retrieval)를 '임의의 텍스트 덩어리'에서 '논리적 객체'로 재설정했을 때 얻을 수 있는 구조적 알파(Alpha)다. 1달러의 쿼리 비용을 0.002달러로 낮추면서도 정확도를 높일 수 있음을 재현 가능한(Reproducible) 오픈소스 테스트 하네스로 입증했다는 점에서 시스템적 가치가 높다.

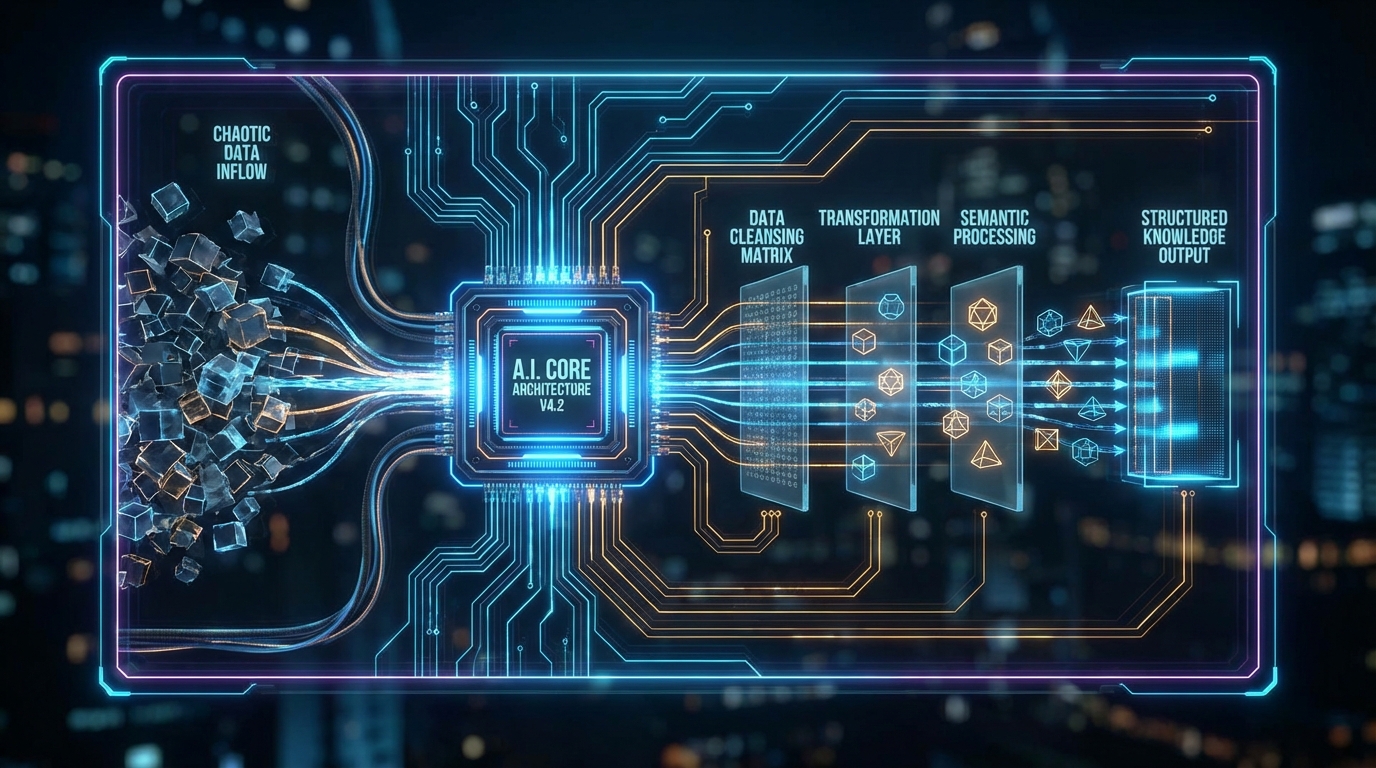

[맥락 해석 2] 77%의 엔티티 유실을 방어하는 3계층 온디맨드 메모리 아키텍처 컨텍스트의 품질 문제는 단일 검색 세션을 넘어 멀티 에이전트의 영구 메모리(Persistent Memory) 영역으로 갈수록 더 심각해진다. 'Context Quality is the New Model Quality' 리포트에 따르면, 토큰 제한으로 인해 발생하는 LLM의 표준 요약 및 압축 과정에서 의사결정, 도구, 날짜 등 핵심 '네임드 엔티티(Named Entities)'의 77%가 유실되는 것으로 실측되었다. 이는 에이전트의 맥락 상실과 치명적인 환각(Hallucination)으로 직결된다. 해당 연구는 L1(플랫폼 네이티브 요약), L2(구조화된 지식 베이스), L3(전체 메시지 SQL 아카이브)로 구성된 UAML(Universal Agent Memory Layer) 3계층 회수 아키텍처를 대안으로 제시한다. 이 구조는 매 턴(Turn)마다 모든 컨텍스트를 주입하는 대신, 필요시 100ms 이하의 레이턴시로 L2와 L3에서 원본 데이터를 '온디맨드'로 인덱싱해 온다. 그 결과, 턴당 토큰 비용을 극도로 통제하면서도 정보 복구율 100%라는 완벽한 무손실(Lossless) 재현성을 달성했다.

[시사점] 모델 스케일링에서 컨텍스트 품질 엔지니어링으로의 패러다임 전환 위 두 사례는 AI 시스템 최적화의 핵심 병목이 '모델의 파라미터 크기'가 아니라 '입력 컨텍스트의 신호 대비 잡음비(SNR, Signal-to-Noise Ratio)'에 있음을 정량적으로 증명한다. 프로덕션 레벨의 데이터 파이프라인 설계자는 이제 단순한 Vector DB의 코사인 유사도에 의존하는 1차원적 RAG 설계에서 벗어나야 한다. 메타데이터 기반의 하드 필터링, AST나 지식 그래프(Knowledge Graph)를 활용한 결정론적 구조화, 그리고 런타임에 필요한 정보만 동적으로 라우팅하여 가져오는 에이전틱 메모리 서킷 구축이 필수적이다. 이는 추론 서버의 VRAM 메모리 스왑과 연산 낭비를 줄이고, TTFT(Time To First Token)를 비약적으로 단축시켜 최종적으로 시스템의 P99 레이턴시 SLA(Service Level Agreement)를 달성하는 가장 확실한 실무적 해법이다.

[전망] 맹목적인 컨텍스트 주입의 종말과 에이전트 상태(State)의 디커플링 장기적으로 에이전트 아키텍처는 초기 프레임워크들처럼 모든 과거 기억을 프롬프트에 욱여넣는 컨텍스트 의존적 방식을 완전히 폐기할 것이다. 대신, 에이전트의 연산 엔진(LLM)과 상태 저장소(Memory/Context)를 철저히 디커플링(Decoupling)하고, MCP(Model Context Protocol)와 같은 표준화된 인터페이스를 통해 필요한 구조화된 컨텍스트만 마이크로초(µs) 단위로 페치(Fetch)하는 아키텍처가 프로덕션 표준이 될 것이다. 비용-성능 트레이드오프 벤치마크에서 최종적으로 승리하는 시스템은 더 거대한 컨텍스트 윈도우를 가진 모델을 호출하는 곳이 아니라, 단 1개의 토큰도 낭비 없이 96% 이상의 정확도로 컨텍스트를 조립해 내는 데이터 파이프라인 정밀도를 갖춘 곳일 것이다.