OpenAI가 Codex를 '코딩 에이전트 플랫폼'으로 공개 포지셔닝했다. 코드 완성이나 페어 프로그래밍이 아니다. 계획(Plan)부터 설계, 빌드, 테스트, 리뷰, 문서화, 배포·유지보수까지 SDLC 7단계 전체를 에이전트에게 위임하는 것이 목표다. 25시간 무중단 작업, 서버사이드 컴팩션을 통한 장시간 컨텍스트 유지, OS 수준 샌드박스—기술 스펙만 보면 꽤 설득력 있다. 문제는 '도입 선언'과 '팀에 실제로 꽂는 것' 사이의 거리다. 그 거리를 세 단계로 좁히는 것이 이 글의 목적이다.

1단계: 에이전트 위임의 실제 진입점을 확인하라

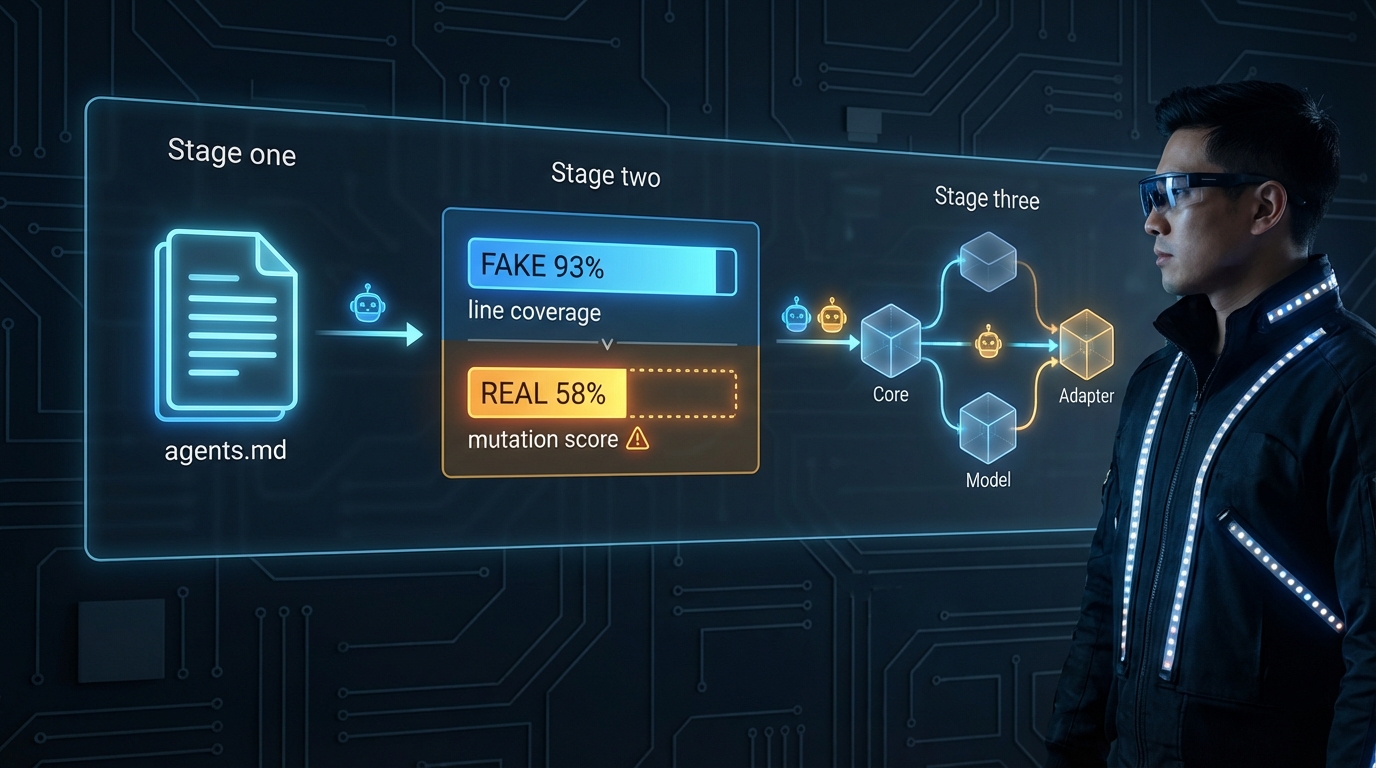

Codex가 흥미로운 이유는 단순히 기능이 많아서가 아니다. agents.md라는 리포지토리 단위 행동 지침 파일, Skills로 패키징되는 재사용 워크플로우, Automations로 스케줄 실행되는 백그라운드 작업—이 세 가지가 조합되면 에이전트가 팀의 컨벤션을 학습하고 반복 업무를 자율 실행하는 구조가 만들어진다. PR Babysitter 스킬이 CI/CD 파이프라인을 모니터링하며 자동 머지까지 처리하거나, Triage Page 스킬이 인시던트 ID 하나로 로그 분석부터 패치까지 원스톱으로 돌아가는 데모는 과장이 아니다. OpenAI 내부 모노레포에서 실제로 쓰고 있다.

그러나 팀 리드 입장에서 진입점은 화려한 데모가 아니라 agents.md다. /init 명령으로 첫 파일을 자동 생성하고, 리포지토리 개요·실행 명령·테스트 기대치·커밋 가이드라인을 100줄 이하로 담아라. 이 파일이 없으면 Codex는 팀의 컨벤션을 모르는 채로 코드를 생성한다. 반대로 이 파일이 잘 관리되면, 에이전트는 npx tsc와 npm test를 스스로 실행하며 팀 규약 준수 여부를 자가 검증한다. 도입 첫 주에 할 일은 Codex 앱 설치보다 agents.md 초안 작성이다.

2단계: 93%라는 숫자를 믿지 마라

Codex를 팀에 꽂고 나면 반드시 마주치는 함정이 있다. AI가 생성한 테스트의 라인 커버리지 수치다. dev.to에 공개된 실험 결과는 충격적이다. AI가 생성한 테스트 스위트의 라인 커버리지는 93.1%였다. 그런데 Stryker 뮤테이션 테스팅을 돌리자 실제 결함 탐지율(MSI)은 58.62%로 떨어졌다. 34%포인트의 간극—이게 바로 'AI 테스트 품질의 기본값'이다.

메커니즘은 단순하다. 모델은 테스트를 생성할 때 함수를 호출하고, 뭔가가 반환되거나 예외가 없으면 통과시키는 방식으로 쓰는 경향이 있다. calculateTax(100)을 호출하고 result !== null을 assert하면 라인 커버리지는 100%다. 하지만 세율 계산이 틀려도, 반올림이 잘못돼도, 부호가 바뀌어도 이 테스트는 통과한다. 이건 모델의 악의가 아니다. 인터넷에 존재하는 수십 년치 테스트 코드 대부분이 이 패턴으로 작성돼 있고, 모델은 그걸 학습했다.

좋은 소식은 해법이 있다는 것이다. 같은 실험에서 Stryker가 생존한 뮤턴트 목록을 AI에게 제공하고 assertion을 강화하도록 지시하는 과정을 세 라운드 반복했더니, MSI가 93.10%까지 올라갔다—공교롭게도 라인 커버리지가 보고했던 바로 그 숫자. 모델은 '무엇이 더 나은 테스트인지'를 판단할 외부 기준이 있으면 그에 맞춰 반복 개선한다. 품질 게이트를 생성 루프 밖에 두는 것, 이게 핵심이다.

팀에 당장 적용할 수 있는 액션은 두 가지다. 첫째, CI 파이프라인에 npx stryker run을 추가하고 MSI 임계값을 설정하라. 라인 커버리지 게이트만으로는 AI 생성 테스트의 품질을 보장할 수 없다. 둘째, Codex에 테스트를 맡길 때 TDD 순서를 강제하라—테스트 먼저, 실패 확인, 그 다음 구현. agents.md에 이 원칙을 명시하면 에이전트가 자발적으로 따를 가능성이 높아진다.

3단계: 에이전트 친화적 아키텍처를 선택하라

테스트 품질 문제를 잡았다면, 더 근본적인 질문이 남는다. 코딩 에이전트가 주 개발자인 팀의 아키텍처는 어떻게 설계해야 하는가. dev.to의 분석이 이 지점을 정확히 짚는다. 현대 백엔드 아키텍처—마이크로서비스, ORM, Docker, Kubernetes—는 팀 간 독립 배포와 "내 PC에서는 되는데" 문제를 해결하기 위해 인간 중심으로 진화했다. AI 에이전트는 다르다. 에이전트는 컨텍스트 윈도우로 작동한다. 서비스가 늘어날수록, 설정 파일이 많아질수록, 암묵적 의존성이 쌓일수록 에이전트의 컨텍스트는 빠르게 소진되고 통합 지점에서 버그가 터진다.

Claude Code가 Express, Prisma, Postgres, Redis, WebSocket 서버, Docker Compose를 조합한 표준 프로덕션 스택을 셋업할 때, 개별 구성 요소는 80% 정확도로 맞추지만 서비스 간 통합—환경변수 불일치, 마이그레이션-시드 충돌, 캐시 무효화 로직 누락—에서 무너진다는 관찰은 우리 팀에서도 반복적으로 확인된 패턴이다. 문제는 모델이 아니라 아키텍처다.

에이전트 친화적 아키텍처의 공통 원칙은 세 가지로 수렴한다. 파일 수를 줄여라—에이전트가 추론해야 할 설정 표면이 줄어든다. 명시적 선언을 늘려라—데이터 모델이 API를 생성하고, 인프라가 코드에서 선언되면 에이전트가 4단계 인다이렉션을 추적할 필요가 없다. 선언형으로 설계하라—에이전트는 '어떻게'가 아닌 '무엇을'을 지시받을 때 더 안정적으로 동작한다. BaaS(Supabase, Convex), 코드-as-인프라(Encore, SST), 통합 런타임(Harper)이 각각 다른 방식으로 이 원칙을 구현한다. 팀의 규모와 마이그레이션 비용을 감안해 선택해야 하지만, 방향은 동일하다.

팀에 꽂는 순서가 결과를 결정한다

세 단계를 다시 정리하면: agents.md 먼저 → MSI 게이트 추가 → 아키텍처 단순화. 이 순서가 중요하다. agents.md 없이 Codex를 돌리면 팀 컨벤션과 무관한 코드가 쌓인다. MSI 게이트 없이 AI 테스트를 믿으면 녹색 CI 뒤에 37%의 결함 탐지 공백이 생긴다. 에이전트 친화적 아키텍처 없이 복잡한 멀티서비스 스택을 그대로 유지하면, 에이전트 성능은 통합 지점에서 계속 무너진다.

OpenAI가 'Building an AI Native Engineering Team' 가이드에서 강조한 것처럼, 에이전트 도입 이후 테스트와 리뷰 단계의 중요성은 오히려 높아진다. 생성 속도가 빨라질수록 검증의 밀도가 그것을 따라가야 한다. Codex가 코드를 쓰는 시간을 아껴주는 만큼, 테크 리드가 확보한 여유는 품질 게이트 설계와 아키텍처 단순화에 써야 한다. 에이전트는 도구가 아니라 동료다—동료가 잘 일하도록 환경을 설계하는 것이 여전히 사람의 일이다.