생성형 AI를 프로덕션 환경에 배포할 때 엔지니어들이 가장 경계해야 할 것은 '조용한 실패(Silent Failure)'다. 어제까지 95%의 Answer Relevance를 보이던 RAG 파이프라인이 오늘 갑자기 환각을 쏟아내거나, 특정 포맷을 완벽히 지키던 에이전트의 라우팅이 엇나가는 현상이다. 우리는 흔히 프롬프트나 벡터 DB의 데이터 오염을 의심하지만, 근본적 원인은 종종 더 깊은 곳에 있다. API 제공자의 통보 없는 모델 업데이트(잠수함 패치)로 인한 '행동 드리프트(Behavioral Drift)'와, 자체 파인튜닝한 모델의 표면적 출력에 속아 추론 능력을 과대평가하는 '착시 현상'이다. 이 두 가지 리스크는 단순한 휴리스틱이나 Human Evaluation으로는 결코 잡아낼 수 없다.

최근 일리노이 대학교(UIUC) 연구팀과 Project VAIL이 발표한 '스태빌리티 모니터(Stability Monitor)' 연구는 API 블랙박스 내부의 기만을 정량적으로 폭로했다. 개발자들은 흔히 LLM 호출 시 temperature=0으로 설정하면 결정론적(Deterministic) 출력이 보장될 것이라 믿는다. 하지만 이는 환상이다. 서비스 제공자가 vLLM에서 기본 Transformers로 추론 엔진을 교체하거나, KV 캐시 최적화를 위해 배치를 조정하거나, 비용 절감을 위해 BF16에서 INT8로 양자화(Quantization)를 적용하는 순간 출력의 확률 분포는 완전히 틀어진다. 연구팀은 멀티 에이전트 환경에서 이러한 미세한 비결정성이 파이프라인 후반부로 갈수록 눈덩이처럼 불어나는 '오차 전파(Error Propagation)' 현상을 지적했다.

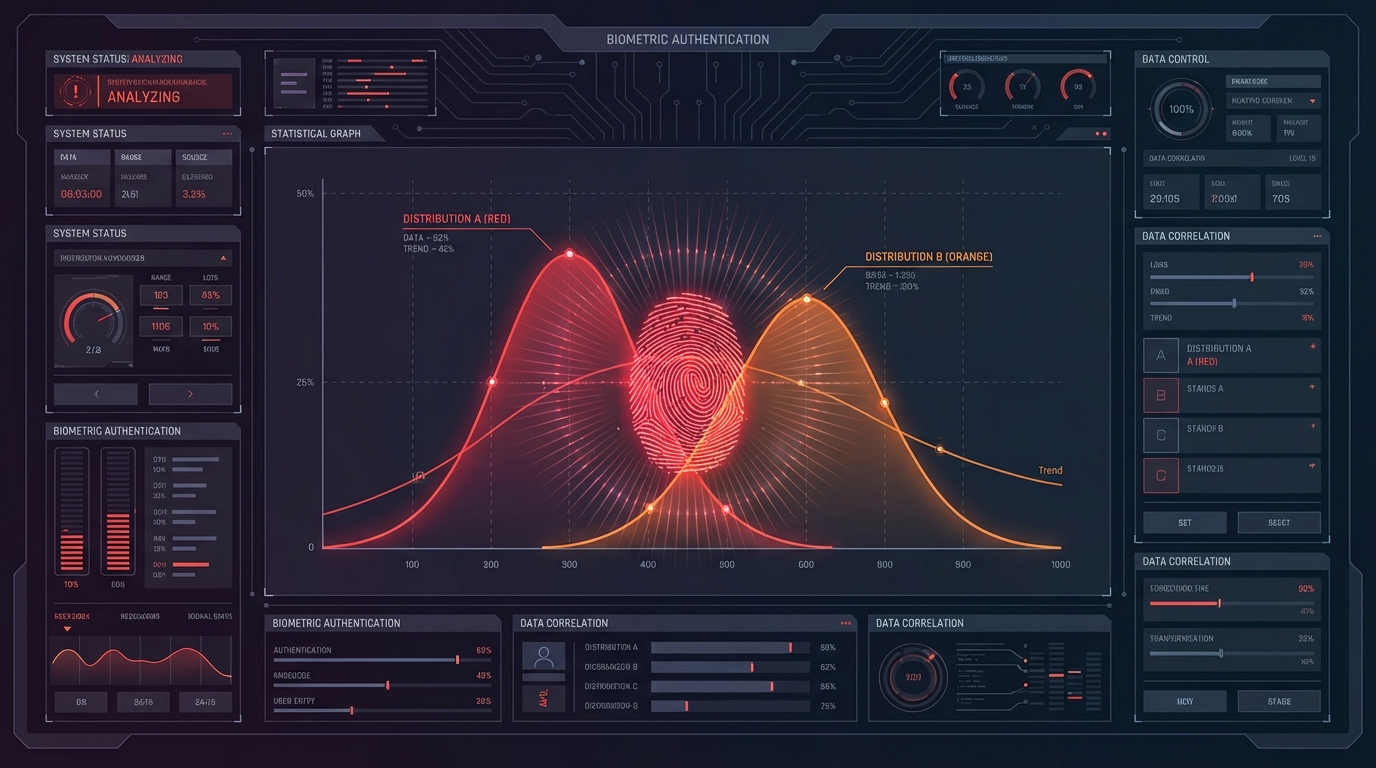

스태빌리티 모니터의 평가 방법론은 통계적 엄밀성이 돋보인다. 모델의 가중치에 접근할 수 없는 환경에서, 800개의 고정된 프롬프트 세트를 주입해 생성된 텍스트를 벡터화하여 '지문(Fingerprint)'을 추출한다. 이후 두 응답 분포 간의 차이를 '에너지 거리(Energy Distance)'라는 통계 기법으로 측정하고, 순열 검정(Permutation test)을 통해 p-value를 산출하여 우연적 오차와 실제 모델 드리프트를 완벽히 분리해냈다. 실제 모니터링 결과는 충격적이다. 동일한 'Kimi-K2' 모델을 서빙함에도, 무샷(Moonshot)의 직접 서비스는 100%의 안정성을 보인 반면, 딥인프라(DeepInfra) 엔드포인트에서는 지속적인 변화 이벤트(Change Event)가 감지되었다. 이는 벤치마크 점수나 모델 이름만 믿고 엔드포인트를 스위칭하는 A/B 테스트가 얼마나 위험한지 증명한다.

API 제공자의 드리프트가 통제 불가능한 외부 리스크라면, 자체 파인튜닝(Fine-tuning)이 유발하는 착시는 개발자의 오판이 부르는 내부 리스크다. 최근 Dev.to 커뮤니티에 공유된 Qwen 2.5 3B 모델의 QLoRA 파인튜닝 사례는 이를 적나라하게 보여준다. 저자는 자신의 이메일, 일기 등 9,572개의 데이터셋(16.6MB)으로 1 epoch을 학습시켰고, Loss는 2.99에서 0.73으로 극적으로 떨어졌다. 결과물은 저자의 철학적 문체와 어휘를 완벽히 모방하는 데 성공했다.

하지만 텍스트의 표면적 스타일(Voice)이 전이되었다고 해서, 모델의 구조적 이해나 정체성(Identity)까지 전이된 것은 아니다. 저자는 이 모델이 화자와 타인을 구분하지 못하고 맥락을 혼동하는 것을 발견하고 이를 '훈련 전이 환상(Training Transfer Illusion)'이라 명명했다. 이는 파인튜닝을 대하는 실무자들에게 치명적인 인사이트를 제공한다. 3B 수준의 경량 모델은 파인튜닝을 통해 타깃 데이터의 확률 분포(Distribution)는 암기할 수 있지만, 그 언어 기저에 깔린 참조 구조(Referential structure)나 포지셔닝은 학습하지 못한다. 즉, RAG의 답변 포맷팅이나 에이전트의 JSON 출력 양식을 맞추는 데는 파인튜닝이 유효하지만, 도메인 특화적인 '논리적 추론 능력' 자체를 파인튜닝으로 주입하려는 시도는 비용 대비 효과가 극히 떨어진다는 뜻이다.

결국 LLM 시스템의 평가는 '표면적 텍스트의 형태'에서 '행동 분포의 통계적 일관성'으로 측정 패러다임이 전환되어야 한다. 프로덕션 환경의 RAG나 멀티 에이전트 오케스트레이션을 구축할 때, 단순히 LLM-as-Judge 1~2회로 품질을 담보해서는 안 된다. 스태빌리티 모니터처럼 통제된 테스트셋을 주기적으로 실행하여 엔드포인트의 에너지 거리를 추적하는 AgentOps 파이프라인을 구축해야 한다. 또한 파인튜닝된 모델의 성능을 평가할 때는 BLEU나 ROUGE 같은 표면적 N-gram 유사도 지표를 버리고, NLI(Natural Language Inference) 기반의 함의 검증이나 철저히 분리된 추론 능력 벤치마크를 통해 '훈련 전이 환상'을 걷어내야 한다. 데이터 중심의 AI 시스템에서 신뢰성은 맹신이 아닌, 지독할 만큼 반복적인 통계적 검증 위에서만 성립한다.